diff --git a/CODE_OF_CONDUCT.md b/CODE_OF_CONDUCT.md

deleted file mode 100644

index 5d8023ba..00000000

--- a/CODE_OF_CONDUCT.md

+++ /dev/null

@@ -1,74 +0,0 @@

-

-# Contributor Covenant Code of Conduct

-

-## Our Pledge

-

-In the interest of fostering an open and welcoming environment, we as

-contributors and maintainers pledge to making participation in our project, and

-our community a harassment-free experience for everyone, regardless of age, body

-size, disability, ethnicity, gender identity and expression, level of experience,

-education, socio-economic status, nationality, personal appearance, race,

-religion, or sexual identity and orientation.

-

-## Our Standards

-

-Examples of behavior that contributes to creating a positive environment

-include:

-

-* Using welcoming and inclusive language

-* Being respectful of differing viewpoints and experiences

-* Gracefully accepting constructive criticism

-* Focusing on what is best for the community

-* Showing empathy towards other community members

-

-Examples of unacceptable behavior by participants include:

-

-* The use of sexualized language or imagery and unwelcome sexual attention or

- advances

-* Trolling, insulting/derogatory comments, and personal or political attacks

-* Public or private harassment

-* Publishing others' private information, such as a physical or electronic

- address, without explicit permission

-* Other conduct which could reasonably be considered inappropriate in a

- professional setting

-

-## Our Responsibilities

-

-Project maintainers are responsible for clarifying the standards of acceptable

-behavior and are expected to take appropriate and fair corrective action in

-response to any instances of unacceptable behavior.

-

-Project maintainers have the right and responsibility to remove, edit, or

-reject comments, commits, code, wiki edits, issues, and other contributions

-that are not aligned to this Code of Conduct, or to ban temporarily or

-permanently any contributor for other behaviors that they deem inappropriate,

-threatening, offensive, or harmful.

-

-## Scope

-

-This Code of Conduct applies both within project spaces and in public spaces

-when an individual is representing the project or its community. Examples of

-representing a project or community include using an official project e-mail

-address, posting via an official social media account, or acting as an appointed

-representative at an online or offline event. Representation of a project may be

-further defined and clarified by project maintainers.

-

-## Enforcement

-

-Instances of abusive, harassing, or otherwise unacceptable behavior may be

-reported by contacting the project team at https://knowstreaming.com/support-center . All

-complaints will be reviewed and investigated and will result in a response that

-is deemed necessary and appropriate to the circumstances. The project team is

-obligated to maintain confidentiality with regard to the reporter of an incident.

-Further details of specific enforcement policies may be posted separately.

-

-Project maintainers who do not follow or enforce the Code of Conduct in good

-faith may face temporary or permanent repercussions as determined by other

-members of the project's leadership.

-

-## Attribution

-

-This Code of Conduct is adapted from the [Contributor Covenant][homepage], version 1.4,

-available at https://www.contributor-covenant.org/version/1/4/code-of-conduct.html

-

-[homepage]: https://www.contributor-covenant.org

diff --git a/CONTRIBUTING.md b/CONTRIBUTING.md

deleted file mode 100644

index 06577128..00000000

--- a/CONTRIBUTING.md

+++ /dev/null

@@ -1,150 +0,0 @@

-

-

-

-# 为KnowStreaming做贡献

-

-

-欢迎👏🏻来到KnowStreaming!本文档是关于如何为KnowStreaming做出贡献的指南。

-

-如果您发现不正确或遗漏的内容, 请留下意见/建议。

-

-## 行为守则

-请务必阅读并遵守我们的 [行为准则](./CODE_OF_CONDUCT.md).

-

-

-

-## 贡献

-

-**KnowStreaming** 欢迎任何角色的新参与者,包括 **User** 、**Contributor**、**Committer**、**PMC** 。

-

-我们鼓励新人积极加入 **KnowStreaming** 项目,从User到Contributor、Committer ,甚至是 PMC 角色。

-

-为了做到这一点,新人需要积极地为 **KnowStreaming** 项目做出贡献。以下介绍如何对 **KnowStreaming** 进行贡献。

-

-

-### 创建/打开 Issue

-

-如果您在文档中发现拼写错误、在代码中**发现错误**或想要**新功能**或想要**提供建议**,您可以在 GitHub 上[创建一个Issue](https://github.com/didi/KnowStreaming/issues/new/choose) 进行报告。

-

-

-如果您想直接贡献, 您可以选择下面标签的问题。

-

-- [contribution welcome](https://github.com/didi/KnowStreaming/labels/contribution%20welcome) : 非常需要解决/新增 的Issues

-- [good first issue](https://github.com/didi/KnowStreaming/labels/good%20first%20issue): 对新人比较友好, 新人可以拿这个Issue来练练手热热身。

-

- 请注意,任何 PR 都必须与有效issue相关联。否则,PR 将被拒绝。

-

-

-

-### 开始你的贡献

-

-**分支介绍**

-

-我们将 `dev`分支作为开发分支, 说明这是一个不稳定的分支。

-

-此外,我们的分支模型符合 [https://nvie.com/posts/a-successful-git-branching-model/](https://nvie.com/posts/a-successful-git-branching-model/). 我们强烈建议新人在创建PR之前先阅读上述文章。

-

-

-

-**贡献流程**

-

-为方便描述,我们这里定义一下2个名词:

-

-自己Fork出来的仓库是私人仓库, 我们这里称之为 :**分叉仓库**

-Fork的源项目,我们称之为:**源仓库**

-

-

-现在,如果您准备好创建PR, 以下是贡献者的工作流程:

-

-1. Fork [KnowStreaming](https://github.com/didi/KnowStreaming) 项目到自己的仓库

-

-2. 从源仓库的`dev`拉取并创建自己的本地分支,例如: `dev`

-3. 在本地分支上对代码进行修改

-4. Rebase 开发分支, 并解决冲突

-5. commit 并 push 您的更改到您自己的**分叉仓库**

-6. 创建一个 Pull Request 到**源仓库**的`dev`分支中。

-7. 等待回复。如果回复的慢,请无情的催促。

-

-

-更为详细的贡献流程请看:[贡献流程](./docs/contributer_guide/贡献流程.md)

-

-创建Pull Request时:

-

-1. 请遵循 PR的 [模板](./.github/PULL_REQUEST_TEMPLATE.md)

-2. 请确保 PR 有相应的issue。

-3. 如果您的 PR 包含较大的更改,例如组件重构或新组件,请编写有关其设计和使用的详细文档(在对应的issue中)。

-4. 注意单个 PR 不能太大。如果需要进行大量更改,最好将更改分成几个单独的 PR。

-5. 在合并PR之前,尽量的将最终的提交信息清晰简洁, 将多次修改的提交尽可能的合并为一次提交。

-6. 创建 PR 后,将为PR分配一个或多个reviewers。

-

-

-如果您的 PR 包含较大的更改,例如组件重构或新组件,请编写有关其设计和使用的详细文档。

-

-

-# 代码审查指南

-

-Commiter将轮流review代码,以确保在合并前至少有一名Commiter

-

-一些原则:

-

-- 可读性——重要的代码应该有详细的文档。API 应该有 Javadoc。代码风格应与现有风格保持一致。

-- 优雅:新的函数、类或组件应该设计得很好。

-- 可测试性——单元测试用例应该覆盖 80% 的新代码。

-- 可维护性 - 遵守我们的编码规范。

-

-

-# 开发者

-

-## 成为Contributor

-

-只要成功提交并合并PR , 则为Contributor

-

-贡献者名单请看:[贡献者名单](./docs/contributer_guide/开发者名单.md)

-

-## 尝试成为Commiter

-

-一般来说, 贡献8个重要的补丁并至少让三个不同的人来Review他们(您需要3个Commiter的支持)。

-然后请人给你提名, 您需要展示您的

-

-1. 至少8个重要的PR和项目的相关问题

-2. 与团队合作的能力

-3. 了解项目的代码库和编码风格

-4. 编写好代码的能力

-

-当前的Commiter可以通过在KnowStreaming中的Issue标签 `nomination`(提名)来提名您

-

-1. 你的名字和姓氏

-2. 指向您的Git个人资料的链接

-3. 解释为什么你应该成为Commiter

-4. 详细说明提名人与您合作的3个PR以及相关问题,这些问题可以证明您的能力。

-

-另外2个Commiter需要支持您的**提名**,如果5个工作日内没有人反对,您就是提交者,如果有人反对或者想要更多的信息,Commiter会讨论并通常达成共识(5个工作日内) 。

-

-

-# 开源奖励计划

-

-

-我们非常欢迎开发者们为KnowStreaming开源项目贡献一份力量,相应也将给予贡献者激励以表认可与感谢。

-

-

-## 参与贡献

-

-1. 积极参与 Issue 的讨论,如答疑解惑、提供想法或报告无法解决的错误(Issue)

-2. 撰写和改进项目的文档(Wiki)

-3. 提交补丁优化代码(Coding)

-

-

-## 你将获得

-

-1. 加入KnowStreaming开源项目贡献者名单并展示

-2. KnowStreaming开源贡献者证书(纸质&电子版)

-3. KnowStreaming贡献者精美大礼包(KnowStreamin/滴滴 周边)

-

-

-## 相关规则

-

-- Contributer和Commiter都会有对应的证书和对应的礼包

-- 每季度有KnowStreaming项目团队评选出杰出贡献者,颁发相应证书。

-- 年末进行年度评选

-

-贡献者名单请看:[贡献者名单](./docs/contributer_guide/开发者名单.md)

\ No newline at end of file

diff --git a/README.md b/README.md

deleted file mode 100644

index 8f526268..00000000

--- a/README.md

+++ /dev/null

@@ -1,157 +0,0 @@

-

-

- -

-

-

-

-

-

- 产品官网 |

- 下载地址 |

- 文档资源 |

- 体验环境

-

-

-

-

-

-  -

-

-

-

-

-

-

-

-

-  -

-

-

-

-

-

-

-

-

-  -

-

-

-

-

-

-

-

-

-  -

-

-

-

-

-

-

-

-

-  -

-

-

-

-

-

-

-

----

-

-

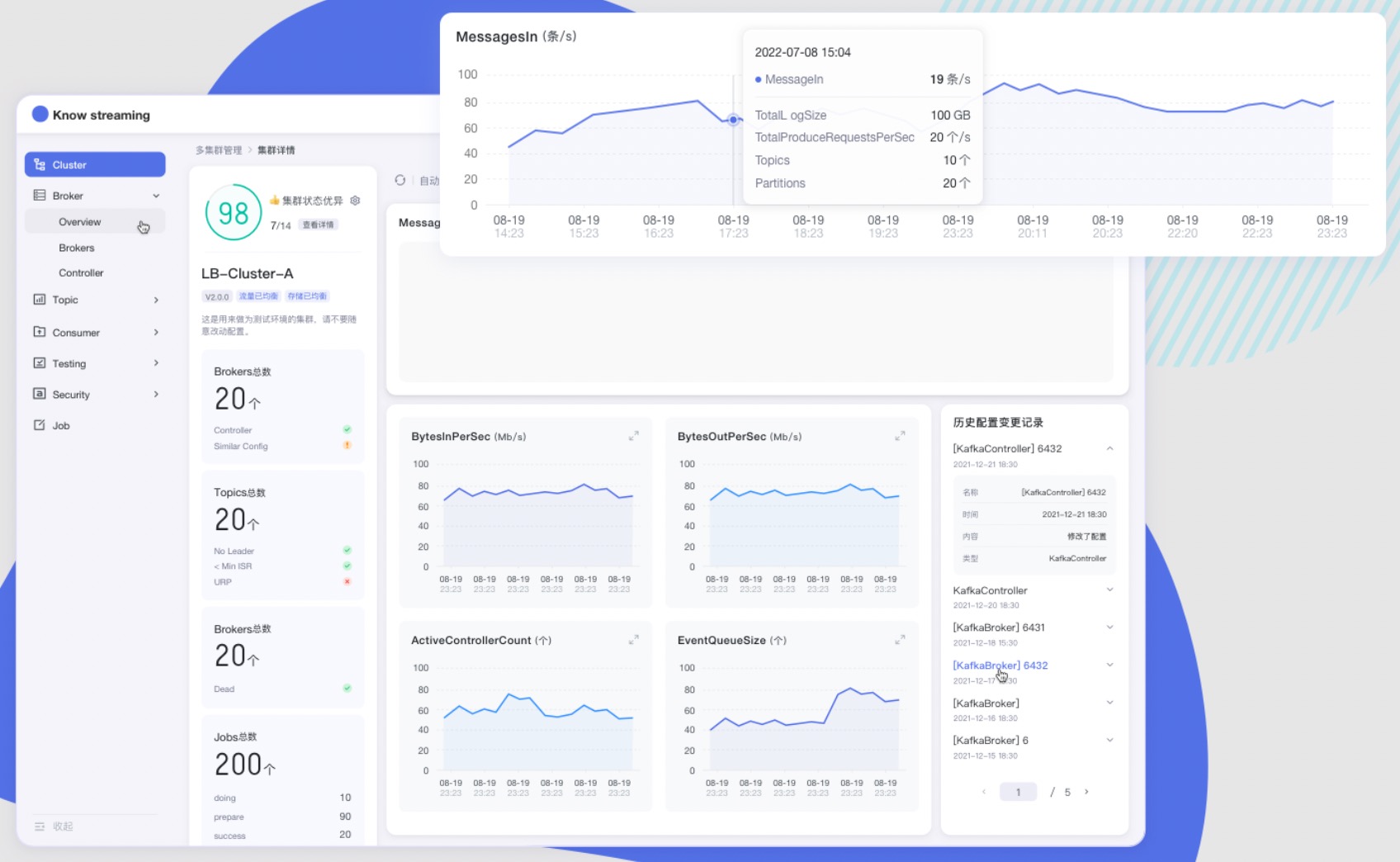

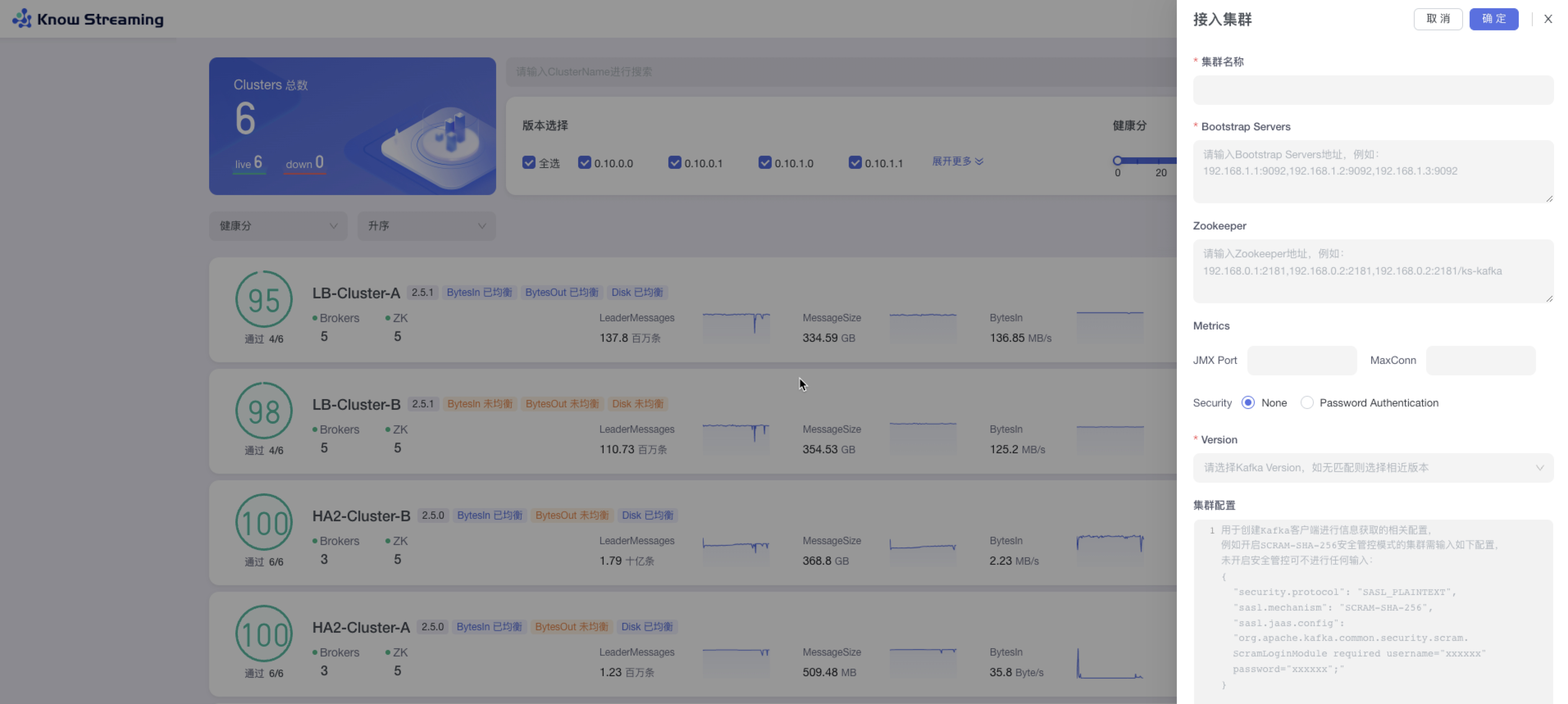

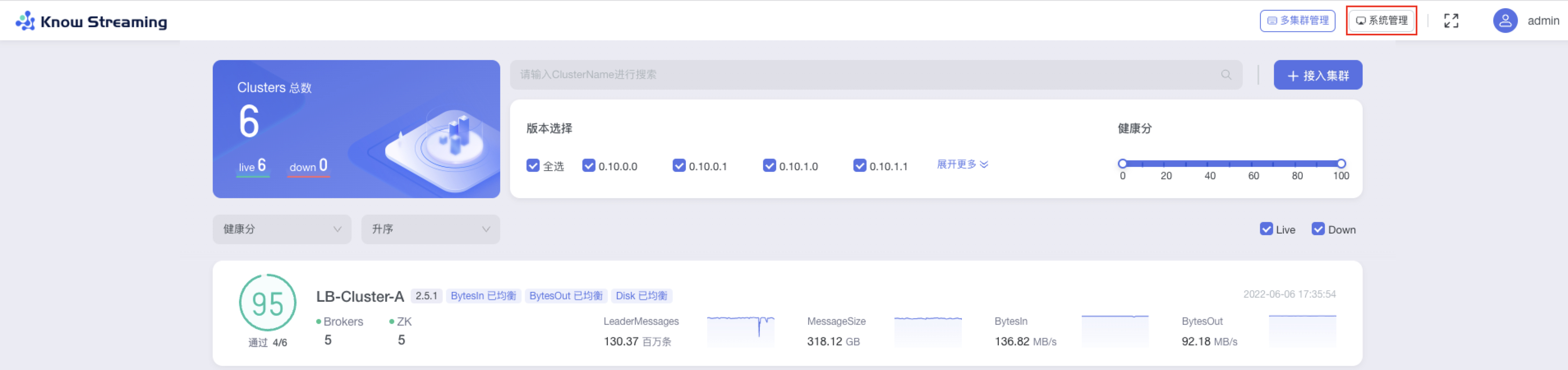

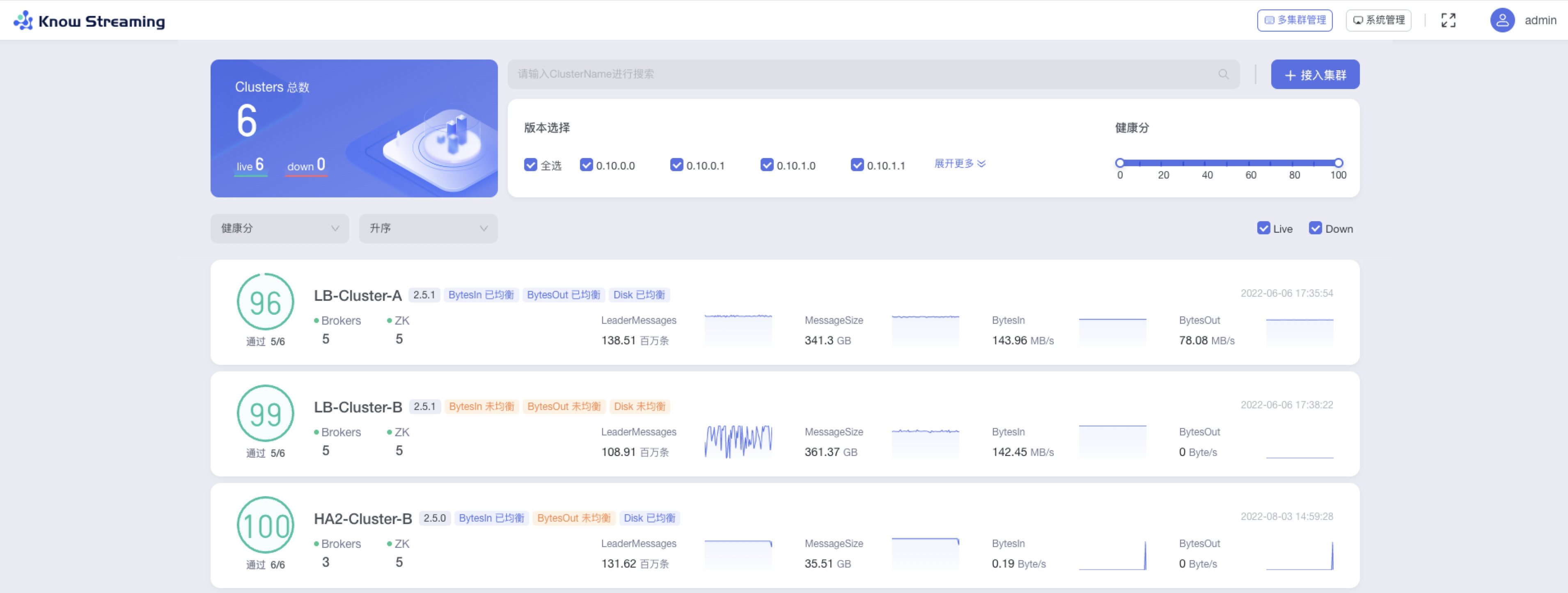

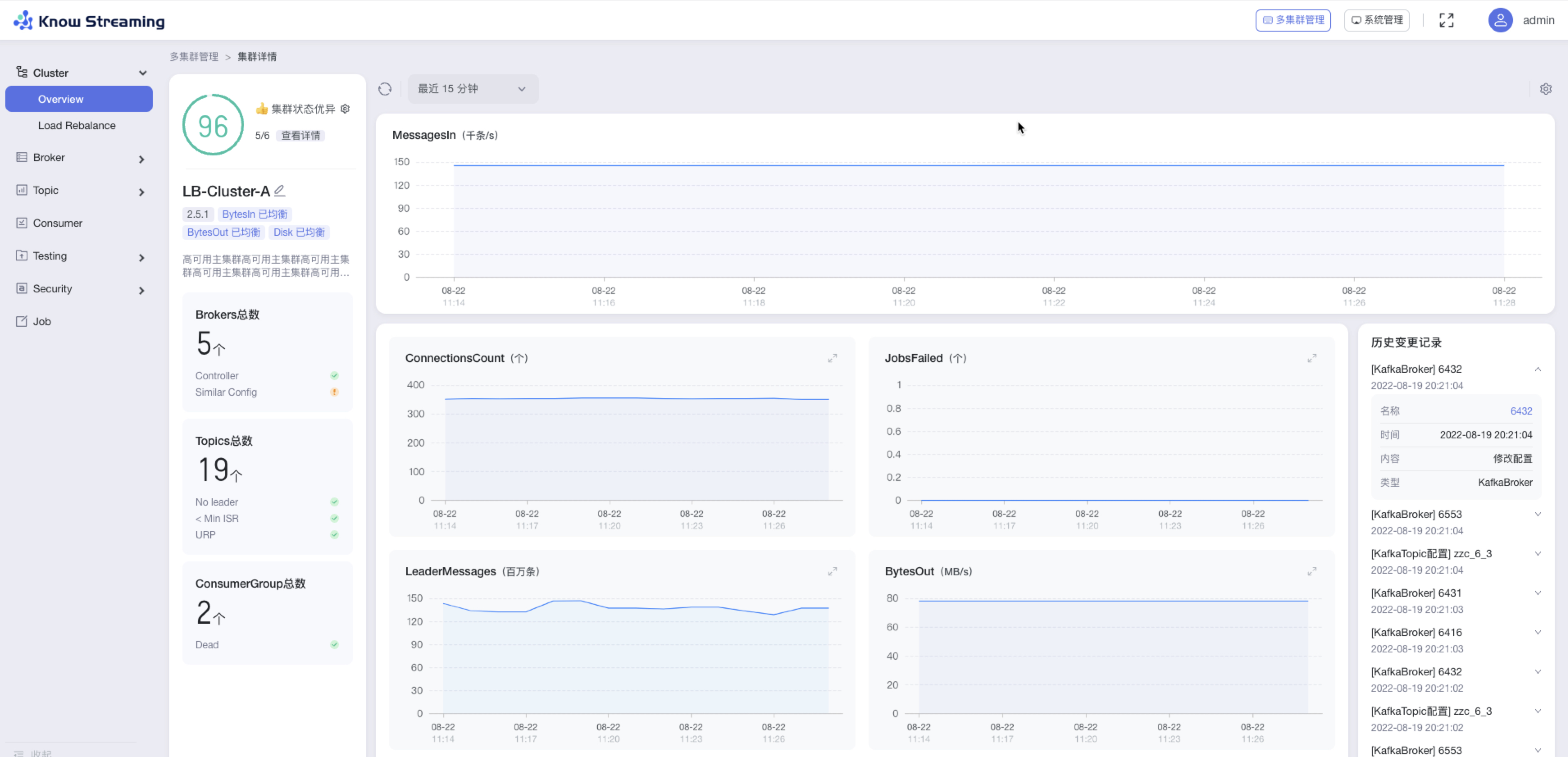

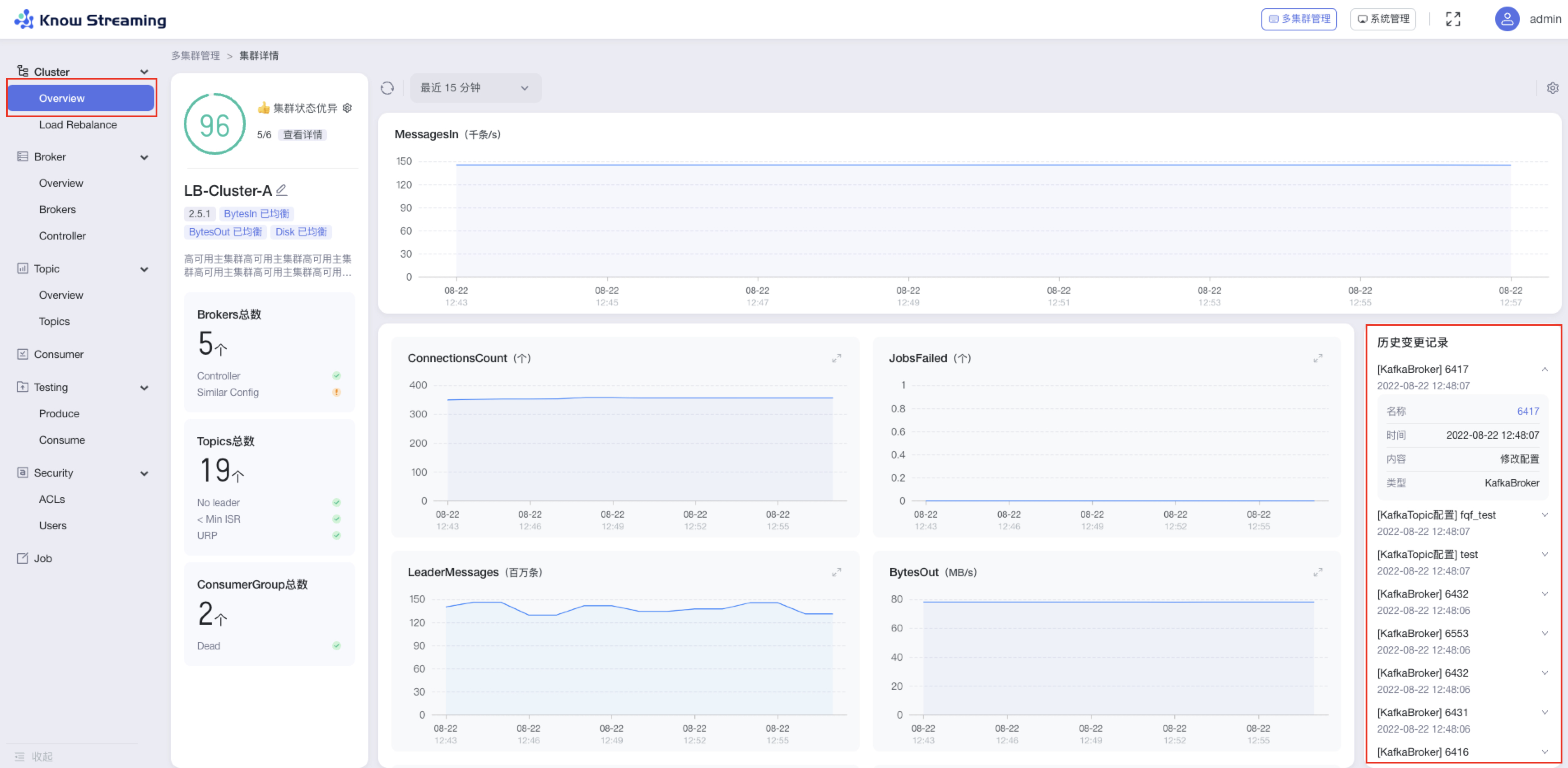

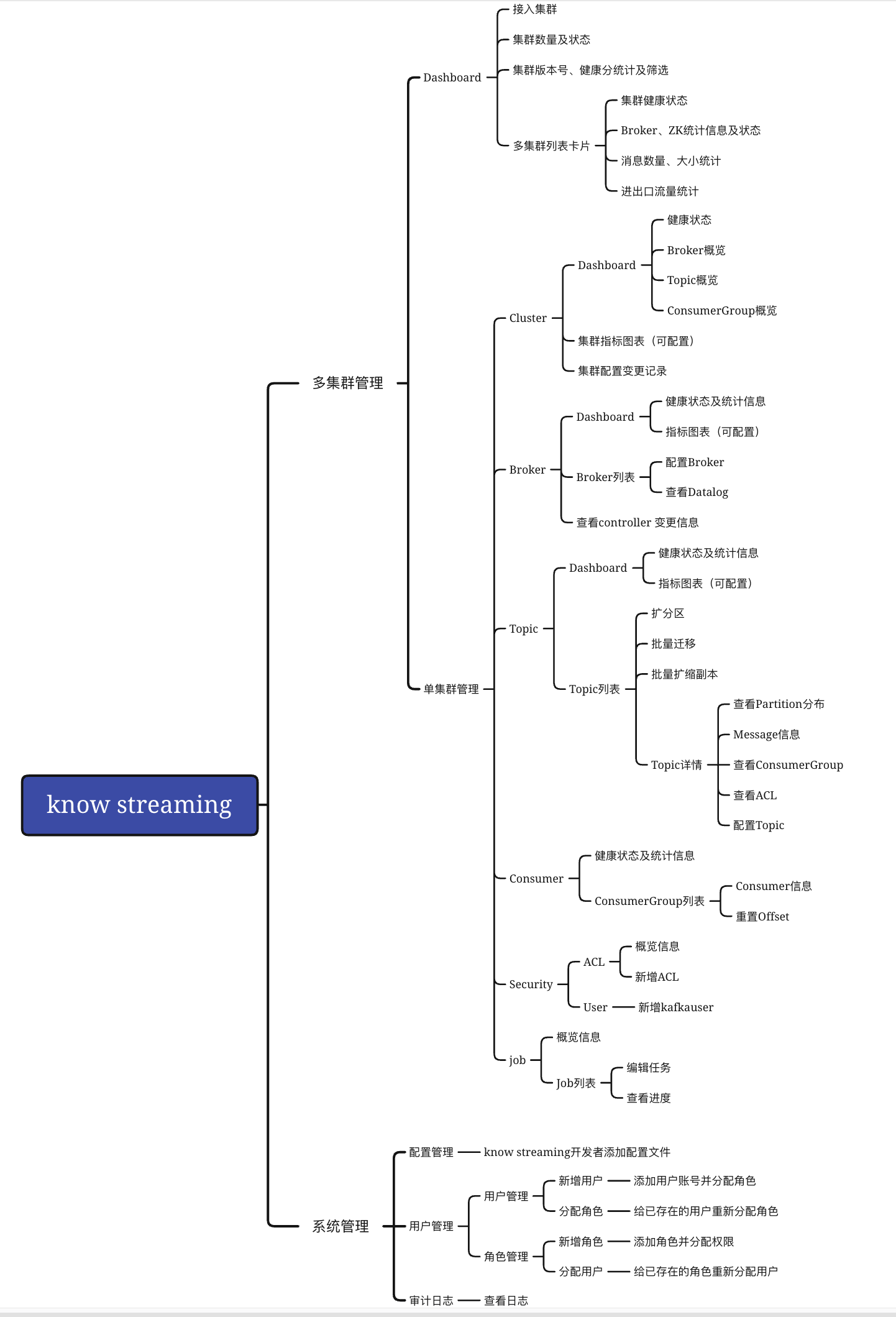

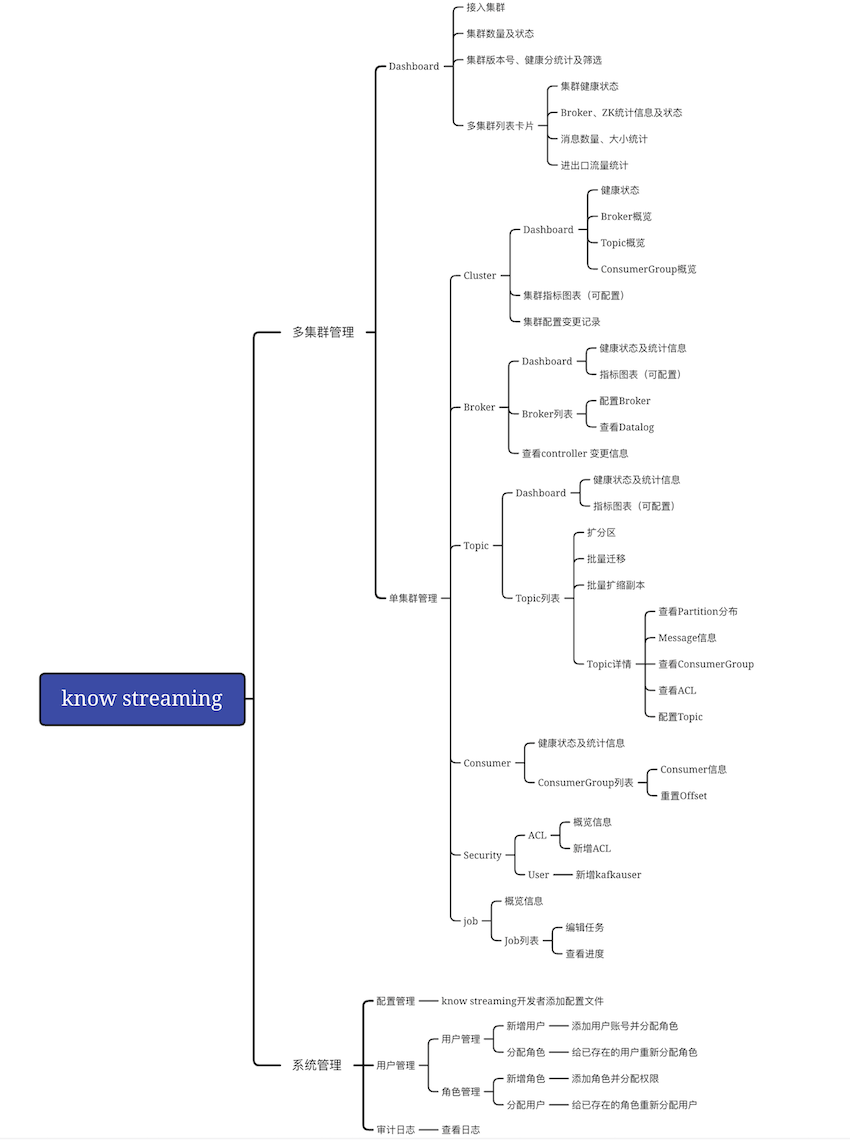

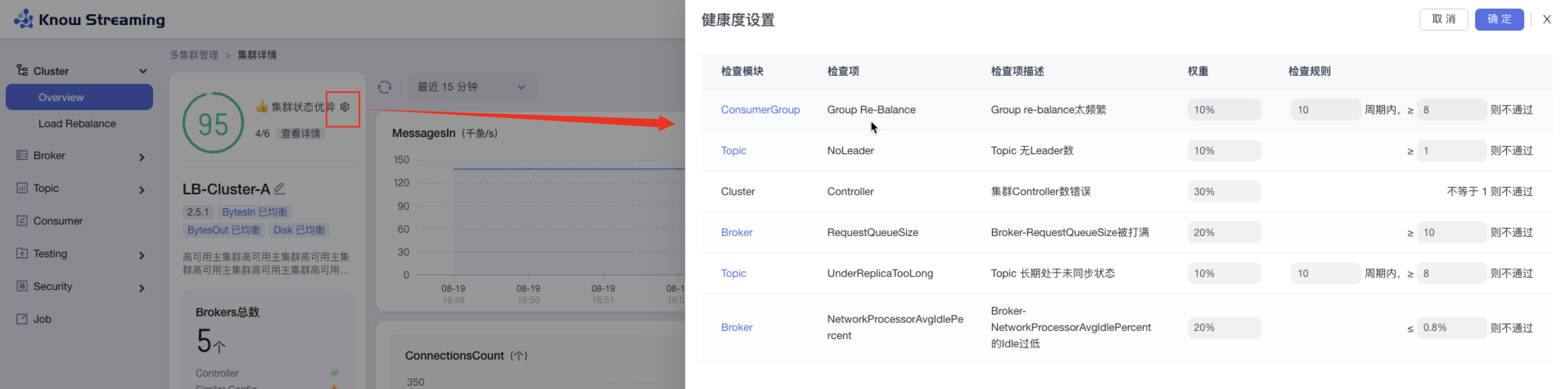

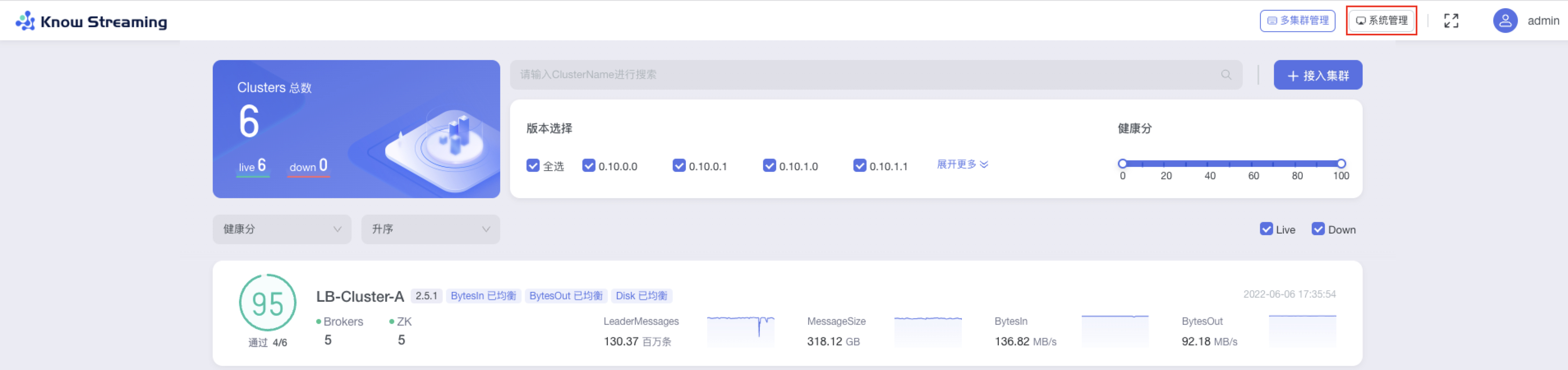

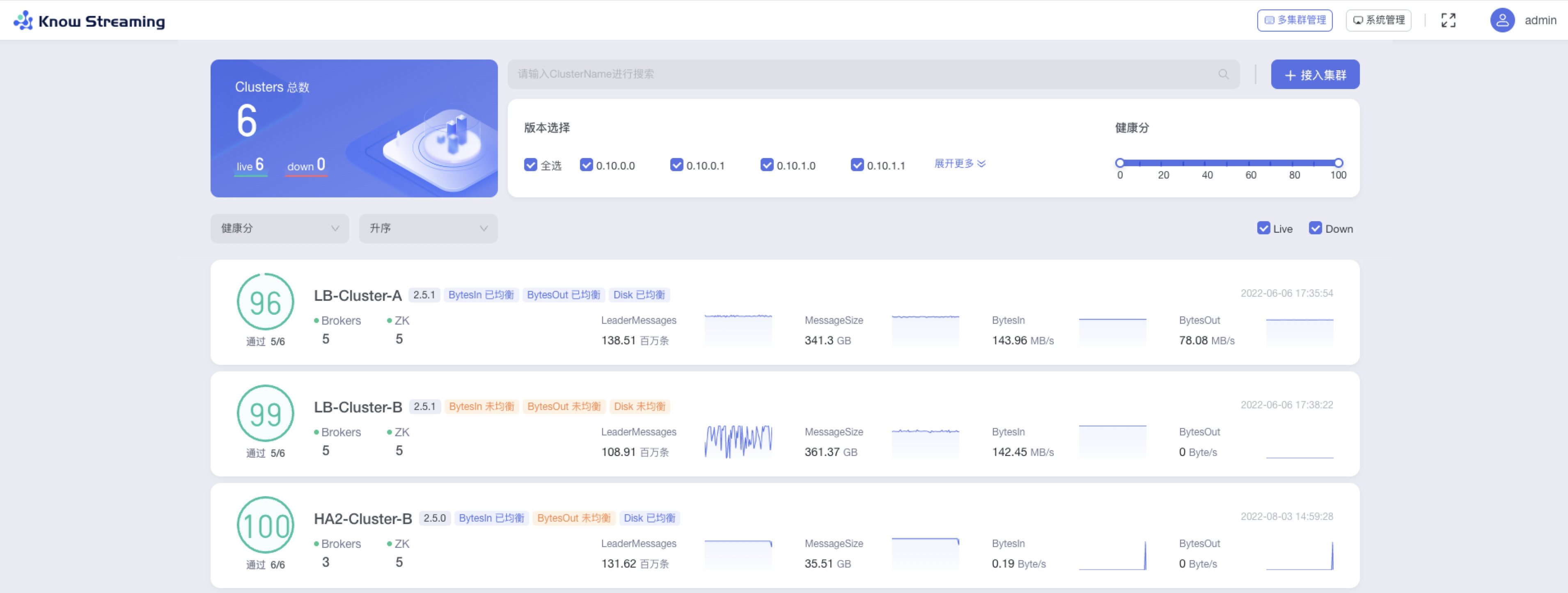

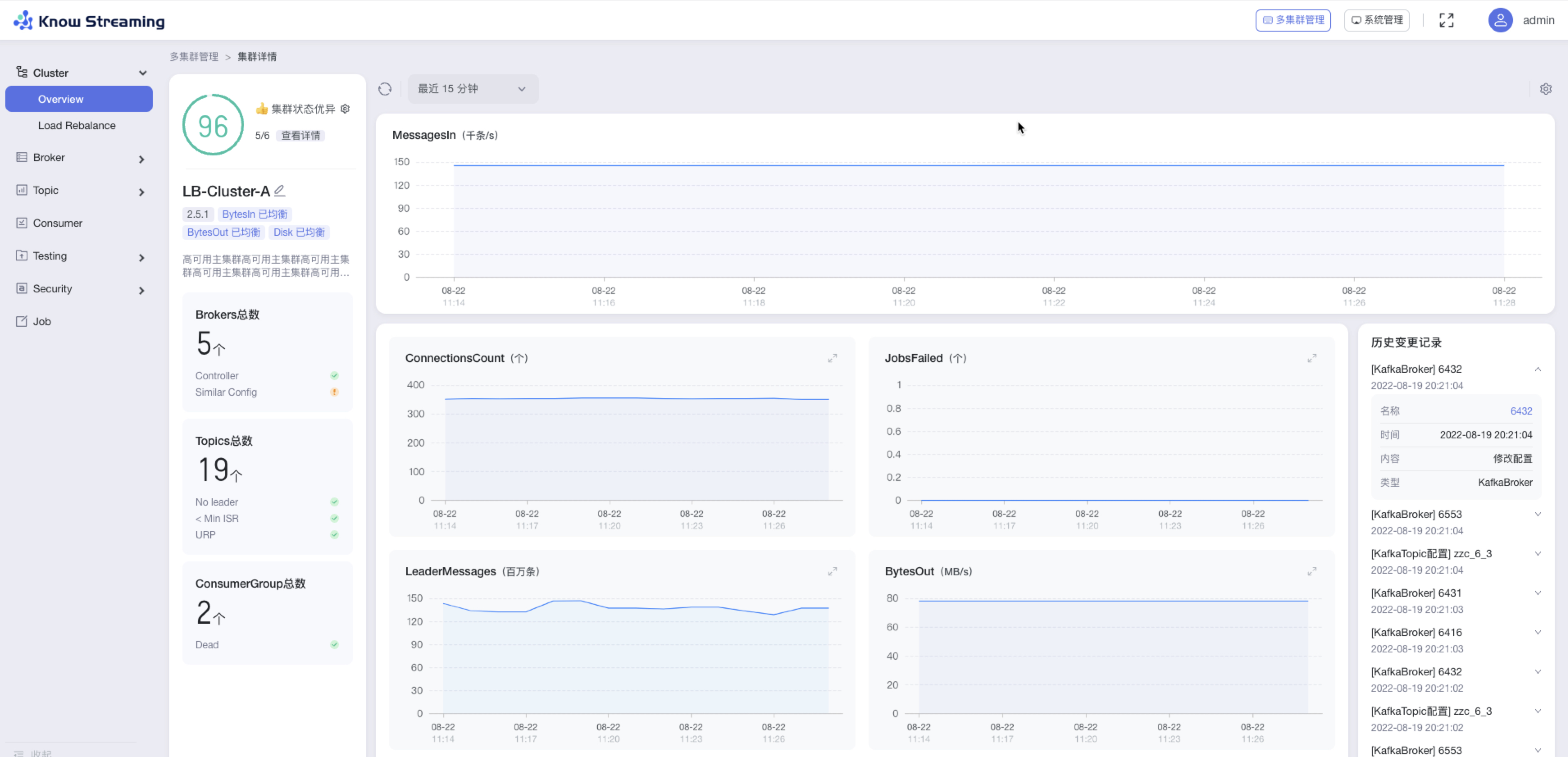

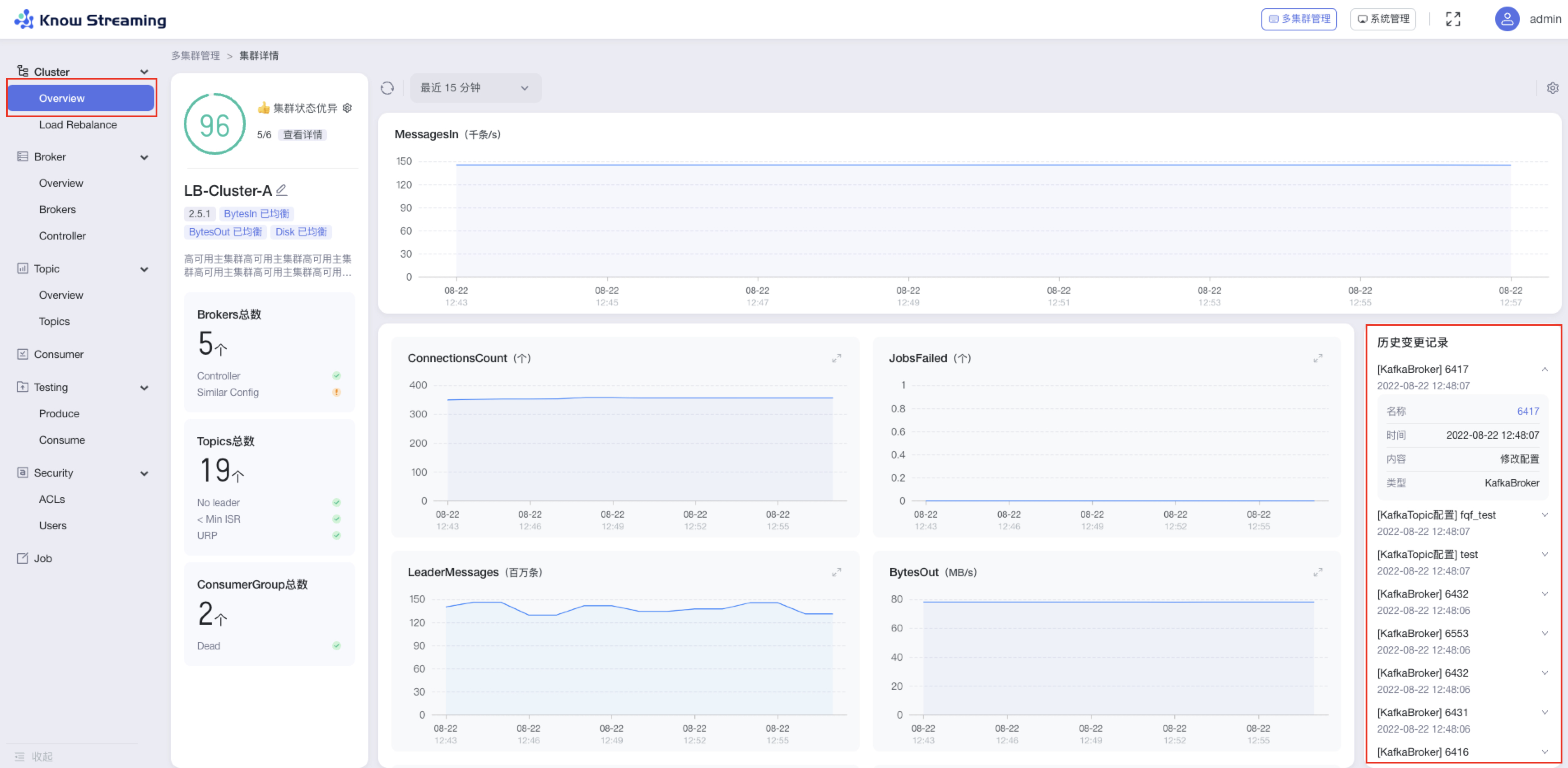

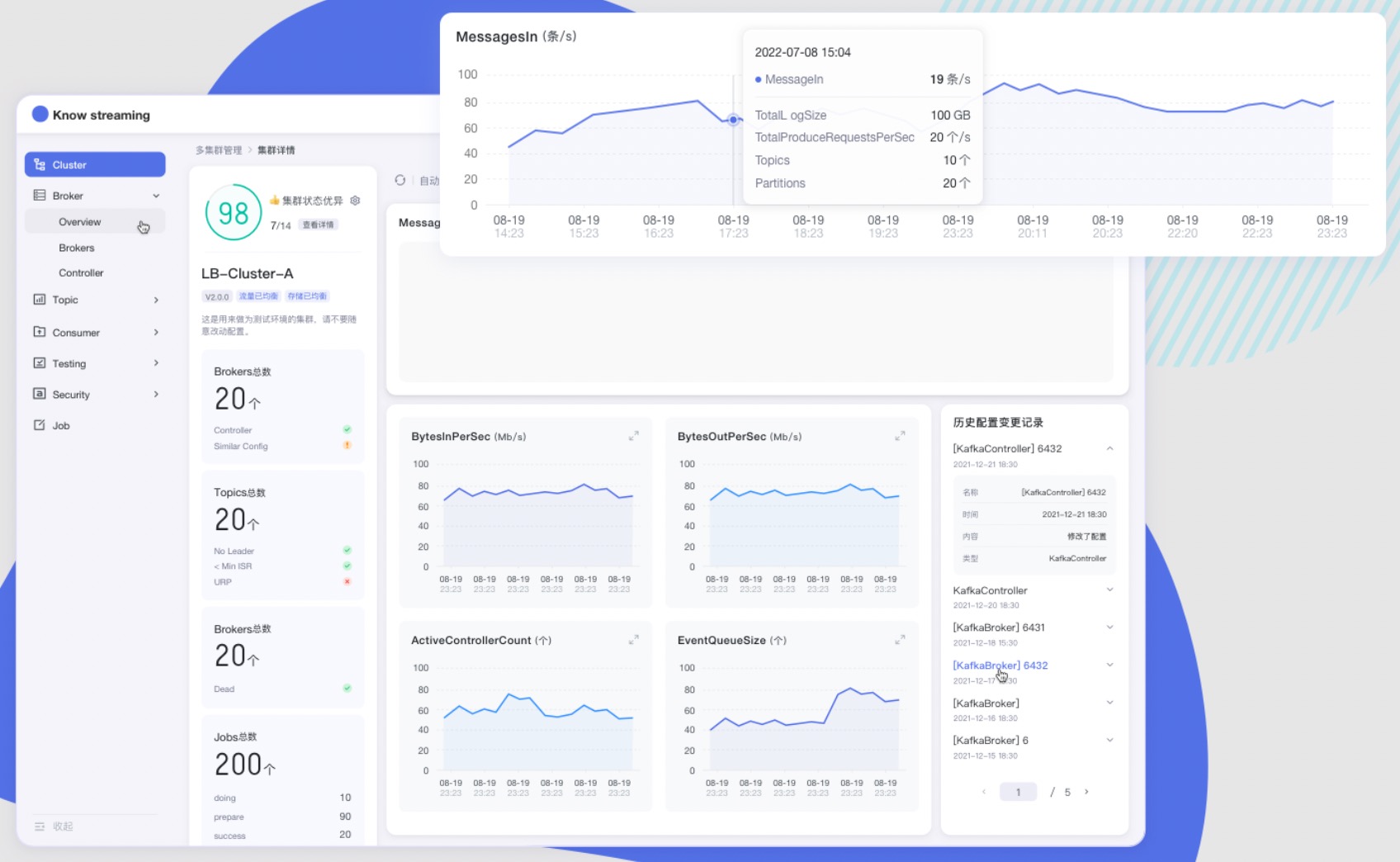

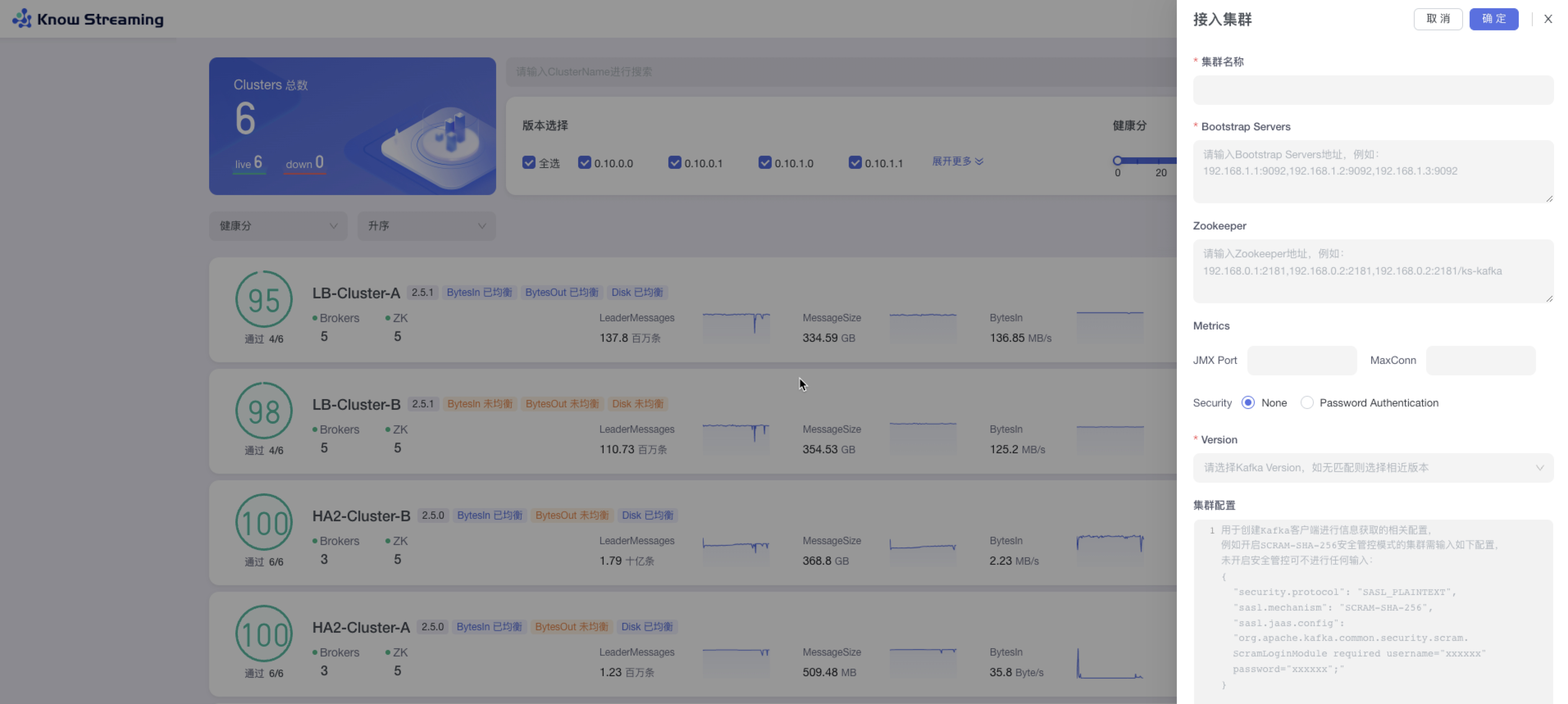

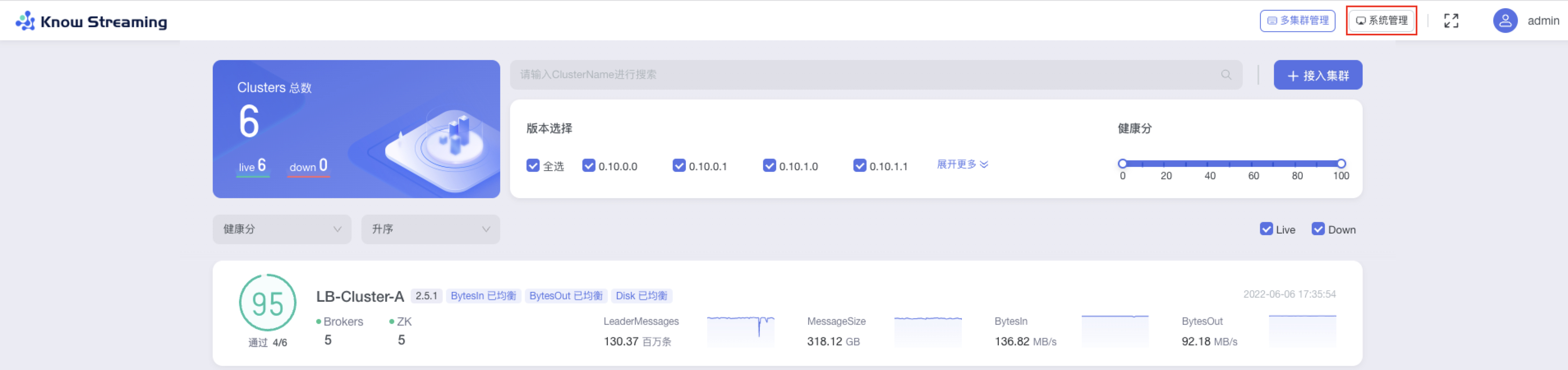

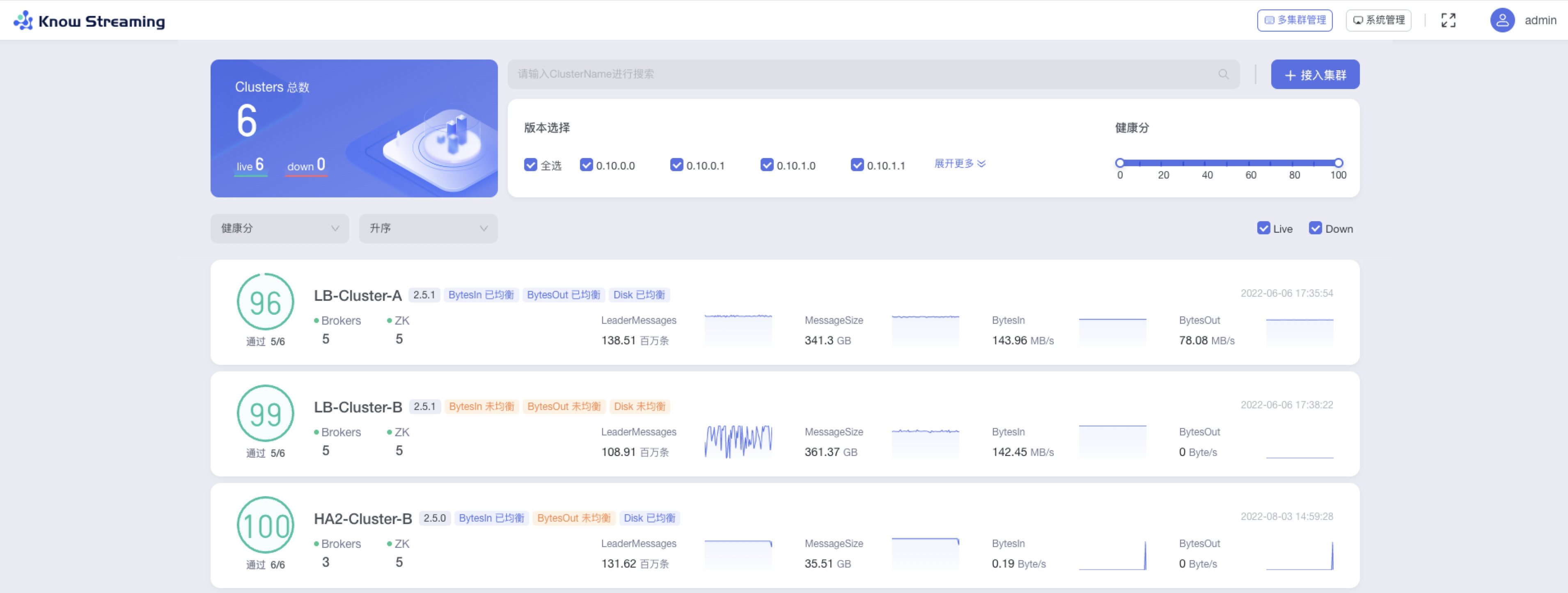

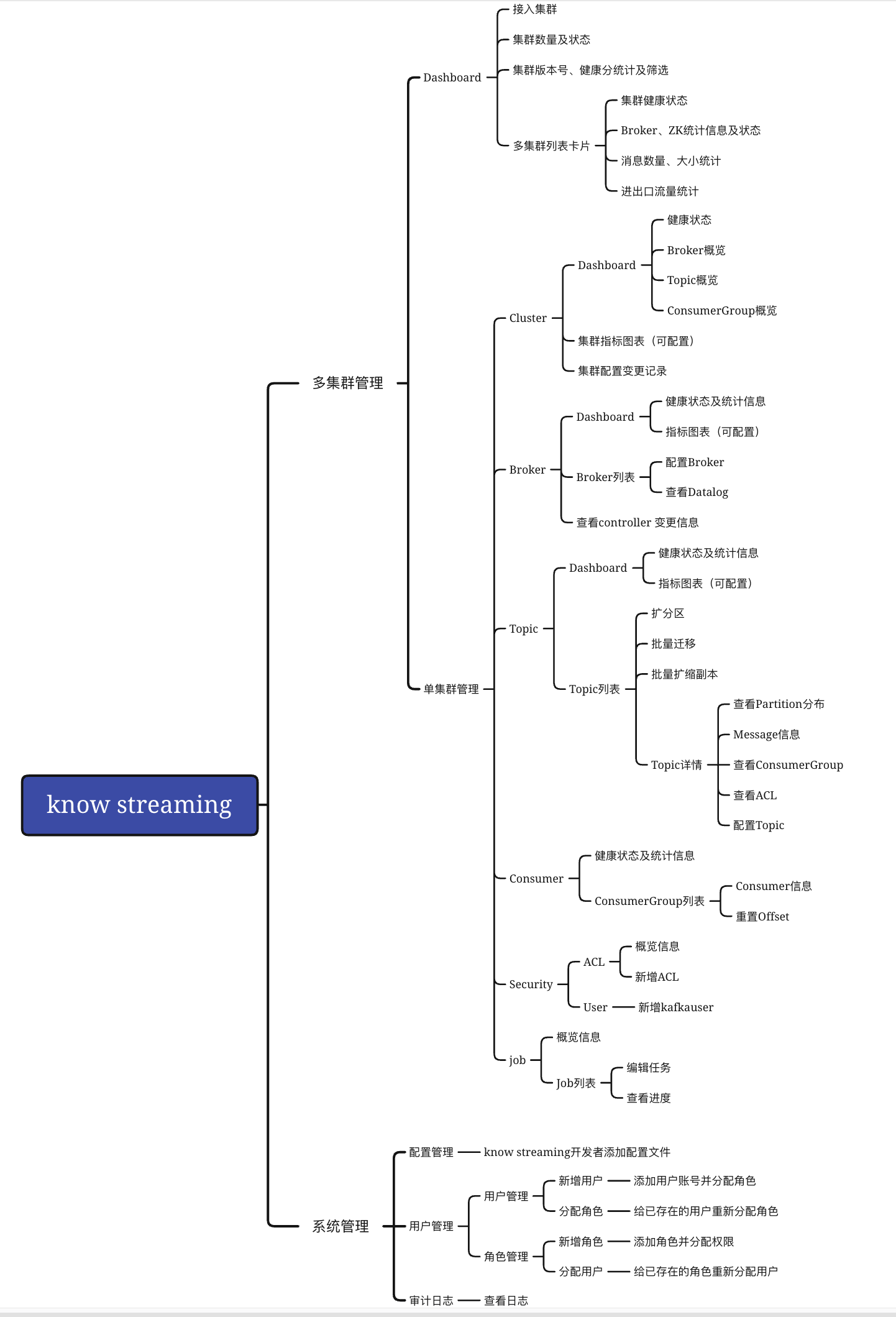

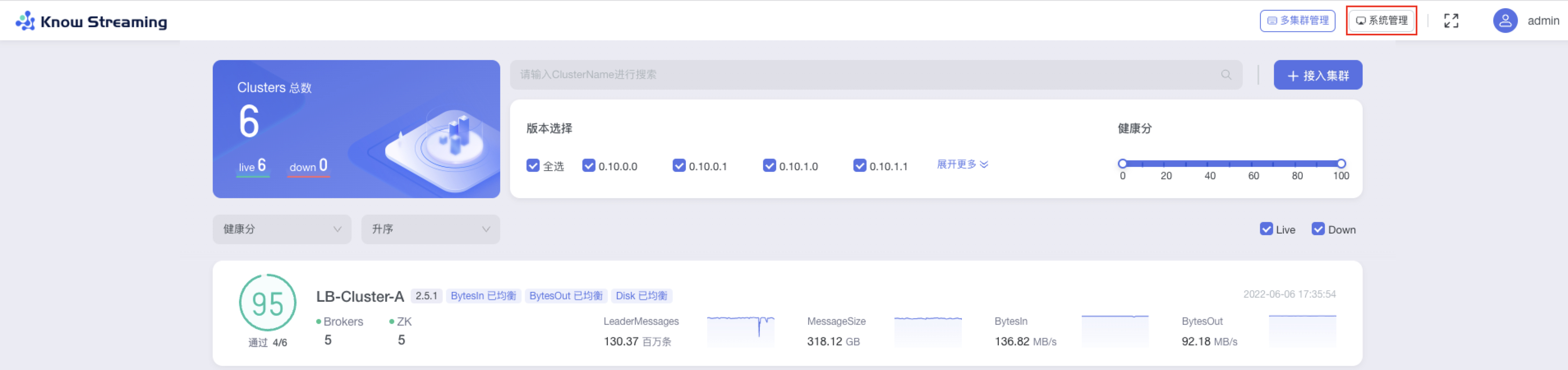

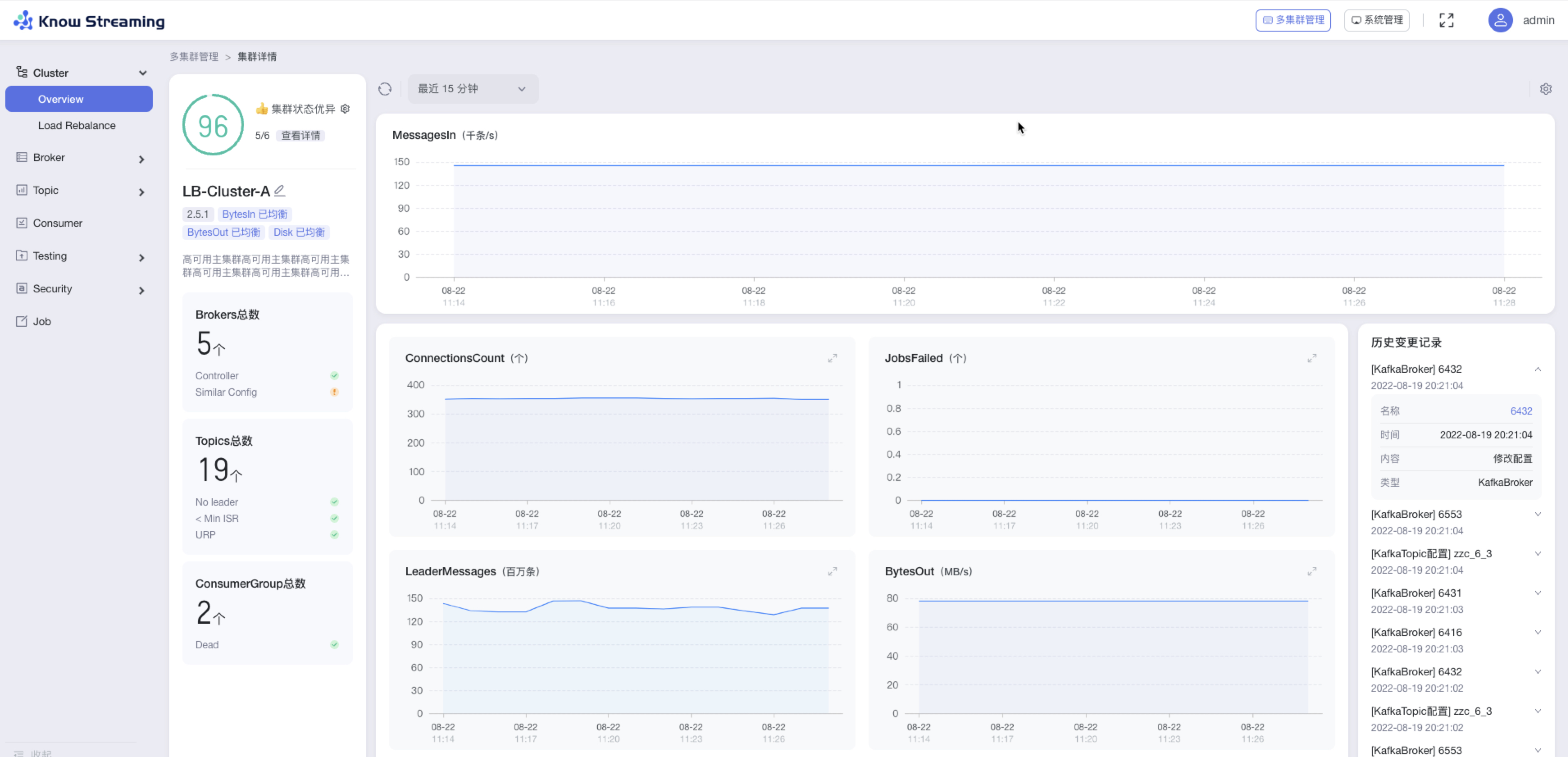

-## `Know Streaming` 简介

-

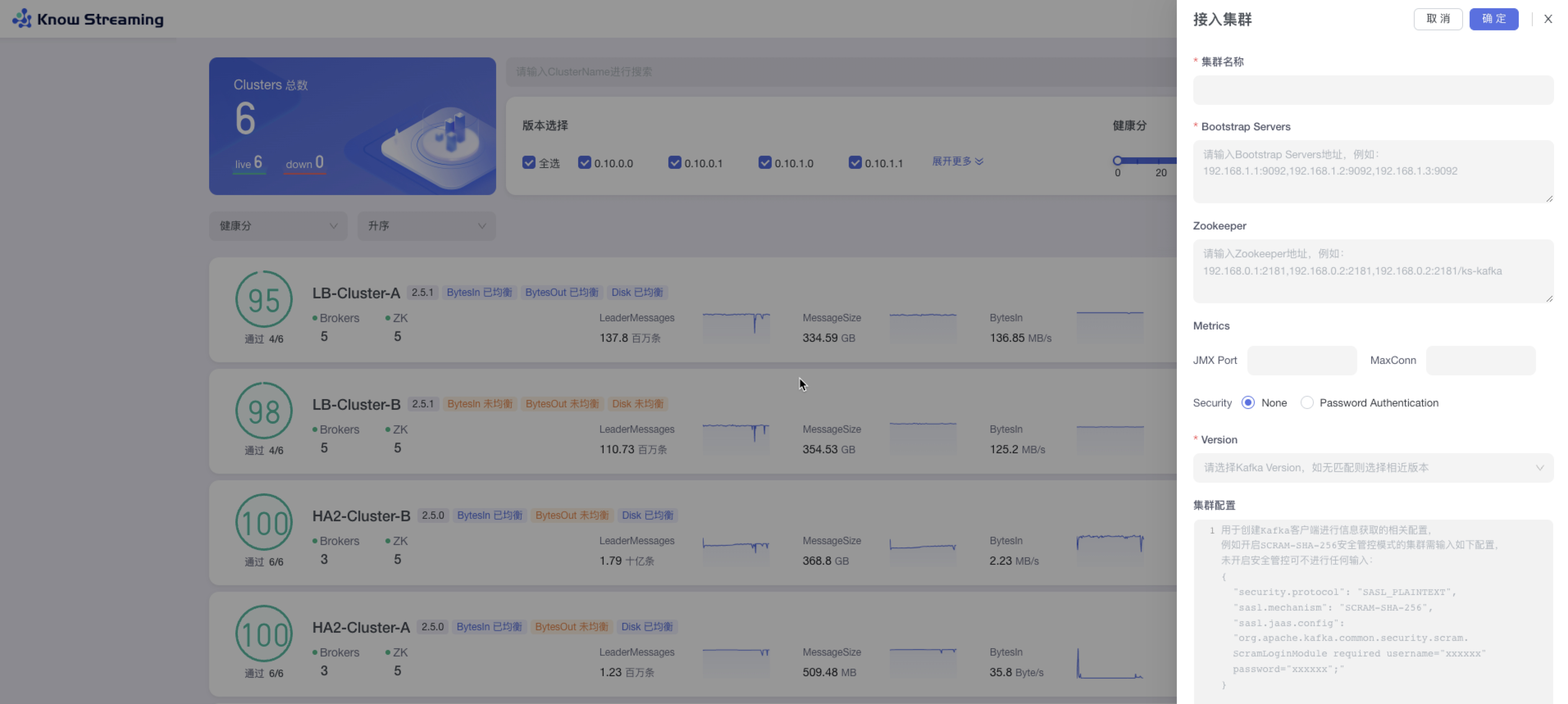

-`Know Streaming`是一套云原生的Kafka管控平台,脱胎于众多互联网内部多年的Kafka运营实践经验,专注于Kafka运维管控、监控告警、资源治理、多活容灾等核心场景。在用户体验、监控、运维管控上进行了平台化、可视化、智能化的建设,提供一系列特色的功能,极大地方便了用户和运维人员的日常使用,让普通运维人员都能成为Kafka专家。

-

-我们现在正在收集 Know Streaming 用户信息,以帮助我们进一步改进 Know Streaming。

-请在 [issue#663](https://github.com/didi/KnowStreaming/issues/663) 上提供您的使用信息来支持我们:[谁在使用 Know Streaming](https://github.com/didi/KnowStreaming/issues/663)

-

-

-

-整体具有以下特点:

-

-- 👀 **零侵入、全覆盖**

- - 无需侵入改造 `Apache Kafka` ,一键便能纳管 `0.10.x` ~ `3.x.x` 众多版本的Kafka,包括 `ZK` 或 `Raft` 运行模式的版本,同时在兼容架构上具备良好的扩展性,帮助您提升集群管理水平;

-

-- 🌪️ **零成本、界面化**

- - 提炼高频 CLI 能力,设计合理的产品路径,提供清新美观的 GUI 界面,支持 Cluster、Broker、Zookeeper、Topic、ConsumerGroup、Message、ACL、Connect 等组件 GUI 管理,普通用户5分钟即可上手;

-

-- 👏 **云原生、插件化**

- - 基于云原生构建,具备水平扩展能力,只需要增加节点即可获取更强的采集及对外服务能力,提供众多可热插拔的企业级特性,覆盖可观测性生态整合、资源治理、多活容灾等核心场景;

-

-- 🚀 **专业能力**

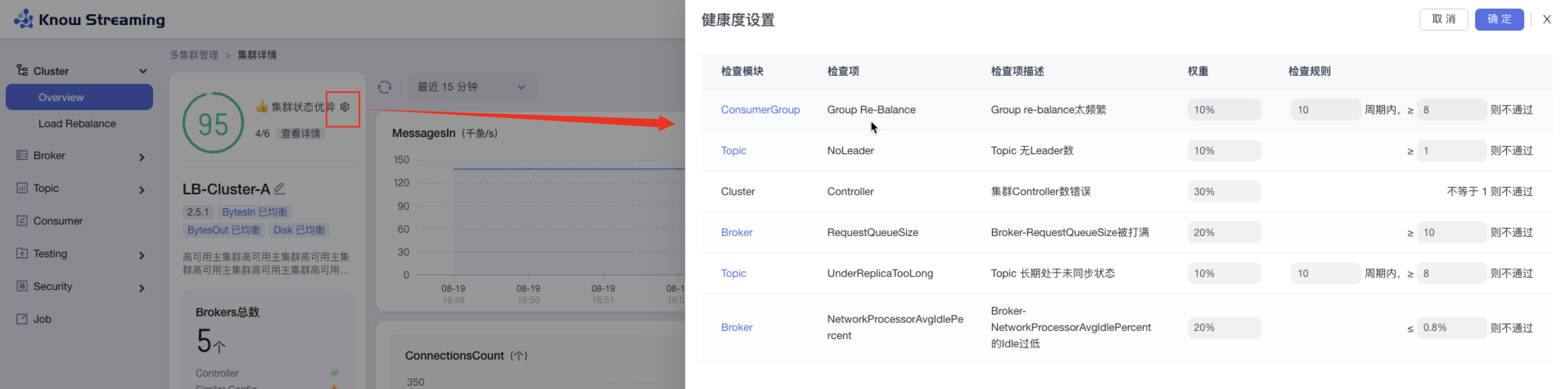

- - 集群管理:支持一键纳管,健康分析、核心组件观测 等功能;

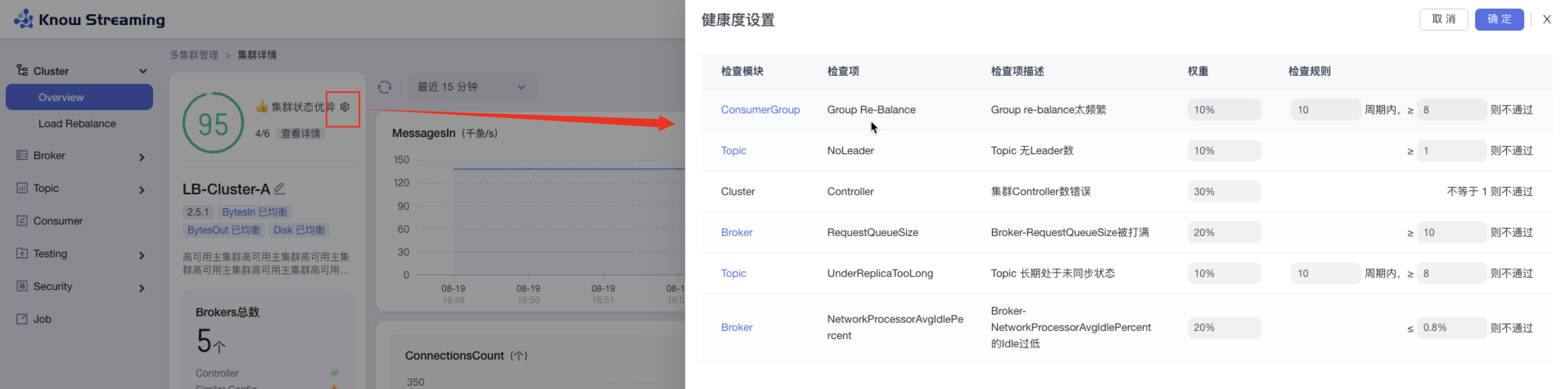

- - 观测提升:多维度指标观测大盘、观测指标最佳实践 等功能;

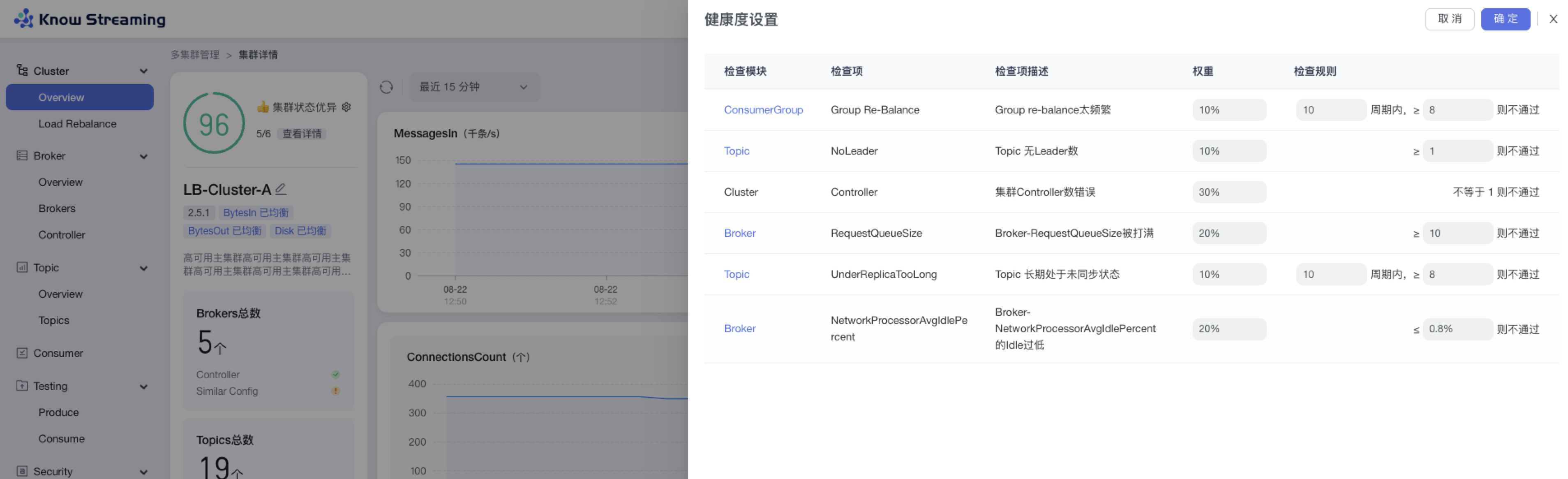

- - 异常巡检:集群多维度健康巡检、集群多维度健康分 等功能;

- - 能力增强:集群负载均衡、Topic扩缩副本、Topic副本迁移 等功能;

-

-

-

-**产品图**

-

-

-

- -

-

-

-

-

-

-

-

-## 文档资源

-

-**`开发相关手册`**

-

-- [打包编译手册](docs/install_guide/源码编译打包手册.md)

-- [单机部署手册](docs/install_guide/单机部署手册.md)

-- [版本升级手册](docs/install_guide/版本升级手册.md)

-- [本地源码启动手册](docs/dev_guide/本地源码启动手册.md)

-

-**`产品相关手册`**

-

-- [产品使用指南](docs/user_guide/用户使用手册.md)

-- [2.x与3.x新旧对比手册](docs/user_guide/新旧对比手册.md)

-- [FAQ](docs/user_guide/faq.md)

-

-

-**点击 [这里](https://doc.knowstreaming.com/product),也可以从官网获取到更多文档**

-

-

-

-

-

-## 成为社区贡献者

-

-1. [贡献源码](https://doc.knowstreaming.com/product/10-contribution) 了解如何成为 Know Streaming 的贡献者

-2. [具体贡献流程](https://doc.knowstreaming.com/product/10-contribution#102-贡献流程)

-3. [开源激励计划](https://doc.knowstreaming.com/product/10-contribution#105-开源激励计划)

-4. [贡献者名单](https://doc.knowstreaming.com/product/10-contribution#106-贡献者名单)

-

-

-获取KnowStreaming开源社区证书。

-

-## 加入技术交流群

-

-**`1、知识星球`**

-

-

- -

-

-

-

-

-

-

-

-

-

-

-

-👍 我们正在组建国内最大,最权威的 **[Kafka中文社区](https://z.didi.cn/5gSF9)**

-

-在这里你可以结交各大互联网的 Kafka大佬 以及 4000+ Kafka爱好者,一起实现知识共享,实时掌控最新行业资讯,期待 👏 您的加入中~ https://z.didi.cn/5gSF9

-

-有问必答~! 互动有礼~!

-

-PS: 提问请尽量把问题一次性描述清楚,并告知环境信息情况~!如使用版本、操作步骤、报错/警告信息等,方便大V们快速解答~

-

-

-

-**`2、微信群`**

-

-微信加群:添加`mike_zhangliang`、`PenceXie` 、`szzdzhp001`的微信号备注KnowStreaming加群。

-

-

-加群之前有劳点一下 star,一个小小的 star 是对KnowStreaming作者们努力建设社区的动力。

-

-感谢感谢!!!

-

- -

-## Star History

-

-[](https://star-history.com/#didi/KnowStreaming&Date)

diff --git a/Releases_Notes.md b/Releases_Notes.md

deleted file mode 100644

index a606ef72..00000000

--- a/Releases_Notes.md

+++ /dev/null

@@ -1,572 +0,0 @@

-

-## v3.3.0

-

-**问题修复**

-- 修复 Connect 的 JMX-Port 配置未生效问题;

-- 修复 不存在 Connector 时,OverView 页面的数据一直处于加载中的问题;

-- 修复 Group 分区信息,分页时展示不全的问题;

-- 修复采集副本指标时,参数传递错误的问题;

-- 修复用户信息修改后,用户列表会抛出空指针异常的问题;

-- 修复 Topic 详情页面,查看消息时,选择分区不生效问题;

-- 修复对 ZK 客户端进行配置后不生效的问题;

-- 修复 connect 模块,指标中缺少健康巡检项通过数的问题;

-- 修复 connect 模块,指标获取方法存在映射错误的问题;

-- 修复 connect 模块,max 纬度指标获取错误的问题;

-- 修复 Topic 指标大盘 TopN 指标显示信息错误的问题;

-- 修复 Broker Similar Config 显示错误的问题;

-- 修复解析 ZK 四字命令时,数据类型设置错误导致空指针的问题;

-- 修复新增 Topic 时,清理策略选项版本控制错误的问题;

-- 修复新接入集群时 Controller-Host 信息不显示的问题;

-- 修复 Connector 和 MM2 列表搜索不生效的问题;

-- 修复 Zookeeper 页面,Leader 显示存在异常的问题;

-- 修复前端打包失败的问题;

-

-

-**产品优化**

-- ZK Overview 页面补充默认展示的指标;

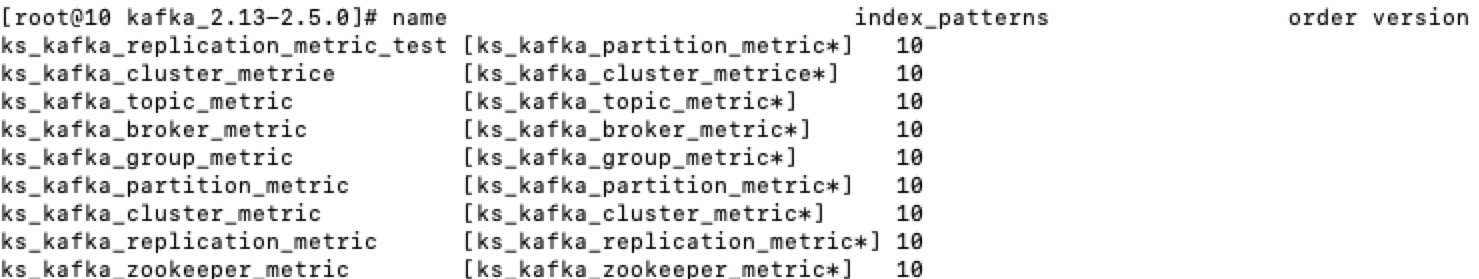

-- 统一初始化 ES 索引模版的脚本为 init_es_template.sh,同时新增缺失的 connect 索引模版初始化脚本,去除多余的 replica 和 zookeper 索引模版初始化脚本;

-- 指标大盘页面,优化指标筛选操作后,无指标数据的指标卡片由不显示改为显示,并增加无数据的兜底;

-- 删除从 ES 读写 replica 指标的相关代码;

-- 优化 Topic 健康巡检的日志,明确错误的原因;

-- 优化无 ZK 模块时,巡检详情忽略对 ZK 的展示;

-- 优化本地缓存大小为可配置;

-- Task 模块中的返回中,补充任务的分组信息;

-- FAQ 补充 Ldap 的配置说明;

-- FAQ 补充接入 Kerberos 认证的 Kafka 集群的配置说明;

-- ks_km_kafka_change_record 表增加时间纬度的索引,优化查询性能;

-- 优化 ZK 健康巡检的日志,便于问题的排查;

-

-**功能新增**

-- 新增基于滴滴 Kafka 的 Topic 复制功能(需使用滴滴 Kafka 才可具备该能力);

-- Topic 指标大盘,新增 Topic 复制相关的指标;

-- 新增基于 TestContainers 的单测;

-

-

-**Kafka MM2 Beta版 (v3.3.0版本新增发布)**

-- MM2 任务的增删改查;

-- MM2 任务的指标大盘;

-- MM2 任务的健康状态;

-

----

-

-

-## v3.2.0

-

-**问题修复**

-- 修复健康巡检结果更新至 DB 时,出现死锁问题;

-- 修复 KafkaJMXClient 类中,logger错误的问题;

-- 后端修复 Topic 过期策略在 0.10.1.0 版本能多选的问题,实际应该只能二选一;

-- 修复接入集群时,不填写集群配置会报错的问题;

-- 升级 spring-context 至 5.3.19 版本,修复安全漏洞;

-- 修复 Broker & Topic 修改配置时,多版本兼容配置的版本信息错误的问题;

-- 修复 Topic 列表的健康分为健康状态;

-- 修复 Broker LogSize 指标存储名称错误导致查询不到的问题;

-- 修复 Prometheus 中,缺少 Group 部分指标的问题;

-- 修复因缺少健康状态指标导致集群数错误的问题;

-- 修复后台任务记录操作日志时,因缺少操作用户信息导致出现异常的问题;

-- 修复 Replica 指标查询时,DSL 错误的问题;

-- 关闭 errorLogger,修复错误日志重复输出的问题;

-- 修复系统管理更新用户信息失败的问题;

-- 修复因原AR信息丢失,导致迁移任务一直处于执行中的错误;

-- 修复集群 Topic 列表实时数据查询时,出现失败的问题;

-- 修复集群 Topic 列表,页面白屏问题;

-- 修复副本变更时,因AR数据异常,导致数组访问越界的问题;

-

-

-**产品优化**

-- 优化健康巡检为按照资源维度多线程并发处理;

-- 统一日志输出格式,并优化部分输出的日志;

-- 优化 ZK 四字命令结果解析过程中,容易引起误解的 WARN 日志;

-- 优化 Zookeeper 详情中,目录结构的搜索文案;

-- 优化线程池的名称,方便第三方系统进行相关问题的分析;

-- 去除 ESClient 的并发访问控制,降低 ESClient 创建数及提升利用率;

-- 优化 Topic Messages 抽屉文案;

-- 优化 ZK 健康巡检失败时的错误日志信息;

-- 提高 Offset 信息获取的超时时间,降低并发过高时出现请求超时的概率;

-- 优化 Topic & Partition 元信息的更新策略,降低对 DB 连接的占用;

-- 优化 Sonar 代码扫码问题;

-- 优化分区 Offset 指标的采集;

-- 优化前端图表相关组件逻辑;

-- 优化产品主题色;

-- Consumer 列表刷新按钮新增 hover 提示;

-- 优化配置 Topic 的消息大小时的测试弹框体验;

-- 优化 Overview 页面 TopN 查询的流程;

-

-

-**功能新增**

-- 新增页面无数据排查文档;

-- 增加 ES 索引删除的功能;

-- 支持拆分API服务和Job服务部署;

-

-

-**Kafka Connect Beta版 (v3.2.0版本新增发布)**

-- Connect 集群的纳管;

-- Connector 的增删改查;

-- Connect 集群 & Connector 的指标大盘;

-

-

----

-

-

-## v3.1.0

-

-**Bug修复**

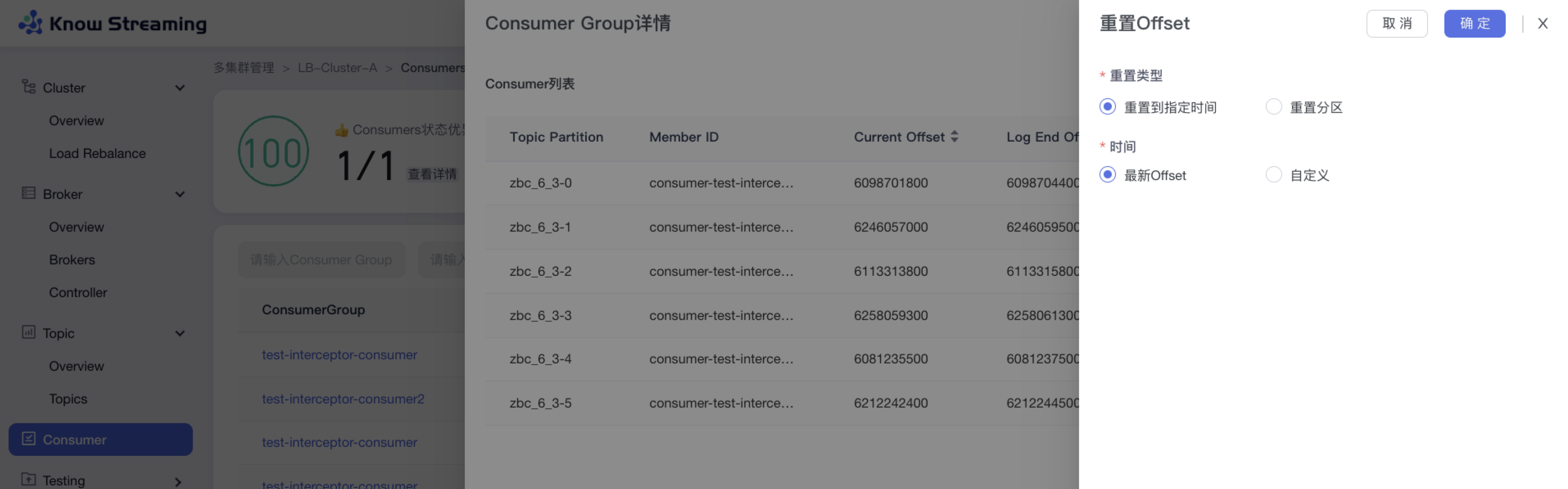

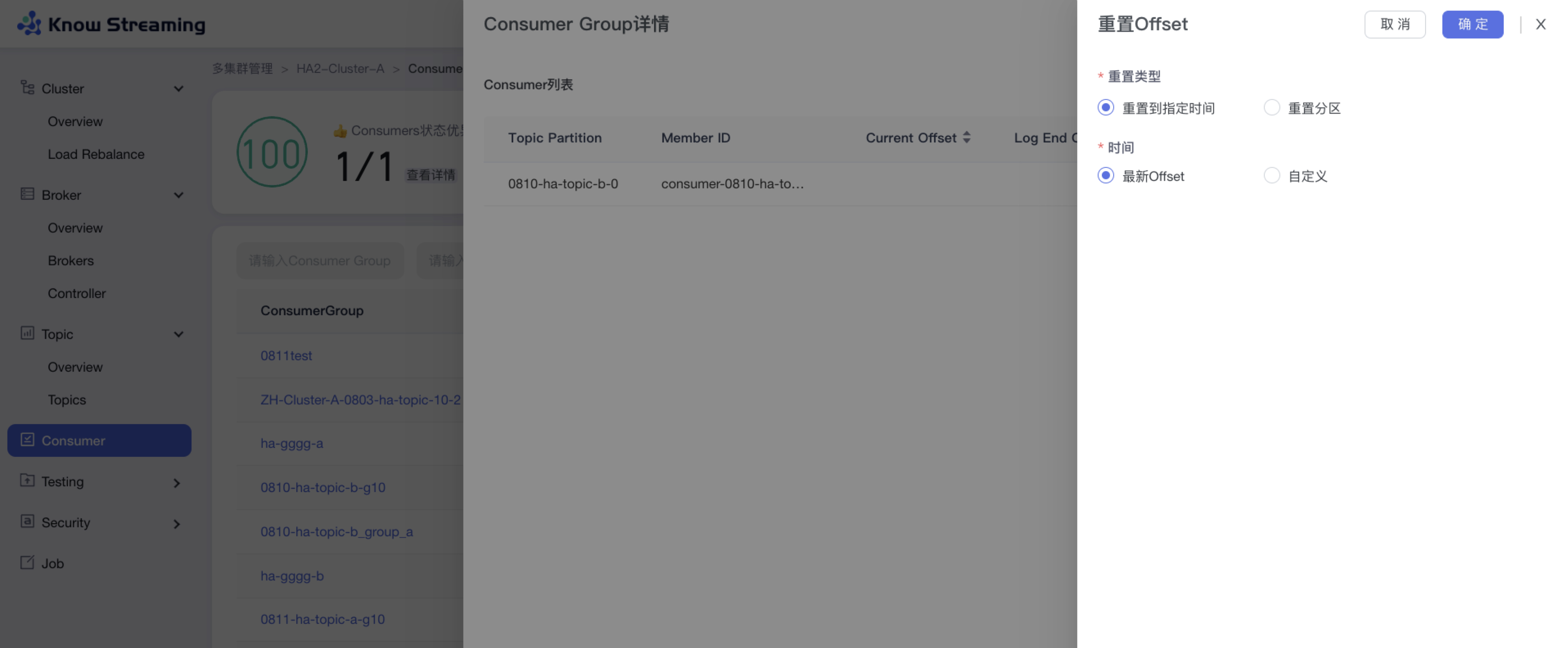

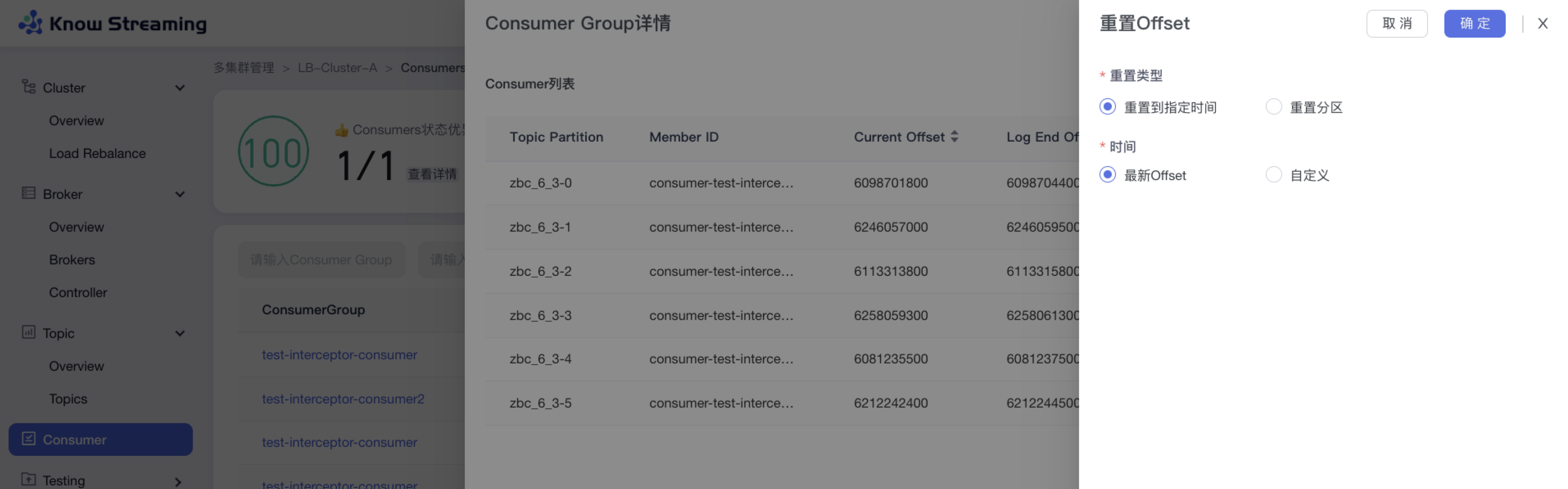

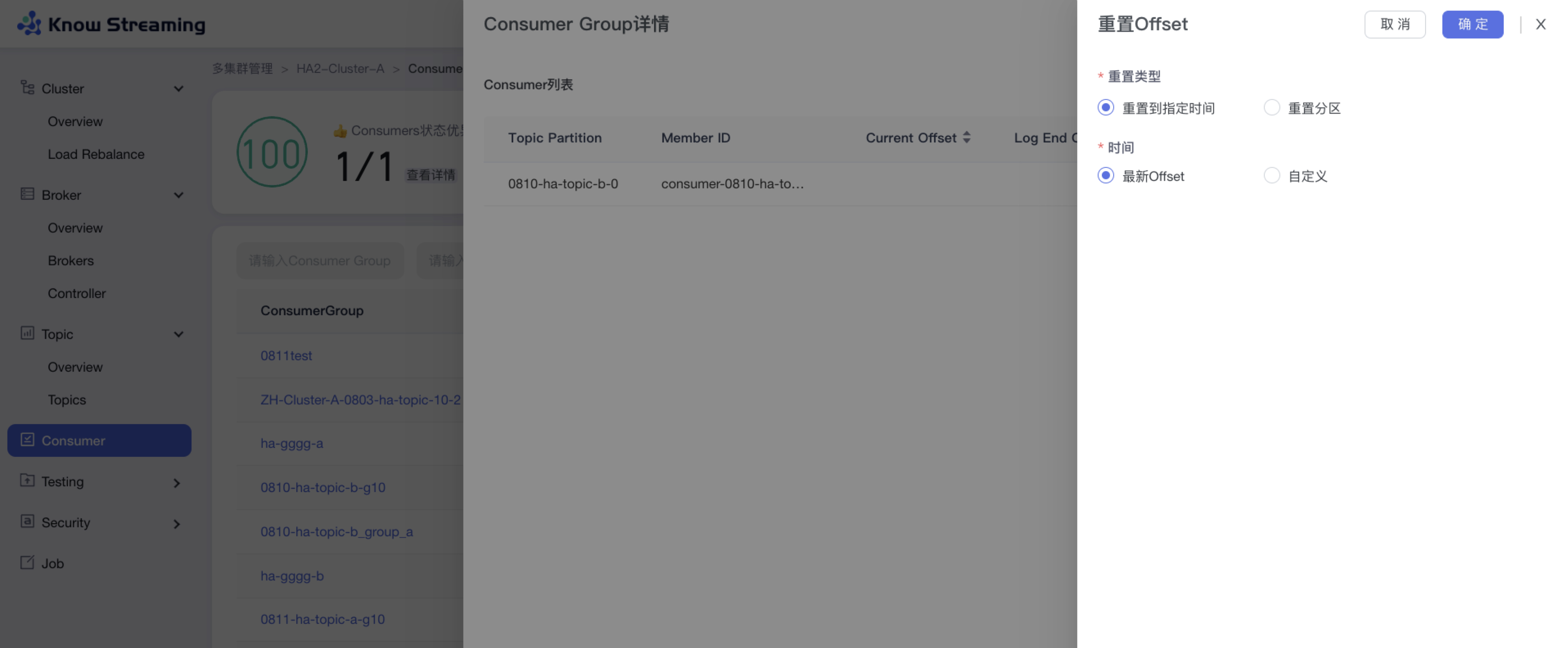

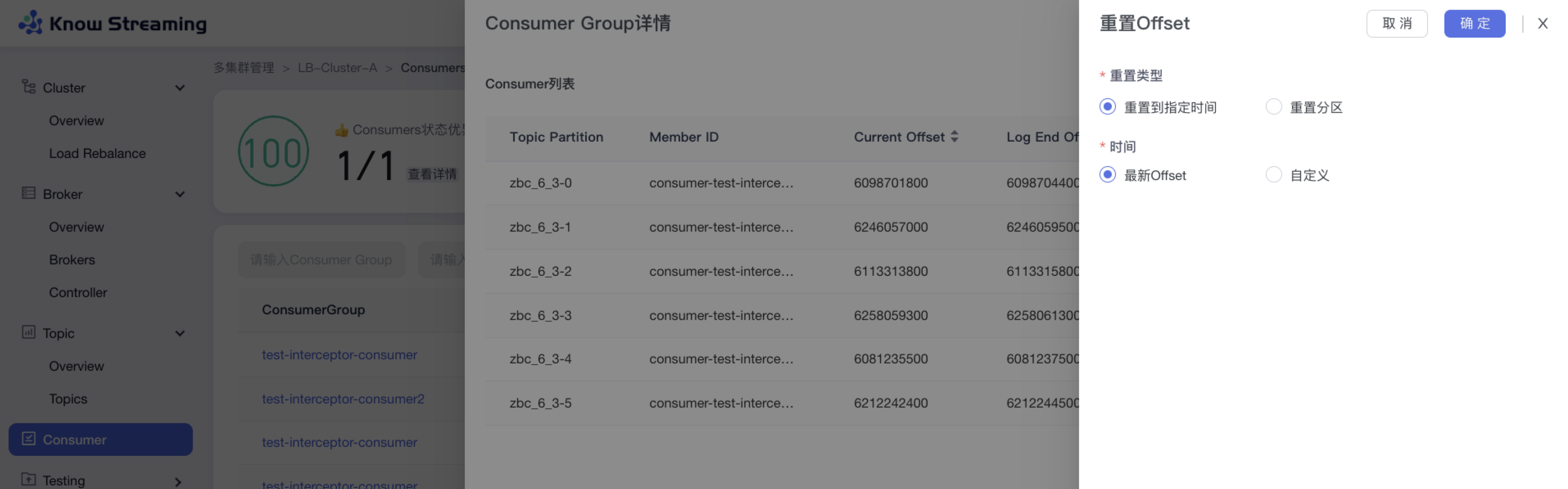

-- 修复重置 Group Offset 的提示信息中,缺少Dead状态也可进行重置的描述;

-- 修复新建 Topic 后,立即查看 Topic Messages 信息时,会提示 Topic 不存在的问题;

-- 修复副本变更时,优先副本选举未被正常处罚执行的问题;

-- 修复 git 目录不存在时,打包不能正常进行的问题;

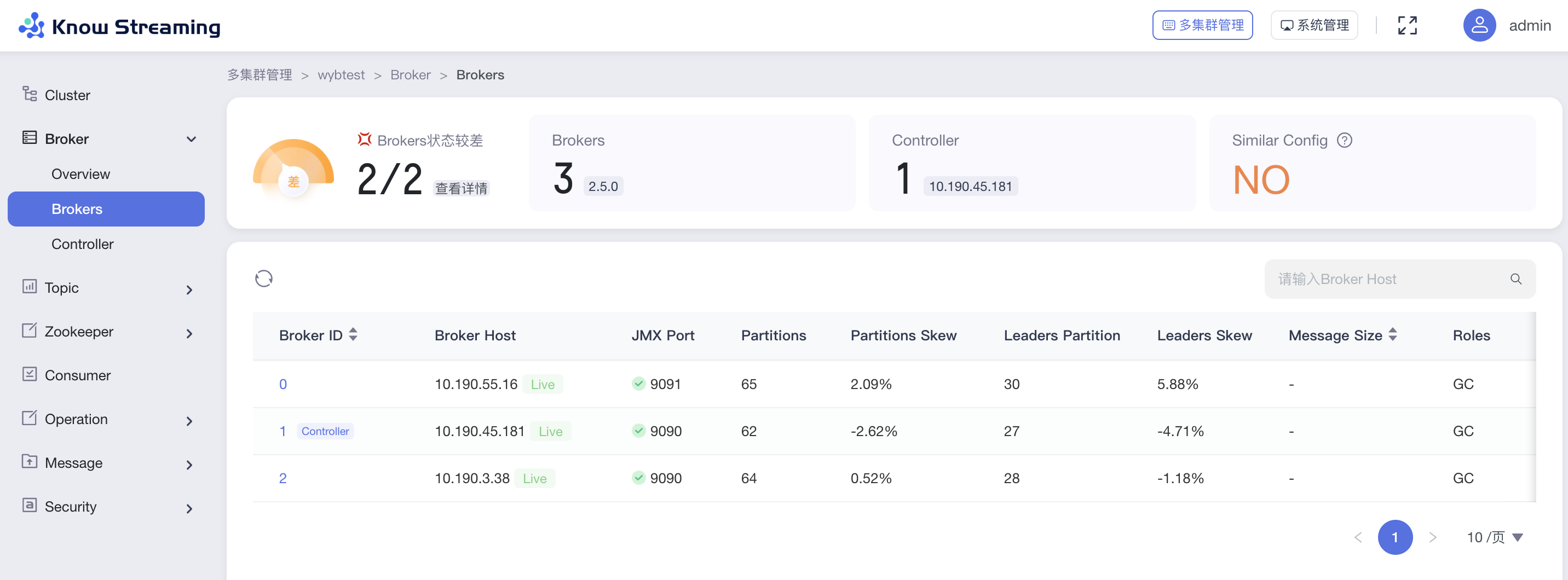

-- 修复 KRaft 模式的 Kafka 集群,JMX PORT 显示 -1 的问题;

-

-

-**体验优化**

-- 优化Cluster、Broker、Topic、Group的健康分为健康状态;

-- 去除健康巡检配置中的权重信息;

-- 错误提示页面展示优化;

-- 前端打包编译依赖默认使用 taobao 镜像;

-- 重新设计优化导航栏的 icon ;

-

-

-**新增**

-- 个人头像下拉信息中,新增产品版本信息;

-- 多集群列表页面,新增集群健康状态分布信息;

-

-

-**Kafka ZK 部分 (v3.1.0版本正式发布)**

-- 新增 ZK 集群的指标大盘信息;

-- 新增 ZK 集群的服务状态概览信息;

-- 新增 ZK 集群的服务节点列表信息;

-- 新增 Kafka 在 ZK 的存储数据查看功能;

-- 新增 ZK 的健康巡检及健康状态计算;

-

-

-

----

-

-

-## v3.0.1

-

-**Bug修复**

-- 修复重置 Group Offset 时,提示信息中缺少 Dead 状态也可进行重置的信息;

-- 修复 Ldap 某个属性不存在时,会直接抛出空指针导致登陆失败的问题;

-- 修复集群 Topic 列表页,健康分详情信息中,检查时间展示错误的问题;

-- 修复更新健康检查结果时,出现死锁的问题;

-- 修复 Replica 索引模版错误的问题;

-- 修复 FAQ 文档中的错误链接;

-- 修复 Broker 的 TopN 指标不存在时,页面数据不展示的问题;

-- 修复 Group 详情页,图表时间范围选择不生效的问题;

-

-

-**体验优化**

-- 集群 Group 列表按照 Group 维度进行展示;

-- 优化避免因 ES 中该指标不存在,导致日志中出现大量空指针的问题;

-- 优化全局 Message & Notification 展示效果;

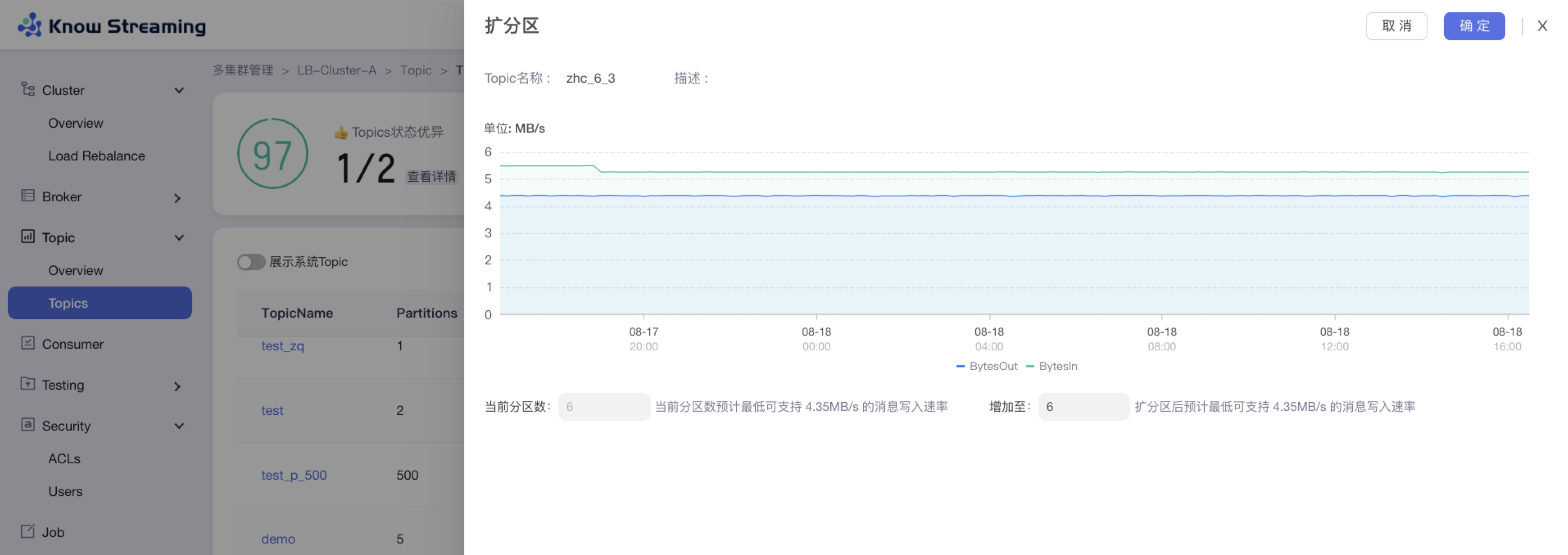

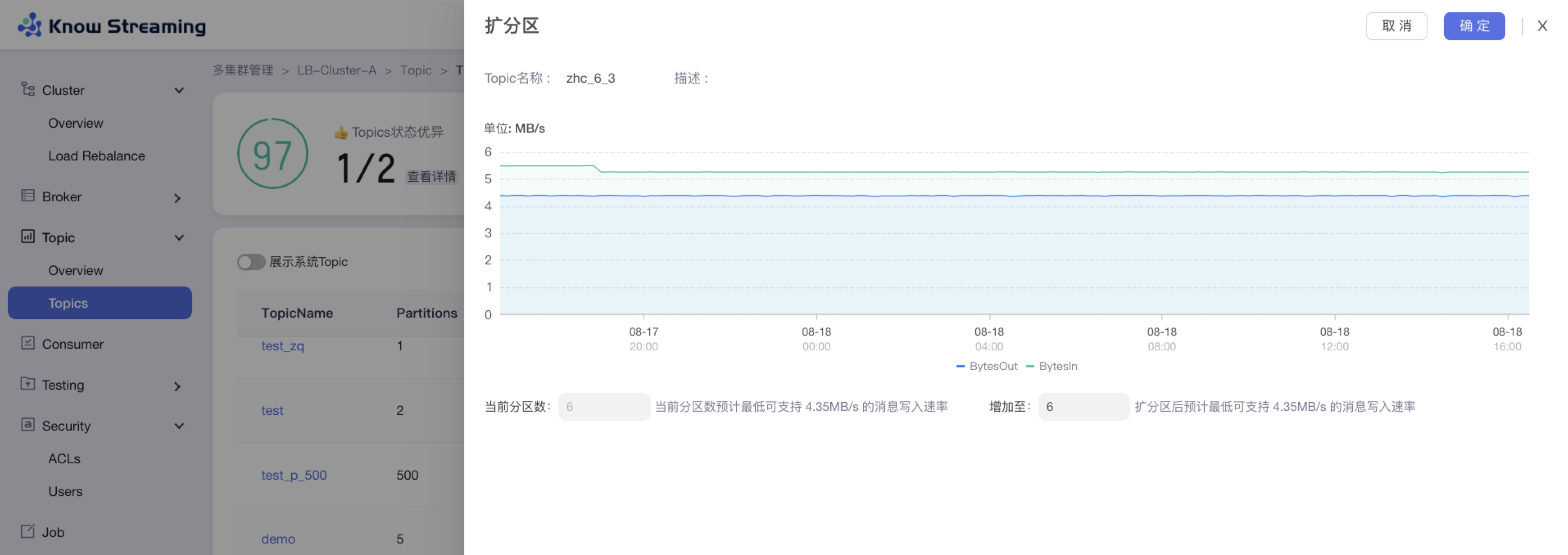

-- 优化 Topic 扩分区名称 & 描述展示;

-

-

-**新增**

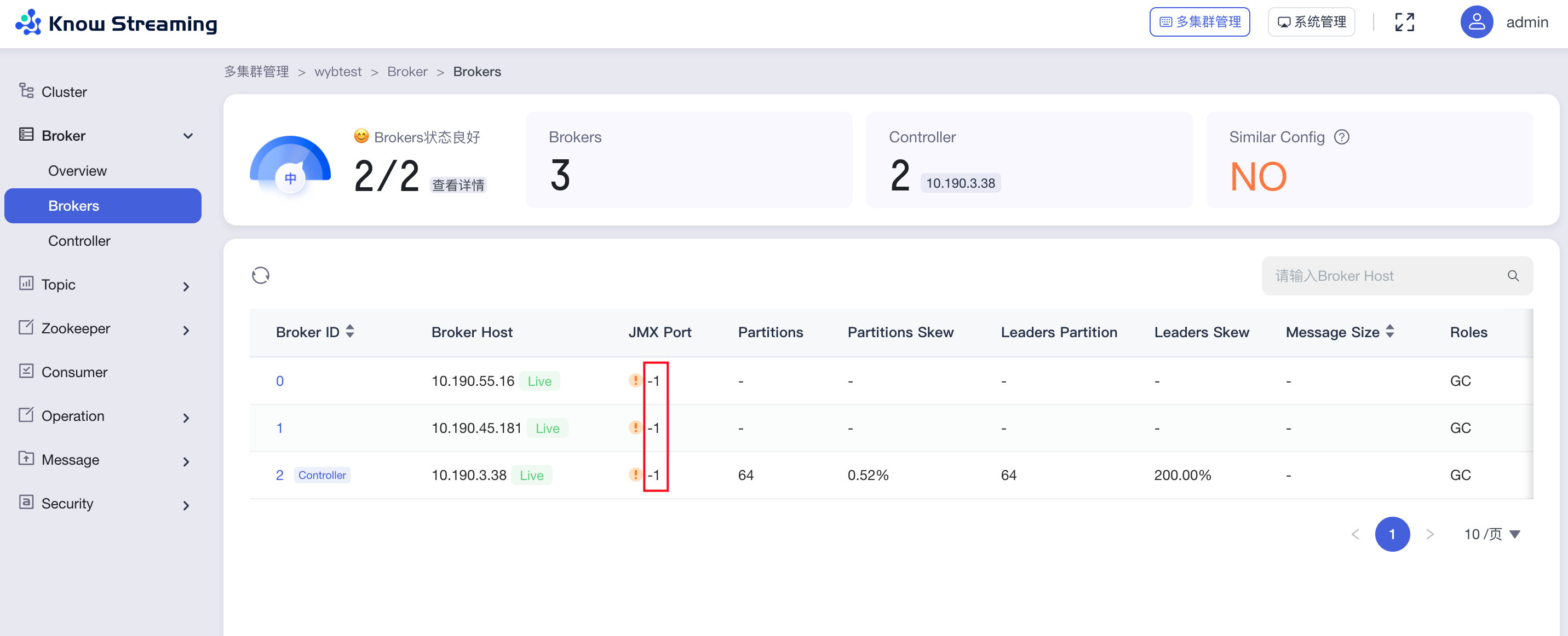

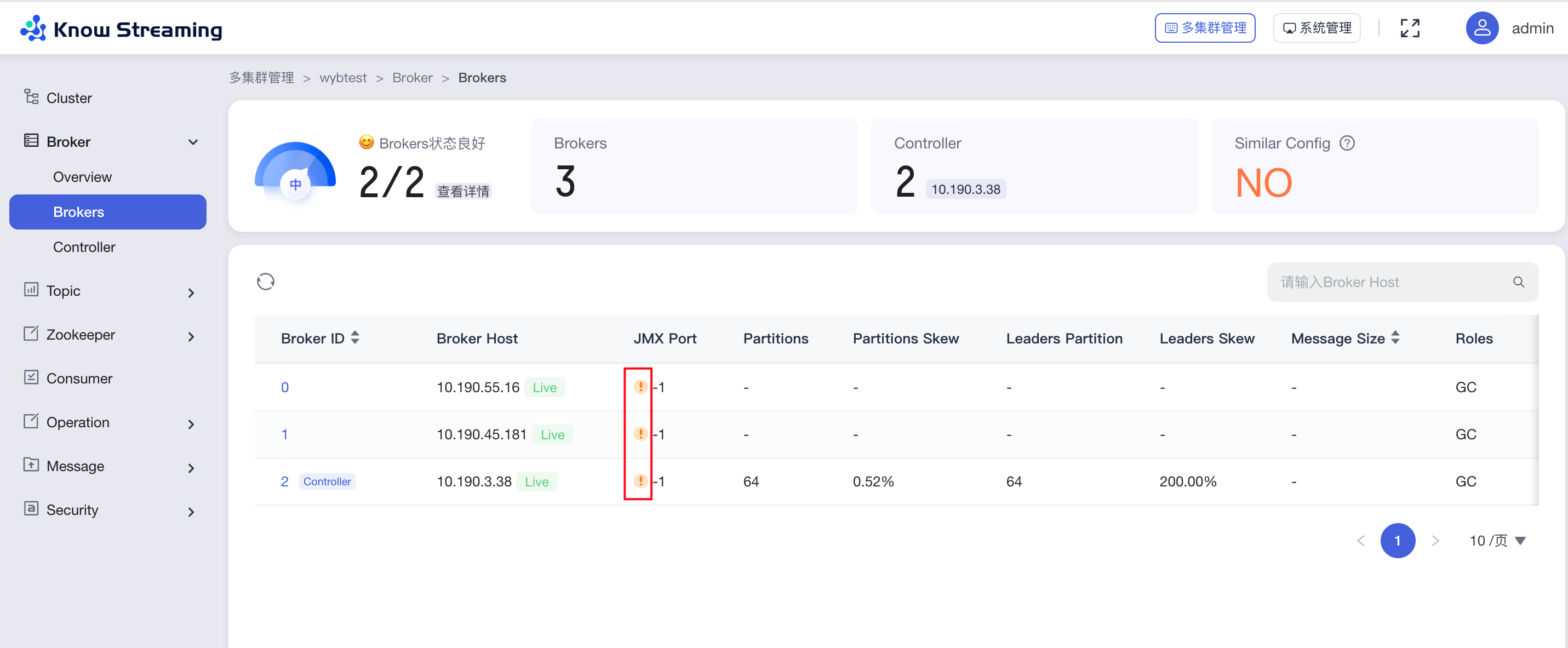

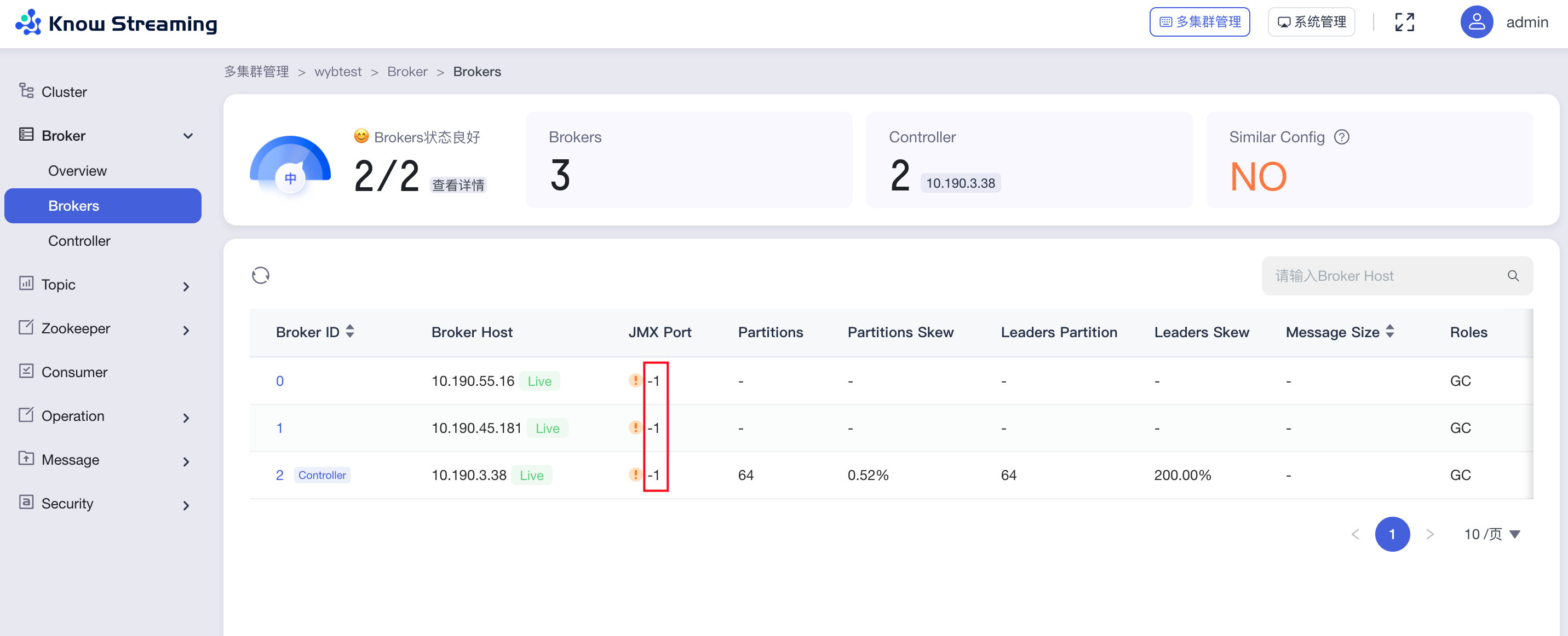

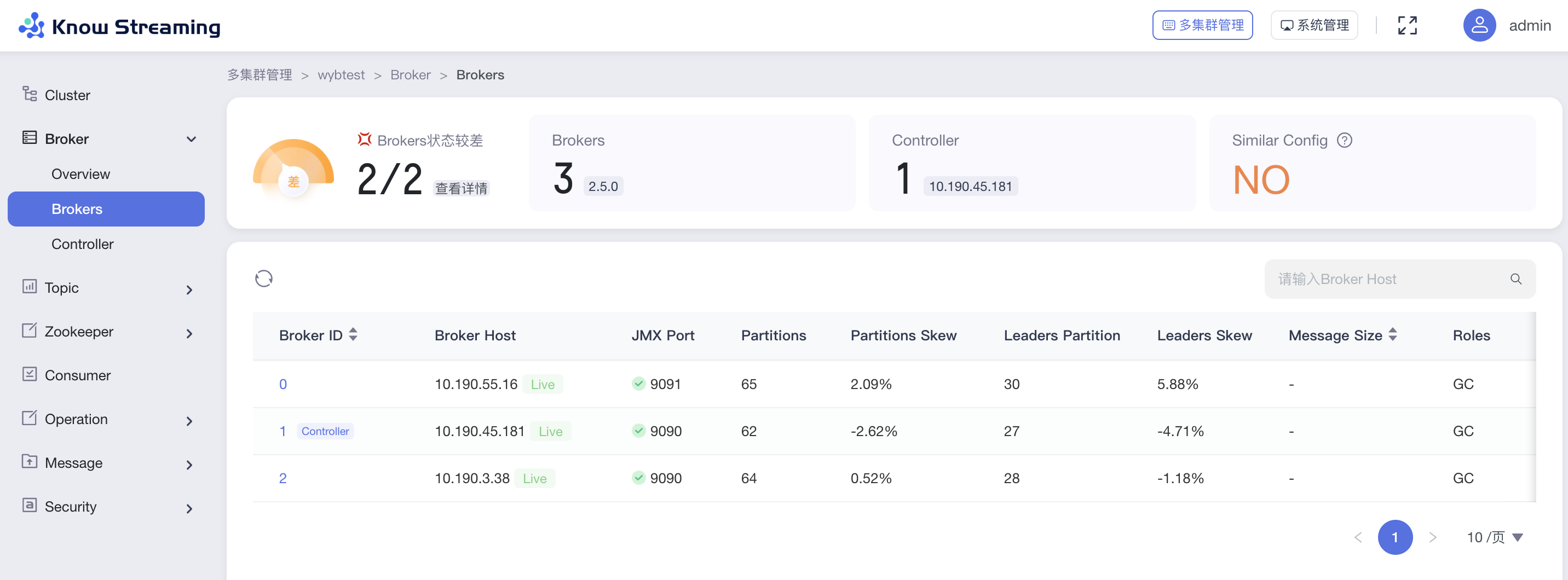

-- Broker 列表页面,新增 JMX 是否成功连接的信息;

-

-

-**ZK 部分(未完全发布)**

-- 后端补充 Kafka ZK 指标采集,Kafka ZK 信息获取相关功能;

-- 增加本地缓存,避免同一采集周期内 ZK 指标重复采集;

-- 增加 ZK 节点采集失败跳过策略,避免不断对存在问题的节点不断尝试;

-- 修复 zkAvgLatency 指标转 Long 时抛出异常问题;

-- 修复 ks_km_zookeeper 表中,role 字段类型错误问题;

-

----

-

-## v3.0.0

-

-**Bug修复**

-- 修复 Group 指标防重复采集不生效问题

-- 修复自动创建 ES 索引模版失败问题

-- 修复 Group+Topic 列表中存在已删除Topic的问题

-- 修复使用 MySQL-8 ,因兼容问题, start_time 信息为 NULL 时,会导致创建任务失败的问题

-- 修复 Group 信息表更新时,出现死锁的问题

-- 修复图表补点逻辑与图表时间范围不适配的问题

-

-

-**体验优化**

-- 按照资源类别,拆分健康巡检任务

-- 优化 Group 详情页的指标为实时获取

-- 图表拖拽排序支持用户级存储

-- 多集群列表 ZK 信息展示兼容无 ZK 情况

-- Topic 详情消息预览支持复制功能

-- 部分内容大数字支持千位分割符展示

-

-

-**新增**

-- 集群信息中,新增 Zookeeper 客户端配置字段

-- 集群信息中,新增 Kafka 集群运行模式字段

-- 新增 docker-compose 的部署方式

-

----

-

-## v3.0.0-beta.3

-

-**文档**

-- FAQ 补充权限识别失败问题的说明

-- 同步更新文档,保持与官网一致

-

-

-**Bug修复**

-- Offset 信息获取时,过滤掉无 Leader 的分区

-- 升级 oshi-core 版本至 5.6.1 版本,修复 Windows 系统获取系统指标失败问题

-- 修复 JMX 连接被关闭后,未进行重建的问题

-- 修复因 DB 中 Broker 信息不存在导致 TotalLogSize 指标获取时抛空指针问题

-- 修复 dml-logi.sql 中,SQL 注释错误的问题

-- 修复 startup.sh 中,识别操作系统类型错误的问题

-- 修复配置管理页面删除配置失败的问题

-- 修复系统管理应用文件引用路径

-- 修复 Topic Messages 详情提示信息点击跳转 404 的问题

-- 修复扩副本时,当前副本数不显示问题

-

-

-**体验优化**

-- Topic-Messages 页面,增加返回数据的排序以及按照Earliest/Latest的获取方式

-- 优化 GroupOffsetResetEnum 类名为 OffsetTypeEnum,使得类名含义更准确

-- 移动 KafkaZKDAO 类,及 Kafka Znode 实体类的位置,使得 Kafka Zookeeper DAO 更加内聚及便于识别

-- 后端补充 Overview 页面指标排序的功能

-- 前端 Webpack 配置优化

-- Cluster Overview 图表取消放大展示功能

-- 列表页增加手动刷新功能

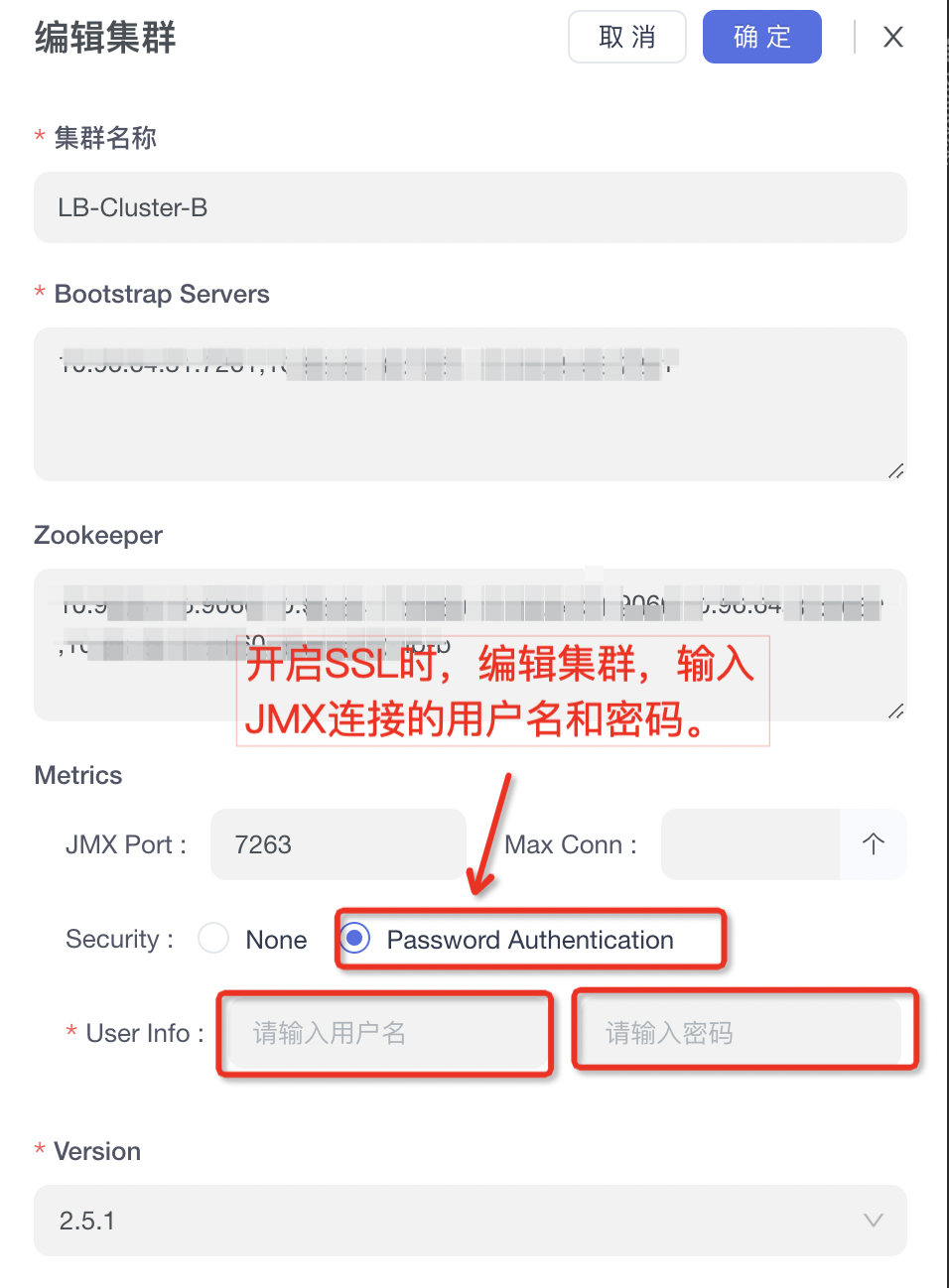

-- 接入/编辑集群,优化 JMX-PORT,Version 信息的回显,优化JMX信息的展示

-- 提高登录页面图片展示清晰度

-- 部分样式和文案优化

-

----

-

-## v3.0.0-beta.2

-

-**文档**

-- 新增登录系统对接文档

-- 优化前端工程打包构建部分文档说明

-- FAQ补充KnowStreaming连接特定JMX IP的说明

-

-

-**Bug修复**

-- 修复logi_security_oplog表字段过短,导致删除Topic等操作无法记录的问题

-- 修复ES查询时,抛java.lang.NumberFormatException: For input string: "{"value":0,"relation":"eq"}" 问题

-- 修复LogStartOffset和LogEndOffset指标单位错误问题

-- 修复进行副本变更时,旧副本数为NULL的问题

-- 修复集群Group列表,在第二页搜索时,搜索时返回的分页信息错误问题

-- 修复重置Offset时,返回的错误信息提示不一致的问题

-- 修复集群查看,系统查看,LoadRebalance等页面权限点缺失问题

-- 修复查询不存在的Topic时,错误信息提示不明显的问题

-- 修复Windows用户打包前端工程报错的问题

-- package-lock.json锁定前端依赖版本号,修复因依赖自动升级导致打包失败等问题

-- 系统管理子应用,补充后端返回的Code码拦截,解决后端接口返回报错不展示的问题

-- 修复用户登出后,依旧可以访问系统的问题

-- 修复巡检任务配置时,数值显示错误的问题

-- 修复Broker/Topic Overview 图表和图表详情问题

-- 修复Job扩缩副本任务明细数据错误的问题

-- 修复重置Offset时,分区ID,Offset数值无限制问题

-- 修复扩缩/迁移副本时,无法选中Kafka系统Topic的问题

-- 修复Topic的Config页面,编辑表单时不能正确回显当前值的问题

-- 修复Broker Card返回数据后依旧展示加载态的问题

-

-

-

-**体验优化**

-- 优化默认用户密码为 admin/admin

-- 缩短新增集群后,集群信息加载的耗时

-- 集群Broker列表,增加Controller角色信息

-- 副本变更任务结束后,增加进行优先副本选举的操作

-- Task模块任务分为Metrics、Common、Metadata三类任务,每类任务配备独立线程池,减少对Job模块的线程池,以及不同类任务之间的相互影响

-- 删除代码中存在的多余无用文件

-- 自动新增ES索引模版及近7天索引,减少用户搭建时需要做的事项

-- 优化前端工程打包流程

-- 优化登录页文案,页面左侧栏内容,单集群详情样式,Topic列表趋势图等

-- 首次进入Broker/Topic图表详情时,进行预缓存数据从而优化体验

-- 优化Topic详情Partition Tab的展示

-- 多集群列表页增加编辑功能

-- 优化副本变更时,迁移时间支持分钟级别粒度

-- logi-security版本升级至2.10.13

-- logi-elasticsearch-client版本升级至1.0.24

-

-

-**能力提升**

-- 支持Ldap登录认证

-

----

-

-## v3.0.0-beta.1

-

-**文档**

-- 新增Task模块说明文档

-- FAQ补充 `Specified key was too long; max key length is 767 bytes ` 错误说明

-- FAQ补充 `出现ESIndexNotFoundException报错` 错误说明

-

-

-**Bug修复**

-- 修复 Consumer 点击 Stop 未停止检索的问题

-- 修复创建/编辑角色权限报错问题

-- 修复多集群管理/单集群详情均衡卡片状态错误问题

-- 修复版本列表未排序问题

-- 修复Raft集群Controller信息不断记录问题

-- 修复部分版本消费组描述信息获取失败问题

-- 修复分区Offset获取失败的日志中,缺少Topic名称信息问题

-- 修复GitHub图地址错误,及图裂问题

-- 修复Broker默认使用的地址和注释不一致问题

-- 修复 Consumer 列表分页不生效问题

-- 修复操作记录表operation_methods字段缺少默认值问题

-- 修复集群均衡表中move_broker_list字段无效的问题

-- 修复KafkaUser、KafkaACL信息获取时,日志一直重复提示不支持问题

-- 修复指标缺失时,曲线出现掉底的问题

-

-

-**体验优化**

-- 优化前端构建时间和打包体积,增加依赖打包的分包策略

-- 优化产品样式和文案展示

-- 优化ES客户端数为可配置

-- 优化日志中大量出现的MySQL Key冲突日志

-

-

-**能力提升**

-- 增加周期任务,用于主动创建缺少的ES模版及索引的能力,减少额外的脚本操作

-- 增加JMX连接的Broker地址可选择的能力

-

----

-

-## v3.0.0-beta.0

-

-**1、多集群管理**

-

-- 增加健康监测体系、关键组件&指标 GUI 展示

-- 增加 2.8.x 以上 Kafka 集群接入,覆盖 0.10.x-3.x

-- 删除逻辑集群、共享集群、Region 概念

-

-**2、Cluster 管理**

-

-- 增加集群概览信息、集群配置变更记录

-- 增加 Cluster 健康分,健康检查规则支持自定义配置

-- 增加 Cluster 关键指标统计和 GUI 展示,支持自定义配置

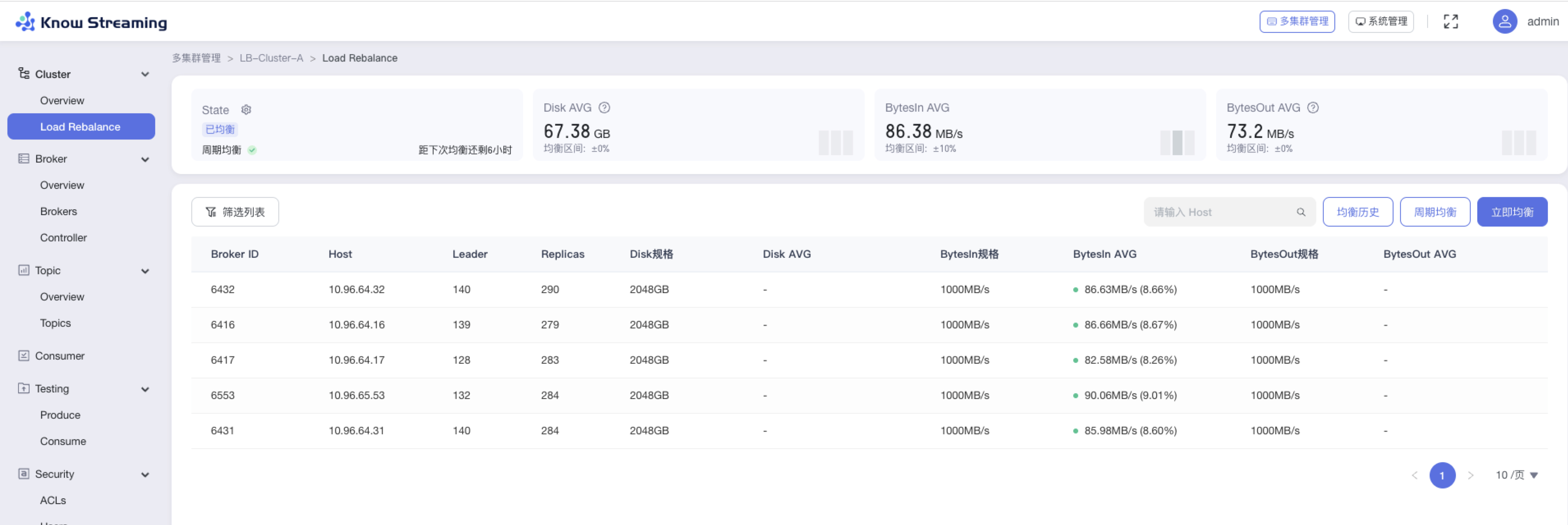

-- 增加 Cluster 层 I/O、Disk 的 Load Reblance 功能,支持定时均衡任务(企业版)

-- 删除限流、鉴权功能

-- 删除 APPID 概念

-

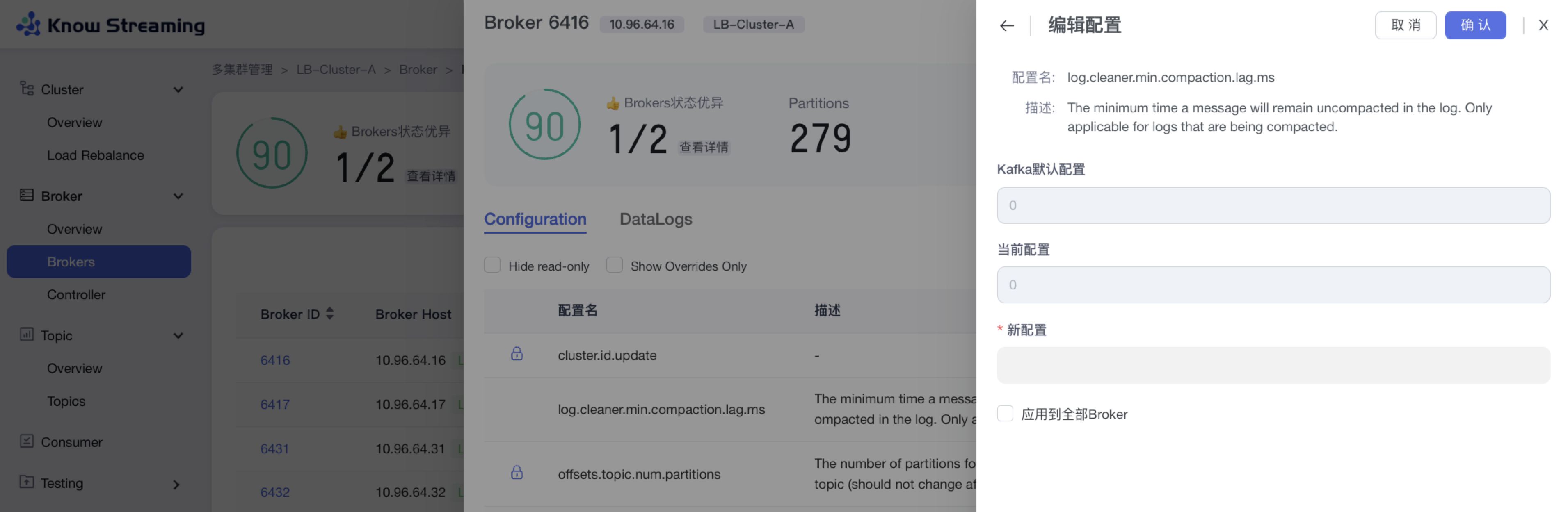

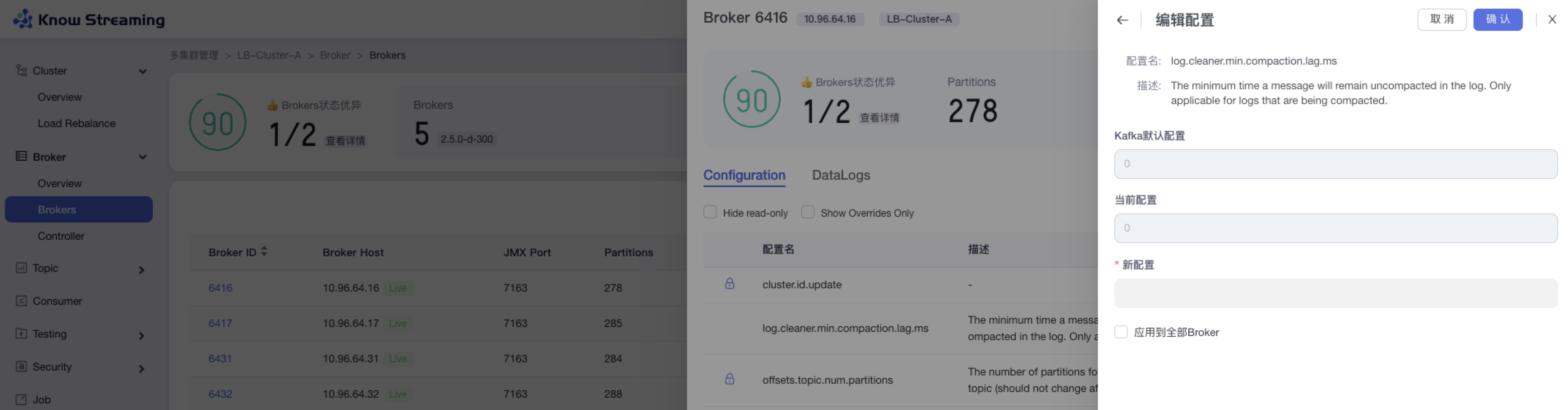

-**3、Broker 管理**

-

-- 增加 Broker 健康分

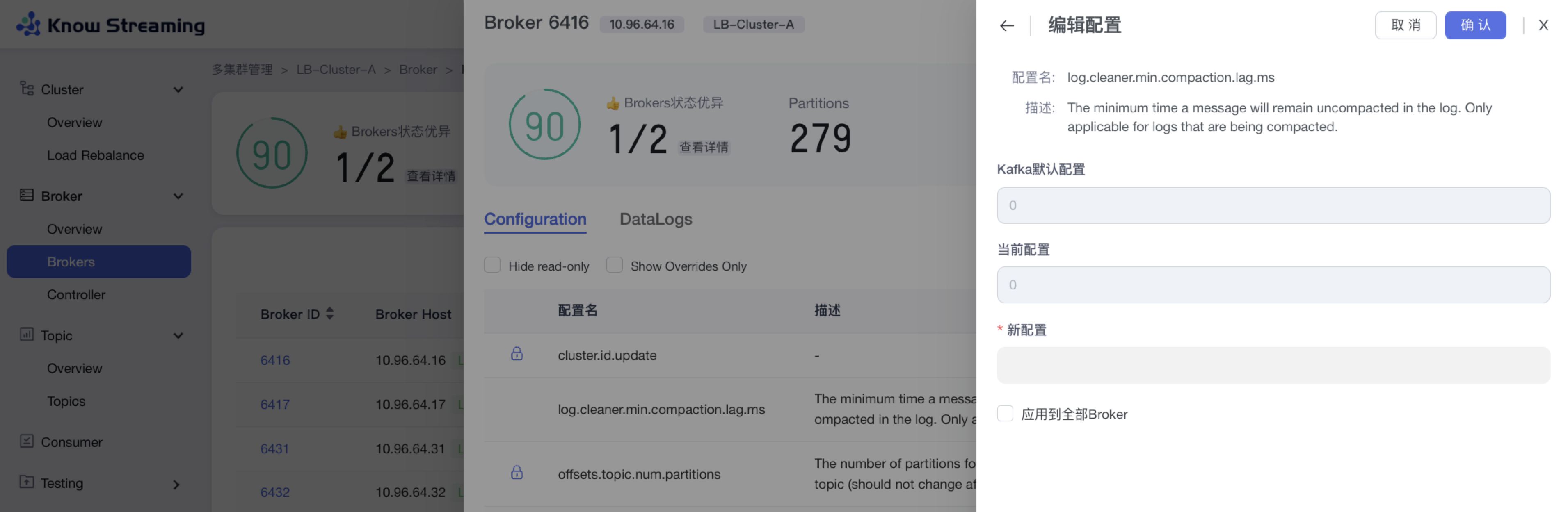

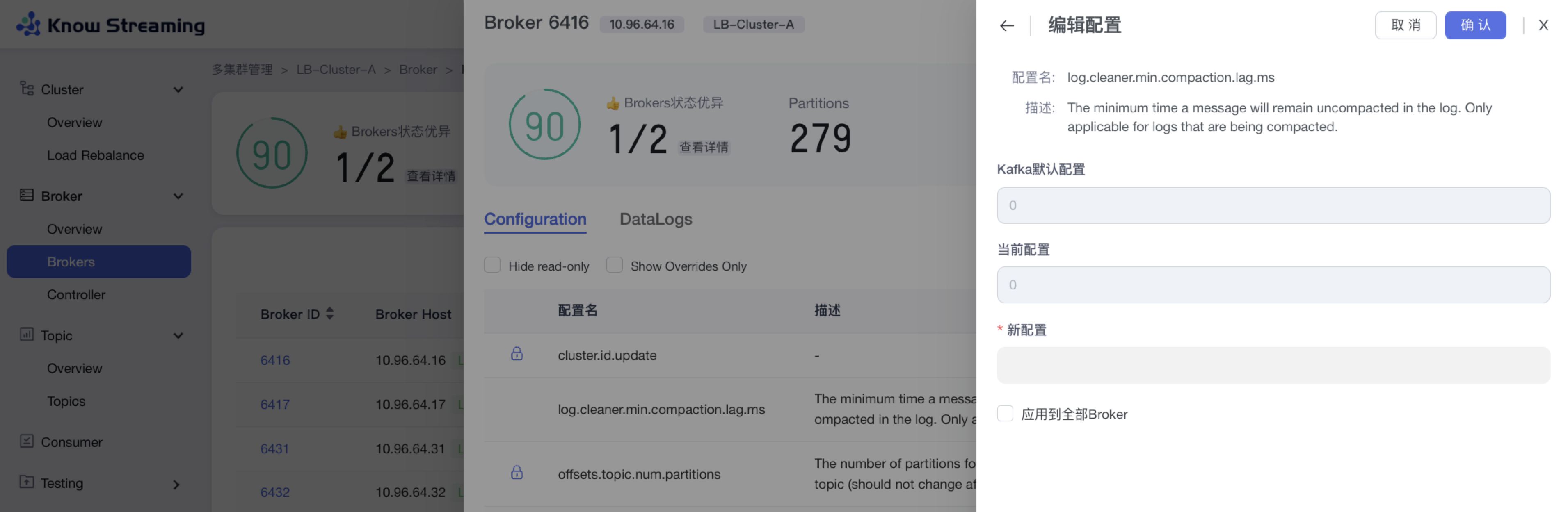

-- 增加 Broker 关键指标统计和 GUI 展示,支持自定义配置

-- 增加 Broker 参数配置功能,需重启生效

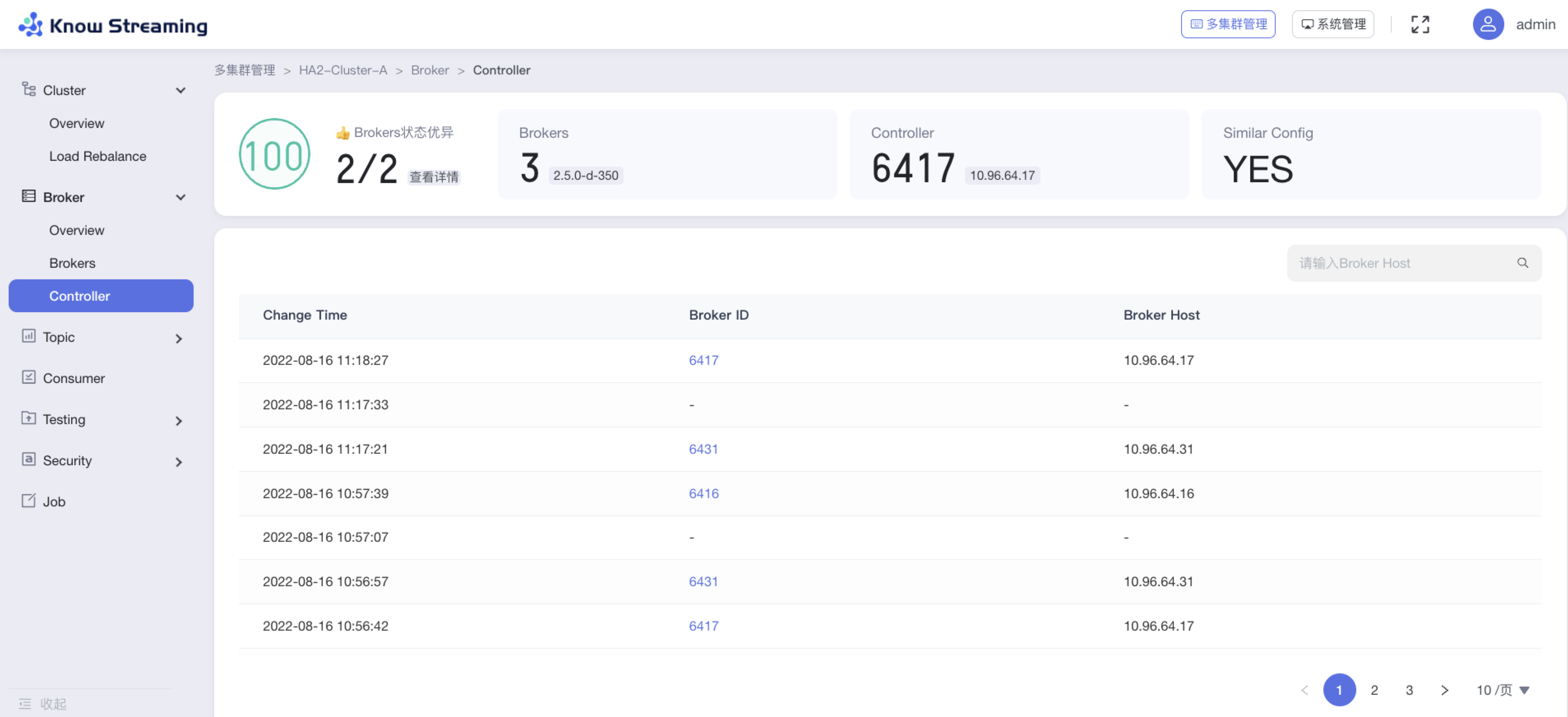

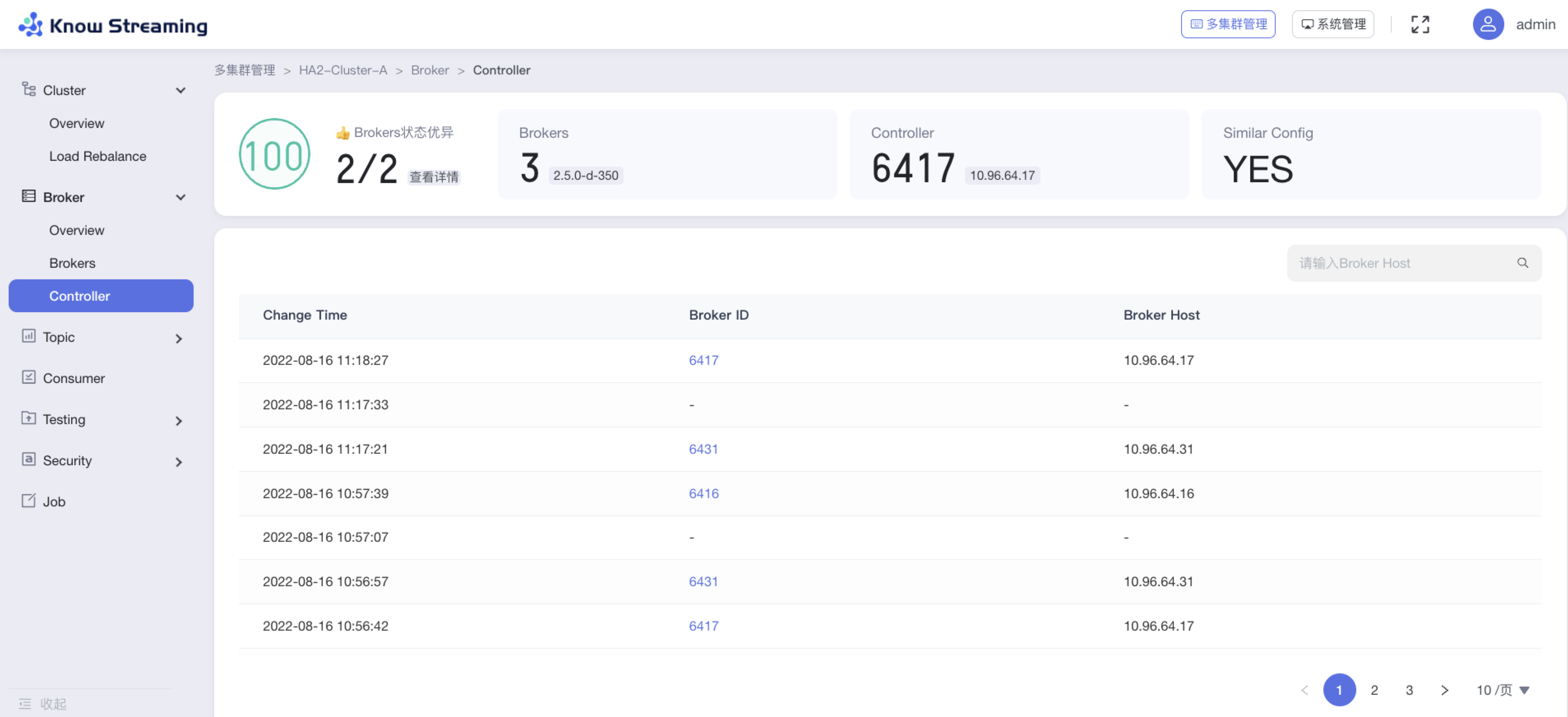

-- 增加 Controller 变更记录

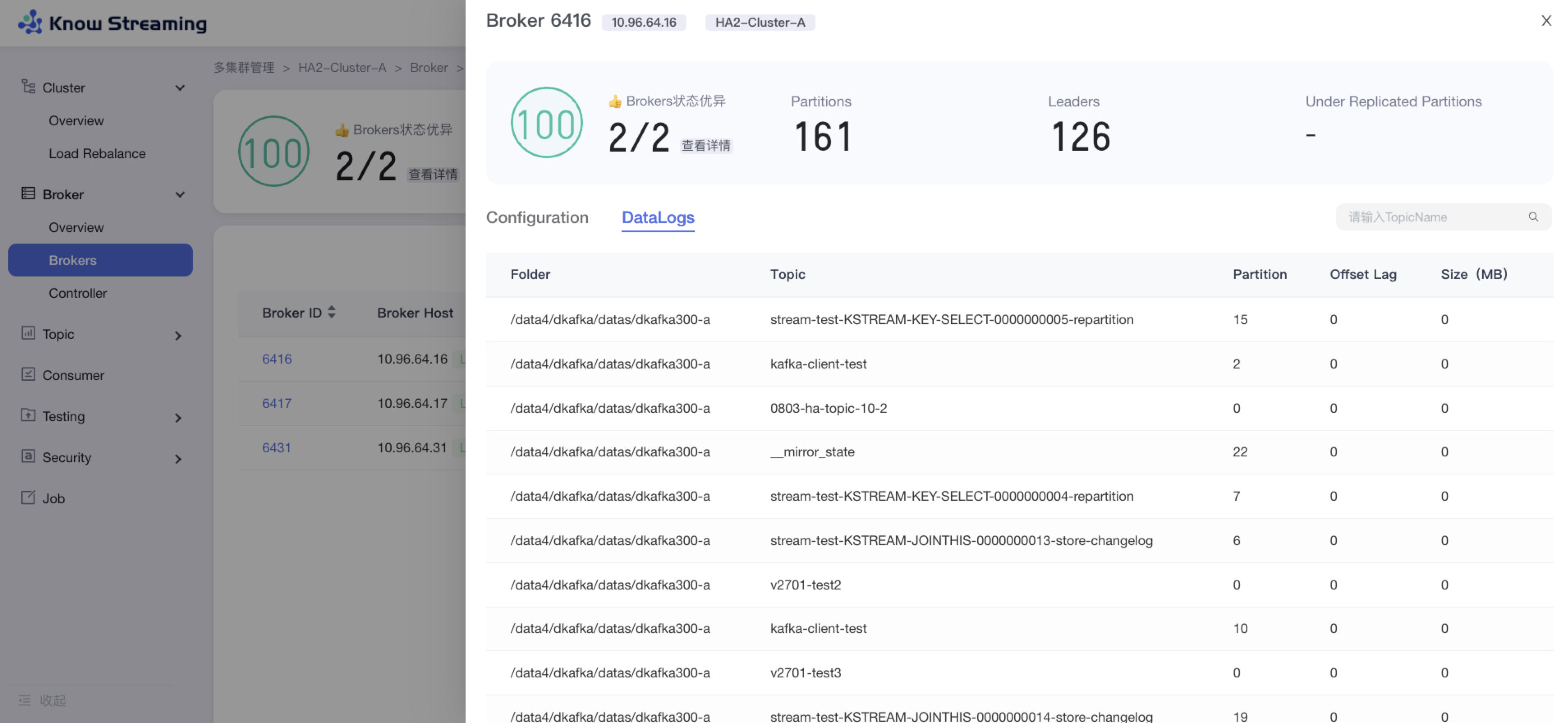

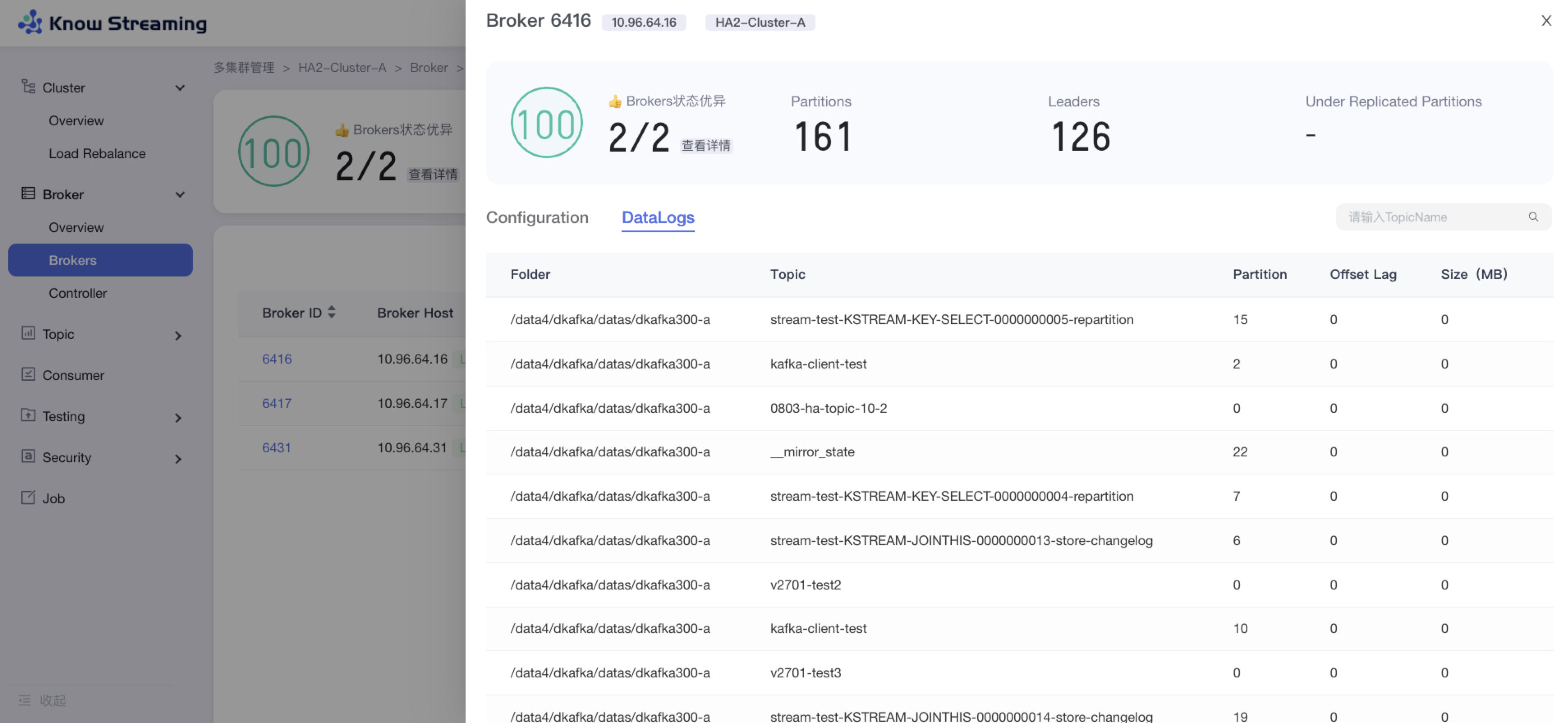

-- 增加 Broker Datalogs 记录

-- 删除 Leader Rebalance 功能

-- 删除 Broker 优先副本选举

-

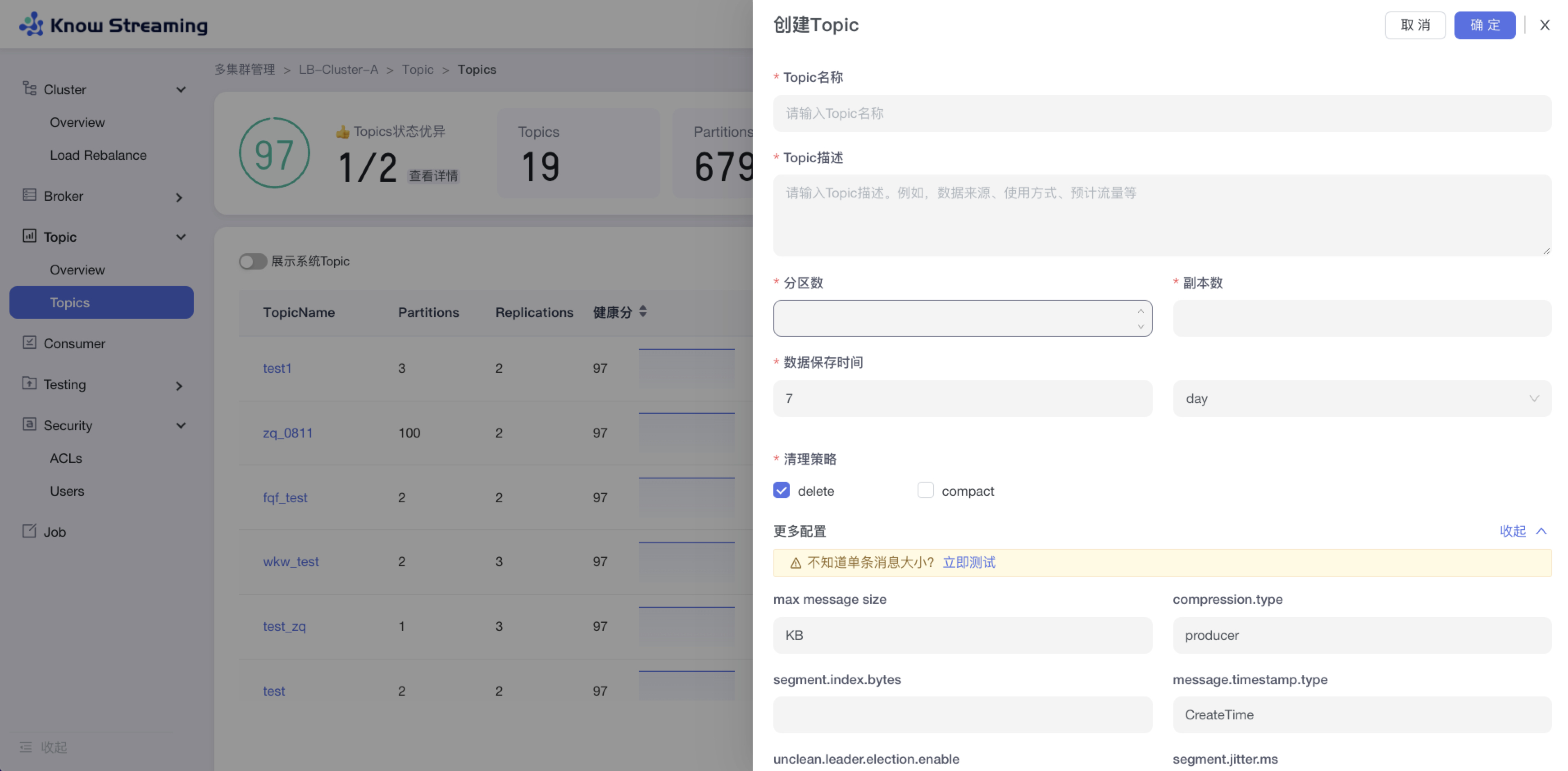

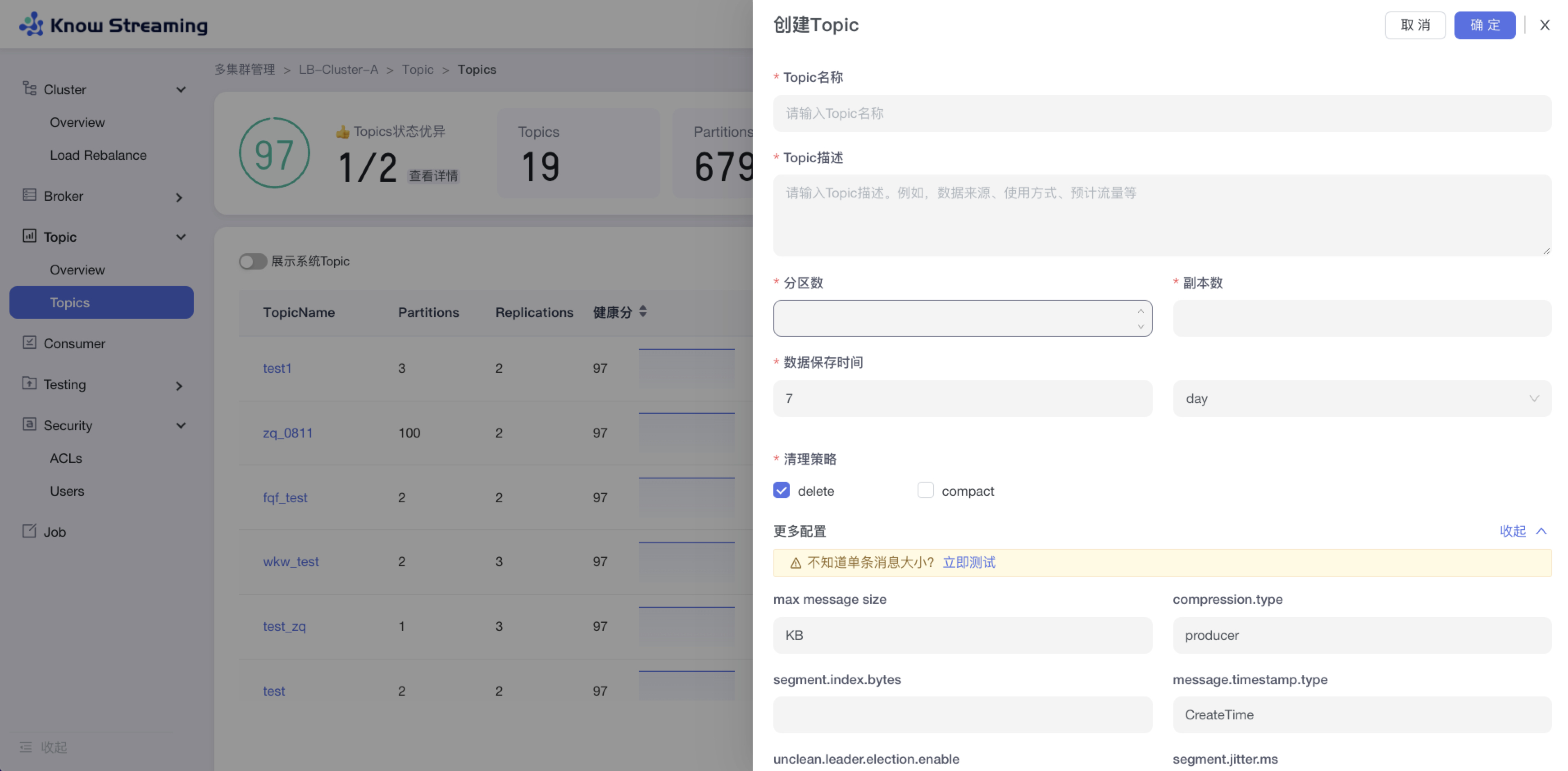

-**4、Topic 管理**

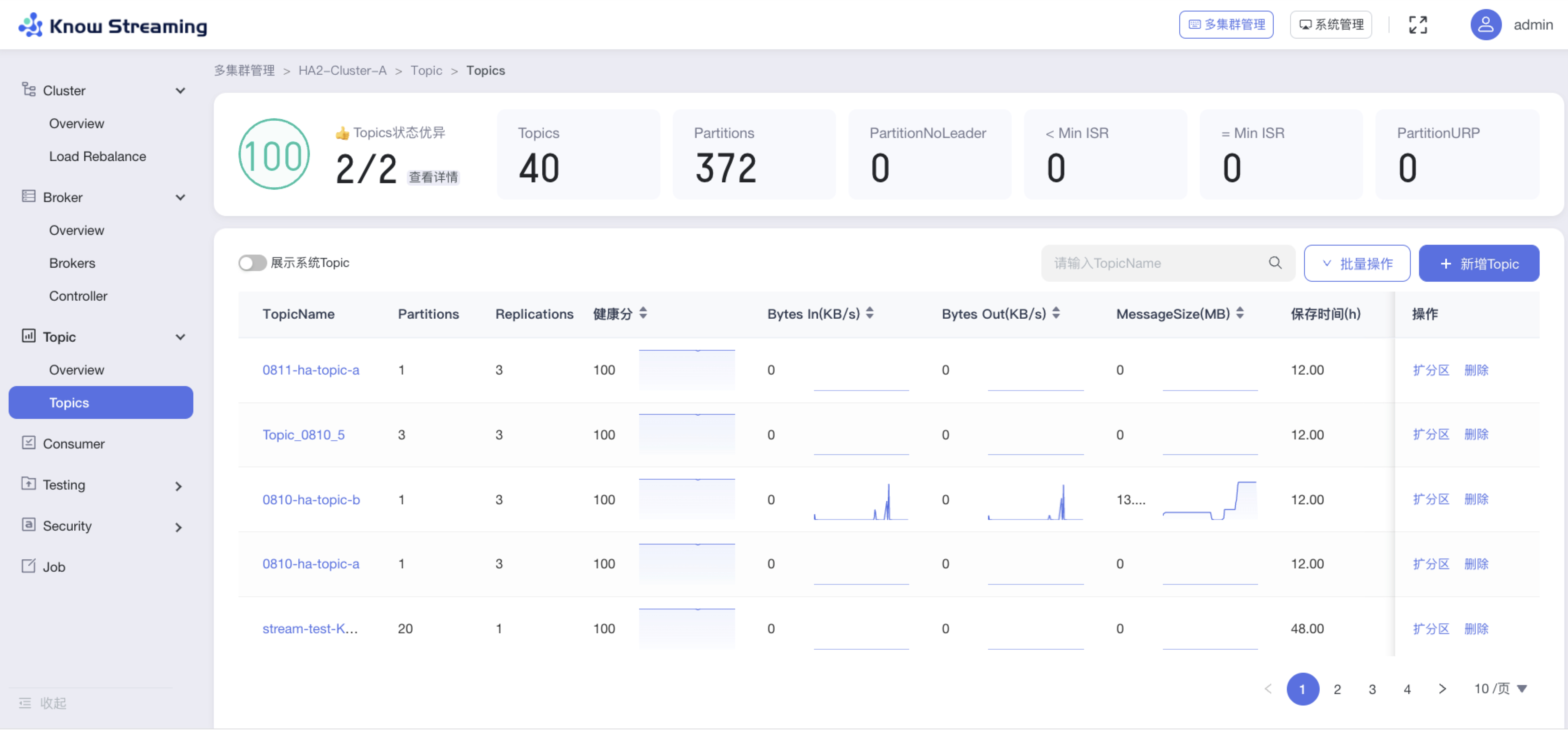

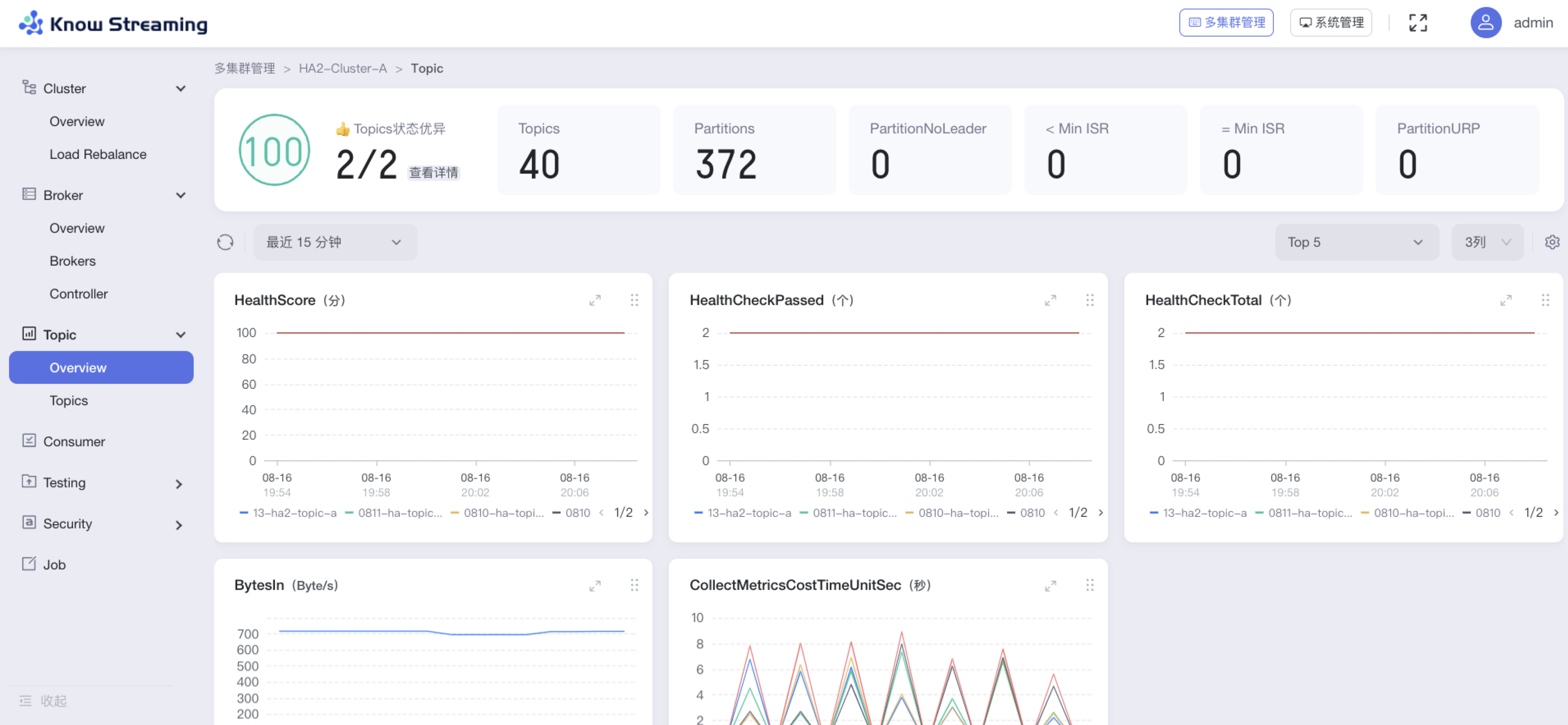

-

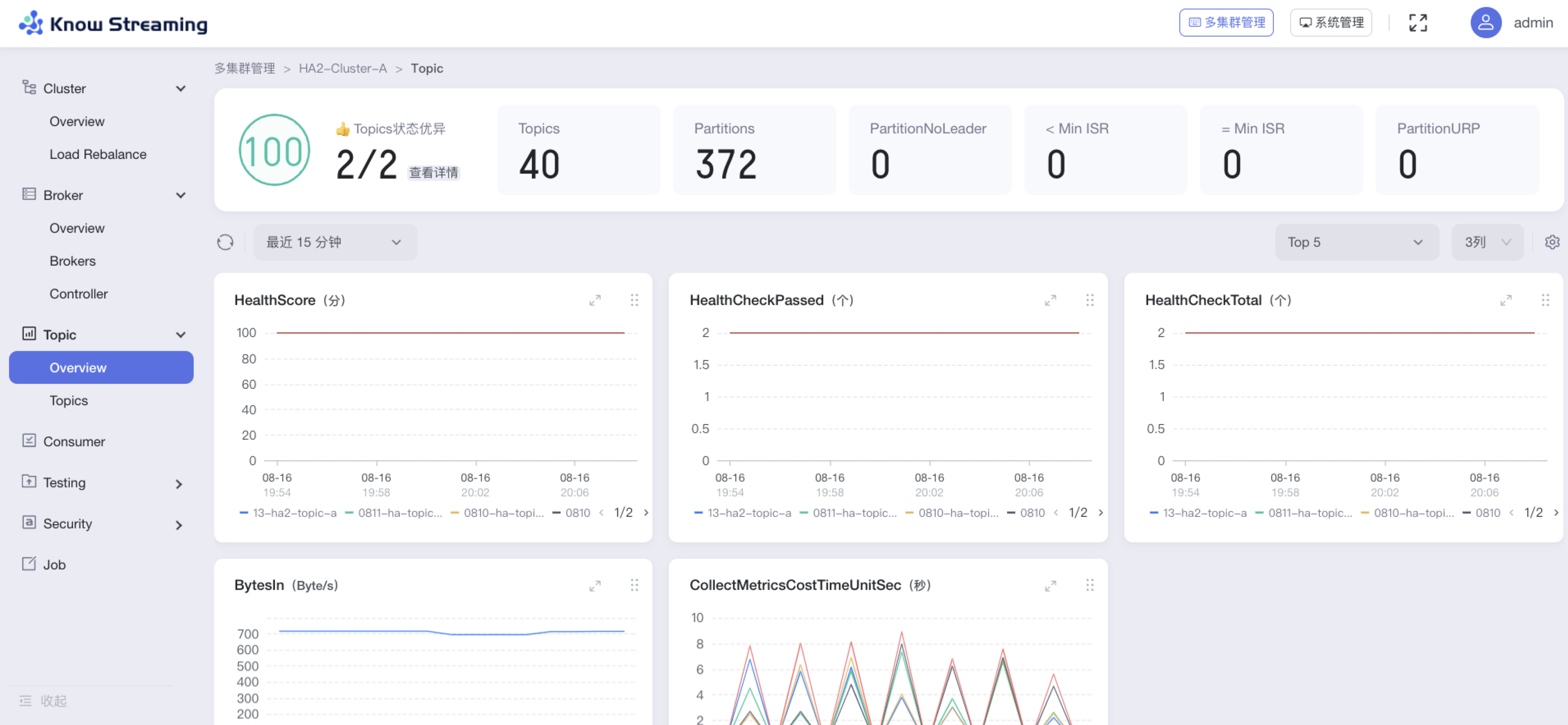

-- 增加 Topic 健康分

-- 增加 Topic 关键指标统计和 GUI 展示,支持自定义配置

-- 增加 Topic 参数配置功能,可实时生效

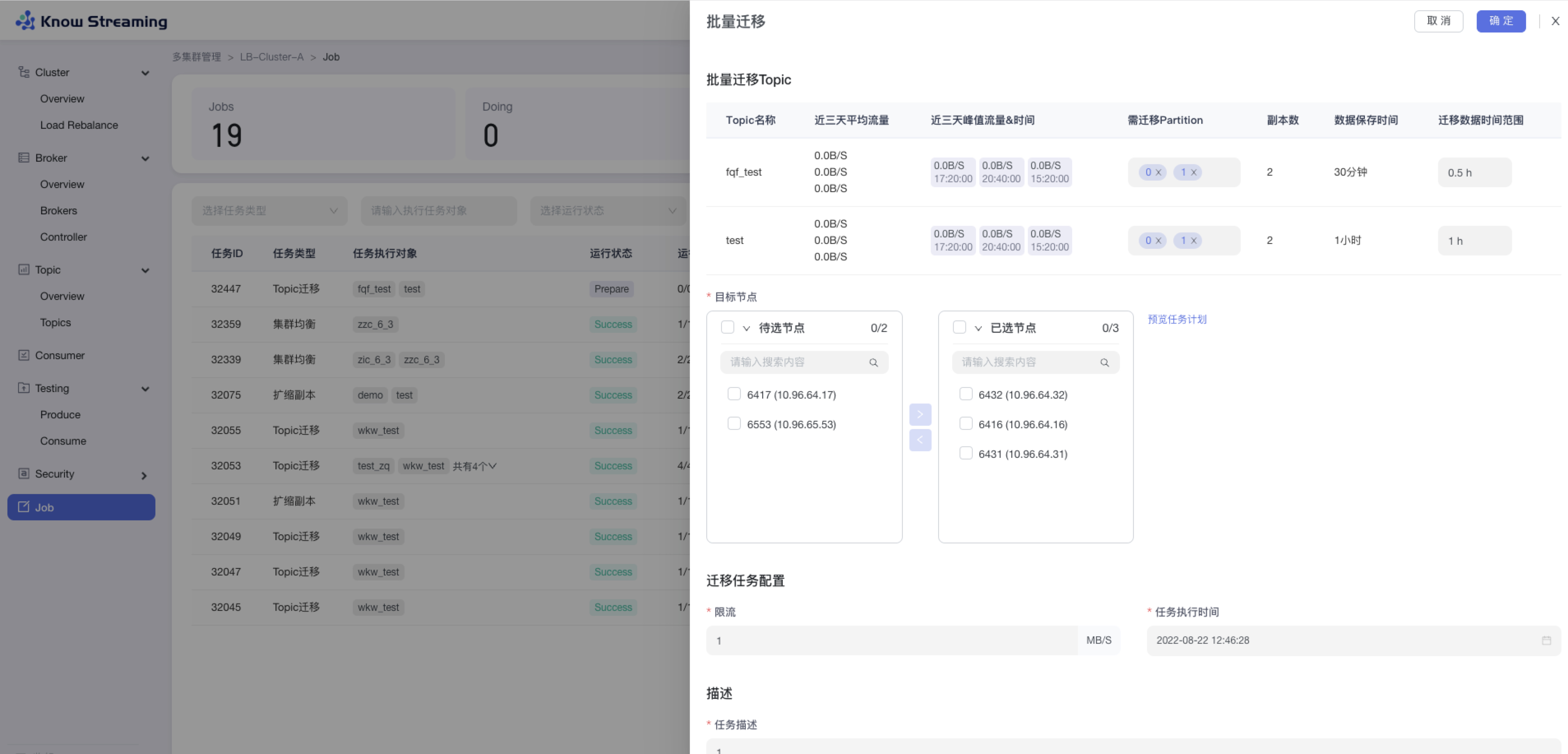

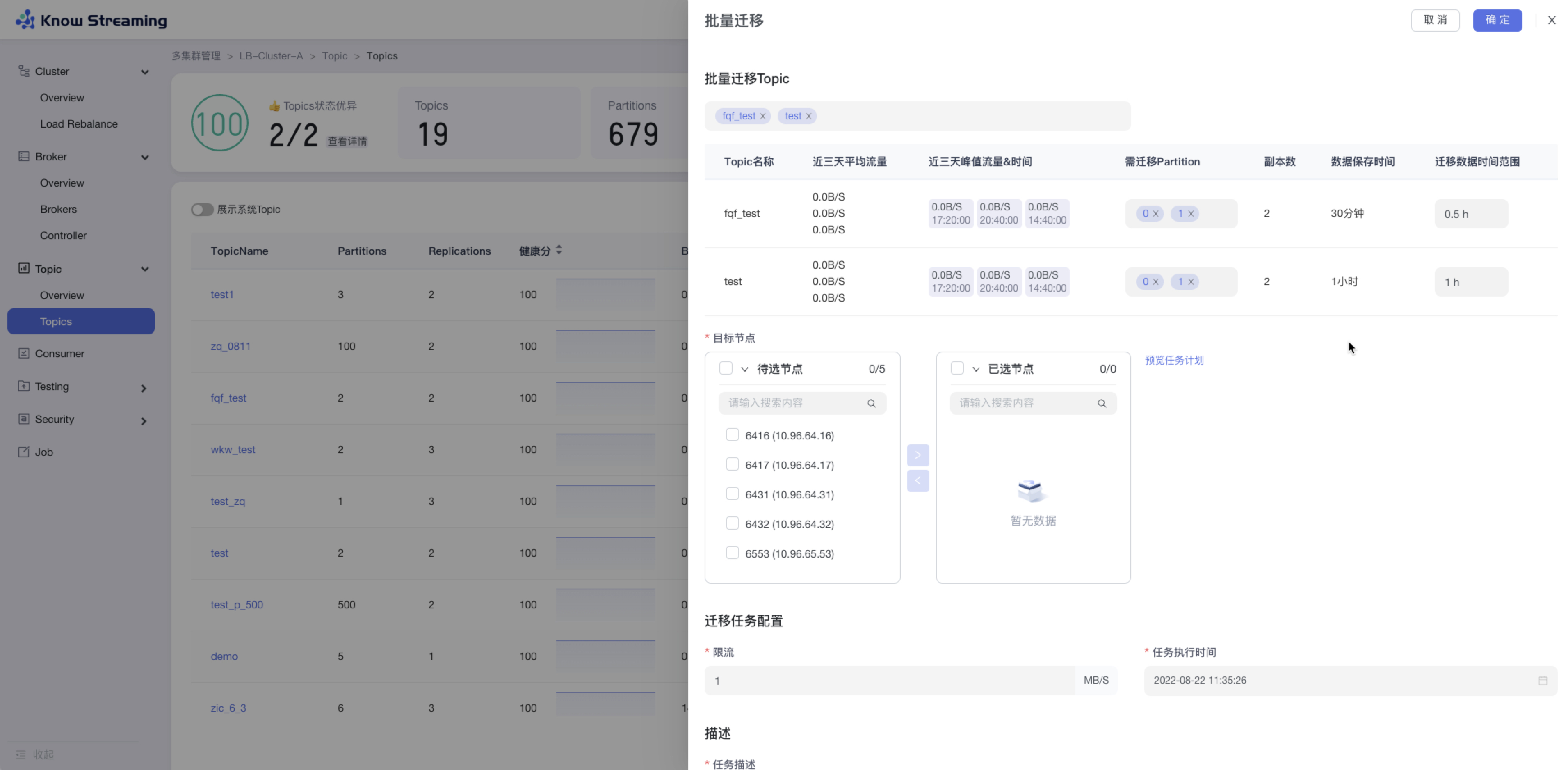

-- 增加 Topic 批量迁移、Topic 批量扩缩副本功能

-- 增加查看系统 Topic 功能

-- 优化 Partition 分布的 GUI 展示

-- 优化 Topic Message 数据采样

-- 删除 Topic 过期概念

-- 删除 Topic 申请配额功能

-

-**5、Consumer 管理**

-

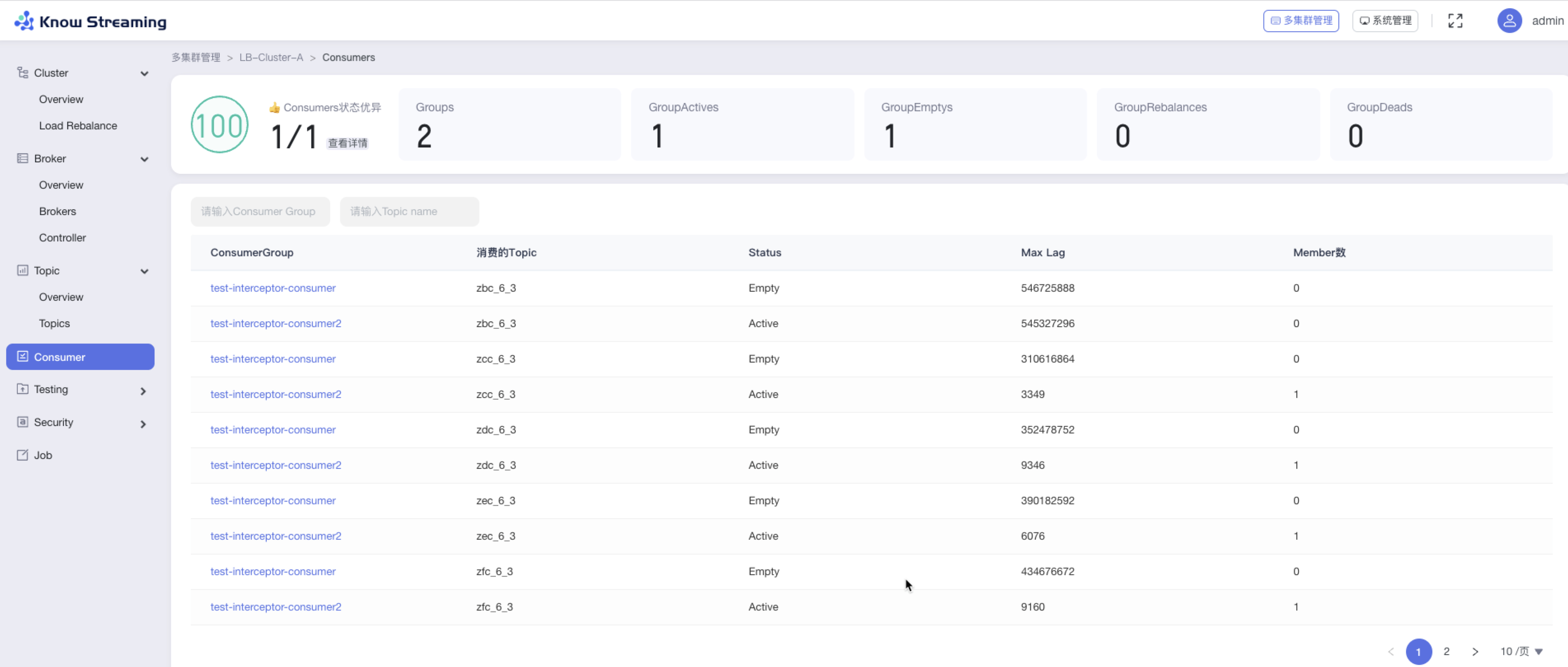

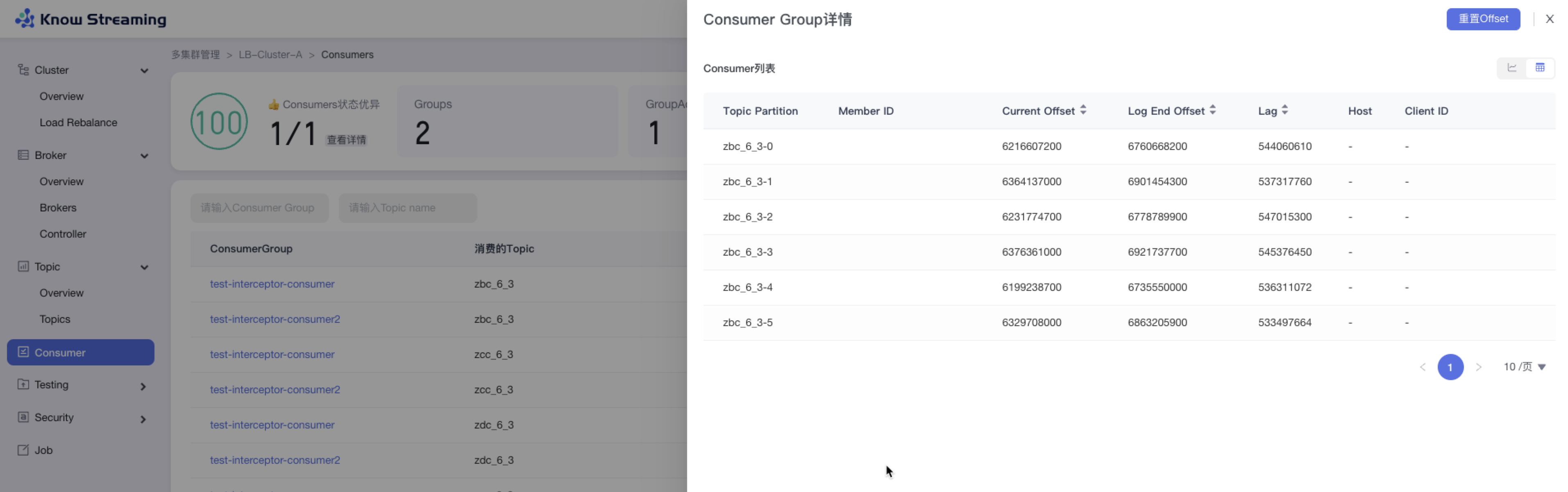

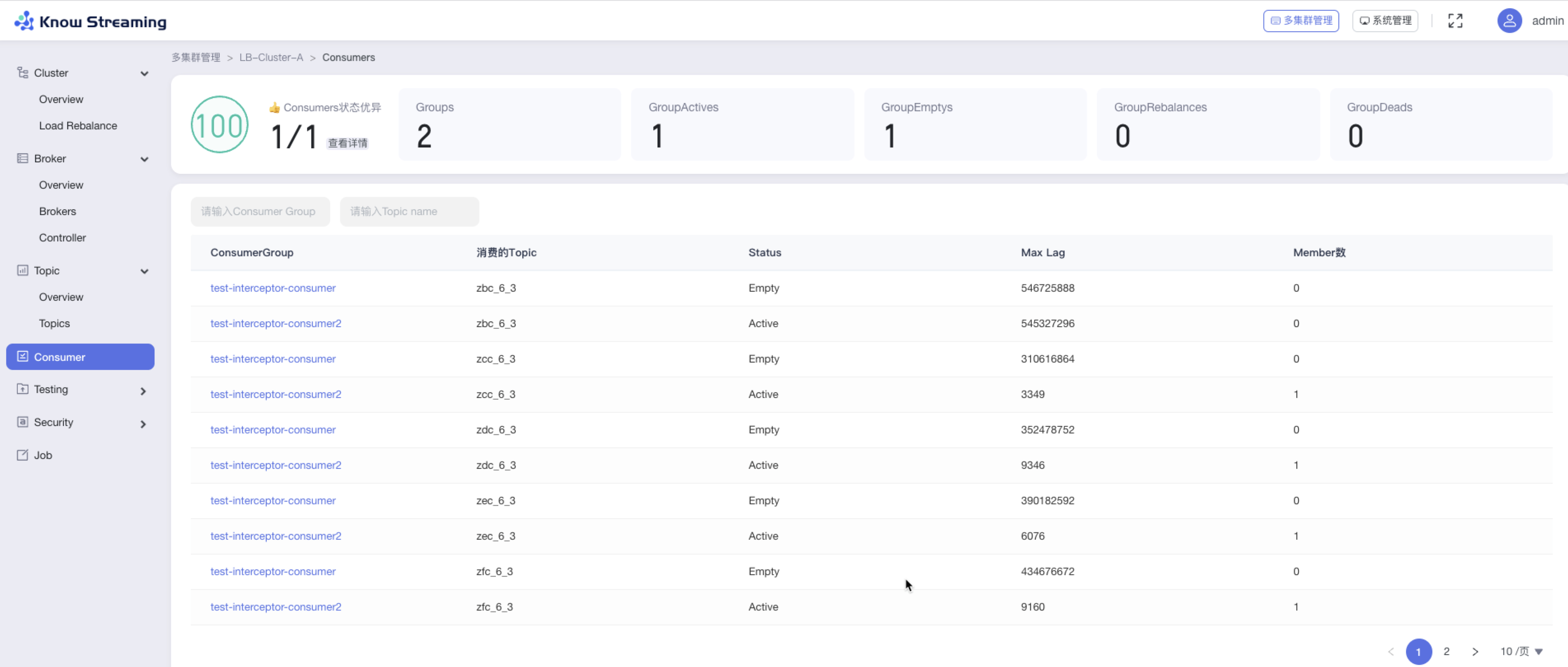

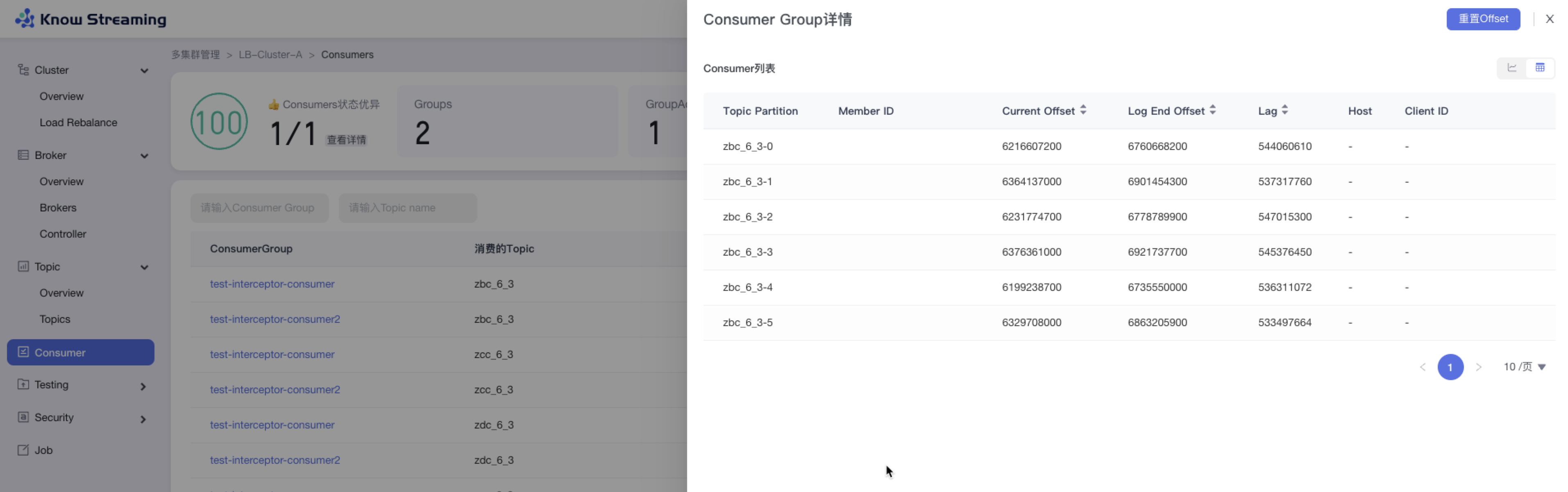

-- 优化了 ConsumerGroup 展示形式,增加 Consumer Lag 的 GUI 展示

-

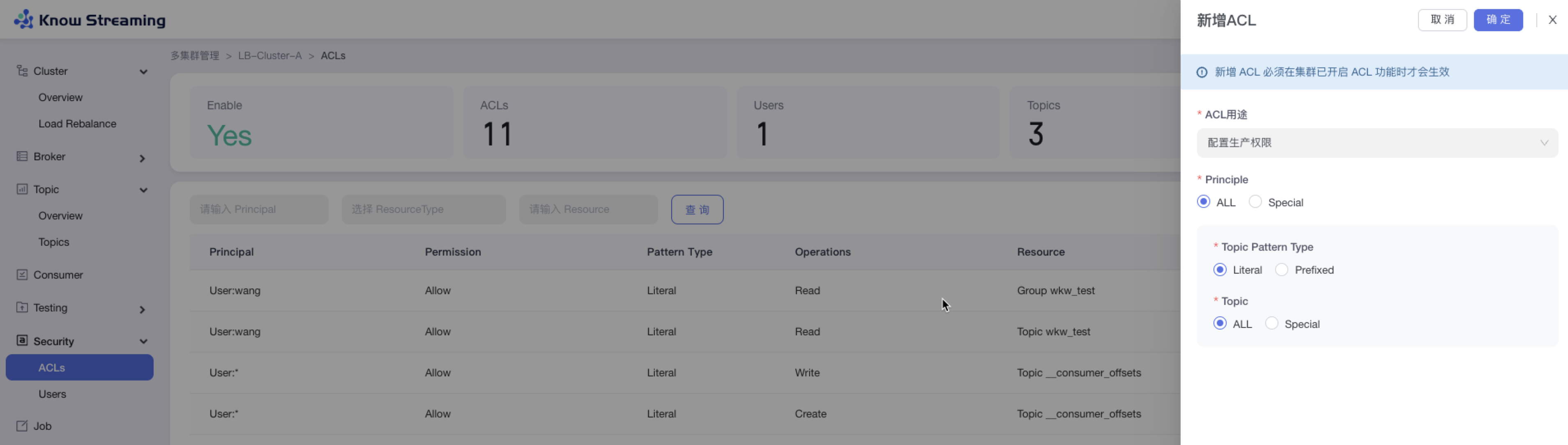

-**6、ACL 管理**

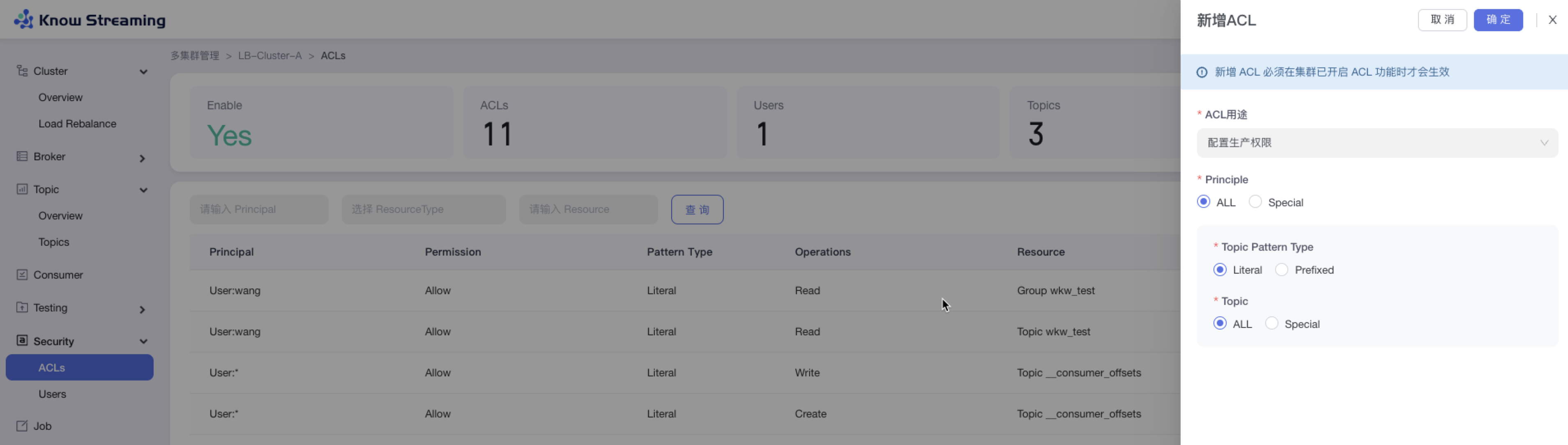

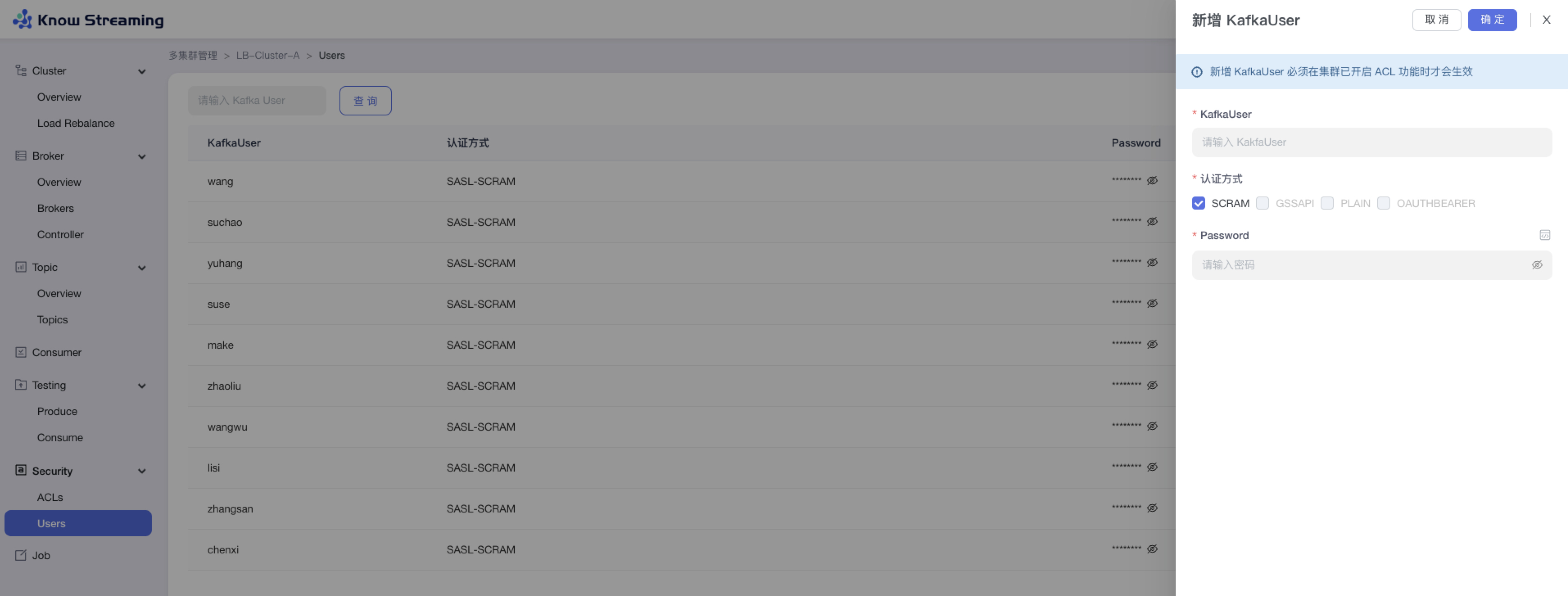

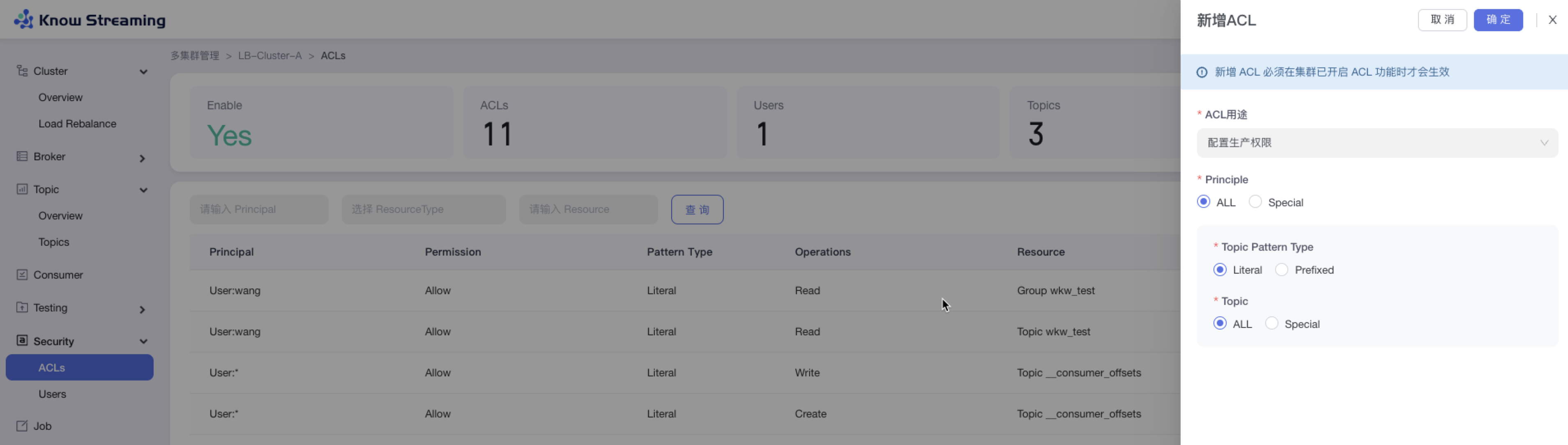

-

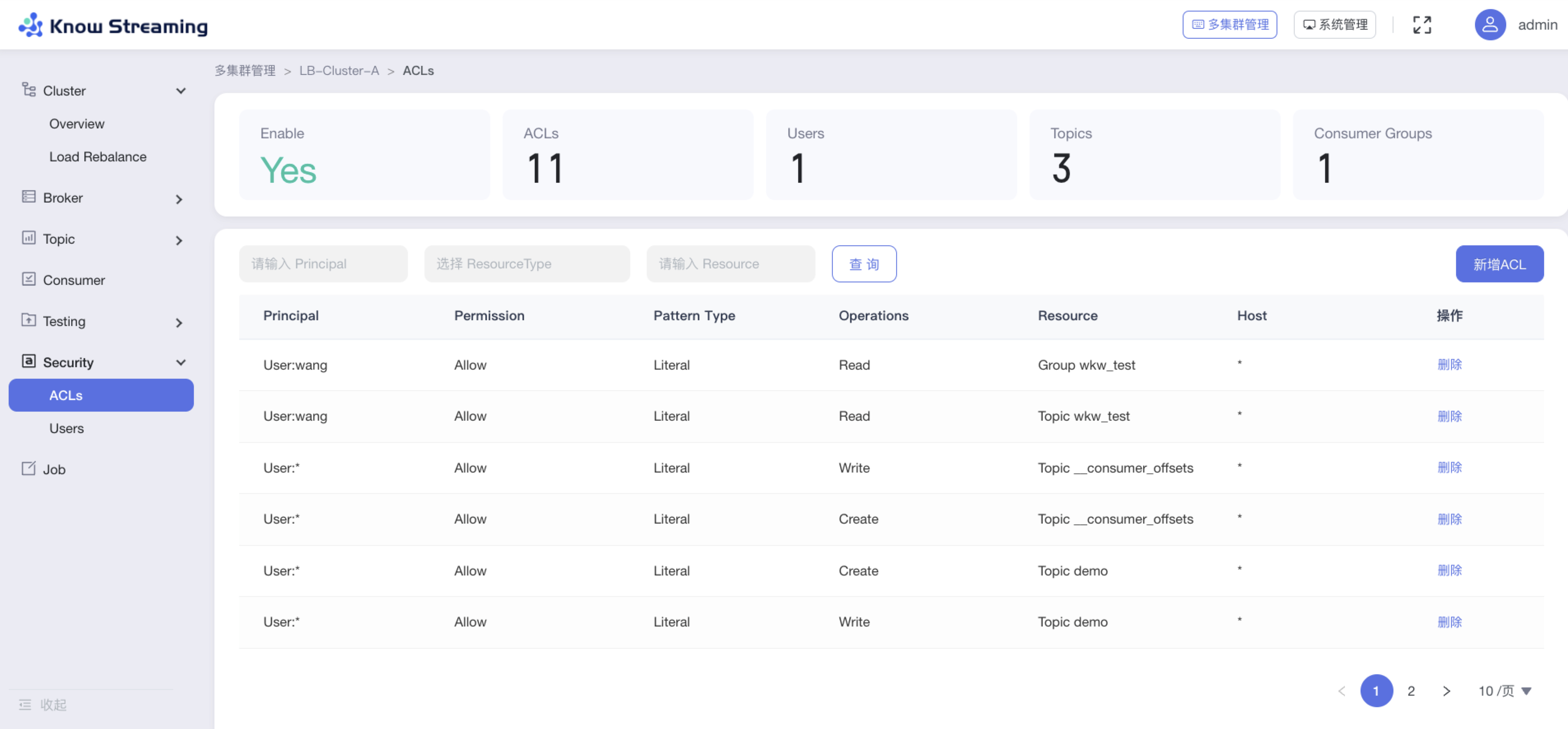

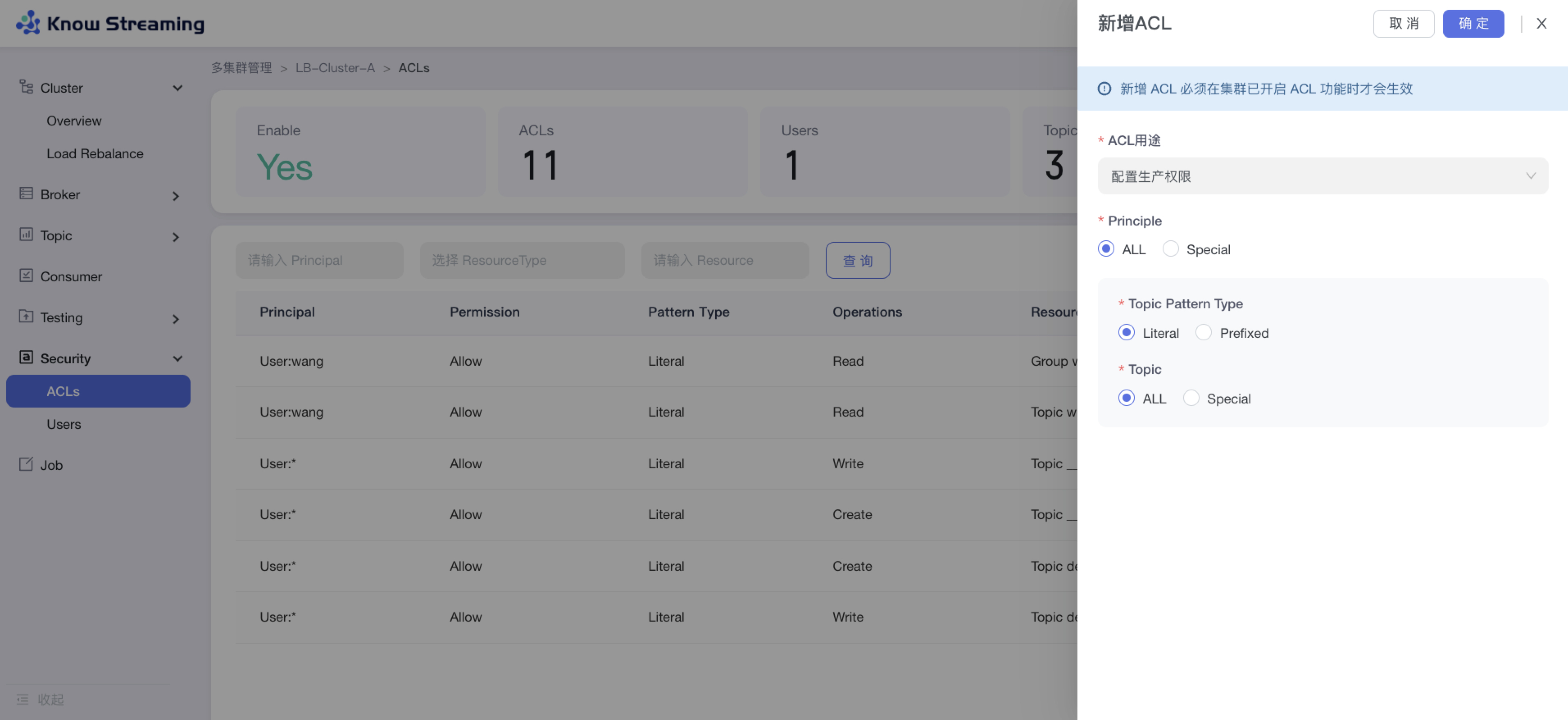

-- 增加原生 ACL GUI 配置功能,可配置生产、消费、自定义多种组合权限

-- 增加 KafkaUser 功能,可自定义新增 KafkaUser

-

-**7、消息测试(企业版)**

-

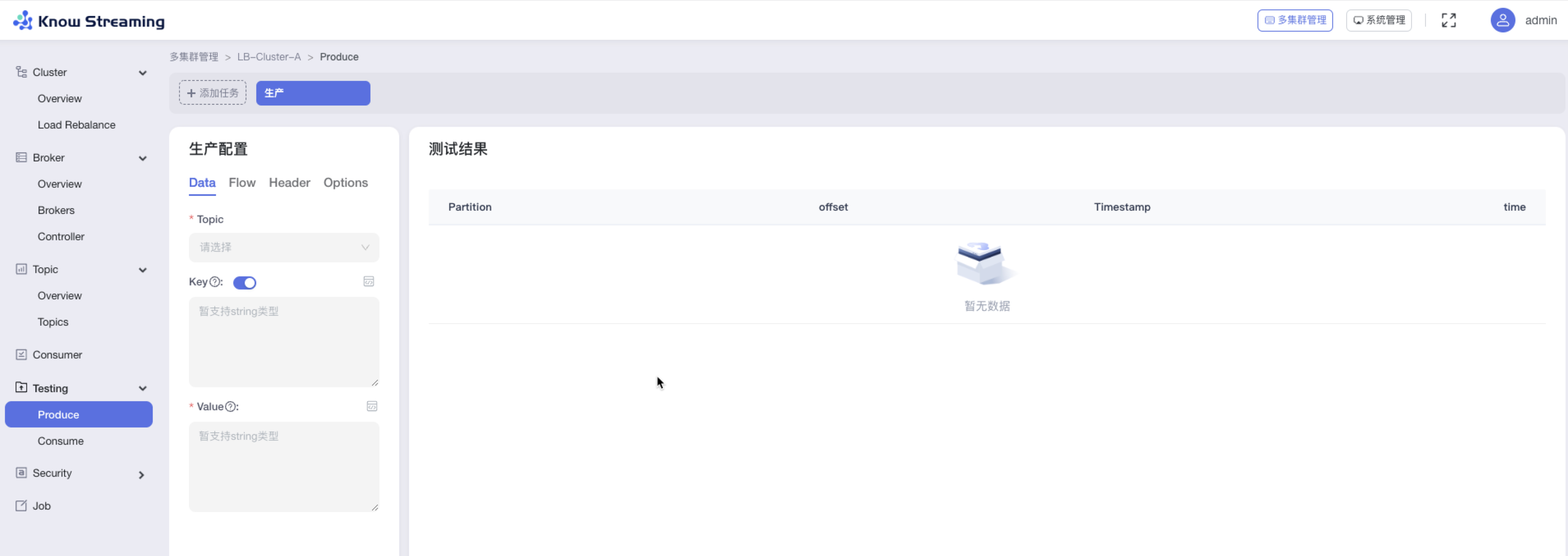

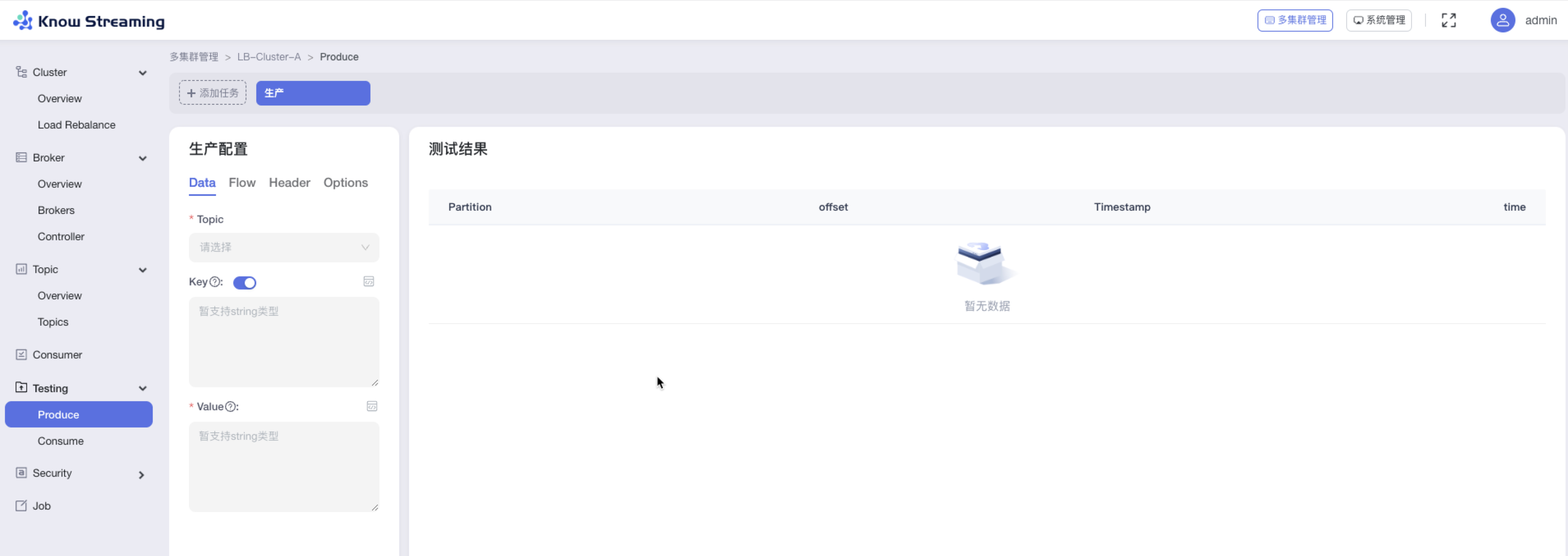

-- 增加生产者消息模拟器,支持 Data、Flow、Header、Options 自定义配置(企业版)

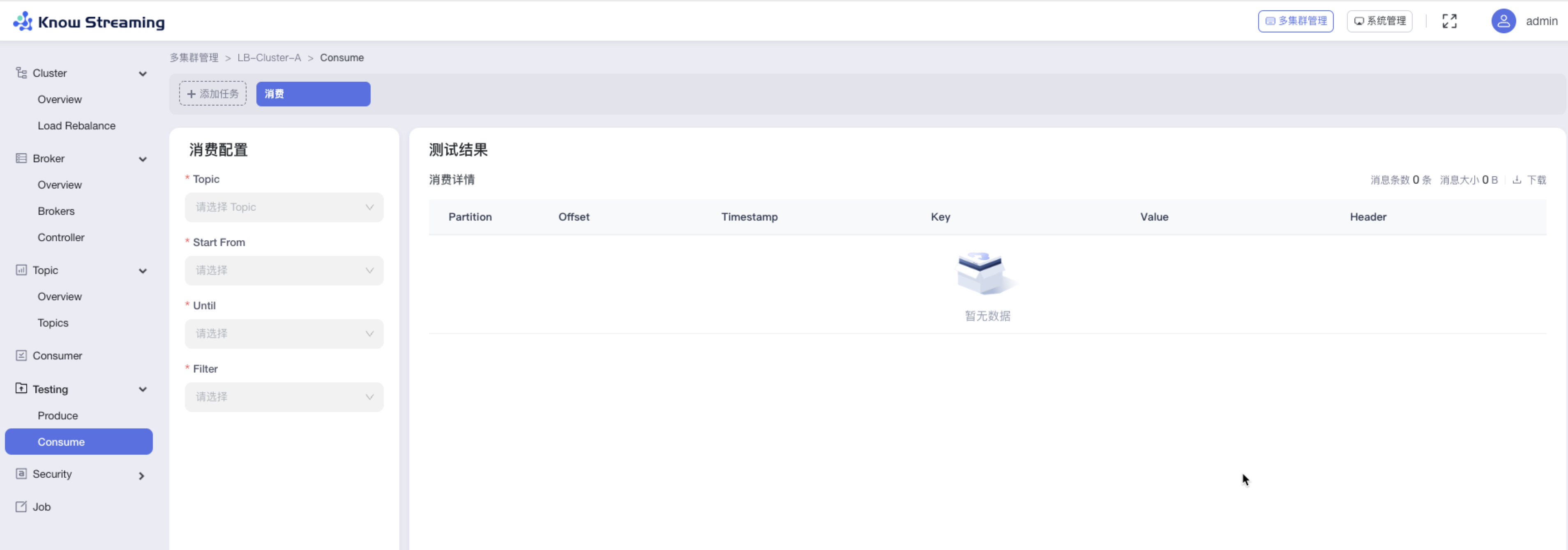

-- 增加消费者消息模拟器,支持 Data、Flow、Header、Options 自定义配置(企业版)

-

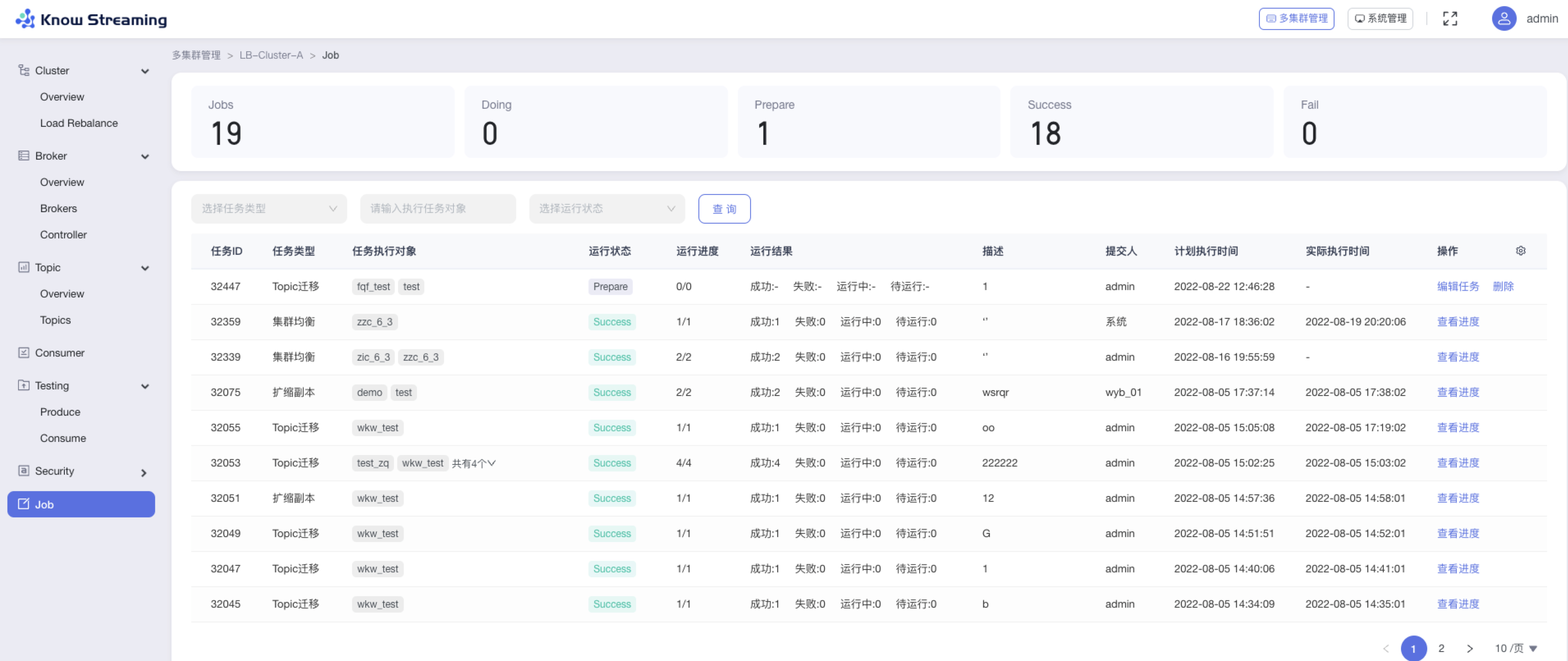

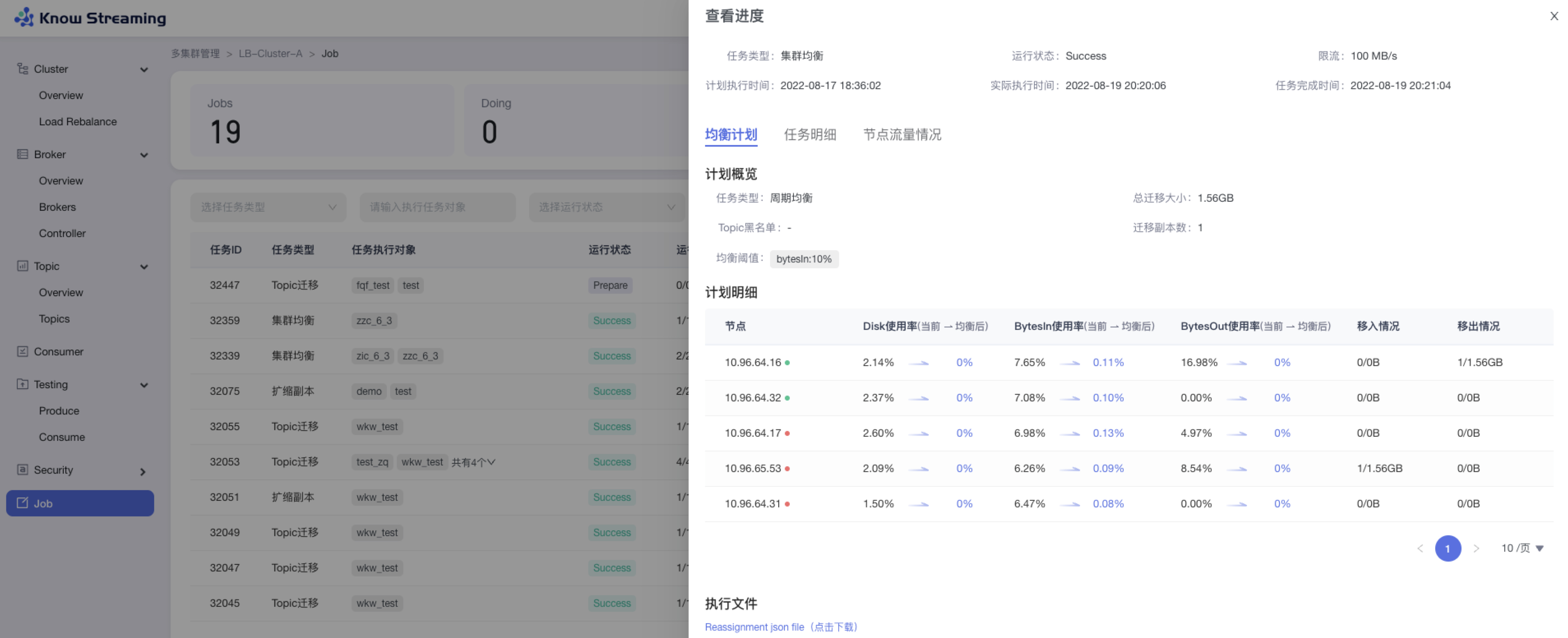

-**8、Job**

-

-- 优化 Job 模块,支持任务进度管理

-

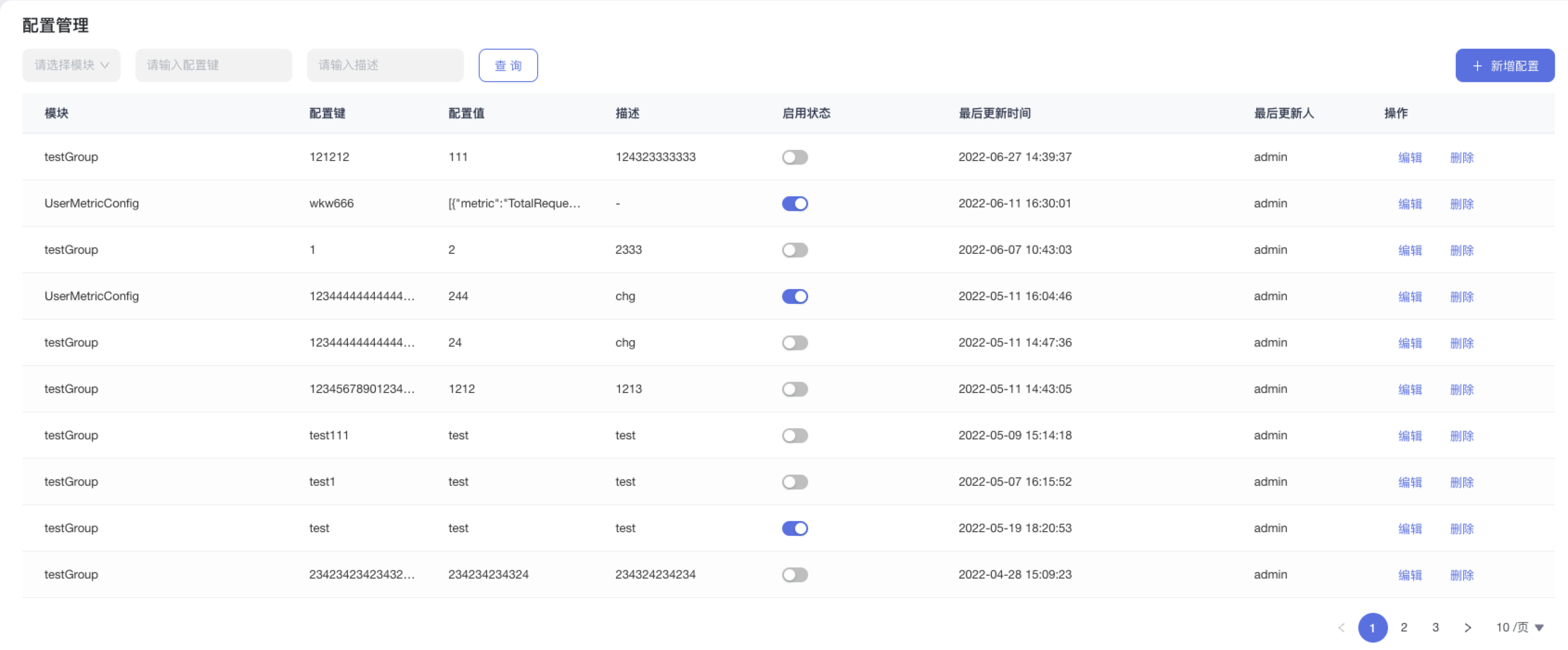

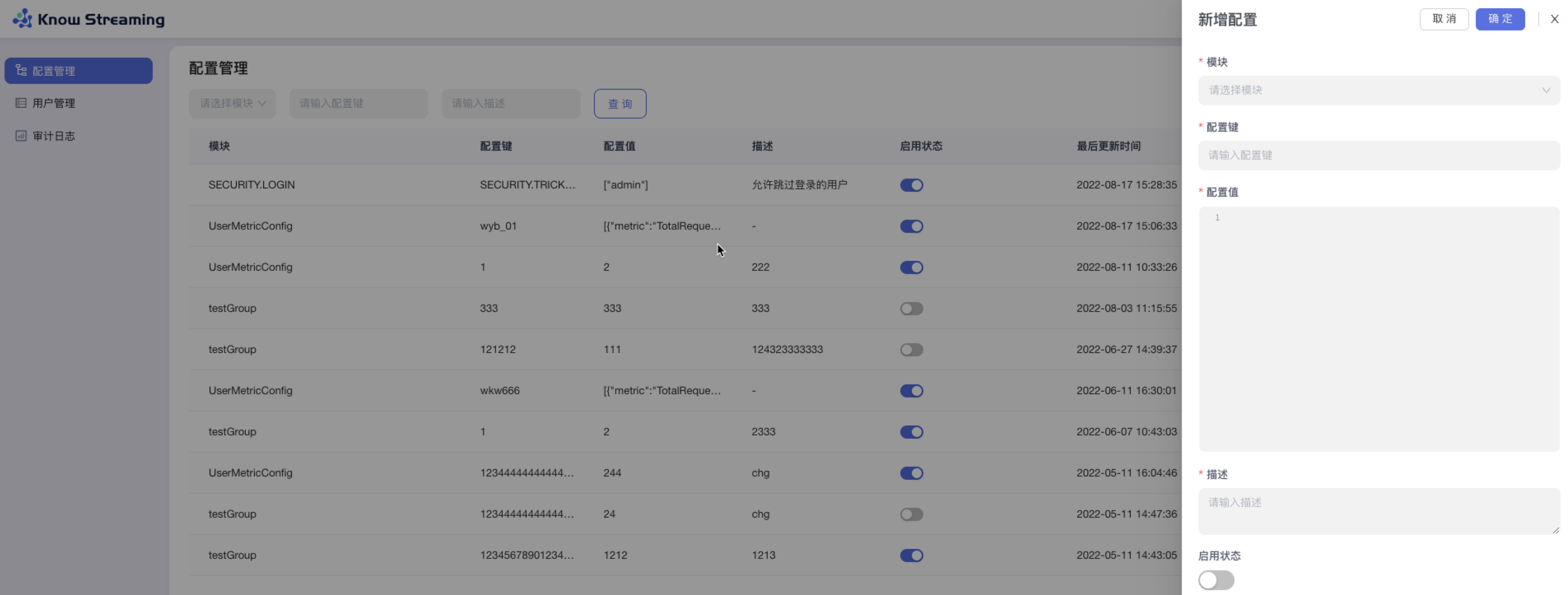

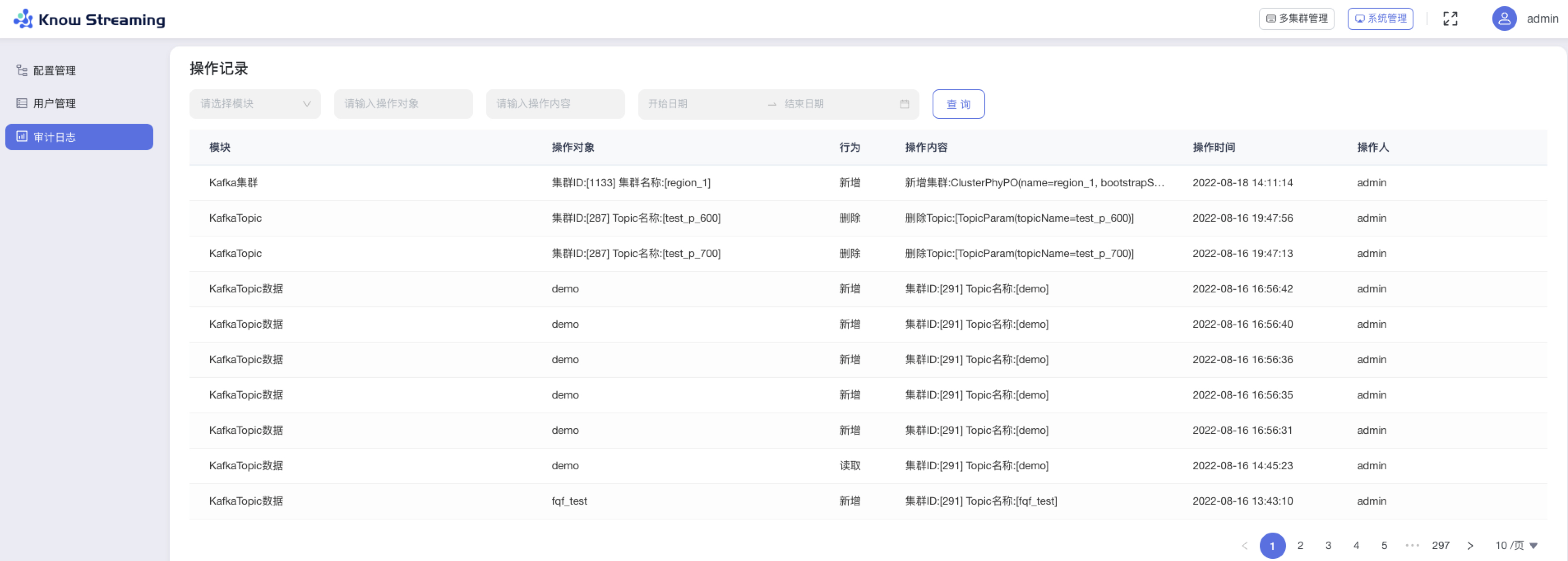

-**9、系统管理**

-

-- 优化用户、角色管理体系,支持自定义角色配置页面及操作权限

-- 优化审计日志信息

-- 删除多租户体系

-- 删除工单流程

-

----

-

-## v2.6.0

-

-版本上线时间:2022-01-24

-

-### 能力提升

-- 增加简单回退工具类

-

-### 体验优化

-- 补充周期任务说明文档

-- 补充集群安装部署使用说明文档

-- 升级Swagger、SpringFramework、SpringBoot、EChats版本

-- 优化Task模块的日志输出

-- 优化corn表达式解析失败后退出无任何日志提示问题

-- Ldap用户接入时,增加部门及邮箱信息等

-- 对Jmx模块,增加连接失败后的回退机制及错误日志优化

-- 增加线程池、客户端池可配置

-- 删除无用的jmx_prometheus_javaagent-0.14.0.jar

-- 优化迁移任务名称

-- 优化创建Region时,Region容量信息不能立即被更新问题

-- 引入lombok

-- 更新视频教程

-- 优化kcm_script.sh脚本中的LogiKM地址为可通过程序传入

-- 第三方接口及网关接口,增加是否跳过登录的开关

-- extends模块相关配置调整为非必须在application.yml中配置

-

-### bug修复

-- 修复批量往DB写入空指标数组时报SQL语法异常的问题

-- 修复网关增加配置及修改配置时,version不变化问题

-- 修复集群列表页,提示框遮挡问题

-- 修复对高版本Broker元信息协议解析失败的问题

-- 修复Dockerfile执行时提示缺少application.yml文件的问题

-- 修复逻辑集群更新时,会报空指针的问题

-

-

-## v2.5.0

-

-版本上线时间:2021-07-10

-

-### 体验优化

-- 更改产品名为LogiKM

-- 更新产品图标

-

-

-## v2.4.1+

-

-版本上线时间:2021-05-21

-

-### 能力提升

-- 增加直接增加权限和配额的接口(v2.4.1)

-- 增加接口调用可绕过登录的功能(v2.4.1)

-

-### 体验优化

-- Tomcat 版本提升至8.5.66(v2.4.2)

-- op接口优化,拆分util接口为topic、leader两类接口(v2.4.1)

-- 简化Gateway配置的Key长度(v2.4.1)

-

-### bug修复

-- 修复页面展示版本错误问题(v2.4.2)

-

-

-## v2.4.0

-

-版本上线时间:2021-05-18

-

-

-### 能力提升

-

-- 增加App与Topic自动化审批开关

-- Broker元信息中增加Rack信息

-- 升级MySQL 驱动,支持MySQL 8+

-- 增加操作记录查询界面

-

-### 体验优化

-

-- FAQ告警组说明优化

-- 用户手册共享及 独享集群概念优化

-- 用户管理界面,前端限制用户删除自己

-

-### bug修复

-

-- 修复op-util类中创建Topic失败的接口

-- 周期同步Topic到DB的任务修复,将Topic列表查询从缓存调整为直接查DB

-- 应用下线审批失败的功能修复,将权限为0(无权限)的数据进行过滤

-- 修复登录及权限绕过的漏洞

-- 修复研发角色展示接入集群、暂停监控等按钮的问题

-

-

-## v2.3.0

-

-版本上线时间:2021-02-08

-

-

-### 能力提升

-

-- 新增支持docker化部署

-- 可指定Broker作为候选controller

-- 可新增并管理网关配置

-- 可获取消费组状态

-- 增加集群的JMX认证

-

-### 体验优化

-

-- 优化编辑用户角色、修改密码的流程

-- 新增consumerID的搜索功能

-- 优化“Topic连接信息”、“消费组重置消费偏移”、“修改Topic保存时间”的文案提示

-- 在相应位置增加《资源申请文档》链接

-

-### bug修复

-

-- 修复Broker监控图表时间轴展示错误的问题

-- 修复创建夜莺监控告警规则时,使用的告警周期的单位不正确的问题

-

-

-

-## v2.2.0

-

-版本上线时间:2021-01-25

-

-

-

-### 能力提升

-

-- 优化工单批量操作流程

-- 增加获取Topic75分位/99分位的实时耗时数据

-- 增加定时任务,可将无主未落DB的Topic定期写入DB

-

-### 体验优化

-

-- 在相应位置增加《集群接入文档》链接

-- 优化物理集群、逻辑集群含义

-- 在Topic详情页、Topic扩分区操作弹窗增加展示Topic所属Region的信息

-- 优化Topic审批时,Topic数据保存时间的配置流程

-- 优化Topic/应用申请、审批时的错误提示文案

-- 优化Topic数据采样的操作项文案

-- 优化运维人员删除Topic时的提示文案

-- 优化运维人员删除Region的删除逻辑与提示文案

-- 优化运维人员删除逻辑集群的提示文案

-- 优化上传集群配置文件时的文件类型限制条件

-

-### bug修复

-

-- 修复填写应用名称时校验特殊字符出错的问题

-- 修复普通用户越权访问应用详情的问题

-- 修复由于Kafka版本升级,导致的数据压缩格式无法获取的问题

-- 修复删除逻辑集群或Topic之后,界面依旧展示的问题

-- 修复进行Leader rebalance操作时执行结果重复提示的问题

-

-

-## v2.1.0

-

-版本上线时间:2020-12-19

-

-

-

-### 体验优化

-

-- 优化页面加载时的背景样式

-- 优化普通用户申请Topic权限的流程

-- 优化Topic申请配额、申请分区的权限限制

-- 优化取消Topic权限的文案提示

-- 优化申请配额表单的表单项名称

-- 优化重置消费偏移的操作流程

-- 优化创建Topic迁移任务的表单内容

-- 优化Topic扩分区操作的弹窗界面样式

-- 优化集群Broker监控可视化图表样式

-- 优化创建逻辑集群的表单内容

-- 优化集群安全协议的提示文案

-

-### bug修复

-

-- 修复偶发性重置消费偏移失败的问题

-

-

-

-

diff --git a/bin/init_es_template.sh b/bin/init_es_template.sh

deleted file mode 100644

index e570d285..00000000

--- a/bin/init_es_template.sh

+++ /dev/null

@@ -1,1036 +0,0 @@

-esaddr=127.0.0.1

-port=8060

-curl -s --connect-timeout 10 -o /dev/null http://${esaddr}:${port}/_cat/nodes >/dev/null 2>&1

-if [ "$?" != "0" ];then

- echo "Elasticserach 访问失败, 请安装完后检查并重新执行该脚本 "

- exit

-fi

-

-curl -s --connect-timeout 10 -o /dev/null -X POST -H 'cache-control: no-cache' -H 'content-type: application/json' http://${esaddr}:${port}/_template/ks_kafka_broker_metric -d '{

- "order" : 10,

- "index_patterns" : [

- "ks_kafka_broker_metric*"

- ],

- "settings" : {

- "index" : {

- "number_of_shards" : "2"

- }

- },

- "mappings" : {

- "properties" : {

- "brokerId" : {

- "type" : "long"

- },

- "routingValue" : {

- "type" : "text",

- "fields" : {

- "keyword" : {

- "ignore_above" : 256,

- "type" : "keyword"

- }

- }

- },

- "clusterPhyId" : {

- "type" : "long"

- },

- "metrics" : {

- "properties" : {

- "NetworkProcessorAvgIdle" : {

- "type" : "float"

- },

- "UnderReplicatedPartitions" : {

- "type" : "float"

- },

- "BytesIn_min_15" : {

- "type" : "float"

- },

- "HealthCheckTotal" : {

- "type" : "float"

- },

- "RequestHandlerAvgIdle" : {

- "type" : "float"

- },

- "connectionsCount" : {

- "type" : "float"

- },

- "BytesIn_min_5" : {

- "type" : "float"

- },

- "HealthScore" : {

- "type" : "float"

- },

- "BytesOut" : {

- "type" : "float"

- },

- "BytesOut_min_15" : {

- "type" : "float"

- },

- "BytesIn" : {

- "type" : "float"

- },

- "BytesOut_min_5" : {

- "type" : "float"

- },

- "TotalRequestQueueSize" : {

- "type" : "float"

- },

- "MessagesIn" : {

- "type" : "float"

- },

- "TotalProduceRequests" : {

- "type" : "float"

- },

- "HealthCheckPassed" : {

- "type" : "float"

- },

- "TotalResponseQueueSize" : {

- "type" : "float"

- }

- }

- },

- "key" : {

- "type" : "text",

- "fields" : {

- "keyword" : {

- "ignore_above" : 256,

- "type" : "keyword"

- }

- }

- },

- "timestamp" : {

- "format" : "yyyy-MM-dd HH:mm:ss Z||yyyy-MM-dd HH:mm:ss||yyyy-MM-dd HH:mm:ss.SSS Z||yyyy-MM-dd HH:mm:ss.SSS||yyyy-MM-dd HH:mm:ss,SSS||yyyy/MM/dd HH:mm:ss||yyyy-MM-dd HH:mm:ss,SSS Z||yyyy/MM/dd HH:mm:ss,SSS Z||epoch_millis",

- "index" : true,

- "type" : "date",

- "doc_values" : true

- }

- }

- },

- "aliases" : { }

- }'

-

-curl -s -o /dev/null -X POST -H 'cache-control: no-cache' -H 'content-type: application/json' http://${esaddr}:${port}/_template/ks_kafka_cluster_metric -d '{

- "order" : 10,

- "index_patterns" : [

- "ks_kafka_cluster_metric*"

- ],

- "settings" : {

- "index" : {

- "number_of_shards" : "2"

- }

- },

- "mappings" : {

- "properties" : {

- "routingValue" : {

- "type" : "text",

- "fields" : {

- "keyword" : {

- "ignore_above" : 256,

- "type" : "keyword"

- }

- }

- },

- "clusterPhyId" : {

- "type" : "long"

- },

- "metrics" : {

- "properties" : {

- "Connections" : {

- "type" : "double"

- },

- "BytesIn_min_15" : {

- "type" : "double"

- },

- "PartitionURP" : {

- "type" : "double"

- },

- "HealthScore_Topics" : {

- "type" : "double"

- },

- "EventQueueSize" : {

- "type" : "double"

- },

- "ActiveControllerCount" : {

- "type" : "double"

- },

- "GroupDeads" : {

- "type" : "double"

- },

- "BytesIn_min_5" : {

- "type" : "double"

- },

- "HealthCheckTotal_Topics" : {

- "type" : "double"

- },

- "Partitions" : {

- "type" : "double"

- },

- "BytesOut" : {

- "type" : "double"

- },

- "Groups" : {

- "type" : "double"

- },

- "BytesOut_min_15" : {

- "type" : "double"

- },

- "TotalRequestQueueSize" : {

- "type" : "double"

- },

- "HealthCheckPassed_Groups" : {

- "type" : "double"

- },

- "TotalProduceRequests" : {

- "type" : "double"

- },

- "HealthCheckPassed" : {

- "type" : "double"

- },

- "TotalLogSize" : {

- "type" : "double"

- },

- "GroupEmptys" : {

- "type" : "double"

- },

- "PartitionNoLeader" : {

- "type" : "double"

- },

- "HealthScore_Brokers" : {

- "type" : "double"

- },

- "Messages" : {

- "type" : "double"

- },

- "Topics" : {

- "type" : "double"

- },

- "PartitionMinISR_E" : {

- "type" : "double"

- },

- "HealthCheckTotal" : {

- "type" : "double"

- },

- "Brokers" : {

- "type" : "double"

- },

- "Replicas" : {

- "type" : "double"

- },

- "HealthCheckTotal_Groups" : {

- "type" : "double"

- },

- "GroupRebalances" : {

- "type" : "double"

- },

- "MessageIn" : {

- "type" : "double"

- },

- "HealthScore" : {

- "type" : "double"

- },

- "HealthCheckPassed_Topics" : {

- "type" : "double"

- },

- "HealthCheckTotal_Brokers" : {

- "type" : "double"

- },

- "PartitionMinISR_S" : {

- "type" : "double"

- },

- "BytesIn" : {

- "type" : "double"

- },

- "BytesOut_min_5" : {

- "type" : "double"

- },

- "GroupActives" : {

- "type" : "double"

- },

- "MessagesIn" : {

- "type" : "double"

- },

- "GroupReBalances" : {

- "type" : "double"

- },

- "HealthCheckPassed_Brokers" : {

- "type" : "double"

- },

- "HealthScore_Groups" : {

- "type" : "double"

- },

- "TotalResponseQueueSize" : {

- "type" : "double"

- },

- "Zookeepers" : {

- "type" : "double"

- },

- "LeaderMessages" : {

- "type" : "double"

- },

- "HealthScore_Cluster" : {

- "type" : "double"

- },

- "HealthCheckPassed_Cluster" : {

- "type" : "double"

- },

- "HealthCheckTotal_Cluster" : {

- "type" : "double"

- }

- }

- },

- "key" : {

- "type" : "text",

- "fields" : {

- "keyword" : {

- "ignore_above" : 256,

- "type" : "keyword"

- }

- }

- },

- "timestamp" : {

- "format" : "yyyy-MM-dd HH:mm:ss Z||yyyy-MM-dd HH:mm:ss||yyyy-MM-dd HH:mm:ss.SSS Z||yyyy-MM-dd HH:mm:ss.SSS||yyyy-MM-dd HH:mm:ss,SSS||yyyy/MM/dd HH:mm:ss||yyyy-MM-dd HH:mm:ss,SSS Z||yyyy/MM/dd HH:mm:ss,SSS Z||epoch_millis",

- "type" : "date"

- }

- }

- },

- "aliases" : { }

- }'

-

-curl -s -o /dev/null -X POST -H 'cache-control: no-cache' -H 'content-type: application/json' http://${esaddr}:${port}/_template/ks_kafka_group_metric -d '{

- "order" : 10,

- "index_patterns" : [

- "ks_kafka_group_metric*"

- ],

- "settings" : {

- "index" : {

- "number_of_shards" : "6"

- }

- },

- "mappings" : {

- "properties" : {

- "group" : {

- "type" : "keyword"

- },

- "partitionId" : {

- "type" : "long"

- },

- "routingValue" : {

- "type" : "text",

- "fields" : {

- "keyword" : {

- "ignore_above" : 256,

- "type" : "keyword"

- }

- }

- },

- "clusterPhyId" : {

- "type" : "long"

- },

- "topic" : {

- "type" : "keyword"

- },

- "metrics" : {

- "properties" : {

- "HealthScore" : {

- "type" : "float"

- },

- "Lag" : {

- "type" : "float"

- },

- "OffsetConsumed" : {

- "type" : "float"

- },

- "HealthCheckTotal" : {

- "type" : "float"

- },

- "HealthCheckPassed" : {

- "type" : "float"

- }

- }

- },

- "groupMetric" : {

- "type" : "keyword"

- },

- "key" : {

- "type" : "text",

- "fields" : {

- "keyword" : {

- "ignore_above" : 256,

- "type" : "keyword"

- }

- }

- },

- "timestamp" : {

- "format" : "yyyy-MM-dd HH:mm:ss Z||yyyy-MM-dd HH:mm:ss||yyyy-MM-dd HH:mm:ss.SSS Z||yyyy-MM-dd HH:mm:ss.SSS||yyyy-MM-dd HH:mm:ss,SSS||yyyy/MM/dd HH:mm:ss||yyyy-MM-dd HH:mm:ss,SSS Z||yyyy/MM/dd HH:mm:ss,SSS Z||epoch_millis",

- "index" : true,

- "type" : "date",

- "doc_values" : true

- }

- }

- },

- "aliases" : { }

- }'

-

-curl -s -o /dev/null -X POST -H 'cache-control: no-cache' -H 'content-type: application/json' http://${esaddr}:${port}/_template/ks_kafka_partition_metric -d '{

- "order" : 10,

- "index_patterns" : [

- "ks_kafka_partition_metric*"

- ],

- "settings" : {

- "index" : {

- "number_of_shards" : "6"

- }

- },

- "mappings" : {

- "properties" : {

- "brokerId" : {

- "type" : "long"

- },

- "partitionId" : {

- "type" : "long"

- },

- "routingValue" : {

- "type" : "text",

- "fields" : {

- "keyword" : {

- "ignore_above" : 256,

- "type" : "keyword"

- }

- }

- },

- "clusterPhyId" : {

- "type" : "long"

- },

- "topic" : {

- "type" : "keyword"

- },

- "metrics" : {

- "properties" : {

- "LogStartOffset" : {

- "type" : "float"

- },

- "Messages" : {

- "type" : "float"

- },

- "LogEndOffset" : {

- "type" : "float"

- }

- }

- },

- "key" : {

- "type" : "text",

- "fields" : {

- "keyword" : {

- "ignore_above" : 256,

- "type" : "keyword"

- }

- }

- },

- "timestamp" : {

- "format" : "yyyy-MM-dd HH:mm:ss Z||yyyy-MM-dd HH:mm:ss||yyyy-MM-dd HH:mm:ss.SSS Z||yyyy-MM-dd HH:mm:ss.SSS||yyyy-MM-dd HH:mm:ss,SSS||yyyy/MM/dd HH:mm:ss||yyyy-MM-dd HH:mm:ss,SSS Z||yyyy/MM/dd HH:mm:ss,SSS Z||epoch_millis",

- "index" : true,

- "type" : "date",

- "doc_values" : true

- }

- }

- },

- "aliases" : { }

- }'

-

-curl -s -o /dev/null -X POST -H 'cache-control: no-cache' -H 'content-type: application/json' http://${esaddr}:${port}/_template/ks_kafka_topic_metric -d '{

- "order" : 10,

- "index_patterns" : [

- "ks_kafka_topic_metric*"

- ],

- "settings" : {

- "index" : {

- "number_of_shards" : "6"

- }

- },

- "mappings" : {

- "properties" : {

- "brokerId" : {

- "type" : "long"

- },

- "routingValue" : {

- "type" : "text",

- "fields" : {

- "keyword" : {

- "ignore_above" : 256,

- "type" : "keyword"

- }

- }

- },

- "topic" : {

- "type" : "keyword"

- },

- "clusterPhyId" : {

- "type" : "long"

- },

- "metrics" : {

- "properties" : {

- "BytesIn_min_15" : {

- "type" : "float"

- },

- "Messages" : {

- "type" : "float"

- },

- "BytesRejected" : {

- "type" : "float"

- },

- "PartitionURP" : {

- "type" : "float"

- },

- "HealthCheckTotal" : {

- "type" : "float"

- },

- "ReplicationCount" : {

- "type" : "float"

- },

- "ReplicationBytesOut" : {

- "type" : "float"

- },

- "ReplicationBytesIn" : {

- "type" : "float"

- },

- "FailedFetchRequests" : {

- "type" : "float"

- },

- "BytesIn_min_5" : {

- "type" : "float"

- },

- "HealthScore" : {

- "type" : "float"

- },

- "LogSize" : {

- "type" : "float"

- },

- "BytesOut" : {

- "type" : "float"

- },

- "BytesOut_min_15" : {

- "type" : "float"

- },

- "FailedProduceRequests" : {

- "type" : "float"

- },

- "BytesIn" : {

- "type" : "float"

- },

- "BytesOut_min_5" : {

- "type" : "float"

- },

- "MessagesIn" : {

- "type" : "float"

- },

- "TotalProduceRequests" : {

- "type" : "float"

- },

- "HealthCheckPassed" : {

- "type" : "float"

- }

- }

- },

- "brokerAgg" : {

- "type" : "keyword"

- },

- "key" : {

- "type" : "text",

- "fields" : {

- "keyword" : {

- "ignore_above" : 256,

- "type" : "keyword"

- }

- }

- },

- "timestamp" : {

- "format" : "yyyy-MM-dd HH:mm:ss Z||yyyy-MM-dd HH:mm:ss||yyyy-MM-dd HH:mm:ss.SSS Z||yyyy-MM-dd HH:mm:ss.SSS||yyyy-MM-dd HH:mm:ss,SSS||yyyy/MM/dd HH:mm:ss||yyyy-MM-dd HH:mm:ss,SSS Z||yyyy/MM/dd HH:mm:ss,SSS Z||epoch_millis",

- "index" : true,

- "type" : "date",

- "doc_values" : true

- }

- }

- },

- "aliases" : { }

- }'

-

-curl -s -o /dev/null -X POST -H 'cache-control: no-cache' -H 'content-type: application/json' http://${SERVER_ES_ADDRESS}/_template/ks_kafka_zookeeper_metric -d '{

- "order" : 10,

- "index_patterns" : [

- "ks_kafka_zookeeper_metric*"

- ],

- "settings" : {

- "index" : {

- "number_of_shards" : "2"

- }

- },

- "mappings" : {

- "properties" : {

- "routingValue" : {

- "type" : "text",

- "fields" : {

- "keyword" : {

- "ignore_above" : 256,

- "type" : "keyword"

- }

- }

- },

- "clusterPhyId" : {

- "type" : "long"

- },

- "metrics" : {

- "properties" : {

- "AvgRequestLatency" : {

- "type" : "double"

- },

- "MinRequestLatency" : {

- "type" : "double"

- },

- "MaxRequestLatency" : {

- "type" : "double"

- },

- "OutstandingRequests" : {

- "type" : "double"

- },

- "NodeCount" : {

- "type" : "double"

- },

- "WatchCount" : {

- "type" : "double"

- },

- "NumAliveConnections" : {

- "type" : "double"

- },

- "PacketsReceived" : {

- "type" : "double"

- },

- "PacketsSent" : {

- "type" : "double"

- },

- "EphemeralsCount" : {

- "type" : "double"

- },

- "ApproximateDataSize" : {

- "type" : "double"

- },

- "OpenFileDescriptorCount" : {

- "type" : "double"

- },

- "MaxFileDescriptorCount" : {

- "type" : "double"

- }

- }

- },

- "key" : {

- "type" : "text",

- "fields" : {

- "keyword" : {

- "ignore_above" : 256,

- "type" : "keyword"

- }

- }

- },

- "timestamp" : {

- "format" : "yyyy-MM-dd HH:mm:ss Z||yyyy-MM-dd HH:mm:ss||yyyy-MM-dd HH:mm:ss.SSS Z||yyyy-MM-dd HH:mm:ss.SSS||yyyy-MM-dd HH:mm:ss,SSS||yyyy/MM/dd HH:mm:ss||yyyy-MM-dd HH:mm:ss,SSS Z||yyyy/MM/dd HH:mm:ss,SSS Z||epoch_millis",

- "type" : "date"

- }

- }

- },

- "aliases" : { }

- }'

-

-curl -s -o /dev/null -X POST -H 'cache-control: no-cache' -H 'content-type: application/json' http://${SERVER_ES_ADDRESS}/_template/ks_kafka_connect_cluster_metric -d '{

- "order" : 10,

- "index_patterns" : [

- "ks_kafka_connect_cluster_metric*"

- ],

- "settings" : {

- "index" : {

- "number_of_shards" : "2"

- }

- },

- "mappings" : {

- "properties" : {

- "connectClusterId" : {

- "type" : "long"

- },

- "routingValue" : {

- "type" : "text",

- "fields" : {

- "keyword" : {

- "ignore_above" : 256,

- "type" : "keyword"

- }

- }

- },

- "clusterPhyId" : {

- "type" : "long"

- },

- "metrics" : {

- "properties" : {

- "ConnectorCount" : {

- "type" : "float"

- },

- "TaskCount" : {

- "type" : "float"

- },

- "ConnectorStartupAttemptsTotal" : {

- "type" : "float"

- },

- "ConnectorStartupFailurePercentage" : {

- "type" : "float"

- },

- "ConnectorStartupFailureTotal" : {

- "type" : "float"

- },

- "ConnectorStartupSuccessPercentage" : {

- "type" : "float"

- },

- "ConnectorStartupSuccessTotal" : {

- "type" : "float"

- },

- "TaskStartupAttemptsTotal" : {

- "type" : "float"

- },

- "TaskStartupFailurePercentage" : {

- "type" : "float"

- },

- "TaskStartupFailureTotal" : {

- "type" : "float"

- },

- "TaskStartupSuccessPercentage" : {

- "type" : "float"

- },

- "TaskStartupSuccessTotal" : {

- "type" : "float"

- }

- }

- },

- "key" : {

- "type" : "text",

- "fields" : {

- "keyword" : {

- "ignore_above" : 256,

- "type" : "keyword"

- }

- }

- },

- "timestamp" : {

- "format" : "yyyy-MM-dd HH:mm:ss Z||yyyy-MM-dd HH:mm:ss||yyyy-MM-dd HH:mm:ss.SSS Z||yyyy-MM-dd HH:mm:ss.SSS||yyyy-MM-dd HH:mm:ss,SSS||yyyy/MM/dd HH:mm:ss||yyyy-MM-dd HH:mm:ss,SSS Z||yyyy/MM/dd HH:mm:ss,SSS Z||epoch_millis",

- "index" : true,

- "type" : "date",

- "doc_values" : true

- }

- }

- },

- "aliases" : { }

- }'

-

-curl -s -o /dev/null -X POST -H 'cache-control: no-cache' -H 'content-type: application/json' http://${SERVER_ES_ADDRESS}/_template/ks_kafka_connect_connector_metric -d '{

- "order" : 10,

- "index_patterns" : [

- "ks_kafka_connect_connector_metric*"

- ],

- "settings" : {

- "index" : {

- "number_of_shards" : "2"

- }

- },

- "mappings" : {

- "properties" : {

- "connectClusterId" : {

- "type" : "long"

- },

- "routingValue" : {

- "type" : "text",

- "fields" : {

- "keyword" : {

- "ignore_above" : 256,

- "type" : "keyword"

- }

- }

- },

- "connectorName" : {

- "type" : "keyword"

- },

- "connectorNameAndClusterId" : {

- "type" : "keyword"

- },

- "clusterPhyId" : {

- "type" : "long"

- },

- "metrics" : {

- "properties" : {

- "HealthState" : {

- "type" : "float"

- },

- "ConnectorTotalTaskCount" : {

- "type" : "float"

- },

- "HealthCheckPassed" : {

- "type" : "float"

- },

- "HealthCheckTotal" : {

- "type" : "float"

- },

- "ConnectorRunningTaskCount" : {

- "type" : "float"

- },

- "ConnectorPausedTaskCount" : {

- "type" : "float"

- },

- "ConnectorFailedTaskCount" : {

- "type" : "float"

- },

- "ConnectorUnassignedTaskCount" : {

- "type" : "float"

- },

- "BatchSizeAvg" : {

- "type" : "float"

- },

- "BatchSizeMax" : {

- "type" : "float"

- },

- "OffsetCommitAvgTimeMs" : {

- "type" : "float"

- },

- "OffsetCommitMaxTimeMs" : {

- "type" : "float"

- },

- "OffsetCommitFailurePercentage" : {

- "type" : "float"

- },

- "OffsetCommitSuccessPercentage" : {

- "type" : "float"

- },

- "PollBatchAvgTimeMs" : {

- "type" : "float"

- },

- "PollBatchMaxTimeMs" : {

- "type" : "float"

- },

- "SourceRecordActiveCount" : {

- "type" : "float"

- },

- "SourceRecordActiveCountAvg" : {

- "type" : "float"

- },

- "SourceRecordActiveCountMax" : {

- "type" : "float"

- },

- "SourceRecordPollRate" : {

- "type" : "float"

- },

- "SourceRecordPollTotal" : {

- "type" : "float"

- },

- "SourceRecordWriteRate" : {

- "type" : "float"

- },

- "SourceRecordWriteTotal" : {

- "type" : "float"

- },

- "OffsetCommitCompletionRate" : {

- "type" : "float"

- },

- "OffsetCommitCompletionTotal" : {

- "type" : "float"

- },

- "OffsetCommitSkipRate" : {

- "type" : "float"

- },

- "OffsetCommitSkipTotal" : {

- "type" : "float"

- },

- "PartitionCount" : {

- "type" : "float"

- },

- "PutBatchAvgTimeMs" : {

- "type" : "float"

- },

- "PutBatchMaxTimeMs" : {

- "type" : "float"

- },

- "SinkRecordActiveCount" : {

- "type" : "float"

- },

- "SinkRecordActiveCountAvg" : {

- "type" : "float"

- },

- "SinkRecordActiveCountMax" : {

- "type" : "float"

- },

- "SinkRecordLagMax" : {

- "type" : "float"

- },

- "SinkRecordReadRate" : {

- "type" : "float"

- },

- "SinkRecordReadTotal" : {

- "type" : "float"

- },

- "SinkRecordSendRate" : {

- "type" : "float"

- },

- "SinkRecordSendTotal" : {

- "type" : "float"

- },

- "DeadletterqueueProduceFailures" : {

- "type" : "float"

- },

- "DeadletterqueueProduceRequests" : {

- "type" : "float"

- },

- "LastErrorTimestamp" : {

- "type" : "float"

- },

- "TotalErrorsLogged" : {

- "type" : "float"

- },

- "TotalRecordErrors" : {

- "type" : "float"

- },

- "TotalRecordFailures" : {

- "type" : "float"

- },

- "TotalRecordsSkipped" : {

- "type" : "float"

- },

- "TotalRetries" : {

- "type" : "float"

- }

- }

- },

- "key" : {

- "type" : "text",

- "fields" : {

- "keyword" : {

- "ignore_above" : 256,

- "type" : "keyword"

- }

- }

- },

- "timestamp" : {

- "format" : "yyyy-MM-dd HH:mm:ss Z||yyyy-MM-dd HH:mm:ss||yyyy-MM-dd HH:mm:ss.SSS Z||yyyy-MM-dd HH:mm:ss.SSS||yyyy-MM-dd HH:mm:ss,SSS||yyyy/MM/dd HH:mm:ss||yyyy-MM-dd HH:mm:ss,SSS Z||yyyy/MM/dd HH:mm:ss,SSS Z||epoch_millis",

- "index" : true,

- "type" : "date",

- "doc_values" : true

- }

- }

- },

- "aliases" : { }

- }'

-

-curl -s -o /dev/null -X POST -H 'cache-control: no-cache' -H 'content-type: application/json' http://${SERVER_ES_ADDRESS}/_template/ks_kafka_connect_mirror_maker_metric -d '{

- "order" : 10,

- "index_patterns" : [

- "ks_kafka_connect_mirror_maker_metric*"

- ],

- "settings" : {

- "index" : {

- "number_of_shards" : "2"

- }

- },

- "mappings" : {

- "properties" : {

- "connectClusterId" : {

- "type" : "long"

- },

- "routingValue" : {

- "type" : "text",

- "fields" : {

- "keyword" : {

- "ignore_above" : 256,

- "type" : "keyword"

- }

- }

- },

- "connectorName" : {

- "type" : "keyword"

- },

- "connectorNameAndClusterId" : {

- "type" : "keyword"

- },

- "clusterPhyId" : {

- "type" : "long"

- },

- "metrics" : {

- "properties" : {

- "HealthState" : {

- "type" : "float"

- },

- "HealthCheckTotal" : {

- "type" : "float"

- },

- "ByteCount" : {

- "type" : "float"

- },

- "ByteRate" : {

- "type" : "float"

- },

- "RecordAgeMs" : {

- "type" : "float"

- },

- "RecordAgeMsAvg" : {

- "type" : "float"

- },

- "RecordAgeMsMax" : {

- "type" : "float"

- },

- "RecordAgeMsMin" : {

- "type" : "float"

- },

- "RecordCount" : {

- "type" : "float"

- },

- "RecordRate" : {

- "type" : "float"

- },

- "ReplicationLatencyMs" : {

- "type" : "float"

- },

- "ReplicationLatencyMsAvg" : {

- "type" : "float"

- },

- "ReplicationLatencyMsMax" : {

- "type" : "float"

- },

- "ReplicationLatencyMsMin" : {

- "type" : "float"

- }

- }

- },

- "key" : {

- "type" : "text",

- "fields" : {

- "keyword" : {

- "ignore_above" : 256,

- "type" : "keyword"

- }

- }

- },

- "timestamp" : {

- "format" : "yyyy-MM-dd HH:mm:ss Z||yyyy-MM-dd HH:mm:ss||yyyy-MM-dd HH:mm:ss.SSS Z||yyyy-MM-dd HH:mm:ss.SSS||yyyy-MM-dd HH:mm:ss,SSS||yyyy/MM/dd HH:mm:ss||yyyy-MM-dd HH:mm:ss,SSS Z||yyyy/MM/dd HH:mm:ss,SSS Z||epoch_millis",

- "index" : true,

- "type" : "date",

- "doc_values" : true

- }

- }

- },

- "aliases" : { }

- }'

-

-

-for i in {0..6};

-do

- logdate=_$(date -d "${i} day ago" +%Y-%m-%d)

- curl -s --connect-timeout 10 -o /dev/null -X PUT http://${esaddr}:${port}/ks_kafka_broker_metric${logdate} && \

- curl -s -o /dev/null -X PUT http://${esaddr}:${port}/ks_kafka_cluster_metric${logdate} && \

- curl -s -o /dev/null -X PUT http://${esaddr}:${port}/ks_kafka_group_metric${logdate} && \

- curl -s -o /dev/null -X PUT http://${esaddr}:${port}/ks_kafka_partition_metric${logdate} && \

- curl -s -o /dev/null -X PUT http://${esaddr}:${port}/ks_kafka_zookeeper_metric${logdate} && \

- curl -s -o /dev/null -X PUT http://${esaddr}:${port}/ks_kafka_connect_cluster_metric${logdate} && \

- curl -s -o /dev/null -X PUT http://${esaddr}:${port}/ks_kafka_connect_connector_metric${logdate} && \

- curl -s -o /dev/null -X PUT http://${esaddr}:${port}/ks_kafka_connect_mirror_maker_metric${logdate} && \

- curl -s -o /dev/null -X PUT http://${esaddr}:${port}/ks_kafka_topic_metric${logdate} || \

- exit 2

-done

diff --git a/bin/shutdown.sh b/bin/shutdown.sh

deleted file mode 100644

index c5317df8..00000000

--- a/bin/shutdown.sh

+++ /dev/null

@@ -1,16 +0,0 @@

-#!/bin/bash

-

-cd `dirname $0`/../libs

-target_dir=`pwd`

-

-pid=`ps ax | grep -i 'ks-km' | grep ${target_dir} | grep java | grep -v grep | awk '{print $1}'`

-if [ -z "$pid" ] ; then

- echo "No ks-km running."

- exit -1;

-fi

-

-echo "The ks-km (${pid}) is running..."

-

-kill ${pid}

-

-echo "Send shutdown request to ks-km (${pid}) OK"

diff --git a/bin/startup.sh b/bin/startup.sh

deleted file mode 100644

index cbde7c56..00000000

--- a/bin/startup.sh

+++ /dev/null

@@ -1,82 +0,0 @@

-error_exit ()

-{

- echo "ERROR: $1 !!"

- exit 1

-}

-

-[ ! -e "$JAVA_HOME/bin/java" ] && JAVA_HOME=$HOME/jdk/java

-[ ! -e "$JAVA_HOME/bin/java" ] && JAVA_HOME=/usr/java

-[ ! -e "$JAVA_HOME/bin/java" ] && unset JAVA_HOME

-

-if [ -z "$JAVA_HOME" ]; then

- if [ "Darwin" = "$(uname -s)" ]; then

-

- if [ -x '/usr/libexec/java_home' ] ; then

- export JAVA_HOME=`/usr/libexec/java_home`

-

- elif [ -d "/System/Library/Frameworks/JavaVM.framework/Versions/CurrentJDK/Home" ]; then

- export JAVA_HOME="/System/Library/Frameworks/JavaVM.framework/Versions/CurrentJDK/Home"

- fi

- else

- JAVA_PATH=`dirname $(readlink -f $(which javac))`

- if [ "x$JAVA_PATH" != "x" ]; then

- export JAVA_HOME=`dirname $JAVA_PATH 2>/dev/null`

- fi

- fi

- if [ -z "$JAVA_HOME" ]; then

- error_exit "Please set the JAVA_HOME variable in your environment, We need java(x64)! jdk8 or later is better!"

- fi

-fi

-

-

-

-

-export WEB_SERVER="ks-km"

-export JAVA_HOME

-export JAVA="$JAVA_HOME/bin/java"

-export BASE_DIR=`cd $(dirname $0)/..; pwd`

-export CUSTOM_SEARCH_LOCATIONS=file:${BASE_DIR}/conf/

-

-

-#===========================================================================================

-# JVM Configuration

-#===========================================================================================

-

-JAVA_OPT="${JAVA_OPT} -server -Xms2g -Xmx2g -Xmn1g -XX:MetaspaceSize=128m -XX:MaxMetaspaceSize=320m"

-JAVA_OPT="${JAVA_OPT} -XX:-OmitStackTraceInFastThrow -XX:+HeapDumpOnOutOfMemoryError -XX:HeapDumpPath=${BASE_DIR}/logs/java_heapdump.hprof"

-

-## jdk版本高的情况 有些 参数废弃了

-JAVA_MAJOR_VERSION=$($JAVA -version 2>&1 | sed -E -n 's/.* version "([0-9]*).*$/\1/p')

-if [[ "$JAVA_MAJOR_VERSION" -ge "9" ]] ; then

- JAVA_OPT="${JAVA_OPT} -Xlog:gc*:file=${BASE_DIR}/logs/km_gc.log:time,tags:filecount=10,filesize=102400"

-else

- JAVA_OPT="${JAVA_OPT} -Djava.ext.dirs=${JAVA_HOME}/jre/lib/ext:${JAVA_HOME}/lib/ext"

- JAVA_OPT="${JAVA_OPT} -Xloggc:${BASE_DIR}/logs/km_gc.log -verbose:gc -XX:+PrintGCDetails -XX:+PrintGCDateStamps -XX:+PrintGCTimeStamps -XX:+UseGCLogFileRotation -XX:NumberOfGCLogFiles=10 -XX:GCLogFileSize=100M"

-

-fi

-

-JAVA_OPT="${JAVA_OPT} -jar ${BASE_DIR}/libs/${WEB_SERVER}.jar"

-JAVA_OPT="${JAVA_OPT} --spring.config.additional-location=${CUSTOM_SEARCH_LOCATIONS}"

-JAVA_OPT="${JAVA_OPT} --logging.config=${BASE_DIR}/conf/logback-spring.xml"

-JAVA_OPT="${JAVA_OPT} --server.max-http-header-size=524288"

-

-

-

-if [ ! -d "${BASE_DIR}/logs" ]; then

- mkdir ${BASE_DIR}/logs

-fi

-

-echo "$JAVA ${JAVA_OPT}"

-

-# check the start.out log output file

-if [ ! -f "${BASE_DIR}/logs/start.out" ]; then

- touch "${BASE_DIR}/logs/start.out"

-fi

-

-# start

-echo -e "---- 启动脚本 ------\n $JAVA ${JAVA_OPT}" > ${BASE_DIR}/logs/start.out 2>&1 &

-

-

-nohup $JAVA ${JAVA_OPT} >> ${BASE_DIR}/logs/start.out 2>&1 &

-

-echo "${WEB_SERVER} is starting,you can check the ${BASE_DIR}/logs/start.out"

diff --git a/docs/contribute_guide/assets/分支管理.drawio b/docs/contribute_guide/assets/分支管理.drawio

deleted file mode 100644

index 0e7e3d37..00000000

--- a/docs/contribute_guide/assets/分支管理.drawio

+++ /dev/null

@@ -1,111 +0,0 @@

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

\ No newline at end of file

diff --git a/docs/contribute_guide/assets/分支管理.png b/docs/contribute_guide/assets/分支管理.png

deleted file mode 100644

index 867fecd4..00000000

Binary files a/docs/contribute_guide/assets/分支管理.png and /dev/null differ

diff --git a/docs/contribute_guide/assets/环境初始化.jpg b/docs/contribute_guide/assets/环境初始化.jpg

deleted file mode 100644

index 31ff5f28..00000000

Binary files a/docs/contribute_guide/assets/环境初始化.jpg and /dev/null differ

diff --git a/docs/contribute_guide/assets/申请合并.jpg b/docs/contribute_guide/assets/申请合并.jpg

deleted file mode 100644

index d02a7f50..00000000

Binary files a/docs/contribute_guide/assets/申请合并.jpg and /dev/null differ

diff --git a/docs/contribute_guide/assets/问题认领.jpg b/docs/contribute_guide/assets/问题认领.jpg

deleted file mode 100644

index 62da4728..00000000

Binary files a/docs/contribute_guide/assets/问题认领.jpg and /dev/null differ

diff --git a/docs/contribute_guide/代码规范.md b/docs/contribute_guide/代码规范.md

deleted file mode 100644

index be0bcfd2..00000000

--- a/docs/contribute_guide/代码规范.md

+++ /dev/null

@@ -1 +0,0 @@

-TODO.

\ No newline at end of file

diff --git a/docs/contribute_guide/贡献名单.md b/docs/contribute_guide/贡献名单.md

deleted file mode 100644

index 41481787..00000000

--- a/docs/contribute_guide/贡献名单.md

+++ /dev/null

@@ -1,100 +0,0 @@

-# 贡献名单

-

-- [贡献名单](#贡献名单)

- - [1、贡献者角色](#1贡献者角色)

- - [1.1、Maintainer](#11maintainer)

- - [1.2、Committer](#12committer)

- - [1.3、Contributor](#13contributor)

- - [2、贡献者名单](#2贡献者名单)

-

-

-## 1、贡献者角色

-

-KnowStreaming 开发者包含 Maintainer、Committer、Contributor 三种角色,每种角色的标准定义如下。

-

-### 1.1、Maintainer

-

-Maintainer 是对 KnowStreaming 项目的演进和发展做出显著贡献的个人。具体包含以下的标准:

-

-- 完成多个关键模块或者工程的设计与开发,是项目的核心开发人员;

-- 持续的投入和激情,能够积极参与社区、官网、issue、PR 等项目相关事项的维护;

-- 在社区中具有有目共睹的影响力,能够代表 KnowStreaming 参加重要的社区会议和活动;

-- 具有培养 Committer 和 Contributor 的意识和能力;

-

-### 1.2、Committer

-

-Committer 是具有 KnowStreaming 仓库写权限的个人,包含以下的标准:

-

-- 能够在长时间内做持续贡献 issue、PR 的个人;

-- 参与 issue 列表的维护及重要 feature 的讨论;

-- 参与 code review;

-

-### 1.3、Contributor

-

-Contributor 是对 KnowStreaming 项目有贡献的个人,标准为:

-

-- 提交过 PR 并被合并;

-

----

-

-## 2、贡献者名单

-

-开源贡献者名单(不定期更新)

-

-在名单内,但是没有收到贡献者礼品的同学,可以联系:szzdzhp001

-

-| 姓名 | Github | 角色 | 公司 |

-| ------------------- | ---------------------------------------------------------- | ----------- | -------- |

-| 张亮 | [@zhangliangboy](https://github.com/zhangliangboy) | Maintainer | 滴滴出行 |

-| 谢鹏 | [@PenceXie](https://github.com/PenceXie) | Maintainer | 滴滴出行 |

-| 赵情融 | [@zqrferrari](https://github.com/zqrferrari) | Maintainer | 滴滴出行 |

-| 石臻臻 | [@shirenchuang](https://github.com/shirenchuang) | Maintainer | 滴滴出行 |

-| 曾巧 | [@ZQKC](https://github.com/ZQKC) | Maintainer | 滴滴出行 |

-| 孙超 | [@lucasun](https://github.com/lucasun) | Maintainer | 滴滴出行 |

-| 洪华驰 | [@brodiehong](https://github.com/brodiehong) | Maintainer | 滴滴出行 |

-| 许喆 | [@potaaaaaato](https://github.com/potaaaaaato) | Committer | 滴滴出行 |

-| 郭宇航 | [@GraceWalk](https://github.com/GraceWalk) | Committer | 滴滴出行 |

-| 李伟 | [@velee](https://github.com/velee) | Committer | 滴滴出行 |

-| 张占昌 | [@zzccctv](https://github.com/zzccctv) | Committer | 滴滴出行 |

-| 王东方 | [@wangdongfang-aden](https://github.com/wangdongfang-aden) | Committer | 滴滴出行 |

-| 王耀波 | [@WYAOBO](https://github.com/WYAOBO) | Committer | 滴滴出行 |

-| 赵寅锐 | [@ZHAOYINRUI](https://github.com/ZHAOYINRUI) | Maintainer | 字节跳动 |

-| haoqi123 | [@haoqi123](https://github.com/haoqi123) | Contributor | 前程无忧 |

-| chaixiaoxue | [@chaixiaoxue](https://github.com/chaixiaoxue) | Contributor | SYNNEX |

-| 陆晗 | [@luhea](https://github.com/luhea) | Contributor | 竞技世界 |

-| Mengqi777 | [@Mengqi777](https://github.com/Mengqi777) | Contributor | 腾讯 |

-| ruanliang-hualun | [@ruanliang-hualun](https://github.com/ruanliang-hualun) | Contributor | 网易 |

-| 17hao | [@17hao](https://github.com/17hao) | Contributor | |

-| Huyueeer | [@Huyueeer](https://github.com/Huyueeer) | Contributor | INVENTEC |

-| lomodays207 | [@lomodays207](https://github.com/lomodays207) | Contributor | 建信金科 |

-| Super .Wein(星痕) | [@superspeedone](https://github.com/superspeedone) | Contributor | 韵达 |

-| Hongten | [@Hongten](https://github.com/Hongten) | Contributor | Shopee |

-| 徐正熙 | [@hyper-xx)](https://github.com/hyper-xx) | Contributor | 滴滴出行 |

-| RichardZhengkay | [@RichardZhengkay](https://github.com/RichardZhengkay) | Contributor | 趣街 |

-| 罐子里的茶 | [@gzldc](https://github.com/gzldc) | Contributor | 道富 |

-| 陈忠玉 | [@paula](https://github.com/chenzhongyu11) | Contributor | 平安产险 |

-| 杨光 | [@yaangvipguang](https://github.com/yangvipguang) | Contributor |

-| 王亚聪 | [@wangyacongi](https://github.com/wangyacongi) | Contributor |

-| Yang Jing | [@yangbajing](https://github.com/yangbajing) | Contributor | |

-| 刘新元 Liu XinYuan | [@Liu-XinYuan](https://github.com/Liu-XinYuan) | Contributor | |

-| Joker | [@LiubeyJokerQueue](https://github.com/JokerQueue) | Contributor | 丰巢 |

-| Eason Lau | [@Liubey](https://github.com/Liubey) | Contributor | |

-| hailanxin | [@hailanxin](https://github.com/hailanxin) | Contributor | |

-| Qi Zhang | [@zzzhangqi](https://github.com/zzzhangqi) | Contributor | 好雨科技 |

-| fengxsong | [@fengxsong](https://github.com/fengxsong) | Contributor | |

-| 谢晓东 | [@Strangevy](https://github.com/Strangevy) | Contributor | 花生日记 |

-| ZhaoXinlong | [@ZhaoXinlong](https://github.com/ZhaoXinlong) | Contributor | |

-| xuehaipeng | [@xuehaipeng](https://github.com/xuehaipeng) | Contributor | |

-| 孔令续 | [@mrazkong](https://github.com/mrazkong) | Contributor | |

-| pierre xiong | [@pierre94](https://github.com/pierre94) | Contributor | |

-| PengShuaixin | [@PengShuaixin](https://github.com/PengShuaixin) | Contributor | |

-| 梁壮 | [@lz](https://github.com/silent-night-no-trace) | Contributor | |

-| 张晓寅 | [@ahu0605](https://github.com/ahu0605) | Contributor | 电信数智 |

-| 黄海婷 | [@Huanghaiting](https://github.com/Huanghaiting) | Contributor | 云徙科技 |

-| 任祥德 | [@RenChauncy](https://github.com/RenChauncy) | Contributor | 探马企服 |

-| 胡圣林 | [@slhu997](https://github.com/slhu997) | Contributor | |

-| 史泽颖 | [@shizeying](https://github.com/shizeying) | Contributor | |

-| 王玉博 | [@Wyb7290](https://github.com/Wyb7290) | Committer | |

-| 伍璇 | [@Luckywustone](https://github.com/Luckywustone) | Contributor ||

-| 邓苑 | [@CatherineDY](https://github.com/CatherineDY) | Contributor ||

-| 封琼凤 | [@Luckywustone](https://github.com/fengqiongfeng) | Committer ||

diff --git a/docs/contribute_guide/贡献指南.md b/docs/contribute_guide/贡献指南.md

deleted file mode 100644

index 37cf89bc..00000000

--- a/docs/contribute_guide/贡献指南.md

+++ /dev/null

@@ -1,167 +0,0 @@

-# 贡献指南

-

-- [贡献指南](#贡献指南)

- - [1、行为准则](#1行为准则)

- - [2、仓库规范](#2仓库规范)

- - [2.1、Issue 规范](#21issue-规范)

- - [2.2、Commit-Log 规范](#22commit-log-规范)

- - [2.3、Pull-Request 规范](#23pull-request-规范)

- - [3、操作示例](#3操作示例)

- - [3.1、初始化环境](#31初始化环境)

- - [3.2、认领问题](#32认领问题)

- - [3.3、处理问题 \& 提交解决](#33处理问题--提交解决)

- - [3.4、请求合并](#34请求合并)

- - [4、常见问题](#4常见问题)

- - [4.1、如何将多个 Commit-Log 合并为一个?](#41如何将多个-commit-log-合并为一个)

-

-

----

-

-

-欢迎 👏🏻 👏🏻 👏🏻 来到 `KnowStreaming`。本文档是关于如何为 `KnowStreaming` 做出贡献的指南。如果您发现不正确或遗漏的内容, 请留下您的意见/建议。

-

-

----

-

-

-## 1、行为准则

-

-请务必阅读并遵守我们的:[行为准则](https://github.com/didi/KnowStreaming/blob/master/CODE_OF_CONDUCT.md)。

-

-

-## 2、仓库规范

-

-### 2.1、Issue 规范

-

-按要求,在 [创建Issue](https://github.com/didi/KnowStreaming/issues/new/choose) 中创建ISSUE即可。

-

-需要重点说明的是:

-- 提供出现问题的环境信息,包括使用的系统,使用的KS版本等;

-- 提供出现问题的复现方式;

-

-

-### 2.2、Commit-Log 规范

-

-`Commit-Log` 包含三部分 `Header`、`Body`、`Footer`。其中 `Header` 是必须的,格式固定,`Body` 在变更有必要详细解释时使用。

-

-

-**1、`Header` 规范**

-

-`Header` 格式为 `[Type]Message(#IssueID)`, 主要有三部分组成,分别是`Type`、`Message`、`IssueID`,

-

-- `Type`:说明这个提交是哪一个类型的,比如有 Bugfix、Feature、Optimize等;

-- `Message`:说明提交的信息,比如修复xx问题;

-- `IssueID`:该提交,关联的Issue的编号;

-

-

-实际例子:[`[Bugfix]修复新接入的集群,Controller-Host不显示的问题(#927)`](https://github.com/didi/KnowStreaming/pull/933/commits)

-

-

-

-**2、`Body` 规范**

-

-一般不需要,如果解决了较复杂问题,或者代码较多,需要 `Body` 说清楚解决的问题,解决的思路等信息。

-

----

-

-**3、实际例子**

-

-```

-[Optimize]优化 MySQL & ES 测试容器的初始化(#906)

-

-主要的变更

-1、knowstreaming/knowstreaming-manager 容器;

-2、knowstreaming/knowstreaming-mysql 容器调整为使用 mysql:5.7 容器;

-3、初始化 mysql:5.7 容器后,增加初始化 MySQL 表及数据的动作;

-

-被影响的变更:

-1、移动 km-dist/init/sql 下的MySQL初始化脚本至 km-persistence/src/main/resource/sql 下,以便项目测试时加载到所需的初始化 SQL;

-2、删除无用的 km-dist/init/template 目录;

-3、因为 km-dist/init/sql 和 km-dist/init/template 目录的调整,因此也调整 ReleaseKnowStreaming.xml 内的文件内容;

-```

-

-

-**TODO : 后续有兴趣的同学,可以考虑引入 Git 的 Hook 进行更好的 Commit-Log 的管理。**

-

-

-### 2.3、Pull-Request 规范

-

-详细见:[PULL-REQUEST 模版](../../.github/PULL_REQUEST_TEMPLATE.md)

-

-需要重点说明的是:

-

-- 任何 PR 都必须与有效 ISSUE 相关联。否则, PR 将被拒绝;

-- 一个分支只修改一件事,一个 PR 只修改一件事;

-

----

-

-

-## 3、操作示例

-

-本节主要介绍对 `KnowStreaming` 进行代码贡献时,相关的操作方式及操作命令。

-

-名词说明:

-- 主仓库:https://github.com/didi/KnowStreaming 这个仓库为主仓库。

-- 分仓库:Fork 到自己账号下的 KnowStreaming 仓库为分仓库;

-

-

-### 3.1、初始化环境

-

-1. `Fork KnowStreaming` 主仓库至自己账号下,见 https://github.com/didi/KnowStreaming 地址右上角的 `Fork` 按钮;

-2. 克隆分仓库至本地:`git clone git@github.com:xxxxxxx/KnowStreaming.git`,该仓库的简写名通常是`origin`;

-3. 添加主仓库至本地:`git remote add upstream https://github.com/didi/KnowStreaming`,`upstream`是主仓库在本地的简写名,可以随意命名,前后保持一致即可;

-4. 拉取主仓库代码:`git fetch upstream`;

-5. 拉取分仓库代码:`git fetch origin`;

-6. 将主仓库的`master`分支,拉取到本地并命名为`github_master`:`git checkout -b upstream/master`;

-

-最后,我们来看一下初始化完成之后的大致效果,具体如下图所示:

-

-

-

-至此,我们的环境就初始化好了。后续,`github_master` 分支就是主仓库的`master`分支,我们可以使用`git pull`拉取该分支的最新代码,还可以使用`git checkout -b xxx`拉取我们想要的分支。

-

-

-

-### 3.2、认领问题

-

-在文末评论说明自己要处理该问题即可,具体如下图所示:

-

-

-

-

-### 3.3、处理问题 & 提交解决

-

-本节主要介绍一下处理问题 & 提交解决过程中的分支管理,具体如下图所示:

-

-

-

-1. 切换到主分支:`git checkout github_master`;

-2. 主分支拉最新代码:`git pull`;

-3. 基于主分支拉新分支:`git checkout -b fix_928`;

-4. 提交代码,安装commit的规范进行提交,例如:`git commit -m "[Optimize]优化xxx问题(#928)"`;

-5. 提交到自己远端仓库:`git push --set-upstream origin fix_928`;

-6. `GitHub` 页面发起 `Pull Request` 请求,管理员合入主仓库。这部分详细见下一节;

-

-

-### 3.4、请求合并

-

-代码在提交到 `GitHub` 分仓库之后,就可以在 `GitHub` 的网站创建 `Pull Request`,申请将代码合入主仓库了。 `Pull Request` 具体见下图所示:

-

-

-

-

-

-[Pull Request 创建的例子](https://github.com/didi/KnowStreaming/pull/945)

-

-

-

----

-

-

-## 4、常见问题

-

-### 4.1、如何将多个 Commit-Log 合并为一个?

-

-可以使用 `git rebase -i` 命令进行解决。

-

-

diff --git a/docs/dev_guide/Task模块简介.md b/docs/dev_guide/Task模块简介.md

deleted file mode 100644

index 688e033b..00000000

--- a/docs/dev_guide/Task模块简介.md

+++ /dev/null

@@ -1,264 +0,0 @@

-# Task模块简介

-

-## 1、Task简介

-

-在 KnowStreaming 中(下面简称KS),Task模块主要是用于执行一些周期任务,包括Cluster、Broker、Topic等指标的定时采集,集群元数据定时更新至DB,集群状态的健康巡检等。在KS中,与Task模块相关的代码,我们都统一存放在km-task模块中。

-

-Task模块是基于 LogiCommon 中的Logi-Job组件实现的任务周期执行,Logi-Job 的功能类似 XXX-Job,它是 XXX-Job 在 KnowStreaming 的内嵌实现,主要用于简化 KnowStreaming 的部署。

-Logi-Job 的任务总共有两种执行模式,分别是:

-

-+ 广播模式:同一KS集群下,同一任务周期中,所有KS主机都会执行该定时任务。

-+ 抢占模式:同一KS集群下,同一任务周期中,仅有某一台KS主机会执行该任务。

-

-KS集群范围定义:连接同一个DB,且application.yml中的spring.logi-job.app-name的名称一样的KS主机为同一KS集群。

-

-## 2、使用指南

-

-Task模块基于Logi-Job的广播模式与抢占模式,分别实现了任务的抢占执行、重复执行以及均衡执行,他们之间的差别是:

-

-+ 抢占执行:同一个KS集群,同一个任务执行周期中,仅有一台KS主机执行该任务;

-+ 重复执行:同一个KS集群,同一个任务执行周期中,所有KS主机都执行该任务。比如3台KS主机,3个Kafka集群,此时每台KS主机都会去采集这3个Kafka集群的指标;

-+ 均衡执行:同一个KS集群,同一个任务执行周期中,每台KS主机仅执行该任务的一部分,所有的KS主机共同协作完成了任务。比如3台KS主机,3个Kafka集群,稳定运行情况下,每台KS主机将仅采集1个Kafka集群的指标,3台KS主机共同完成3个Kafka集群指标的采集。

-

-下面我们看一下具体例子。

-

-### 2.1、抢占模式——抢占执行

-

-功能说明:

-

-+ 同一个KS集群,同一个任务执行周期中,仅有一台KS主机执行该任务。

-

-代码例子:

-

-```java

-// 1、实现Job接口,重写excute方法;

-// 2、在类上添加@Task注解,并且配置好信息,指定为随机抢占模式;

-// 效果:KS集群中,每5秒,会有一台KS主机输出 "测试定时任务运行中";

-@Task(name = "TestJob",

- description = "测试定时任务",

- cron = "*/5 * * * * ?",

- autoRegister = true,

- consensual = ConsensualEnum.RANDOM, // 这里一定要设置为RANDOM

- timeout = 6 * 60)

-public class TestJob implements Job {

-

- @Override

- public TaskResult execute(JobContext jobContext) throws Exception {

-

- System.out.println("测试定时任务运行中");

- return new TaskResult();

-

- }

-

-}

-```

-

-

-

-### 2.2、广播模式——重复执行

-

-功能说明:

-

-+ 同一个KS集群,同一个任务执行周期中,所有KS主机都执行该任务。比如3台KS主机,3个Kafka集群,此时每台KS主机都会去重复采集这3个Kafka集群的指标。

-

-代码例子:

-

-```java

-// 1、实现Job接口,重写excute方法;

-// 2、在类上添加@Task注解,并且配置好信息,指定为广播抢占模式;

-// 效果:KS集群中,每5秒,每台KS主机都会输出 "测试定时任务运行中";

-@Task(name = "TestJob",

- description = "测试定时任务",

- cron = "*/5 * * * * ?",

- autoRegister = true,

- consensual = ConsensualEnum.BROADCAST, // 这里一定要设置为BROADCAST

- timeout = 6 * 60)

-public class TestJob implements Job {

-

- @Override

- public TaskResult execute(JobContext jobContext) throws Exception {

-

- System.out.println("测试定时任务运行中");

- return new TaskResult();

-

- }

-

-}

-```

-

-

-

-### 2.3、广播模式——均衡执行

-

-功能说明:

-

-+ 同一个KS集群,同一个任务执行周期中,每台KS主机仅执行该任务的一部分,所有的KS主机共同协作完成了任务。比如3台KS主机,3个Kafka集群,稳定运行情况下,每台KS主机将仅采集1个Kafka集群的指标,3台KS主机共同完成3个Kafka集群指标的采集。

-

-代码例子:

-

-+ 该模式有点特殊,是KS基于Logi-Job的广播模式,做的一个扩展,以下为一个使用例子:

-

-```java

-// 1、继承AbstractClusterPhyDispatchTask,实现processSubTask方法;

-// 2、在类上添加@Task注解,并且配置好信息,指定为广播模式;

-// 效果:在本样例中,每隔1分钟ks会将所有的kafka集群列表在ks集群主机内均衡拆分,每台主机会将分发到自身的Kafka集群依次执行processSubTask方法,实现KS集群的任务协同处理。

-@Task(name = "kmJobTask",

- description = "km job 模块调度执行任务",

- cron = "0 0/1 * * * ? *",

- autoRegister = true,

- consensual = ConsensualEnum.BROADCAST,

- timeout = 6 * 60)

-public class KMJobTask extends AbstractClusterPhyDispatchTask {

-

- @Autowired

- private JobService jobService;

-

- @Override

- protected TaskResult processSubTask(ClusterPhy clusterPhy, long triggerTimeUnitMs) throws Exception {

- jobService.scheduleJobByClusterId(clusterPhy.getId());

- return TaskResult.SUCCESS;

- }

-}

-```

-

-

-

-## 3、原理简介

-

-### 3.1、Task注解说明

-

-```java

-public @interface Task {

- String name() default ""; //任务名称

- String description() default ""; //任务描述

- String owner() default "system"; //拥有者

- String cron() default ""; //定时执行的时间策略

- int retryTimes() default 0; //失败以后所能重试的最大次数

- long timeout() default 0; //在超时时间里重试

- //是否自动注册任务到数据库中

- //如果设置为false,需要手动去数据库km_task表注册定时任务信息。数据库记录和@Task注解缺一不可

- boolean autoRegister() default false;

- //执行模式:广播、随机抢占

- //广播模式:同一集群下的所有服务器都会执行该定时任务

- //随机抢占模式:同一集群下随机一台服务器执行该任务

- ConsensualEnum consensual() default ConsensualEnum.RANDOM;

- }

-```

-

-### 3.2、数据库表介绍

-

-+ logi_task:记录项目中的定时任务信息,一个定时任务对应一条记录。

-+ logi_job:具体任务执行信息。

-+ logi_job_log:定时任务的执行日志。

-+ logi_worker:记录机器信息,实现集群控制。

-

-### 3.3、均衡执行简介

-

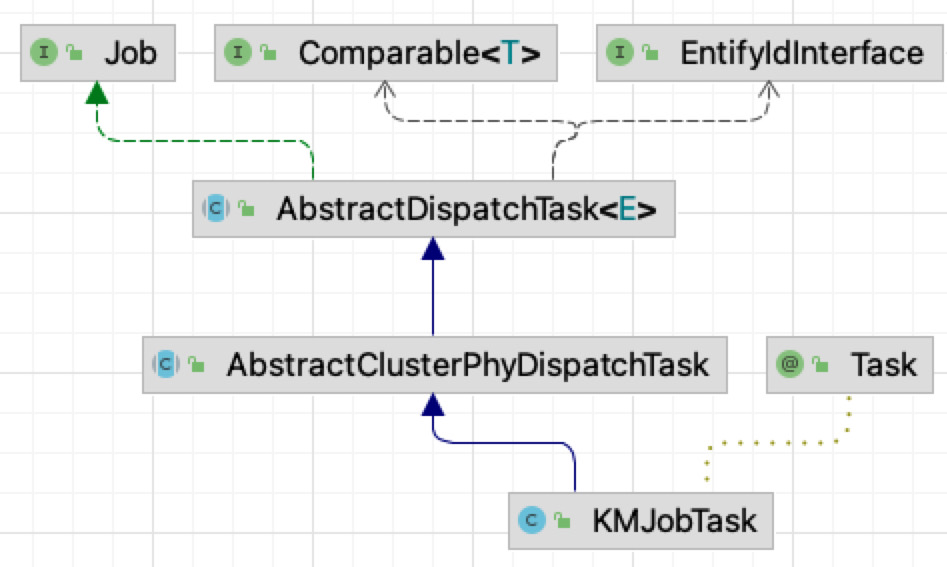

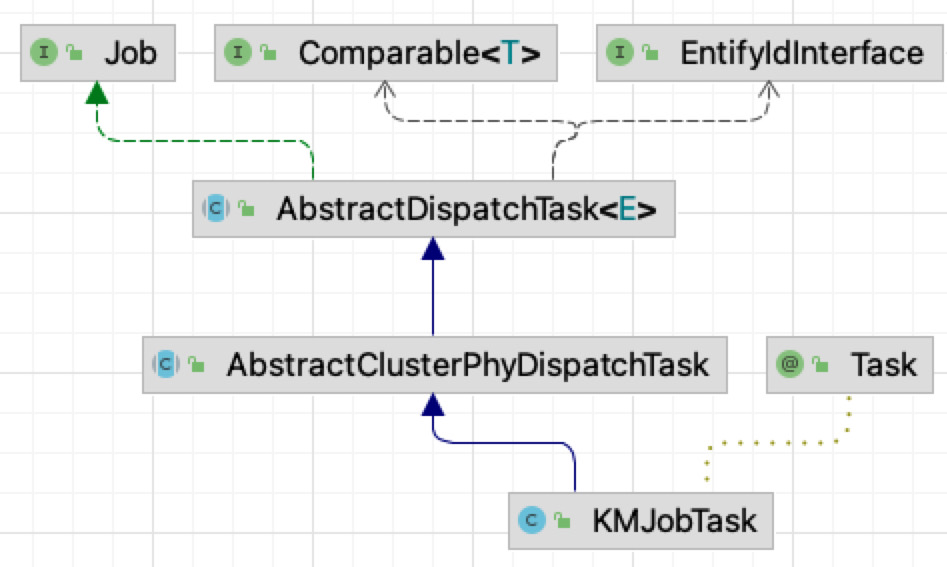

-#### 3.3.1、类关系图

-

-这里以KMJobTask为例,简单介绍KM中的定时任务实现逻辑。

-

-

-

-+ Job:使用logi组件实现定时任务,必须实现该接口。

-+ Comparable & EntufyIdInterface:比较接口,实现任务的排序逻辑。

-+ AbstractDispatchTask:实现广播模式下,任务的均衡分发。

-+ AbstractClusterPhyDispatchTask:对分发到当前服务器的集群列表进行枚举。

-+ KMJobTask:实现对单个集群的定时任务处理。

-

-#### 3.3.2、关键类代码

-

-+ **AbstractDispatchTask类**

-

-```java

-// 实现Job接口的抽象类,进行任务的负载均衡执行

-public abstract class AbstractDispatchTask implements Job {

-

- // 罗列所有的任务

- protected abstract List listAllTasks();

-

- // 执行被分配给该KS主机的任务

- protected abstract TaskResult processTask(List subTaskList, long triggerTimeUnitMs);

-

- // 被Logi-Job触发执行该方法

- // 该方法进行任务的分配

- @Override

- public TaskResult execute(JobContext jobContext) {

- try {

-

- long triggerTimeUnitMs = System.currentTimeMillis();

-

- // 获取所有的任务

- List allTaskList = this.listAllTasks();

-

- // 计算当前KS机器需要执行的任务

- List subTaskList = this.selectTask(allTaskList, jobContext.getAllWorkerCodes(), jobContext.getCurrentWorkerCode());

-

- // 进行任务处理

- return this.processTask(subTaskList, triggerTimeUnitMs);

- } catch (Exception e) {

- // ...

- }

- }

-}

-```

-

-+ **AbstractClusterPhyDispatchTask类**

-

-```java

-// 继承AbstractDispatchTask的抽象类,对Kafka集群进行负载均衡执行

-public abstract class AbstractClusterPhyDispatchTask extends AbstractDispatchTask {

-

- // 执行被分配的任务,具体由子类实现

- protected abstract TaskResult processSubTask(ClusterPhy clusterPhy, long triggerTimeUnitMs) throws Exception;

-

- // 返回所有的Kafka集群

- @Override

- public List listAllTasks() {

- return clusterPhyService.listAllClusters();

- }

-

- // 执行被分配给该KS主机的Kafka集群任务

- @Override

- public TaskResult processTask(List subTaskList, long triggerTimeUnitMs) { // ... }

-

-}

-```

-

-+ **KMJobTask类**

-

-```java

-// 加上@Task注解,并配置任务执行信息

-@Task(name = "kmJobTask",

- description = "km job 模块调度执行任务",

- cron = "0 0/1 * * * ? *",

- autoRegister = true,

- consensual = ConsensualEnum.BROADCAST,

- timeout = 6 * 60)

-// 继承AbstractClusterPhyDispatchTask类

-public class KMJobTask extends AbstractClusterPhyDispatchTask {

-

- @Autowired

- private JobService jobService;

-

- // 执行该Kafka集群的Job模块的任务

- @Override

- protected TaskResult processSubTask(ClusterPhy clusterPhy, long triggerTimeUnitMs) throws Exception {

- jobService.scheduleJobByClusterId(clusterPhy.getId());

- return TaskResult.SUCCESS;

- }

-}

-```

-

-#### 3.3.3、均衡执行总结

-

-均衡执行的实现原理总结起来就是以下几点:

-

-+ Logi-Job设置为广播模式,触发所有的KS主机执行任务;

-+ 每台KS主机,被触发执行后,按照统一的规则,对任务列表,KS集群主机列表进行排序。然后按照顺序将任务列表均衡的分配给排序后的KS集群主机。KS集群稳定运行情况下,这一步保证了每台KS主机之间分配到的任务列表不重复,不丢失。