Compare commits

1 Commits

| Author | SHA1 | Date | |

|---|---|---|---|

|

|

f8ca797f16 |

51

.github/ISSUE_TEMPLATE/bug_report.md

vendored

@@ -1,51 +0,0 @@

|

||||

---

|

||||

name: 报告Bug

|

||||

about: 报告KnowStreaming的相关Bug

|

||||

title: ''

|

||||

labels: bug

|

||||

assignees: ''

|

||||

|

||||

---

|

||||

|

||||

- [ ] 我已经在 [issues](https://github.com/didi/KnowStreaming/issues) 搜索过相关问题了,并没有重复的。

|

||||

|

||||

你是否希望来认领这个Bug。

|

||||

|

||||

「 Y / N 」

|

||||

|

||||

### 环境信息

|

||||

|

||||

* KnowStreaming version : <font size=4 color =red> xxx </font>

|

||||

* Operating System version : <font size=4 color =red> xxx </font>

|

||||

* Java version : <font size=4 color =red> xxx </font>

|

||||

|

||||

|

||||

### 重现该问题的步骤

|

||||

|

||||

1. xxx

|

||||

|

||||

|

||||

|

||||

2. xxx

|

||||

|

||||

|

||||

3. xxx

|

||||

|

||||

|

||||

|

||||

### 预期结果

|

||||

|

||||

<!-- 写下应该出现的预期结果?-->

|

||||

|

||||

### 实际结果

|

||||

|

||||

<!-- 实际发生了什么? -->

|

||||

|

||||

|

||||

---

|

||||

|

||||

如果有异常,请附上异常Trace:

|

||||

|

||||

```

|

||||

Just put your stack trace here!

|

||||

```

|

||||

8

.github/ISSUE_TEMPLATE/config.yml

vendored

@@ -1,8 +0,0 @@

|

||||

blank_issues_enabled: true

|

||||

contact_links:

|

||||

- name: 讨论问题

|

||||

url: https://github.com/didi/KnowStreaming/discussions/new

|

||||

about: 发起问题、讨论 等等

|

||||

- name: KnowStreaming官网

|

||||

url: https://knowstreaming.com/

|

||||

about: KnowStreaming website

|

||||

26

.github/ISSUE_TEMPLATE/detail_optimizing.md

vendored

@@ -1,26 +0,0 @@

|

||||

---

|

||||

name: 优化建议

|

||||

about: 相关功能优化建议

|

||||

title: ''

|

||||

labels: Optimization Suggestions

|

||||

assignees: ''

|

||||

|

||||

---

|

||||

|

||||

- [ ] 我已经在 [issues](https://github.com/didi/KnowStreaming/issues) 搜索过相关问题了,并没有重复的。

|

||||

|

||||

你是否希望来认领这个优化建议。

|

||||

|

||||

「 Y / N 」

|

||||

|

||||

### 环境信息

|

||||

|

||||

* KnowStreaming version : <font size=4 color =red> xxx </font>

|

||||

* Operating System version : <font size=4 color =red> xxx </font>

|

||||

* Java version : <font size=4 color =red> xxx </font>

|

||||

|

||||

### 需要优化的功能点

|

||||

|

||||

|

||||

### 建议如何优化

|

||||

|

||||

20

.github/ISSUE_TEMPLATE/feature_request.md

vendored

@@ -1,20 +0,0 @@

|

||||

---

|

||||

name: 提议新功能/需求

|

||||

about: 给KnowStreaming提一个功能需求

|

||||

title: ''

|

||||

labels: feature

|

||||

assignees: ''

|

||||

|

||||

---

|

||||

|

||||

- [ ] 我在 [issues](https://github.com/didi/KnowStreaming/issues) 中并未搜索到与此相关的功能需求。

|

||||

- [ ] 我在 [release note](https://github.com/didi/KnowStreaming/releases) 已经发布的版本中并没有搜到相关功能.

|

||||

|

||||

你是否希望来认领这个Feature。

|

||||

|

||||

「 Y / N 」

|

||||

|

||||

|

||||

## 这里描述需求

|

||||

<!--请尽可能的描述清楚您的需求 -->

|

||||

|

||||

12

.github/ISSUE_TEMPLATE/question.md

vendored

@@ -1,12 +0,0 @@

|

||||

---

|

||||

name: 提个问题

|

||||

about: 问KnowStreaming相关问题

|

||||

title: ''

|

||||

labels: question

|

||||

assignees: ''

|

||||

|

||||

---

|

||||

|

||||

- [ ] 我已经在 [issues](https://github.com/didi/KnowStreaming/issues) 搜索过相关问题了,并没有重复的。

|

||||

|

||||

## 在这里提出你的问题

|

||||

22

.github/PULL_REQUEST_TEMPLATE.md

vendored

@@ -1,22 +0,0 @@

|

||||

请不要在没有先创建Issue的情况下创建Pull Request。

|

||||

|

||||

## 变更的目的是什么

|

||||

|

||||

XXXXX

|

||||

|

||||

## 简短的更新日志

|

||||

|

||||

XX

|

||||

|

||||

## 验证这一变化

|

||||

|

||||

XXXX

|

||||

|

||||

请遵循此清单,以帮助我们快速轻松地整合您的贡献:

|

||||

|

||||

* [ ] 确保有针对更改提交的 Github issue(通常在您开始处理之前)。诸如拼写错误之类的琐碎更改不需要 Github issue。您的Pull Request应该只解决这个问题,而不需要进行其他更改—— 一个 PR 解决一个问题。

|

||||

* [ ] 格式化 Pull Request 标题,如[ISSUE #123] support Confluent Schema Registry。 Pull Request 中的每个提交都应该有一个有意义的主题行和正文。

|

||||

* [ ] 编写足够详细的Pull Request描述,以了解Pull Request的作用、方式和原因。

|

||||

* [ ] 编写必要的单元测试来验证您的逻辑更正。如果提交了新功能或重大更改,请记住在test 模块中添加 integration-test

|

||||

* [ ] 确保编译通过,集成测试通过

|

||||

|

||||

229

.gitignore

vendored

@@ -1,116 +1,113 @@

|

||||

### Intellij ###

|

||||

# Covers JetBrains IDEs: IntelliJ, RubyMine, PhpStorm, AppCode, PyCharm, CLion, Android Studio and Webstorm

|

||||

|

||||

*.iml

|

||||

|

||||

## Directory-based project format:

|

||||

.idea/

|

||||

# if you remove the above rule, at least ignore the following:

|

||||

|

||||

# User-specific stuff:

|

||||

# .idea/workspace.xml

|

||||

# .idea/tasks.xml

|

||||

# .idea/dictionaries

|

||||

# .idea/shelf

|

||||

|

||||

# Sensitive or high-churn files:

|

||||

.idea/dataSources.ids

|

||||

.idea/dataSources.xml

|

||||

.idea/sqlDataSources.xml

|

||||

.idea/dynamic.xml

|

||||

.idea/uiDesigner.xml

|

||||

|

||||

|

||||

# Mongo Explorer plugin:

|

||||

.idea/mongoSettings.xml

|

||||

|

||||

## File-based project format:

|

||||

*.ipr

|

||||

*.iws

|

||||

|

||||

## Plugin-specific files:

|

||||

|

||||

# IntelliJ

|

||||

/out/

|

||||

|

||||

# mpeltonen/sbt-idea plugin

|

||||

.idea_modules/

|

||||

|

||||

# JIRA plugin

|

||||

atlassian-ide-plugin.xml

|

||||

|

||||

# Crashlytics plugin (for Android Studio and IntelliJ)

|

||||

com_crashlytics_export_strings.xml

|

||||

crashlytics.properties

|

||||

crashlytics-build.properties

|

||||

fabric.properties

|

||||

|

||||

|

||||

### Java ###

|

||||

*.class

|

||||

|

||||

# Mobile Tools for Java (J2ME)

|

||||

.mtj.tmp/

|

||||

|

||||

# Package Files #

|

||||

*.jar

|

||||

*.war

|

||||

*.ear

|

||||

*.tar.gz

|

||||

|

||||

# virtual machine crash logs, see http://www.java.com/en/download/help/error_hotspot.xml

|

||||

hs_err_pid*

|

||||

|

||||

|

||||

### OSX ###

|

||||

.DS_Store

|

||||

.AppleDouble

|

||||

.LSOverride

|

||||

|

||||

# Icon must end with two \r

|

||||

Icon

|

||||

|

||||

|

||||

# Thumbnails

|

||||

._*

|

||||

|

||||

# Files that might appear in the root of a volume

|

||||

.DocumentRevisions-V100

|

||||

.fseventsd

|

||||

.Spotlight-V100

|

||||

.TemporaryItems

|

||||

.Trashes

|

||||

.VolumeIcon.icns

|

||||

|

||||

# Directories potentially created on remote AFP share

|

||||

.AppleDB

|

||||

.AppleDesktop

|

||||

Network Trash Folder

|

||||

Temporary Items

|

||||

.apdisk

|

||||

|

||||

/target

|

||||

target/

|

||||

*.log

|

||||

*.log.*

|

||||

*.bak

|

||||

*.vscode

|

||||

*/.vscode/*

|

||||

*/.vscode

|

||||

*/velocity.log*

|

||||

*/*.log

|

||||

*/*.log.*

|

||||

node_modules/

|

||||

node_modules/*

|

||||

workspace.xml

|

||||

/output/*

|

||||

.gitversion

|

||||

out/*

|

||||

dist/

|

||||

dist/*

|

||||

km-rest/src/main/resources/templates/

|

||||

*dependency-reduced-pom*

|

||||

#filter flattened xml

|

||||

*/.flattened-pom.xml

|

||||

.flattened-pom.xml

|

||||

*/*/.flattened-pom.xml

|

||||

### Intellij ###

|

||||

# Covers JetBrains IDEs: IntelliJ, RubyMine, PhpStorm, AppCode, PyCharm, CLion, Android Studio and Webstorm

|

||||

|

||||

*.iml

|

||||

|

||||

## Directory-based project format:

|

||||

.idea/

|

||||

# if you remove the above rule, at least ignore the following:

|

||||

|

||||

# User-specific stuff:

|

||||

# .idea/workspace.xml

|

||||

# .idea/tasks.xml

|

||||

# .idea/dictionaries

|

||||

# .idea/shelf

|

||||

|

||||

# Sensitive or high-churn files:

|

||||

.idea/dataSources.ids

|

||||

.idea/dataSources.xml

|

||||

.idea/sqlDataSources.xml

|

||||

.idea/dynamic.xml

|

||||

.idea/uiDesigner.xml

|

||||

|

||||

|

||||

# Mongo Explorer plugin:

|

||||

.idea/mongoSettings.xml

|

||||

|

||||

## File-based project format:

|

||||

*.ipr

|

||||

*.iws

|

||||

|

||||

## Plugin-specific files:

|

||||

|

||||

# IntelliJ

|

||||

/out/

|

||||

|

||||

# mpeltonen/sbt-idea plugin

|

||||

.idea_modules/

|

||||

|

||||

# JIRA plugin

|

||||

atlassian-ide-plugin.xml

|

||||

|

||||

# Crashlytics plugin (for Android Studio and IntelliJ)

|

||||

com_crashlytics_export_strings.xml

|

||||

crashlytics.properties

|

||||

crashlytics-build.properties

|

||||

fabric.properties

|

||||

|

||||

|

||||

### Java ###

|

||||

*.class

|

||||

|

||||

# Mobile Tools for Java (J2ME)

|

||||

.mtj.tmp/

|

||||

|

||||

# Package Files #

|

||||

*.jar

|

||||

*.war

|

||||

*.ear

|

||||

*.tar.gz

|

||||

|

||||

# virtual machine crash logs, see http://www.java.com/en/download/help/error_hotspot.xml

|

||||

hs_err_pid*

|

||||

|

||||

|

||||

### OSX ###

|

||||

.DS_Store

|

||||

.AppleDouble

|

||||

.LSOverride

|

||||

|

||||

# Icon must end with two \r

|

||||

Icon

|

||||

|

||||

|

||||

# Thumbnails

|

||||

._*

|

||||

|

||||

# Files that might appear in the root of a volume

|

||||

.DocumentRevisions-V100

|

||||

.fseventsd

|

||||

.Spotlight-V100

|

||||

.TemporaryItems

|

||||

.Trashes

|

||||

.VolumeIcon.icns

|

||||

|

||||

# Directories potentially created on remote AFP share

|

||||

.AppleDB

|

||||

.AppleDesktop

|

||||

Network Trash Folder

|

||||

Temporary Items

|

||||

.apdisk

|

||||

|

||||

/target

|

||||

target/

|

||||

*.log

|

||||

*.log.*

|

||||

*.bak

|

||||

*.vscode

|

||||

*/.vscode/*

|

||||

*/.vscode

|

||||

*/velocity.log*

|

||||

*/*.log

|

||||

*/*.log.*

|

||||

node_modules/

|

||||

node_modules/*

|

||||

workspace.xml

|

||||

/output/*

|

||||

.gitversion

|

||||

node_modules/*

|

||||

out/*

|

||||

dist/

|

||||

dist/*

|

||||

kafka-manager-web/src/main/resources/templates/

|

||||

.DS_Store

|

||||

|

||||

@@ -1,74 +0,0 @@

|

||||

|

||||

# Contributor Covenant Code of Conduct

|

||||

|

||||

## Our Pledge

|

||||

|

||||

In the interest of fostering an open and welcoming environment, we as

|

||||

contributors and maintainers pledge to making participation in our project and

|

||||

our community a harassment-free experience for everyone, regardless of age, body

|

||||

size, disability, ethnicity, gender identity and expression, level of experience,

|

||||

education, socio-economic status, nationality, personal appearance, race,

|

||||

religion, or sexual identity and orientation.

|

||||

|

||||

## Our Standards

|

||||

|

||||

Examples of behavior that contributes to creating a positive environment

|

||||

include:

|

||||

|

||||

* Using welcoming and inclusive language

|

||||

* Being respectful of differing viewpoints and experiences

|

||||

* Gracefully accepting constructive criticism

|

||||

* Focusing on what is best for the community

|

||||

* Showing empathy towards other community members

|

||||

|

||||

Examples of unacceptable behavior by participants include:

|

||||

|

||||

* The use of sexualized language or imagery and unwelcome sexual attention or

|

||||

advances

|

||||

* Trolling, insulting/derogatory comments, and personal or political attacks

|

||||

* Public or private harassment

|

||||

* Publishing others' private information, such as a physical or electronic

|

||||

address, without explicit permission

|

||||

* Other conduct which could reasonably be considered inappropriate in a

|

||||

professional setting

|

||||

|

||||

## Our Responsibilities

|

||||

|

||||

Project maintainers are responsible for clarifying the standards of acceptable

|

||||

behavior and are expected to take appropriate and fair corrective action in

|

||||

response to any instances of unacceptable behavior.

|

||||

|

||||

Project maintainers have the right and responsibility to remove, edit, or

|

||||

reject comments, commits, code, wiki edits, issues, and other contributions

|

||||

that are not aligned to this Code of Conduct, or to ban temporarily or

|

||||

permanently any contributor for other behaviors that they deem inappropriate,

|

||||

threatening, offensive, or harmful.

|

||||

|

||||

## Scope

|

||||

|

||||

This Code of Conduct applies both within project spaces and in public spaces

|

||||

when an individual is representing the project or its community. Examples of

|

||||

representing a project or community include using an official project e-mail

|

||||

address, posting via an official social media account, or acting as an appointed

|

||||

representative at an online or offline event. Representation of a project may be

|

||||

further defined and clarified by project maintainers.

|

||||

|

||||

## Enforcement

|

||||

|

||||

Instances of abusive, harassing, or otherwise unacceptable behavior may be

|

||||

reported by contacting the project team at shirenchuang@didiglobal.com . All

|

||||

complaints will be reviewed and investigated and will result in a response that

|

||||

is deemed necessary and appropriate to the circumstances. The project team is

|

||||

obligated to maintain confidentiality with regard to the reporter of an incident.

|

||||

Further details of specific enforcement policies may be posted separately.

|

||||

|

||||

Project maintainers who do not follow or enforce the Code of Conduct in good

|

||||

faith may face temporary or permanent repercussions as determined by other

|

||||

members of the project's leadership.

|

||||

|

||||

## Attribution

|

||||

|

||||

This Code of Conduct is adapted from the [Contributor Covenant][homepage], version 1.4,

|

||||

available at https://www.contributor-covenant.org/version/1/4/code-of-conduct.html

|

||||

|

||||

[homepage]: https://www.contributor-covenant.org

|

||||

158

CONTRIBUTING.md

@@ -1,150 +1,28 @@

|

||||

# Contribution Guideline

|

||||

|

||||

Thanks for considering to contribute this project. All issues and pull requests are highly appreciated.

|

||||

|

||||

## Pull Requests

|

||||

|

||||

# 为KnowStreaming做贡献

|

||||

Before sending pull request to this project, please read and follow guidelines below.

|

||||

|

||||

1. Branch: We only accept pull request on `dev` branch.

|

||||

2. Coding style: Follow the coding style used in kafka-manager.

|

||||

3. Commit message: Use English and be aware of your spell.

|

||||

4. Test: Make sure to test your code.

|

||||

|

||||

欢迎👏🏻来到KnowStreaming!本文档是关于如何为KnowStreaming做出贡献的指南。

|

||||

Add device mode, API version, related log, screenshots and other related information in your pull request if possible.

|

||||

|

||||

如果您发现不正确或遗漏的内容, 请留下意见/建议。

|

||||

NOTE: We assume all your contribution can be licensed under the [Apache License 2.0](LICENSE).

|

||||

|

||||

## 行为守则

|

||||

请务必阅读并遵守我们的 [行为准则](./CODE_OF_CONDUCT.md).

|

||||

## Issues

|

||||

|

||||

We love clearly described issues. :)

|

||||

|

||||

Following information can help us to resolve the issue faster.

|

||||

|

||||

## 贡献

|

||||

|

||||

**KnowStreaming** 欢迎任何角色的新参与者,包括 **User** 、**Contributor**、**Committer**、**PMC** 。

|

||||

|

||||

我们鼓励新人积极加入 **KnowStreaming** 项目,从User到Contributor、Committer ,甚至是 PMC 角色。

|

||||

|

||||

为了做到这一点,新人需要积极地为 **KnowStreaming** 项目做出贡献。以下介绍如何对 **KnowStreaming** 进行贡献。

|

||||

|

||||

|

||||

### 创建/打开 Issue

|

||||

|

||||

如果您在文档中发现拼写错误、在代码中**发现错误**或想要**新功能**或想要**提供建议**,您可以在 GitHub 上[创建一个Issue](https://github.com/didi/KnowStreaming/issues/new/choose) 进行报告。

|

||||

|

||||

|

||||

如果您想直接贡献, 您可以选择下面标签的问题。

|

||||

|

||||

- [contribution welcome](https://github.com/didi/KnowStreaming/labels/contribution%20welcome) : 非常需要解决/新增 的Issues

|

||||

- [good first issue](https://github.com/didi/KnowStreaming/labels/good%20first%20issue): 对新人比较友好, 新人可以拿这个Issue来练练手热热身。

|

||||

|

||||

<font color=red ><b> 请注意,任何 PR 都必须与有效issue相关联。否则,PR 将被拒绝。</b></font>

|

||||

|

||||

|

||||

|

||||

### 开始你的贡献

|

||||

|

||||

**分支介绍**

|

||||

|

||||

我们将 `dev`分支作为开发分支, 说明这是一个不稳定的分支。

|

||||

|

||||

此外,我们的分支模型符合 [https://nvie.com/posts/a-successful-git-branching-model/](https://nvie.com/posts/a-successful-git-branching-model/). 我们强烈建议新人在创建PR之前先阅读上述文章。

|

||||

|

||||

|

||||

|

||||

**贡献流程**

|

||||

|

||||

为方便描述,我们这里定义一下2个名词:

|

||||

|

||||

自己Fork出来的仓库是私人仓库, 我们这里称之为 :**分叉仓库**

|

||||

Fork的源项目,我们称之为:**源仓库**

|

||||

|

||||

|

||||

现在,如果您准备好创建PR, 以下是贡献者的工作流程:

|

||||

|

||||

1. Fork [KnowStreaming](https://github.com/didi/KnowStreaming) 项目到自己的仓库

|

||||

|

||||

2. 从源仓库的`dev`拉取并创建自己的本地分支,例如: `dev`

|

||||

3. 在本地分支上对代码进行修改

|

||||

4. Rebase 开发分支, 并解决冲突

|

||||

5. commit 并 push 您的更改到您自己的**分叉仓库**

|

||||

6. 创建一个 Pull Request 到**源仓库**的`dev`分支中。

|

||||

7. 等待回复。如果回复的慢,请无情的催促。

|

||||

|

||||

|

||||

更为详细的贡献流程请看:[贡献流程](./docs/contributer_guide/贡献流程.md)

|

||||

|

||||

创建Pull Request时:

|

||||

|

||||

1. 请遵循 PR的 [模板](./.github/PULL_REQUEST_TEMPLATE.md)

|

||||

2. 请确保 PR 有相应的issue。

|

||||

3. 如果您的 PR 包含较大的更改,例如组件重构或新组件,请编写有关其设计和使用的详细文档(在对应的issue中)。

|

||||

4. 注意单个 PR 不能太大。如果需要进行大量更改,最好将更改分成几个单独的 PR。

|

||||

5. 在合并PR之前,尽量的将最终的提交信息清晰简洁, 将多次修改的提交尽可能的合并为一次提交。

|

||||

6. 创建 PR 后,将为PR分配一个或多个reviewers。

|

||||

|

||||

|

||||

<font color=red><b>如果您的 PR 包含较大的更改,例如组件重构或新组件,请编写有关其设计和使用的详细文档。</b></font>

|

||||

|

||||

|

||||

# 代码审查指南

|

||||

|

||||

Commiter将轮流review代码,以确保在合并前至少有一名Commiter

|

||||

|

||||

一些原则:

|

||||

|

||||

- 可读性——重要的代码应该有详细的文档。API 应该有 Javadoc。代码风格应与现有风格保持一致。

|

||||

- 优雅:新的函数、类或组件应该设计得很好。

|

||||

- 可测试性——单元测试用例应该覆盖 80% 的新代码。

|

||||

- 可维护性 - 遵守我们的编码规范。

|

||||

|

||||

|

||||

# 开发者

|

||||

|

||||

## 成为Contributor

|

||||

|

||||

只要成功提交并合并PR , 则为Contributor

|

||||

|

||||

贡献者名单请看:[贡献者名单](./docs/contributer_guide/开发者名单.md)

|

||||

|

||||

## 尝试成为Commiter

|

||||

|

||||

一般来说, 贡献8个重要的补丁并至少让三个不同的人来Review他们(您需要3个Commiter的支持)。

|

||||

然后请人给你提名, 您需要展示您的

|

||||

|

||||

1. 至少8个重要的PR和项目的相关问题

|

||||

2. 与团队合作的能力

|

||||

3. 了解项目的代码库和编码风格

|

||||

4. 编写好代码的能力

|

||||

|

||||

当前的Commiter可以通过在KnowStreaming中的Issue标签 `nomination`(提名)来提名您

|

||||

|

||||

1. 你的名字和姓氏

|

||||

2. 指向您的Git个人资料的链接

|

||||

3. 解释为什么你应该成为Commiter

|

||||

4. 详细说明提名人与您合作的3个PR以及相关问题,这些问题可以证明您的能力。

|

||||

|

||||

另外2个Commiter需要支持您的**提名**,如果5个工作日内没有人反对,您就是提交者,如果有人反对或者想要更多的信息,Commiter会讨论并通常达成共识(5个工作日内) 。

|

||||

|

||||

|

||||

# 开源奖励计划

|

||||

|

||||

|

||||

我们非常欢迎开发者们为KnowStreaming开源项目贡献一份力量,相应也将给予贡献者激励以表认可与感谢。

|

||||

|

||||

|

||||

## 参与贡献

|

||||

|

||||

1. 积极参与 Issue 的讨论,如答疑解惑、提供想法或报告无法解决的错误(Issue)

|

||||

2. 撰写和改进项目的文档(Wiki)

|

||||

3. 提交补丁优化代码(Coding)

|

||||

|

||||

|

||||

## 你将获得

|

||||

|

||||

1. 加入KnowStreaming开源项目贡献者名单并展示

|

||||

2. KnowStreaming开源贡献者证书(纸质&电子版)

|

||||

3. KnowStreaming贡献者精美大礼包(KnowStreamin/滴滴 周边)

|

||||

|

||||

|

||||

## 相关规则

|

||||

|

||||

- Contributer和Commiter都会有对应的证书和对应的礼包

|

||||

- 每季度有KnowStreaming项目团队评选出杰出贡献者,颁发相应证书。

|

||||

- 年末进行年度评选

|

||||

|

||||

贡献者名单请看:[贡献者名单](./docs/contributer_guide/开发者名单.md)

|

||||

* Device mode and hardware information.

|

||||

* API version.

|

||||

* Logs.

|

||||

* Screenshots.

|

||||

* Steps to reproduce the issue.

|

||||

221

README.md

@@ -1,157 +1,64 @@

|

||||

|

||||

<p align="center">

|

||||

<img src="https://user-images.githubusercontent.com/71620349/185368586-aed82d30-1534-453d-86ff-ecfa9d0f35bd.png" width = "256" div align=center />

|

||||

|

||||

</p>

|

||||

|

||||

<p align="center">

|

||||

<a href="https://knowstreaming.com">产品官网</a> |

|

||||

<a href="https://github.com/didi/KnowStreaming/releases">下载地址</a> |

|

||||

<a href="https://doc.knowstreaming.com/product">文档资源</a> |

|

||||

<a href="https://demo.knowstreaming.com">体验环境</a>

|

||||

</p>

|

||||

|

||||

<p align="center">

|

||||

<!--最近一次提交时间-->

|

||||

<a href="https://img.shields.io/github/last-commit/didi/KnowStreaming">

|

||||

<img src="https://img.shields.io/github/last-commit/didi/KnowStreaming" alt="LastCommit">

|

||||

</a>

|

||||

|

||||

<!--最新版本-->

|

||||

<a href="https://github.com/didi/KnowStreaming/blob/master/LICENSE">

|

||||

<img src="https://img.shields.io/github/v/release/didi/KnowStreaming" alt="License">

|

||||

</a>

|

||||

|

||||

<!--License信息-->

|

||||

<a href="https://github.com/didi/KnowStreaming/blob/master/LICENSE">

|

||||

<img src="https://img.shields.io/github/license/didi/KnowStreaming" alt="License">

|

||||

</a>

|

||||

|

||||

<!--Open-Issue-->

|

||||

<a href="https://github.com/didi/KnowStreaming/issues">

|

||||

<img src="https://img.shields.io/github/issues-raw/didi/KnowStreaming" alt="Issues">

|

||||

</a>

|

||||

|

||||

<!--知识星球-->

|

||||

<a href="https://z.didi.cn/5gSF9">

|

||||

<img src="https://img.shields.io/badge/join-%E7%9F%A5%E8%AF%86%E6%98%9F%E7%90%83-red" alt="Slack">

|

||||

</a>

|

||||

|

||||

</p>

|

||||

|

||||

|

||||

---

|

||||

|

||||

|

||||

## `Know Streaming` 简介

|

||||

|

||||

`Know Streaming`是一套云原生的Kafka管控平台,脱胎于众多互联网内部多年的Kafka运营实践经验,专注于Kafka运维管控、监控告警、资源治理、多活容灾等核心场景。在用户体验、监控、运维管控上进行了平台化、可视化、智能化的建设,提供一系列特色的功能,极大地方便了用户和运维人员的日常使用,让普通运维人员都能成为Kafka专家。

|

||||

|

||||

我们现在正在收集 Know Streaming 用户信息,以帮助我们进一步改进 Know Streaming。

|

||||

请在 [issue#663](https://github.com/didi/KnowStreaming/issues/663) 上提供您的使用信息来支持我们:[谁在使用 Know Streaming](https://github.com/didi/KnowStreaming/issues/663)

|

||||

|

||||

|

||||

|

||||

整体具有以下特点:

|

||||

|

||||

- 👀 **零侵入、全覆盖**

|

||||

- 无需侵入改造 `Apache Kafka` ,一键便能纳管 `0.10.x` ~ `3.x.x` 众多版本的Kafka,包括 `ZK` 或 `Raft` 运行模式的版本,同时在兼容架构上具备良好的扩展性,帮助您提升集群管理水平;

|

||||

|

||||

- 🌪️ **零成本、界面化**

|

||||

- 提炼高频 CLI 能力,设计合理的产品路径,提供清新美观的 GUI 界面,支持 Cluster、Broker、Zookeeper、Topic、ConsumerGroup、Message、ACL、Connect 等组件 GUI 管理,普通用户5分钟即可上手;

|

||||

|

||||

- 👏 **云原生、插件化**

|

||||

- 基于云原生构建,具备水平扩展能力,只需要增加节点即可获取更强的采集及对外服务能力,提供众多可热插拔的企业级特性,覆盖可观测性生态整合、资源治理、多活容灾等核心场景;

|

||||

|

||||

- 🚀 **专业能力**

|

||||

- 集群管理:支持一键纳管,健康分析、核心组件观测 等功能;

|

||||

- 观测提升:多维度指标观测大盘、观测指标最佳实践 等功能;

|

||||

- 异常巡检:集群多维度健康巡检、集群多维度健康分 等功能;

|

||||

- 能力增强:集群负载均衡、Topic扩缩副本、Topic副本迁移 等功能;

|

||||

|

||||

|

||||

|

||||

**产品图**

|

||||

|

||||

<p align="center">

|

||||

|

||||

<img src="http://img-ys011.didistatic.com/static/dc2img/do1_sPmS4SNLX9m1zlpmHaLJ" width = "768" height = "473" div align=center />

|

||||

|

||||

</p>

|

||||

|

||||

|

||||

|

||||

|

||||

## 文档资源

|

||||

|

||||

**`开发相关手册`**

|

||||

|

||||

- [打包编译手册](docs/install_guide/源码编译打包手册.md)

|

||||

- [单机部署手册](docs/install_guide/单机部署手册.md)

|

||||

- [版本升级手册](docs/install_guide/版本升级手册.md)

|

||||

- [本地源码启动手册](docs/dev_guide/本地源码启动手册.md)

|

||||

|

||||

**`产品相关手册`**

|

||||

|

||||

- [产品使用指南](docs/user_guide/用户使用手册.md)

|

||||

- [2.x与3.x新旧对比手册](docs/user_guide/新旧对比手册.md)

|

||||

- [FAQ](docs/user_guide/faq.md)

|

||||

|

||||

|

||||

**点击 [这里](https://doc.knowstreaming.com/product),也可以从官网获取到更多文档**

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

## 成为社区贡献者

|

||||

|

||||

1. [贡献源码](https://doc.knowstreaming.com/product/10-contribution) 了解如何成为 Know Streaming 的贡献者

|

||||

2. [具体贡献流程](https://doc.knowstreaming.com/product/10-contribution#102-贡献流程)

|

||||

3. [开源激励计划](https://doc.knowstreaming.com/product/10-contribution#105-开源激励计划)

|

||||

4. [贡献者名单](https://doc.knowstreaming.com/product/10-contribution#106-贡献者名单)

|

||||

|

||||

|

||||

获取KnowStreaming开源社区证书。

|

||||

|

||||

## 加入技术交流群

|

||||

|

||||

**`1、知识星球`**

|

||||

|

||||

<p align="left">

|

||||

<img src="https://user-images.githubusercontent.com/71620349/185357284-fdff1dad-c5e9-4ddf-9a82-0be1c970980d.JPG" height = "180" div align=left />

|

||||

</p>

|

||||

|

||||

<br/>

|

||||

<br/>

|

||||

<br/>

|

||||

<br/>

|

||||

<br/>

|

||||

<br/>

|

||||

<br/>

|

||||

<br/>

|

||||

|

||||

👍 我们正在组建国内最大,最权威的 **[Kafka中文社区](https://z.didi.cn/5gSF9)**

|

||||

|

||||

在这里你可以结交各大互联网的 Kafka大佬 以及 4000+ Kafka爱好者,一起实现知识共享,实时掌控最新行业资讯,期待 👏 您的加入中~ https://z.didi.cn/5gSF9

|

||||

|

||||

有问必答~! 互动有礼~!

|

||||

|

||||

PS: 提问请尽量把问题一次性描述清楚,并告知环境信息情况~!如使用版本、操作步骤、报错/警告信息等,方便大V们快速解答~

|

||||

|

||||

|

||||

|

||||

**`2、微信群`**

|

||||

|

||||

微信加群:添加`mike_zhangliang`、`PenceXie` 、`szzdzhp001`的微信号备注KnowStreaming加群。

|

||||

<br/>

|

||||

|

||||

加群之前有劳点一下 star,一个小小的 star 是对KnowStreaming作者们努力建设社区的动力。

|

||||

|

||||

感谢感谢!!!

|

||||

|

||||

<img width="116" alt="wx" src="https://user-images.githubusercontent.com/71620349/192257217-c4ebc16c-3ad9-485d-a914-5911d3a4f46b.png">

|

||||

|

||||

## Star History

|

||||

|

||||

[](https://star-history.com/#didi/KnowStreaming&Date)

|

||||

|

||||

---

|

||||

|

||||

|

||||

|

||||

**一站式`Apache Kafka`集群指标监控与运维管控平台**

|

||||

|

||||

---

|

||||

|

||||

## 主要功能特性

|

||||

|

||||

|

||||

### 集群监控维度

|

||||

|

||||

- 多版本集群管控,支持从`0.10.2`到`2.x`版本;

|

||||

- 集群Topic、Broker等多维度历史与实时关键指标查看;

|

||||

|

||||

|

||||

### 集群管控维度

|

||||

|

||||

- 集群运维,包括逻辑Region方式管理集群

|

||||

- Broker运维,包括优先副本选举

|

||||

- Topic运维,包括创建、查询、扩容、修改属性、数据采样及迁移等;

|

||||

- 消费组运维,包括指定时间或指定偏移两种方式进行重置消费偏移

|

||||

|

||||

|

||||

### 用户使用维度

|

||||

|

||||

- Kafka用户、Kafka研发、Kafka运维 视角区分

|

||||

- Kafka用户、Kafka研发、Kafka运维 权限区分

|

||||

|

||||

|

||||

## kafka-manager架构图

|

||||

|

||||

|

||||

|

||||

|

||||

## 相关文档

|

||||

|

||||

- [kafka-manager 安装手册](docs/install_guide/install_guide_cn.md)

|

||||

- [kafka-manager 接入集群](docs/user_guide/add_cluster/add_cluster.md)

|

||||

- [kafka-manager 用户使用手册](docs/user_guide/user_guide_cn.md)

|

||||

- [kafka-manager FAQ](docs/user_guide/faq.md)

|

||||

|

||||

## 钉钉交流群

|

||||

|

||||

|

||||

|

||||

|

||||

## 项目成员

|

||||

|

||||

### 内部核心人员

|

||||

|

||||

`iceyuhui`、`liuyaguang`、`limengmonty`、`zhangliangmike`、`nullhuangyiming`、`zengqiao`、`eilenexuzhe`、`huangjiaweihjw`

|

||||

|

||||

|

||||

### 外部贡献者

|

||||

|

||||

`fangjunyu`、`zhoutaiyang`

|

||||

|

||||

|

||||

## 协议

|

||||

|

||||

`kafka-manager`基于`Apache-2.0`协议进行分发和使用,更多信息参见[协议文件](./LICENSE)

|

||||

|

||||

@@ -1,521 +0,0 @@

|

||||

|

||||

## v3.2.0

|

||||

|

||||

**问题修复**

|

||||

- 修复健康巡检结果更新至 DB 时,出现死锁问题;

|

||||

- 修复 KafkaJMXClient 类中,logger错误的问题;

|

||||

- 后端修复 Topic 过期策略在 0.10.1.0 版本能多选的问题,实际应该只能二选一;

|

||||

- 修复接入集群时,不填写集群配置会报错的问题;

|

||||

- 升级 spring-context 至 5.3.19 版本,修复安全漏洞;

|

||||

- 修复 Broker & Topic 修改配置时,多版本兼容配置的版本信息错误的问题;

|

||||

- 修复 Topic 列表的健康分为健康状态;

|

||||

- 修复 Broker LogSize 指标存储名称错误导致查询不到的问题;

|

||||

- 修复 Prometheus 中,缺少 Group 部分指标的问题;

|

||||

- 修复因缺少健康状态指标导致集群数错误的问题;

|

||||

- 修复后台任务记录操作日志时,因缺少操作用户信息导致出现异常的问题;

|

||||

- 修复 Replica 指标查询时,DSL 错误的问题;

|

||||

- 关闭 errorLogger,修复错误日志重复输出的问题;

|

||||

- 修复系统管理更新用户信息失败的问题;

|

||||

- 修复因原AR信息丢失,导致迁移任务一直处于执行中的错误;

|

||||

- 修复集群 Topic 列表实时数据查询时,出现失败的问题;

|

||||

- 修复集群 Topic 列表,页面白屏问题;

|

||||

- 修复副本变更时,因AR数据异常,导致数组访问越界的问题;

|

||||

|

||||

|

||||

**产品优化**

|

||||

- 优化健康巡检为按照资源维度多线程并发处理;

|

||||

- 统一日志输出格式,并优化部分输出的日志;

|

||||

- 优化 ZK 四字命令结果解析过程中,容易引起误解的 WARN 日志;

|

||||

- 优化 Zookeeper 详情中,目录结构的搜索文案;

|

||||

- 优化线程池的名称,方便第三方系统进行相关问题的分析;

|

||||

- 去除 ESClient 的并发访问控制,降低 ESClient 创建数及提升利用率;

|

||||

- 优化 Topic Messages 抽屉文案;

|

||||

- 优化 ZK 健康巡检失败时的错误日志信息;

|

||||

- 提高 Offset 信息获取的超时时间,降低并发过高时出现请求超时的概率;

|

||||

- 优化 Topic & Partition 元信息的更新策略,降低对 DB 连接的占用;

|

||||

- 优化 Sonar 代码扫码问题;

|

||||

- 优化分区 Offset 指标的采集;

|

||||

- 优化前端图表相关组件逻辑;

|

||||

- 优化产品主题色;

|

||||

- Consumer 列表刷新按钮新增 hover 提示;

|

||||

- 优化配置 Topic 的消息大小时的测试弹框体验;

|

||||

- 优化 Overview 页面 TopN 查询的流程;

|

||||

|

||||

|

||||

**功能新增**

|

||||

- 新增页面无数据排查文档;

|

||||

- 增加 ES 索引删除的功能;

|

||||

- 支持拆分API服务和Job服务部署;

|

||||

|

||||

|

||||

**Kafka Connect Beta版 (v3.2.0版本新增发布)**

|

||||

- Connect 集群的纳管;

|

||||

- Connector 的增删改查;

|

||||

- Connect 集群 & Connector 的指标大盘;

|

||||

|

||||

|

||||

---

|

||||

|

||||

|

||||

## v3.1.0

|

||||

|

||||

**Bug修复**

|

||||

- 修复重置 Group Offset 的提示信息中,缺少Dead状态也可进行重置的描述;

|

||||

- 修复新建 Topic 后,立即查看 Topic Messages 信息时,会提示 Topic 不存在的问题;

|

||||

- 修复副本变更时,优先副本选举未被正常处罚执行的问题;

|

||||

- 修复 git 目录不存在时,打包不能正常进行的问题;

|

||||

- 修复 KRaft 模式的 Kafka 集群,JMX PORT 显示 -1 的问题;

|

||||

|

||||

|

||||

**体验优化**

|

||||

- 优化Cluster、Broker、Topic、Group的健康分为健康状态;

|

||||

- 去除健康巡检配置中的权重信息;

|

||||

- 错误提示页面展示优化;

|

||||

- 前端打包编译依赖默认使用 taobao 镜像;

|

||||

- 重新设计优化导航栏的 icon ;

|

||||

|

||||

|

||||

**新增**

|

||||

- 个人头像下拉信息中,新增产品版本信息;

|

||||

- 多集群列表页面,新增集群健康状态分布信息;

|

||||

|

||||

|

||||

**Kafka ZK 部分 (v3.1.0版本正式发布)**

|

||||

- 新增 ZK 集群的指标大盘信息;

|

||||

- 新增 ZK 集群的服务状态概览信息;

|

||||

- 新增 ZK 集群的服务节点列表信息;

|

||||

- 新增 Kafka 在 ZK 的存储数据查看功能;

|

||||

- 新增 ZK 的健康巡检及健康状态计算;

|

||||

|

||||

|

||||

|

||||

---

|

||||

|

||||

|

||||

## v3.0.1

|

||||

|

||||

**Bug修复**

|

||||

- 修复重置 Group Offset 时,提示信息中缺少 Dead 状态也可进行重置的信息;

|

||||

- 修复 Ldap 某个属性不存在时,会直接抛出空指针导致登陆失败的问题;

|

||||

- 修复集群 Topic 列表页,健康分详情信息中,检查时间展示错误的问题;

|

||||

- 修复更新健康检查结果时,出现死锁的问题;

|

||||

- 修复 Replica 索引模版错误的问题;

|

||||

- 修复 FAQ 文档中的错误链接;

|

||||

- 修复 Broker 的 TopN 指标不存在时,页面数据不展示的问题;

|

||||

- 修复 Group 详情页,图表时间范围选择不生效的问题;

|

||||

|

||||

|

||||

**体验优化**

|

||||

- 集群 Group 列表按照 Group 维度进行展示;

|

||||

- 优化避免因 ES 中该指标不存在,导致日志中出现大量空指针的问题;

|

||||

- 优化全局 Message & Notification 展示效果;

|

||||

- 优化 Topic 扩分区名称 & 描述展示;

|

||||

|

||||

|

||||

**新增**

|

||||

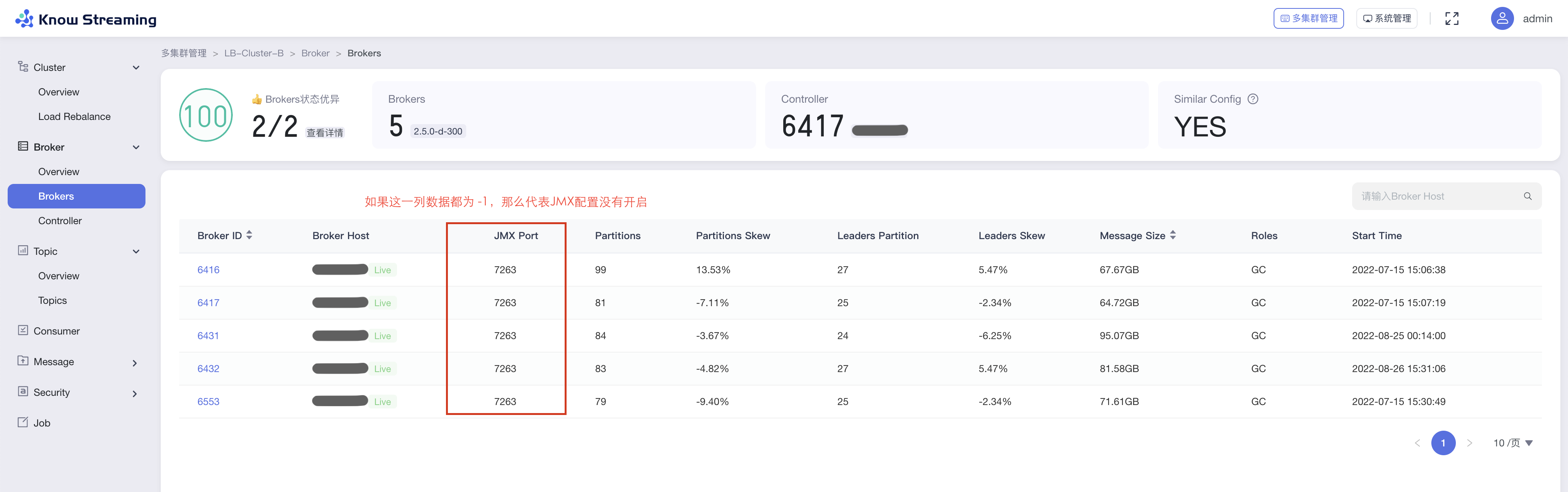

- Broker 列表页面,新增 JMX 是否成功连接的信息;

|

||||

|

||||

|

||||

**ZK 部分(未完全发布)**

|

||||

- 后端补充 Kafka ZK 指标采集,Kafka ZK 信息获取相关功能;

|

||||

- 增加本地缓存,避免同一采集周期内 ZK 指标重复采集;

|

||||

- 增加 ZK 节点采集失败跳过策略,避免不断对存在问题的节点不断尝试;

|

||||

- 修复 zkAvgLatency 指标转 Long 时抛出异常问题;

|

||||

- 修复 ks_km_zookeeper 表中,role 字段类型错误问题;

|

||||

|

||||

---

|

||||

|

||||

## v3.0.0

|

||||

|

||||

**Bug修复**

|

||||

- 修复 Group 指标防重复采集不生效问题

|

||||

- 修复自动创建 ES 索引模版失败问题

|

||||

- 修复 Group+Topic 列表中存在已删除Topic的问题

|

||||

- 修复使用 MySQL-8 ,因兼容问题, start_time 信息为 NULL 时,会导致创建任务失败的问题

|

||||

- 修复 Group 信息表更新时,出现死锁的问题

|

||||

- 修复图表补点逻辑与图表时间范围不适配的问题

|

||||

|

||||

|

||||

**体验优化**

|

||||

- 按照资源类别,拆分健康巡检任务

|

||||

- 优化 Group 详情页的指标为实时获取

|

||||

- 图表拖拽排序支持用户级存储

|

||||

- 多集群列表 ZK 信息展示兼容无 ZK 情况

|

||||

- Topic 详情消息预览支持复制功能

|

||||

- 部分内容大数字支持千位分割符展示

|

||||

|

||||

|

||||

**新增**

|

||||

- 集群信息中,新增 Zookeeper 客户端配置字段

|

||||

- 集群信息中,新增 Kafka 集群运行模式字段

|

||||

- 新增 docker-compose 的部署方式

|

||||

|

||||

---

|

||||

|

||||

## v3.0.0-beta.3

|

||||

|

||||

**文档**

|

||||

- FAQ 补充权限识别失败问题的说明

|

||||

- 同步更新文档,保持与官网一致

|

||||

|

||||

|

||||

**Bug修复**

|

||||

- Offset 信息获取时,过滤掉无 Leader 的分区

|

||||

- 升级 oshi-core 版本至 5.6.1 版本,修复 Windows 系统获取系统指标失败问题

|

||||

- 修复 JMX 连接被关闭后,未进行重建的问题

|

||||

- 修复因 DB 中 Broker 信息不存在导致 TotalLogSize 指标获取时抛空指针问题

|

||||

- 修复 dml-logi.sql 中,SQL 注释错误的问题

|

||||

- 修复 startup.sh 中,识别操作系统类型错误的问题

|

||||

- 修复配置管理页面删除配置失败的问题

|

||||

- 修复系统管理应用文件引用路径

|

||||

- 修复 Topic Messages 详情提示信息点击跳转 404 的问题

|

||||

- 修复扩副本时,当前副本数不显示问题

|

||||

|

||||

|

||||

**体验优化**

|

||||

- Topic-Messages 页面,增加返回数据的排序以及按照Earliest/Latest的获取方式

|

||||

- 优化 GroupOffsetResetEnum 类名为 OffsetTypeEnum,使得类名含义更准确

|

||||

- 移动 KafkaZKDAO 类,及 Kafka Znode 实体类的位置,使得 Kafka Zookeeper DAO 更加内聚及便于识别

|

||||

- 后端补充 Overview 页面指标排序的功能

|

||||

- 前端 Webpack 配置优化

|

||||

- Cluster Overview 图表取消放大展示功能

|

||||

- 列表页增加手动刷新功能

|

||||

- 接入/编辑集群,优化 JMX-PORT,Version 信息的回显,优化JMX信息的展示

|

||||

- 提高登录页面图片展示清晰度

|

||||

- 部分样式和文案优化

|

||||

|

||||

---

|

||||

|

||||

## v3.0.0-beta.2

|

||||

|

||||

**文档**

|

||||

- 新增登录系统对接文档

|

||||

- 优化前端工程打包构建部分文档说明

|

||||

- FAQ补充KnowStreaming连接特定JMX IP的说明

|

||||

|

||||

|

||||

**Bug修复**

|

||||

- 修复logi_security_oplog表字段过短,导致删除Topic等操作无法记录的问题

|

||||

- 修复ES查询时,抛java.lang.NumberFormatException: For input string: "{"value":0,"relation":"eq"}" 问题

|

||||

- 修复LogStartOffset和LogEndOffset指标单位错误问题

|

||||

- 修复进行副本变更时,旧副本数为NULL的问题

|

||||

- 修复集群Group列表,在第二页搜索时,搜索时返回的分页信息错误问题

|

||||

- 修复重置Offset时,返回的错误信息提示不一致的问题

|

||||

- 修复集群查看,系统查看,LoadRebalance等页面权限点缺失问题

|

||||

- 修复查询不存在的Topic时,错误信息提示不明显的问题

|

||||

- 修复Windows用户打包前端工程报错的问题

|

||||

- package-lock.json锁定前端依赖版本号,修复因依赖自动升级导致打包失败等问题

|

||||

- 系统管理子应用,补充后端返回的Code码拦截,解决后端接口返回报错不展示的问题

|

||||

- 修复用户登出后,依旧可以访问系统的问题

|

||||

- 修复巡检任务配置时,数值显示错误的问题

|

||||

- 修复Broker/Topic Overview 图表和图表详情问题

|

||||

- 修复Job扩缩副本任务明细数据错误的问题

|

||||

- 修复重置Offset时,分区ID,Offset数值无限制问题

|

||||

- 修复扩缩/迁移副本时,无法选中Kafka系统Topic的问题

|

||||

- 修复Topic的Config页面,编辑表单时不能正确回显当前值的问题

|

||||

- 修复Broker Card返回数据后依旧展示加载态的问题

|

||||

|

||||

|

||||

|

||||

**体验优化**

|

||||

- 优化默认用户密码为 admin/admin

|

||||

- 缩短新增集群后,集群信息加载的耗时

|

||||

- 集群Broker列表,增加Controller角色信息

|

||||

- 副本变更任务结束后,增加进行优先副本选举的操作

|

||||

- Task模块任务分为Metrics、Common、Metadata三类任务,每类任务配备独立线程池,减少对Job模块的线程池,以及不同类任务之间的相互影响

|

||||

- 删除代码中存在的多余无用文件

|

||||

- 自动新增ES索引模版及近7天索引,减少用户搭建时需要做的事项

|

||||

- 优化前端工程打包流程

|

||||

- 优化登录页文案,页面左侧栏内容,单集群详情样式,Topic列表趋势图等

|

||||

- 首次进入Broker/Topic图表详情时,进行预缓存数据从而优化体验

|

||||

- 优化Topic详情Partition Tab的展示

|

||||

- 多集群列表页增加编辑功能

|

||||

- 优化副本变更时,迁移时间支持分钟级别粒度

|

||||

- logi-security版本升级至2.10.13

|

||||

- logi-elasticsearch-client版本升级至1.0.24

|

||||

|

||||

|

||||

**能力提升**

|

||||

- 支持Ldap登录认证

|

||||

|

||||

---

|

||||

|

||||

## v3.0.0-beta.1

|

||||

|

||||

**文档**

|

||||

- 新增Task模块说明文档

|

||||

- FAQ补充 `Specified key was too long; max key length is 767 bytes ` 错误说明

|

||||

- FAQ补充 `出现ESIndexNotFoundException报错` 错误说明

|

||||

|

||||

|

||||

**Bug修复**

|

||||

- 修复 Consumer 点击 Stop 未停止检索的问题

|

||||

- 修复创建/编辑角色权限报错问题

|

||||

- 修复多集群管理/单集群详情均衡卡片状态错误问题

|

||||

- 修复版本列表未排序问题

|

||||

- 修复Raft集群Controller信息不断记录问题

|

||||

- 修复部分版本消费组描述信息获取失败问题

|

||||

- 修复分区Offset获取失败的日志中,缺少Topic名称信息问题

|

||||

- 修复GitHub图地址错误,及图裂问题

|

||||

- 修复Broker默认使用的地址和注释不一致问题

|

||||

- 修复 Consumer 列表分页不生效问题

|

||||

- 修复操作记录表operation_methods字段缺少默认值问题

|

||||

- 修复集群均衡表中move_broker_list字段无效的问题

|

||||

- 修复KafkaUser、KafkaACL信息获取时,日志一直重复提示不支持问题

|

||||

- 修复指标缺失时,曲线出现掉底的问题

|

||||

|

||||

|

||||

**体验优化**

|

||||

- 优化前端构建时间和打包体积,增加依赖打包的分包策略

|

||||

- 优化产品样式和文案展示

|

||||

- 优化ES客户端数为可配置

|

||||

- 优化日志中大量出现的MySQL Key冲突日志

|

||||

|

||||

|

||||

**能力提升**

|

||||

- 增加周期任务,用于主动创建缺少的ES模版及索引的能力,减少额外的脚本操作

|

||||

- 增加JMX连接的Broker地址可选择的能力

|

||||

|

||||

---

|

||||

|

||||

## v3.0.0-beta.0

|

||||

|

||||

**1、多集群管理**

|

||||

|

||||

- 增加健康监测体系、关键组件&指标 GUI 展示

|

||||

- 增加 2.8.x 以上 Kafka 集群接入,覆盖 0.10.x-3.x

|

||||

- 删除逻辑集群、共享集群、Region 概念

|

||||

|

||||

**2、Cluster 管理**

|

||||

|

||||

- 增加集群概览信息、集群配置变更记录

|

||||

- 增加 Cluster 健康分,健康检查规则支持自定义配置

|

||||

- 增加 Cluster 关键指标统计和 GUI 展示,支持自定义配置

|

||||

- 增加 Cluster 层 I/O、Disk 的 Load Reblance 功能,支持定时均衡任务(企业版)

|

||||

- 删除限流、鉴权功能

|

||||

- 删除 APPID 概念

|

||||

|

||||

**3、Broker 管理**

|

||||

|

||||

- 增加 Broker 健康分

|

||||

- 增加 Broker 关键指标统计和 GUI 展示,支持自定义配置

|

||||

- 增加 Broker 参数配置功能,需重启生效

|

||||

- 增加 Controller 变更记录

|

||||

- 增加 Broker Datalogs 记录

|

||||

- 删除 Leader Rebalance 功能

|

||||

- 删除 Broker 优先副本选举

|

||||

|

||||

**4、Topic 管理**

|

||||

|

||||

- 增加 Topic 健康分

|

||||

- 增加 Topic 关键指标统计和 GUI 展示,支持自定义配置

|

||||

- 增加 Topic 参数配置功能,可实时生效

|

||||

- 增加 Topic 批量迁移、Topic 批量扩缩副本功能

|

||||

- 增加查看系统 Topic 功能

|

||||

- 优化 Partition 分布的 GUI 展示

|

||||

- 优化 Topic Message 数据采样

|

||||

- 删除 Topic 过期概念

|

||||

- 删除 Topic 申请配额功能

|

||||

|

||||

**5、Consumer 管理**

|

||||

|

||||

- 优化了 ConsumerGroup 展示形式,增加 Consumer Lag 的 GUI 展示

|

||||

|

||||

**6、ACL 管理**

|

||||

|

||||

- 增加原生 ACL GUI 配置功能,可配置生产、消费、自定义多种组合权限

|

||||

- 增加 KafkaUser 功能,可自定义新增 KafkaUser

|

||||

|

||||

**7、消息测试(企业版)**

|

||||

|

||||

- 增加生产者消息模拟器,支持 Data、Flow、Header、Options 自定义配置(企业版)

|

||||

- 增加消费者消息模拟器,支持 Data、Flow、Header、Options 自定义配置(企业版)

|

||||

|

||||

**8、Job**

|

||||

|

||||

- 优化 Job 模块,支持任务进度管理

|

||||

|

||||

**9、系统管理**

|

||||

|

||||

- 优化用户、角色管理体系,支持自定义角色配置页面及操作权限

|

||||

- 优化审计日志信息

|

||||

- 删除多租户体系

|

||||

- 删除工单流程

|

||||

|

||||

---

|

||||

|

||||

## v2.6.0

|

||||

|

||||

版本上线时间:2022-01-24

|

||||

|

||||

### 能力提升

|

||||

- 增加简单回退工具类

|

||||

|

||||

### 体验优化

|

||||

- 补充周期任务说明文档

|

||||

- 补充集群安装部署使用说明文档

|

||||

- 升级Swagger、SpringFramework、SpringBoot、EChats版本

|

||||

- 优化Task模块的日志输出

|

||||

- 优化corn表达式解析失败后退出无任何日志提示问题

|

||||

- Ldap用户接入时,增加部门及邮箱信息等

|

||||

- 对Jmx模块,增加连接失败后的回退机制及错误日志优化

|

||||

- 增加线程池、客户端池可配置

|

||||

- 删除无用的jmx_prometheus_javaagent-0.14.0.jar

|

||||

- 优化迁移任务名称

|

||||

- 优化创建Region时,Region容量信息不能立即被更新问题

|

||||

- 引入lombok

|

||||

- 更新视频教程

|

||||

- 优化kcm_script.sh脚本中的LogiKM地址为可通过程序传入

|

||||

- 第三方接口及网关接口,增加是否跳过登录的开关

|

||||

- extends模块相关配置调整为非必须在application.yml中配置

|

||||

|

||||

### bug修复

|

||||

- 修复批量往DB写入空指标数组时报SQL语法异常的问题

|

||||

- 修复网关增加配置及修改配置时,version不变化问题

|

||||

- 修复集群列表页,提示框遮挡问题

|

||||

- 修复对高版本Broker元信息协议解析失败的问题

|

||||

- 修复Dockerfile执行时提示缺少application.yml文件的问题

|

||||

- 修复逻辑集群更新时,会报空指针的问题

|

||||

|

||||

|

||||

## v2.5.0

|

||||

|

||||

版本上线时间:2021-07-10

|

||||

|

||||

### 体验优化

|

||||

- 更改产品名为LogiKM

|

||||

- 更新产品图标

|

||||

|

||||

|

||||

## v2.4.1+

|

||||

|

||||

版本上线时间:2021-05-21

|

||||

|

||||

### 能力提升

|

||||

- 增加直接增加权限和配额的接口(v2.4.1)

|

||||

- 增加接口调用可绕过登录的功能(v2.4.1)

|

||||

|

||||

### 体验优化

|

||||

- Tomcat 版本提升至8.5.66(v2.4.2)

|

||||

- op接口优化,拆分util接口为topic、leader两类接口(v2.4.1)

|

||||

- 简化Gateway配置的Key长度(v2.4.1)

|

||||

|

||||

### bug修复

|

||||

- 修复页面展示版本错误问题(v2.4.2)

|

||||

|

||||

|

||||

## v2.4.0

|

||||

|

||||

版本上线时间:2021-05-18

|

||||

|

||||

|

||||

### 能力提升

|

||||

|

||||

- 增加App与Topic自动化审批开关

|

||||

- Broker元信息中增加Rack信息

|

||||

- 升级MySQL 驱动,支持MySQL 8+

|

||||

- 增加操作记录查询界面

|

||||

|

||||

### 体验优化

|

||||

|

||||

- FAQ告警组说明优化

|

||||

- 用户手册共享及 独享集群概念优化

|

||||

- 用户管理界面,前端限制用户删除自己

|

||||

|

||||

### bug修复

|

||||

|

||||

- 修复op-util类中创建Topic失败的接口

|

||||

- 周期同步Topic到DB的任务修复,将Topic列表查询从缓存调整为直接查DB

|

||||

- 应用下线审批失败的功能修复,将权限为0(无权限)的数据进行过滤

|

||||

- 修复登录及权限绕过的漏洞

|

||||

- 修复研发角色展示接入集群、暂停监控等按钮的问题

|

||||

|

||||

|

||||

## v2.3.0

|

||||

|

||||

版本上线时间:2021-02-08

|

||||

|

||||

|

||||

### 能力提升

|

||||

|

||||

- 新增支持docker化部署

|

||||

- 可指定Broker作为候选controller

|

||||

- 可新增并管理网关配置

|

||||

- 可获取消费组状态

|

||||

- 增加集群的JMX认证

|

||||

|

||||

### 体验优化

|

||||

|

||||

- 优化编辑用户角色、修改密码的流程

|

||||

- 新增consumerID的搜索功能

|

||||

- 优化“Topic连接信息”、“消费组重置消费偏移”、“修改Topic保存时间”的文案提示

|

||||

- 在相应位置增加《资源申请文档》链接

|

||||

|

||||

### bug修复

|

||||

|

||||

- 修复Broker监控图表时间轴展示错误的问题

|

||||

- 修复创建夜莺监控告警规则时,使用的告警周期的单位不正确的问题

|

||||

|

||||

|

||||

|

||||

## v2.2.0

|

||||

|

||||

版本上线时间:2021-01-25

|

||||

|

||||

|

||||

|

||||

### 能力提升

|

||||

|

||||

- 优化工单批量操作流程

|

||||

- 增加获取Topic75分位/99分位的实时耗时数据

|

||||

- 增加定时任务,可将无主未落DB的Topic定期写入DB

|

||||

|

||||

### 体验优化

|

||||

|

||||

- 在相应位置增加《集群接入文档》链接

|

||||

- 优化物理集群、逻辑集群含义

|

||||

- 在Topic详情页、Topic扩分区操作弹窗增加展示Topic所属Region的信息

|

||||

- 优化Topic审批时,Topic数据保存时间的配置流程

|

||||

- 优化Topic/应用申请、审批时的错误提示文案

|

||||

- 优化Topic数据采样的操作项文案

|

||||

- 优化运维人员删除Topic时的提示文案

|

||||

- 优化运维人员删除Region的删除逻辑与提示文案

|

||||

- 优化运维人员删除逻辑集群的提示文案

|

||||

- 优化上传集群配置文件时的文件类型限制条件

|

||||

|

||||

### bug修复

|

||||

|

||||

- 修复填写应用名称时校验特殊字符出错的问题

|

||||

- 修复普通用户越权访问应用详情的问题

|

||||

- 修复由于Kafka版本升级,导致的数据压缩格式无法获取的问题

|

||||

- 修复删除逻辑集群或Topic之后,界面依旧展示的问题

|

||||

- 修复进行Leader rebalance操作时执行结果重复提示的问题

|

||||

|

||||

|

||||

## v2.1.0

|

||||

|

||||

版本上线时间:2020-12-19

|

||||

|

||||

|

||||

|

||||

### 体验优化

|

||||

|

||||

- 优化页面加载时的背景样式

|

||||

- 优化普通用户申请Topic权限的流程

|

||||

- 优化Topic申请配额、申请分区的权限限制

|

||||

- 优化取消Topic权限的文案提示

|

||||

- 优化申请配额表单的表单项名称

|

||||

- 优化重置消费偏移的操作流程

|

||||

- 优化创建Topic迁移任务的表单内容

|

||||

- 优化Topic扩分区操作的弹窗界面样式

|

||||

- 优化集群Broker监控可视化图表样式

|

||||

- 优化创建逻辑集群的表单内容

|

||||

- 优化集群安全协议的提示文案

|

||||

|

||||

### bug修复

|

||||

|

||||

- 修复偶发性重置消费偏移失败的问题

|

||||

|

||||

|

||||

|

||||

|

||||

@@ -1,718 +0,0 @@

|

||||

esaddr=127.0.0.1

|

||||

port=8060

|

||||

curl -s --connect-timeout 10 -o /dev/null http://${esaddr}:${port}/_cat/nodes >/dev/null 2>&1

|

||||

if [ "$?" != "0" ];then

|

||||

echo "Elasticserach 访问失败, 请安装完后检查并重新执行该脚本 "

|

||||

exit

|

||||

fi

|

||||

|

||||

curl -s --connect-timeout 10 -o /dev/null -X POST -H 'cache-control: no-cache' -H 'content-type: application/json' http://${esaddr}:${port}/_template/ks_kafka_broker_metric -d '{

|

||||

"order" : 10,

|

||||

"index_patterns" : [

|

||||

"ks_kafka_broker_metric*"

|

||||

],

|

||||

"settings" : {

|

||||

"index" : {

|

||||

"number_of_shards" : "10"

|

||||

}

|

||||

},

|

||||

"mappings" : {

|

||||

"properties" : {

|

||||

"brokerId" : {

|

||||

"type" : "long"

|

||||

},

|

||||

"routingValue" : {

|

||||

"type" : "text",

|

||||

"fields" : {

|

||||

"keyword" : {

|

||||

"ignore_above" : 256,

|

||||

"type" : "keyword"

|

||||

}

|

||||

}

|

||||

},

|

||||

"clusterPhyId" : {

|

||||

"type" : "long"

|

||||

},

|

||||

"metrics" : {

|

||||

"properties" : {

|

||||

"NetworkProcessorAvgIdle" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"UnderReplicatedPartitions" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"BytesIn_min_15" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"HealthCheckTotal" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"RequestHandlerAvgIdle" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"connectionsCount" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"BytesIn_min_5" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"HealthScore" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"BytesOut" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"BytesOut_min_15" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"BytesIn" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"BytesOut_min_5" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"TotalRequestQueueSize" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"MessagesIn" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"TotalProduceRequests" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"HealthCheckPassed" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"TotalResponseQueueSize" : {

|

||||

"type" : "float"

|

||||

}

|

||||

}

|

||||

},

|

||||

"key" : {

|

||||

"type" : "text",

|

||||

"fields" : {

|

||||

"keyword" : {

|

||||

"ignore_above" : 256,

|

||||

"type" : "keyword"

|

||||

}

|

||||

}

|

||||

},

|

||||

"timestamp" : {

|

||||

"format" : "yyyy-MM-dd HH:mm:ss Z||yyyy-MM-dd HH:mm:ss||yyyy-MM-dd HH:mm:ss.SSS Z||yyyy-MM-dd HH:mm:ss.SSS||yyyy-MM-dd HH:mm:ss,SSS||yyyy/MM/dd HH:mm:ss||yyyy-MM-dd HH:mm:ss,SSS Z||yyyy/MM/dd HH:mm:ss,SSS Z||epoch_millis",

|

||||

"index" : true,

|

||||

"type" : "date",

|

||||

"doc_values" : true

|

||||

}

|

||||

}

|

||||

},

|

||||

"aliases" : { }

|

||||

}'

|

||||

|

||||

curl -s -o /dev/null -X POST -H 'cache-control: no-cache' -H 'content-type: application/json' http://${esaddr}:${port}/_template/ks_kafka_cluster_metric -d '{

|

||||

"order" : 10,

|

||||

"index_patterns" : [

|

||||

"ks_kafka_cluster_metric*"

|

||||

],

|

||||

"settings" : {

|

||||

"index" : {

|

||||

"number_of_shards" : "10"

|

||||

}

|

||||

},

|

||||

"mappings" : {

|

||||

"properties" : {

|

||||

"routingValue" : {

|

||||

"type" : "text",

|

||||

"fields" : {

|

||||

"keyword" : {

|

||||

"ignore_above" : 256,

|

||||

"type" : "keyword"

|

||||

}

|

||||

}

|

||||

},

|

||||

"clusterPhyId" : {

|

||||

"type" : "long"

|

||||

},

|

||||

"metrics" : {

|

||||

"properties" : {

|

||||

"Connections" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"BytesIn_min_15" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"PartitionURP" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"HealthScore_Topics" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"EventQueueSize" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"ActiveControllerCount" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"GroupDeads" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"BytesIn_min_5" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"HealthCheckTotal_Topics" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"Partitions" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"BytesOut" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"Groups" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"BytesOut_min_15" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"TotalRequestQueueSize" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"HealthCheckPassed_Groups" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"TotalProduceRequests" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"HealthCheckPassed" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"TotalLogSize" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"GroupEmptys" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"PartitionNoLeader" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"HealthScore_Brokers" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"Messages" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"Topics" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"PartitionMinISR_E" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"HealthCheckTotal" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"Brokers" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"Replicas" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"HealthCheckTotal_Groups" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"GroupRebalances" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"MessageIn" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"HealthScore" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"HealthCheckPassed_Topics" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"HealthCheckTotal_Brokers" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"PartitionMinISR_S" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"BytesIn" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"BytesOut_min_5" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"GroupActives" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"MessagesIn" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"GroupReBalances" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"HealthCheckPassed_Brokers" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"HealthScore_Groups" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"TotalResponseQueueSize" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"Zookeepers" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"LeaderMessages" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"HealthScore_Cluster" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"HealthCheckPassed_Cluster" : {

|

||||

"type" : "double"

|

||||

},

|

||||

"HealthCheckTotal_Cluster" : {

|

||||

"type" : "double"

|

||||

}

|

||||

}

|

||||

},

|

||||

"key" : {

|

||||

"type" : "text",

|

||||

"fields" : {

|

||||

"keyword" : {

|

||||

"ignore_above" : 256,

|

||||

"type" : "keyword"

|

||||

}

|

||||

}

|

||||

},

|

||||

"timestamp" : {

|

||||

"format" : "yyyy-MM-dd HH:mm:ss Z||yyyy-MM-dd HH:mm:ss||yyyy-MM-dd HH:mm:ss.SSS Z||yyyy-MM-dd HH:mm:ss.SSS||yyyy-MM-dd HH:mm:ss,SSS||yyyy/MM/dd HH:mm:ss||yyyy-MM-dd HH:mm:ss,SSS Z||yyyy/MM/dd HH:mm:ss,SSS Z||epoch_millis",

|

||||

"type" : "date"

|

||||

}

|

||||

}

|

||||

},

|

||||

"aliases" : { }

|

||||

}'

|

||||

|

||||

curl -s -o /dev/null -X POST -H 'cache-control: no-cache' -H 'content-type: application/json' http://${esaddr}:${port}/_template/ks_kafka_group_metric -d '{

|

||||

"order" : 10,

|

||||

"index_patterns" : [

|

||||

"ks_kafka_group_metric*"

|

||||

],

|

||||

"settings" : {

|

||||

"index" : {

|

||||

"number_of_shards" : "10"

|

||||

}

|

||||

},

|

||||

"mappings" : {

|

||||

"properties" : {

|

||||

"group" : {

|

||||

"type" : "keyword"

|

||||

},

|

||||

"partitionId" : {

|

||||

"type" : "long"

|

||||

},

|

||||

"routingValue" : {

|

||||

"type" : "text",

|

||||

"fields" : {

|

||||

"keyword" : {

|

||||

"ignore_above" : 256,

|

||||

"type" : "keyword"

|

||||

}

|

||||

}

|

||||

},

|

||||

"clusterPhyId" : {

|

||||

"type" : "long"

|

||||

},

|

||||

"topic" : {

|

||||

"type" : "keyword"

|

||||

},

|

||||

"metrics" : {

|

||||

"properties" : {

|

||||

"HealthScore" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"Lag" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"OffsetConsumed" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"HealthCheckTotal" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"HealthCheckPassed" : {

|

||||

"type" : "float"

|

||||

}

|

||||

}

|

||||

},

|

||||

"groupMetric" : {

|

||||

"type" : "keyword"

|

||||

},

|

||||

"key" : {

|

||||

"type" : "text",

|

||||

"fields" : {

|

||||

"keyword" : {

|

||||

"ignore_above" : 256,

|

||||

"type" : "keyword"

|

||||

}

|

||||

}

|

||||

},

|

||||

"timestamp" : {

|

||||

"format" : "yyyy-MM-dd HH:mm:ss Z||yyyy-MM-dd HH:mm:ss||yyyy-MM-dd HH:mm:ss.SSS Z||yyyy-MM-dd HH:mm:ss.SSS||yyyy-MM-dd HH:mm:ss,SSS||yyyy/MM/dd HH:mm:ss||yyyy-MM-dd HH:mm:ss,SSS Z||yyyy/MM/dd HH:mm:ss,SSS Z||epoch_millis",

|

||||

"index" : true,

|

||||

"type" : "date",

|

||||

"doc_values" : true

|

||||

}

|

||||

}

|

||||

},

|

||||

"aliases" : { }

|

||||

}'

|

||||

|

||||

curl -s -o /dev/null -X POST -H 'cache-control: no-cache' -H 'content-type: application/json' http://${esaddr}:${port}/_template/ks_kafka_partition_metric -d '{

|

||||

"order" : 10,

|

||||

"index_patterns" : [

|

||||

"ks_kafka_partition_metric*"

|

||||

],

|

||||

"settings" : {

|

||||

"index" : {

|

||||

"number_of_shards" : "10"

|

||||

}

|

||||

},

|

||||

"mappings" : {

|

||||

"properties" : {

|

||||

"brokerId" : {

|

||||

"type" : "long"

|

||||

},

|

||||

"partitionId" : {

|

||||

"type" : "long"

|

||||

},

|

||||

"routingValue" : {

|

||||

"type" : "text",

|

||||

"fields" : {

|

||||

"keyword" : {

|

||||

"ignore_above" : 256,

|

||||

"type" : "keyword"

|

||||

}

|

||||

}

|

||||

},

|

||||

"clusterPhyId" : {

|

||||

"type" : "long"

|

||||

},

|

||||

"topic" : {

|

||||

"type" : "keyword"

|

||||

},

|

||||

"metrics" : {

|

||||

"properties" : {

|

||||

"LogStartOffset" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"Messages" : {

|

||||

"type" : "float"

|

||||

},

|

||||

"LogEndOffset" : {

|

||||

"type" : "float"

|

||||

}

|

||||

}

|

||||

},

|

||||

"key" : {

|

||||

"type" : "text",

|

||||