Compare commits

1072 Commits

v2.0.0-alp

...

ve_3.1.0

| Author | SHA1 | Date | |

|---|---|---|---|

|

|

c56d8cfb0f | ||

|

|

c27786a257 | ||

|

|

81910d1958 | ||

|

|

55d5fc4bde | ||

|

|

f30586b150 | ||

|

|

37037c19f0 | ||

|

|

1a5e2c7309 | ||

|

|

941dd4fd65 | ||

|

|

5f6df3681c | ||

|

|

7d045dbf05 | ||

|

|

4ff4accdc3 | ||

|

|

bbe967c4a8 | ||

|

|

b101cec6fa | ||

|

|

e98ec562a2 | ||

|

|

0e71ecc587 | ||

|

|

0f11a65df8 | ||

|

|

da00c8c877 | ||

|

|

8b177877bb | ||

|

|

ea199dca8d | ||

|

|

88b5833f77 | ||

|

|

127b5be651 | ||

|

|

80f001cdd5 | ||

|

|

30d297cae1 | ||

|

|

a96853db90 | ||

|

|

c1502152c0 | ||

|

|

afda292796 | ||

|

|

163cab78ae | ||

|

|

8f4ff36c09 | ||

|

|

47b6b3577a | ||

|

|

f3eca3b214 | ||

|

|

62f7d3f72f | ||

|

|

26e60d8a64 | ||

|

|

df655a250c | ||

|

|

811fc9b400 | ||

|

|

83df02783c | ||

|

|

6a5efce874 | ||

|

|

fa0ae5e474 | ||

|

|

cafd665a2d | ||

|

|

e8f77a456b | ||

|

|

4510c62ebd | ||

|

|

79864955e1 | ||

|

|

ff26a8d46c | ||

|

|

cc226d552e | ||

|

|

962f89475b | ||

|

|

ec204a1605 | ||

|

|

58d7623938 | ||

|

|

8f4ecfcdc0 | ||

|

|

ef719cedbc | ||

|

|

b7856c892b | ||

|

|

7435a78883 | ||

|

|

f49206b316 | ||

|

|

7d500a0721 | ||

|

|

98a519f20b | ||

|

|

39b655bb43 | ||

|

|

78d56a49fe | ||

|

|

d2e9d1fa01 | ||

|

|

41ff914dc3 | ||

|

|

3ba447fac2 | ||

|

|

e9cc380a2e | ||

|

|

017cac9bbe | ||

|

|

9ad72694af | ||

|

|

e8f9821870 | ||

|

|

bb167b9f8d | ||

|

|

28fbb5e130 | ||

|

|

16101e81e8 | ||

|

|

aced504d2a | ||

|

|

abb064d9d1 | ||

|

|

dc1899a1cd | ||

|

|

442f34278c | ||

|

|

a6dcbcd35b | ||

|

|

2b600e96eb | ||

|

|

177bb80f31 | ||

|

|

63fbe728c4 | ||

|

|

b33020840b | ||

|

|

c5caf7c0d6 | ||

|

|

0f0473db4c | ||

|

|

beadde3e06 | ||

|

|

a423a20480 | ||

|

|

79f0a23813 | ||

|

|

780fdea2cc | ||

|

|

1c0fda1adf | ||

|

|

9cf13e9b30 | ||

|

|

87cd058fd8 | ||

|

|

81b1ec48c2 | ||

|

|

66dd82f4fd | ||

|

|

ce35b23911 | ||

|

|

e79342acf5 | ||

|

|

3fc9f39d24 | ||

|

|

0221fb3a4a | ||

|

|

f009f8b7ba | ||

|

|

b76959431a | ||

|

|

975370b593 | ||

|

|

7275030971 | ||

|

|

99b0be5a95 | ||

|

|

edd3f95fc4 | ||

|

|

479f983b09 | ||

|

|

7650332252 | ||

|

|

8f1a021851 | ||

|

|

ce4df4d5fd | ||

|

|

bd43ae1b5d | ||

|

|

8fa34116b9 | ||

|

|

7e92553017 | ||

|

|

b7e243a693 | ||

|

|

35d4888afb | ||

|

|

b3e8a4f0f6 | ||

|

|

321125caee | ||

|

|

e01427aa4f | ||

|

|

14652e7f7a | ||

|

|

7c05899dbd | ||

|

|

56726b703f | ||

|

|

6237b0182f | ||

|

|

be5b662f65 | ||

|

|

224698355c | ||

|

|

8f47138ecd | ||

|

|

d159746391 | ||

|

|

63df93ea5e | ||

|

|

38948c0daa | ||

|

|

6c610427b6 | ||

|

|

b4cc31c459 | ||

|

|

7d781712c9 | ||

|

|

dd61ce9b2a | ||

|

|

69a7212986 | ||

|

|

ff05a951fd | ||

|

|

89d5357b40 | ||

|

|

7ca3d65c42 | ||

|

|

7b5c2d800f | ||

|

|

f414b47a78 | ||

|

|

44f4e2f0f9 | ||

|

|

2361008bdf | ||

|

|

7377ef3ec5 | ||

|

|

a28d064b7a | ||

|

|

e2e57e8575 | ||

|

|

9d90bd2835 | ||

|

|

7445e68df4 | ||

|

|

ab42625ad2 | ||

|

|

18789a0a53 | ||

|

|

68a37bb56a | ||

|

|

3b33652c47 | ||

|

|

1e0c4c3904 | ||

|

|

04e223de16 | ||

|

|

c4a691aa8a | ||

|

|

ff9dde163a | ||

|

|

eb7efbd1a5 | ||

|

|

8c8c362c54 | ||

|

|

66e119ad5d | ||

|

|

6dedc04a05 | ||

|

|

0cf8bad0df | ||

|

|

95c9582d8b | ||

|

|

7815126ff5 | ||

|

|

a5fa9de54b | ||

|

|

95f1a2c630 | ||

|

|

1e256ae1fd | ||

|

|

9fc9c54fa1 | ||

|

|

1b362b1e02 | ||

|

|

04e3172cca | ||

|

|

1caab7f3f7 | ||

|

|

9d33c725ad | ||

|

|

6ed1d38106 | ||

|

|

0f07ddedaf | ||

|

|

289945b471 | ||

|

|

f331a6d144 | ||

|

|

0c8c12a651 | ||

|

|

028c3bb2fa | ||

|

|

d7a5a0d405 | ||

|

|

5ef5f6e531 | ||

|

|

1d205734b3 | ||

|

|

5edd43884f | ||

|

|

c1992373bc | ||

|

|

ed562f9c8a | ||

|

|

b4d44ef8c7 | ||

|

|

ad0c16a1b4 | ||

|

|

7eabe66853 | ||

|

|

3983d73695 | ||

|

|

161d4c4562 | ||

|

|

9a1e89564e | ||

|

|

0c18c5b4f6 | ||

|

|

3e12ba34f7 | ||

|

|

e71e29391b | ||

|

|

9b7b9a7af0 | ||

|

|

a23819c308 | ||

|

|

6cb1825d96 | ||

|

|

77b8c758dc | ||

|

|

e5a582cfad | ||

|

|

ec83db267e | ||

|

|

bfd026cae7 | ||

|

|

35f1dd8082 | ||

|

|

7ed0e7dd23 | ||

|

|

1a3cbf7a9d | ||

|

|

d9e4abc3de | ||

|

|

a4186085d3 | ||

|

|

26b1846bb4 | ||

|

|

1aa89527a6 | ||

|

|

eac76d7ad0 | ||

|

|

cea0cd56f6 | ||

|

|

c4b897f282 | ||

|

|

47389dbabb | ||

|

|

a2f8b1a851 | ||

|

|

feac0a058f | ||

|

|

27eeac9fd4 | ||

|

|

a14db4b194 | ||

|

|

54ee271a47 | ||

|

|

a3a9be4f7f | ||

|

|

d4f0a832f3 | ||

|

|

7dc533372c | ||

|

|

1737d87713 | ||

|

|

dbb98dea11 | ||

|

|

802b382b36 | ||

|

|

fc82999d45 | ||

|

|

08aa000c07 | ||

|

|

39015b5100 | ||

|

|

0d635ad419 | ||

|

|

9133205915 | ||

|

|

725ac10c3d | ||

|

|

2b76358c8f | ||

|

|

833c360698 | ||

|

|

7da1e67b01 | ||

|

|

7eb86a47dd | ||

|

|

d67e383c28 | ||

|

|

8749d3e1f5 | ||

|

|

30fba21c48 | ||

|

|

d83d35aee9 | ||

|

|

1d3caeea7d | ||

|

|

c8806dbb4d | ||

|

|

e5802c7f50 | ||

|

|

590f684d66 | ||

|

|

8e5a67f565 | ||

|

|

8d2fbce11e | ||

|

|

26916f6632 | ||

|

|

fbfa0d2d2a | ||

|

|

e626b99090 | ||

|

|

203859b71b | ||

|

|

9a25c22f3a | ||

|

|

0a03f41a7c | ||

|

|

56191939c8 | ||

|

|

beb754aaaa | ||

|

|

f234f740ca | ||

|

|

e14679694c | ||

|

|

e06712397e | ||

|

|

b6c6df7ffc | ||

|

|

375c6f56c9 | ||

|

|

0bf85c97b5 | ||

|

|

630e582321 | ||

|

|

a89fe23bdd | ||

|

|

a7a5fa9a31 | ||

|

|

c73a7eee2f | ||

|

|

121f8468d5 | ||

|

|

7b0b6936e0 | ||

|

|

597ea04a96 | ||

|

|

f7f90aeaaa | ||

|

|

227479f695 | ||

|

|

6477fb3fe0 | ||

|

|

4223f4f3c4 | ||

|

|

7288874d72 | ||

|

|

68f76f2daf | ||

|

|

fe6ddebc49 | ||

|

|

12b5acd073 | ||

|

|

a6f1fe07b3 | ||

|

|

85e3f2a946 | ||

|

|

d4f416de14 | ||

|

|

0d9a6702c1 | ||

|

|

d11285cdbf | ||

|

|

5f1f33d2b9 | ||

|

|

474daf752d | ||

|

|

27d1b92690 | ||

|

|

993afa4c19 | ||

|

|

028d891c32 | ||

|

|

0df55ec22d | ||

|

|

579f64774d | ||

|

|

792f8d939d | ||

|

|

e4fb02fcda | ||

|

|

0c14c641d0 | ||

|

|

dba671fd1e | ||

|

|

80d1693722 | ||

|

|

26014a11b2 | ||

|

|

848fddd55a | ||

|

|

97f5f05f1a | ||

|

|

25b82810f2 | ||

|

|

9b1e506fa7 | ||

|

|

7a42996e97 | ||

|

|

dbfcebcf67 | ||

|

|

37c3f69a28 | ||

|

|

5d412890b4 | ||

|

|

1e318a4c40 | ||

|

|

d4549176ec | ||

|

|

61efdf492f | ||

|

|

67ea4d44c8 | ||

|

|

fdae05a4aa | ||

|

|

5efb837ee8 | ||

|

|

584b626d93 | ||

|

|

de25a4ed8e | ||

|

|

2e852e5ca6 | ||

|

|

b11000715a | ||

|

|

b3f8b46f0f | ||

|

|

8d22a0664a | ||

|

|

20756a3453 | ||

|

|

c9b4d45a64 | ||

|

|

83f7f5468b | ||

|

|

59c042ad67 | ||

|

|

d550fc5068 | ||

|

|

6effba69a0 | ||

|

|

9b46956259 | ||

|

|

b5a4a732da | ||

|

|

487862367e | ||

|

|

5b63b9ce67 | ||

|

|

afbcd3e1df | ||

|

|

12b82c1395 | ||

|

|

863b765e0d | ||

|

|

731429c51c | ||

|

|

66f3bc61fe | ||

|

|

4efe35dd51 | ||

|

|

c92461ef93 | ||

|

|

405e6e0c1d | ||

|

|

0d227aef49 | ||

|

|

0e49002f42 | ||

|

|

2e016800e0 | ||

|

|

09f317b991 | ||

|

|

5a48cb1547 | ||

|

|

f632febf33 | ||

|

|

3c53467943 | ||

|

|

d358c0f4f7 | ||

|

|

de977a5b32 | ||

|

|

703d685d59 | ||

|

|

31a5f17408 | ||

|

|

c40ae3c455 | ||

|

|

b71a34279e | ||

|

|

8f8c0c4eda | ||

|

|

3a384f0e34 | ||

|

|

cf7bc11cbd | ||

|

|

be60ae8399 | ||

|

|

8e50d145d5 | ||

|

|

7a3d15525c | ||

|

|

64f32d8b24 | ||

|

|

949d6ba605 | ||

|

|

ceb8db09f4 | ||

|

|

ed05a0ebb8 | ||

|

|

a7cbb76655 | ||

|

|

93cbfa0b1f | ||

|

|

6120613a98 | ||

|

|

dbd00db159 | ||

|

|

befde952f5 | ||

|

|

1aa759e5be | ||

|

|

2de27719c1 | ||

|

|

21db57b537 | ||

|

|

dfe8d09477 | ||

|

|

90dfa22c64 | ||

|

|

0f35427645 | ||

|

|

7909f60ff8 | ||

|

|

9a1a8a4c30 | ||

|

|

fa7ad64140 | ||

|

|

8a0c23339d | ||

|

|

e7ab3aff16 | ||

|

|

d0948797b9 | ||

|

|

04a5e17451 | ||

|

|

47065c8042 | ||

|

|

488c778736 | ||

|

|

d10a7bcc75 | ||

|

|

afe44a2537 | ||

|

|

9eadafe850 | ||

|

|

dab3eefcc0 | ||

|

|

2b9a6b28d8 | ||

|

|

465f98ca2b | ||

|

|

a0312be4fd | ||

|

|

4a5161372b | ||

|

|

4c9921f752 | ||

|

|

6dd72d40ee | ||

|

|

db49c234bb | ||

|

|

4a9df0c4d9 | ||

|

|

461573c2ba | ||

|

|

291992753f | ||

|

|

fcefe7ac38 | ||

|

|

7da712fcff | ||

|

|

2fd8687624 | ||

|

|

639b1f8336 | ||

|

|

ab3b83e42a | ||

|

|

4818629c40 | ||

|

|

61784c860a | ||

|

|

d5667254f2 | ||

|

|

af2b93983f | ||

|

|

8281301cbd | ||

|

|

0043ab8371 | ||

|

|

500eaace82 | ||

|

|

28e8540c78 | ||

|

|

69adf682e2 | ||

|

|

69cd1ff6e1 | ||

|

|

415d67cc32 | ||

|

|

46a2fec79b | ||

|

|

560b322fca | ||

|

|

effe17ac85 | ||

|

|

7699acfc1b | ||

|

|

6e058240b3 | ||

|

|

f005c6bc44 | ||

|

|

7be462599f | ||

|

|

271ab432d9 | ||

|

|

4114777a4e | ||

|

|

9189a54442 | ||

|

|

b95ee762e3 | ||

|

|

9e3c4dc06b | ||

|

|

1891a3ac86 | ||

|

|

9ecdcac06d | ||

|

|

790cb6a2e1 | ||

|

|

4a98e5f025 | ||

|

|

507abc1d84 | ||

|

|

9b732fbbad | ||

|

|

220f1c6fc3 | ||

|

|

7a950c67b6 | ||

|

|

78f625dc8c | ||

|

|

211d26a3ed | ||

|

|

dce2bc6326 | ||

|

|

90e5d7f6f0 | ||

|

|

71d4e0f9e6 | ||

|

|

580b4534e0 | ||

|

|

fc835e09c6 | ||

|

|

c6e782a637 | ||

|

|

1ddfbfc833 | ||

|

|

dbf637fe0f | ||

|

|

110e129622 | ||

|

|

677e9d1b54 | ||

|

|

ad2adb905e | ||

|

|

5e9de7ac14 | ||

|

|

c63fb8380c | ||

|

|

2d39acc224 | ||

|

|

e68358e05f | ||

|

|

a96f10edf0 | ||

|

|

f03d94935b | ||

|

|

9c1320cd95 | ||

|

|

4f2ae588a5 | ||

|

|

eff51034b7 | ||

|

|

18832dc448 | ||

|

|

5262ae8907 | ||

|

|

7f251679fa | ||

|

|

5f5920b427 | ||

|

|

65a16d058a | ||

|

|

a73484d23a | ||

|

|

47887a20c6 | ||

|

|

9465c6f198 | ||

|

|

c09872c8c2 | ||

|

|

b0501cc80d | ||

|

|

f0792db6b3 | ||

|

|

e1514c901b | ||

|

|

e90c5003ae | ||

|

|

92a0d5d52c | ||

|

|

8912cb5323 | ||

|

|

d008c19149 | ||

|

|

e844b6444a | ||

|

|

02606cdce2 | ||

|

|

0081720f0e | ||

|

|

cca1e92868 | ||

|

|

69b774a074 | ||

|

|

5656b03fb4 | ||

|

|

02d0dcbb7f | ||

|

|

7b2e06df12 | ||

|

|

4259ae63d7 | ||

|

|

d7b11803bc | ||

|

|

fed298a6d4 | ||

|

|

51832385b1 | ||

|

|

462303fca0 | ||

|

|

4405703e42 | ||

|

|

23e398e121 | ||

|

|

b17bb89d04 | ||

|

|

5590cebf8f | ||

|

|

1fa043f09d | ||

|

|

3bd0af1451 | ||

|

|

1545962745 | ||

|

|

d032571681 | ||

|

|

33fb0acc7e | ||

|

|

1ec68a91e2 | ||

|

|

a23c113a46 | ||

|

|

371ae2c0a5 | ||

|

|

8f8f6ffa27 | ||

|

|

475fe0d91f | ||

|

|

3d74e60d03 | ||

|

|

83ac83bb28 | ||

|

|

8478fb857c | ||

|

|

7074bdaa9f | ||

|

|

58164294cc | ||

|

|

7c0e9df156 | ||

|

|

bd62212ecb | ||

|

|

2292039b42 | ||

|

|

73f8da8d5a | ||

|

|

e51dbe0ca7 | ||

|

|

482a375e31 | ||

|

|

689c5ce455 | ||

|

|

734a020ecc | ||

|

|

44d537f78c | ||

|

|

b4c60eb910 | ||

|

|

e120b32375 | ||

|

|

de54966d30 | ||

|

|

39a6302c18 | ||

|

|

05ceeea4b0 | ||

|

|

9f8e3373a8 | ||

|

|

42521cbae4 | ||

|

|

b23c35197e | ||

|

|

70f28d9ac4 | ||

|

|

912d73d98a | ||

|

|

2a720fce6f | ||

|

|

e4534c359f | ||

|

|

b91bec15f2 | ||

|

|

67ad5cacb7 | ||

|

|

b4a739476a | ||

|

|

a7bf2085db | ||

|

|

c3802cf48b | ||

|

|

54711c4491 | ||

|

|

fcb52a69c0 | ||

|

|

1b632f9754 | ||

|

|

73d7a0ecdc | ||

|

|

08943593b3 | ||

|

|

c949a88f20 | ||

|

|

a49c11f655 | ||

|

|

a66aed4a88 | ||

|

|

0045c953a0 | ||

|

|

fdce41b451 | ||

|

|

4d5e4d0f00 | ||

|

|

82c9b6481e | ||

|

|

053d4dcb18 | ||

|

|

e1b2c442aa | ||

|

|

0ed8ba8ca4 | ||

|

|

f195847c68 | ||

|

|

5beb13b17e | ||

|

|

7d9ec05062 | ||

|

|

fc604a9eaf | ||

|

|

4f3c1ad9b6 | ||

|

|

6d45ed586c | ||

|

|

1afb633b4f | ||

|

|

34d9f9174b | ||

|

|

3b0c208eff | ||

|

|

05022f8db4 | ||

|

|

3336de457a | ||

|

|

10a27bc29c | ||

|

|

542e5d3c2d | ||

|

|

7372617b14 | ||

|

|

89735a130b | ||

|

|

859cf74bd6 | ||

|

|

e2744ab399 | ||

|

|

16bd065098 | ||

|

|

71c52e6dd7 | ||

|

|

a7f8c3ced3 | ||

|

|

f3f0432c65 | ||

|

|

426ba2d150 | ||

|

|

2790099efa | ||

|

|

f6ba8bc95e | ||

|

|

d6181522c0 | ||

|

|

04cf071ca6 | ||

|

|

e4371b5d02 | ||

|

|

52c52b2a0d | ||

|

|

8f40f10575 | ||

|

|

fe0f6fcd0b | ||

|

|

31b1ad8bb4 | ||

|

|

373680d854 | ||

|

|

9e3bc80495 | ||

|

|

89405fe003 | ||

|

|

b9ea3865a5 | ||

|

|

b5bd643814 | ||

|

|

52ccaeffd5 | ||

|

|

18136c12fd | ||

|

|

dec3f9e75e | ||

|

|

ccc0ee4d18 | ||

|

|

69e9708080 | ||

|

|

5944ba099a | ||

|

|

ada2718b5e | ||

|

|

1f87bd63e7 | ||

|

|

c0f3259cf6 | ||

|

|

e1d5749a40 | ||

|

|

a8d7eb27d9 | ||

|

|

1eecdf3829 | ||

|

|

be8b345889 | ||

|

|

074da389b3 | ||

|

|

4df2dc09fe | ||

|

|

e8d42ba074 | ||

|

|

c036483680 | ||

|

|

2818584db6 | ||

|

|

37585f760d | ||

|

|

f5477a03a1 | ||

|

|

50388425b2 | ||

|

|

725c59eab0 | ||

|

|

7bf1de29a4 | ||

|

|

d90c3fc7dd | ||

|

|

80785ce072 | ||

|

|

44ea896de8 | ||

|

|

d30cb8a0f0 | ||

|

|

6c7b333b34 | ||

|

|

6d34a00e77 | ||

|

|

1f353e10ce | ||

|

|

4e10f8d1c5 | ||

|

|

a22cd853fc | ||

|

|

354e0d6a87 | ||

|

|

dfabe28645 | ||

|

|

fce230da48 | ||

|

|

055ba9bda6 | ||

|

|

ec19c3b4dd | ||

|

|

37aa526404 | ||

|

|

86c1faa40f | ||

|

|

8dcf15d0f9 | ||

|

|

6835e1e680 | ||

|

|

d8f89b8f67 | ||

|

|

ec28eba781 | ||

|

|

5ef8fff5bc | ||

|

|

4f317b76fa | ||

|

|

61672637dc | ||

|

|

ecf6e8f664 | ||

|

|

4115975320 | ||

|

|

21904a8609 | ||

|

|

10b0a3dabb | ||

|

|

b2091e9aed | ||

|

|

f2cb5bd77c | ||

|

|

19c61c52e6 | ||

|

|

b327359183 | ||

|

|

9e9bb72e17 | ||

|

|

a23907e009 | ||

|

|

ad131f5a2c | ||

|

|

dbeae4ca68 | ||

|

|

0fb0e94848 | ||

|

|

95d2a82d35 | ||

|

|

5bc6eb6774 | ||

|

|

3ba81e9aaa | ||

|

|

329a9b59c1 | ||

|

|

39cccd568e | ||

|

|

19b7f6ad8c | ||

|

|

41c000cf47 | ||

|

|

1b8ea61e87 | ||

|

|

22c26e24b1 | ||

|

|

396045177c | ||

|

|

4538593236 | ||

|

|

8086ef355b | ||

|

|

60d038fe46 | ||

|

|

ff0f4463be | ||

|

|

820571d993 | ||

|

|

e311d3767c | ||

|

|

24d7b80244 | ||

|

|

61f99e4d2e | ||

|

|

d5348bcf49 | ||

|

|

5d31d66365 | ||

|

|

29778a0154 | ||

|

|

165c0a5866 | ||

|

|

588323961e | ||

|

|

fd1c0b71c5 | ||

|

|

54fbdcadf9 | ||

|

|

69a30d0cf0 | ||

|

|

b8f9b44f38 | ||

|

|

cbf17d4eb5 | ||

|

|

327e025262 | ||

|

|

6b1e944bba | ||

|

|

668ed4d61b | ||

|

|

312c0584ed | ||

|

|

110d3acb58 | ||

|

|

ddbc60283b | ||

|

|

471bcecfd6 | ||

|

|

0245791b13 | ||

|

|

4794396ce8 | ||

|

|

c7088779d6 | ||

|

|

672905da12 | ||

|

|

47172b13be | ||

|

|

3668a10af6 | ||

|

|

a4e294c03f | ||

|

|

3fd6f4003f | ||

|

|

3eaf5cd530 | ||

|

|

c344fd8ca4 | ||

|

|

09639ca294 | ||

|

|

a81b6dca83 | ||

|

|

b74aefb08f | ||

|

|

fffc0c3add | ||

|

|

757f90aa7a | ||

|

|

022f9eb551 | ||

|

|

6e7b82cfcb | ||

|

|

b5fb24b360 | ||

|

|

b77345222c | ||

|

|

793e81406e | ||

|

|

cef1ec95d2 | ||

|

|

7e1b3c552b | ||

|

|

69736a63b6 | ||

|

|

fb4a9f9056 | ||

|

|

387d89d3af | ||

|

|

65d9ca9d39 | ||

|

|

8c842af4ba | ||

|

|

4faf9262c9 | ||

|

|

be7724c67d | ||

|

|

48d26347f7 | ||

|

|

bdb01ec8b5 | ||

|

|

9047815799 | ||

|

|

05bd94a2cc | ||

|

|

c9f7da84d0 | ||

|

|

bcc124e86a | ||

|

|

48d2733403 | ||

|

|

31fc6e4e56 | ||

|

|

fcdeef0146 | ||

|

|

1cd524c0cc | ||

|

|

0f746917a7 | ||

|

|

a2228d0169 | ||

|

|

e8a679d34b | ||

|

|

1912a42091 | ||

|

|

ca81f96635 | ||

|

|

eb3b8c4b31 | ||

|

|

6740d6d60b | ||

|

|

c46c35b248 | ||

|

|

0b2dcec4bc | ||

|

|

f8e2a4aff4 | ||

|

|

7256db8c4e | ||

|

|

b14d5d9bee | ||

|

|

12e15c3e4b | ||

|

|

51911bf272 | ||

|

|

6dc8061401 | ||

|

|

b8fa4f8797 | ||

|

|

cc0bea7f45 | ||

|

|

4e9124b244 | ||

|

|

f0eabef7b0 | ||

|

|

23e5557958 | ||

|

|

b1d02afa85 | ||

|

|

2edc380f47 | ||

|

|

cea8295c09 | ||

|

|

244bfc993a | ||

|

|

3a272a4493 | ||

|

|

a3300db770 | ||

|

|

b0394ce261 | ||

|

|

3123089790 | ||

|

|

f13cf66676 | ||

|

|

0c8c4d87fb | ||

|

|

066088fdeb | ||

|

|

cf641e41c7 | ||

|

|

5b48322e1b | ||

|

|

9d3f680d58 | ||

|

|

bed28d57e6 | ||

|

|

2538525103 | ||

|

|

6ed798db8c | ||

|

|

8e9d966829 | ||

|

|

be16640f92 | ||

|

|

0e1376dd2e | ||

|

|

0494575aa7 | ||

|

|

bed57534e0 | ||

|

|

1862d631d1 | ||

|

|

c977ce5690 | ||

|

|

84df377516 | ||

|

|

4d9a284f6e | ||

|

|

da7ad8b44a | ||

|

|

4164046323 | ||

|

|

72e743dfd1 | ||

|

|

7eb7edaf0a | ||

|

|

49368aaf76 | ||

|

|

b8c07a966f | ||

|

|

c6bcc0e3aa | ||

|

|

7719339f23 | ||

|

|

8ad64722ed | ||

|

|

611f8b8865 | ||

|

|

38bdc173e8 | ||

|

|

52244325d9 | ||

|

|

3fd3d99b8c | ||

|

|

d4ee5e91a2 | ||

|

|

c2ad2d7238 | ||

|

|

892e195f0e | ||

|

|

c5b1bed7dc | ||

|

|

0e388d7aa7 | ||

|

|

c3a0dbbe48 | ||

|

|

8b95b3ffc7 | ||

|

|

42b78461cd | ||

|

|

9190a41ca5 | ||

|

|

28a7251319 | ||

|

|

20565866ef | ||

|

|

246f10aee5 | ||

|

|

960017280d | ||

|

|

7218aaf52e | ||

|

|

62050cc7b6 | ||

|

|

f88a14ac0a | ||

|

|

9286761c30 | ||

|

|

07c3273247 | ||

|

|

eb8fe77582 | ||

|

|

b68ba0bff6 | ||

|

|

696657c09e | ||

|

|

12bea9b60a | ||

|

|

9334e9552f | ||

|

|

a43b04a98b | ||

|

|

f359ff995d | ||

|

|

9185d2646b | ||

|

|

33e61c762c | ||

|

|

e342e646ff | ||

|

|

ed163a80e0 | ||

|

|

b390df08b5 | ||

|

|

f0b3b9f7f4 | ||

|

|

a67d732507 | ||

|

|

ca0ebe0d75 | ||

|

|

94d113cbe0 | ||

|

|

25c3aeaa5f | ||

|

|

736d5a00b7 | ||

|

|

f1627b214c | ||

|

|

d9265ec7ea | ||

|

|

663e871bed | ||

|

|

5c5eaddef7 | ||

|

|

edaec4f1ae | ||

|

|

6d19acaa6c | ||

|

|

d29a619fbf | ||

|

|

b17808dd91 | ||

|

|

c5321a3667 | ||

|

|

8836691510 | ||

|

|

6568f6525d | ||

|

|

473fc27b49 | ||

|

|

74aeb55acb | ||

|

|

8efcf0529f | ||

|

|

06071c2f9c | ||

|

|

5eb4eca487 | ||

|

|

33f6153e12 | ||

|

|

df3283f526 | ||

|

|

b5901a2819 | ||

|

|

6d5f1402fe | ||

|

|

65e3782b2e | ||

|

|

135981dd30 | ||

|

|

fe5cf2d922 | ||

|

|

e15425cc2e | ||

|

|

c3cb0a4e33 | ||

|

|

cc32976bdd | ||

|

|

bc08318716 | ||

|

|

ee1ab30c2c | ||

|

|

7fa1a66f7e | ||

|

|

946bf37406 | ||

|

|

8706f6931a | ||

|

|

f551674860 | ||

|

|

d90fe0ef07 | ||

|

|

bf979fa3b3 | ||

|

|

b3b88891e9 | ||

|

|

01c5de60dc | ||

|

|

47b8fe5022 | ||

|

|

324b37b875 | ||

|

|

76e7e192d8 | ||

|

|

f9f3c4d923 | ||

|

|

a476476bd1 | ||

|

|

82a60a884a | ||

|

|

f17727de18 | ||

|

|

f1f33c79f4 | ||

|

|

d52eaafdbb | ||

|

|

e7a3e50ed1 | ||

|

|

2e09a87baa | ||

|

|

b92ae7e47e | ||

|

|

f98446e139 | ||

|

|

57a48dadaa | ||

|

|

c65ec68e46 | ||

|

|

d6559be3fc | ||

|

|

6fbf67f9a9 | ||

|

|

59df5b24fe | ||

|

|

3e1544294b | ||

|

|

a12c398816 | ||

|

|

0bd3e28348 | ||

|

|

ad4e39c088 | ||

|

|

2668d96e6a | ||

|

|

357c496aad | ||

|

|

22a513ba22 | ||

|

|

e6dd1119be | ||

|

|

2dbe454e04 | ||

|

|

e3a59b76eb | ||

|

|

01008acfcd | ||

|

|

b67a162d3f | ||

|

|

8bfde9fbaf | ||

|

|

1fdecf8def | ||

|

|

1141d4b833 | ||

|

|

cdac92ca7b | ||

|

|

2a57c260cc | ||

|

|

f41e29ab3a | ||

|

|

8f10624073 | ||

|

|

eb1f8be11e | ||

|

|

3333501ab9 | ||

|

|

0f40820315 | ||

|

|

5f1a839620 | ||

|

|

b9bb1c775d | ||

|

|

1059b7376b | ||

|

|

f38ab4a9ce | ||

|

|

9e7450c012 | ||

|

|

99a3e360fe | ||

|

|

d45f8f78d6 | ||

|

|

648af61116 | ||

|

|

eebf1b89b1 | ||

|

|

f8094bb624 | ||

|

|

ed13e0d2c2 | ||

|

|

aa830589b4 | ||

|

|

999a2bd929 | ||

|

|

d69ee98450 | ||

|

|

f6712c24ad | ||

|

|

89d2772194 | ||

|

|

03352142b6 | ||

|

|

73a51e0c00 | ||

|

|

2e26f8caa6 | ||

|

|

f9bcce9e43 | ||

|

|

2ecc877ba8 | ||

|

|

3f8a3c69e3 | ||

|

|

67c37a0984 | ||

|

|

a58a55d00d | ||

|

|

06d51dd0b8 | ||

|

|

d5db028f57 | ||

|

|

fcb85ff4be | ||

|

|

3695b4363d | ||

|

|

cb11e6437c | ||

|

|

5127bd11ce | ||

|

|

91f90aefa1 | ||

|

|

0a067bce36 | ||

|

|

f0aba433bf | ||

|

|

f06467a0e3 | ||

|

|

68bcd3c710 | ||

|

|

a645733cc5 | ||

|

|

49fe5baf94 | ||

|

|

411ee55653 | ||

|

|

e351ce7411 | ||

|

|

f33e585a71 | ||

|

|

77f3096e0d | ||

|

|

9a5b18c4e6 | ||

|

|

0c7112869a | ||

|

|

f66a4d71ea | ||

|

|

9b0ab878df | ||

|

|

d30b90dfd0 | ||

|

|

efd28f8c27 | ||

|

|

e05e722387 | ||

|

|

748e81956d | ||

|

|

c9a41febce | ||

|

|

18e244b756 | ||

|

|

47676139a3 | ||

|

|

1ed933b7ad | ||

|

|

f6a343ccd6 | ||

|

|

dd6cdc22e5 | ||

|

|

f70f4348b3 | ||

|

|

ec7f801929 | ||

|

|

0f8aca382e | ||

|

|

0270f77eaa | ||

|

|

dcba71ada4 | ||

|

|

6080f76a9c | ||

|

|

e7349161f3 | ||

|

|

2e2907ea09 | ||

|

|

25e84b2a6c | ||

|

|

5efd424172 | ||

|

|

2672502c07 | ||

|

|

83440cc3d9 | ||

|

|

8e5f93be1c | ||

|

|

c1afc07955 | ||

|

|

4a83e14878 | ||

|

|

832320abc6 | ||

|

|

70c237da72 | ||

|

|

edfcc5c023 | ||

|

|

0668debec6 | ||

|

|

02d6463faa | ||

|

|

1fdb85234c | ||

|

|

44b7dd1808 | ||

|

|

e983ee3101 | ||

|

|

75e7e81c05 | ||

|

|

31ce3b9c08 | ||

|

|

ed93c50fef | ||

|

|

4845660eb5 | ||

|

|

c7919210a2 | ||

|

|

9491418f3b | ||

|

|

e8de403286 | ||

|

|

dfb625377b | ||

|

|

2c0f2a8be6 | ||

|

|

787d3cb3e9 | ||

|

|

96ca17d26c | ||

|

|

3dd0f7f2c3 | ||

|

|

10ba0cf976 | ||

|

|

276c15cc23 | ||

|

|

2584b848ad | ||

|

|

6471efed5f | ||

|

|

5b7d7ad65d | ||

|

|

712851a8a5 | ||

|

|

63d291cb47 | ||

|

|

f825c92111 | ||

|

|

419eb2ea41 | ||

|

|

89b58dd64e | ||

|

|

6bc5f81440 | ||

|

|

424f4b7b5e | ||

|

|

9271a1caac | ||

|

|

0ee4df03f9 | ||

|

|

8ac713ce32 | ||

|

|

76b2489fe9 | ||

|

|

6786095154 | ||

|

|

2c5793ef37 | ||

|

|

d483f25b96 | ||

|

|

7118368979 | ||

|

|

59256c2e80 | ||

|

|

1fb8a0db1e | ||

|

|

07d0c8e8fa | ||

|

|

98452ead17 | ||

|

|

d8c9f40377 | ||

|

|

8148d5eec6 | ||

|

|

4c429ad604 | ||

|

|

a9c52de8d5 | ||

|

|

f648aa1f91 | ||

|

|

eaba388bdd | ||

|

|

73e6afcbc6 | ||

|

|

8c3b72adf2 | ||

|

|

ae18ff4262 | ||

|

|

1adc8af543 | ||

|

|

7413df6f1e | ||

|

|

bda8559190 | ||

|

|

b74612fa41 | ||

|

|

22e0c20dcd | ||

|

|

08f92e1100 | ||

|

|

bb12ece46e | ||

|

|

0065438305 | ||

|

|

7f115c1b3e | ||

|

|

4e0114ab0d | ||

|

|

0ef64fa4bd | ||

|

|

84dbc17c22 | ||

|

|

16e16e356d | ||

|

|

978ee885c4 | ||

|

|

850d43df63 | ||

|

|

fc109fd1b1 | ||

|

|

9aefc55534 | ||

|

|

2829947b93 | ||

|

|

0c2af89a1c | ||

|

|

14c2dc9624 | ||

|

|

4f35d710a6 | ||

|

|

fdb5e018e5 | ||

|

|

6001fde25c | ||

|

|

ae63c0adaf | ||

|

|

ad1539c8f6 | ||

|

|

634a0c8cd0 | ||

|

|

773f9a0c63 | ||

|

|

e4e320e9e3 | ||

|

|

3b4b400e6b | ||

|

|

a950be2d95 | ||

|

|

ba6f5ab984 | ||

|

|

f3a5e3f5ed | ||

|

|

e685e621f3 | ||

|

|

2cd2be9b67 | ||

|

|

e73d9e8a03 | ||

|

|

476f74a604 | ||

|

|

ab0d1d99e6 | ||

|

|

d5680ffd5d | ||

|

|

3c091a88d4 | ||

|

|

49b70b33de | ||

|

|

c5ff2716fb | ||

|

|

400fdf0896 | ||

|

|

cbb8c7323c | ||

|

|

60e79f8f77 | ||

|

|

0e829d739a | ||

|

|

62abb274e0 | ||

|

|

e4028785de | ||

|

|

2bb44bcb76 | ||

|

|

684599f81b | ||

|

|

b56d28f5df | ||

|

|

02b9ac04c8 | ||

|

|

2fc283990a | ||

|

|

abb652ebd5 | ||

|

|

55786cb7f7 | ||

|

|

447a575f4f | ||

|

|

49280a8617 | ||

|

|

ff78a9cc35 | ||

|

|

3fea5c9c8c | ||

|

|

aea63cad52 | ||

|

|

800abe9920 | ||

|

|

dd6069e41a | ||

|

|

90d31aeff0 | ||

|

|

4d9a327b1f | ||

|

|

06a97ef076 | ||

|

|

76c2477387 | ||

|

|

bc4dac9cad | ||

|

|

36e3d6c18a | ||

|

|

edfd84a8e3 | ||

|

|

fb20cf6069 | ||

|

|

abbe47f6b9 | ||

|

|

f84d250134 | ||

|

|

3ffb4b8990 | ||

|

|

f70cfabede | ||

|

|

3a81783d77 | ||

|

|

237a4a90ff | ||

|

|

99c7dfc98d | ||

|

|

48aba34370 | ||

|

|

29cca36f2c | ||

|

|

0f5819f5c2 | ||

|

|

373772de2d | ||

|

|

7f5bbe8b5f | ||

|

|

daee57167b | ||

|

|

03467196b9 | ||

|

|

d3f3531cdb | ||

|

|

883b694592 | ||

|

|

6c89d66af9 | ||

|

|

fb0a76b418 | ||

|

|

64f77fca5b | ||

|

|

b1fca2c5be | ||

|

|

108d705f09 | ||

|

|

a77242e66c | ||

|

|

8b153113ff | ||

|

|

6d0ec37135 |

51

.github/ISSUE_TEMPLATE/bug_report.md

vendored

Normal file

@@ -0,0 +1,51 @@

|

|||||||

|

---

|

||||||

|

name: 报告Bug

|

||||||

|

about: 报告KnowStreaming的相关Bug

|

||||||

|

title: ''

|

||||||

|

labels: bug

|

||||||

|

assignees: ''

|

||||||

|

|

||||||

|

---

|

||||||

|

|

||||||

|

- [ ] 我已经在 [issues](https://github.com/didi/KnowStreaming/issues) 搜索过相关问题了,并没有重复的。

|

||||||

|

|

||||||

|

你是否希望来认领这个Bug。

|

||||||

|

|

||||||

|

「 Y / N 」

|

||||||

|

|

||||||

|

### 环境信息

|

||||||

|

|

||||||

|

* KnowStreaming version : <font size=4 color =red> xxx </font>

|

||||||

|

* Operating System version : <font size=4 color =red> xxx </font>

|

||||||

|

* Java version : <font size=4 color =red> xxx </font>

|

||||||

|

|

||||||

|

|

||||||

|

### 重现该问题的步骤

|

||||||

|

|

||||||

|

1. xxx

|

||||||

|

|

||||||

|

|

||||||

|

|

||||||

|

2. xxx

|

||||||

|

|

||||||

|

|

||||||

|

3. xxx

|

||||||

|

|

||||||

|

|

||||||

|

|

||||||

|

### 预期结果

|

||||||

|

|

||||||

|

<!-- 写下应该出现的预期结果?-->

|

||||||

|

|

||||||

|

### 实际结果

|

||||||

|

|

||||||

|

<!-- 实际发生了什么? -->

|

||||||

|

|

||||||

|

|

||||||

|

---

|

||||||

|

|

||||||

|

如果有异常,请附上异常Trace:

|

||||||

|

|

||||||

|

```

|

||||||

|

Just put your stack trace here!

|

||||||

|

```

|

||||||

8

.github/ISSUE_TEMPLATE/config.yml

vendored

Normal file

@@ -0,0 +1,8 @@

|

|||||||

|

blank_issues_enabled: true

|

||||||

|

contact_links:

|

||||||

|

- name: 讨论问题

|

||||||

|

url: https://github.com/didi/KnowStreaming/discussions/new

|

||||||

|

about: 发起问题、讨论 等等

|

||||||

|

- name: KnowStreaming官网

|

||||||

|

url: https://knowstreaming.com/

|

||||||

|

about: KnowStreaming website

|

||||||

26

.github/ISSUE_TEMPLATE/detail_optimizing.md

vendored

Normal file

@@ -0,0 +1,26 @@

|

|||||||

|

---

|

||||||

|

name: 优化建议

|

||||||

|

about: 相关功能优化建议

|

||||||

|

title: ''

|

||||||

|

labels: Optimization Suggestions

|

||||||

|

assignees: ''

|

||||||

|

|

||||||

|

---

|

||||||

|

|

||||||

|

- [ ] 我已经在 [issues](https://github.com/didi/KnowStreaming/issues) 搜索过相关问题了,并没有重复的。

|

||||||

|

|

||||||

|

你是否希望来认领这个优化建议。

|

||||||

|

|

||||||

|

「 Y / N 」

|

||||||

|

|

||||||

|

### 环境信息

|

||||||

|

|

||||||

|

* KnowStreaming version : <font size=4 color =red> xxx </font>

|

||||||

|

* Operating System version : <font size=4 color =red> xxx </font>

|

||||||

|

* Java version : <font size=4 color =red> xxx </font>

|

||||||

|

|

||||||

|

### 需要优化的功能点

|

||||||

|

|

||||||

|

|

||||||

|

### 建议如何优化

|

||||||

|

|

||||||

20

.github/ISSUE_TEMPLATE/feature_request.md

vendored

Normal file

@@ -0,0 +1,20 @@

|

|||||||

|

---

|

||||||

|

name: 提议新功能/需求

|

||||||

|

about: 给KnowStreaming提一个功能需求

|

||||||

|

title: ''

|

||||||

|

labels: feature

|

||||||

|

assignees: ''

|

||||||

|

|

||||||

|

---

|

||||||

|

|

||||||

|

- [ ] 我在 [issues](https://github.com/didi/KnowStreaming/issues) 中并未搜索到与此相关的功能需求。

|

||||||

|

- [ ] 我在 [release note](https://github.com/didi/KnowStreaming/releases) 已经发布的版本中并没有搜到相关功能.

|

||||||

|

|

||||||

|

你是否希望来认领这个Feature。

|

||||||

|

|

||||||

|

「 Y / N 」

|

||||||

|

|

||||||

|

|

||||||

|

## 这里描述需求

|

||||||

|

<!--请尽可能的描述清楚您的需求 -->

|

||||||

|

|

||||||

12

.github/ISSUE_TEMPLATE/question.md

vendored

Normal file

@@ -0,0 +1,12 @@

|

|||||||

|

---

|

||||||

|

name: 提个问题

|

||||||

|

about: 问KnowStreaming相关问题

|

||||||

|

title: ''

|

||||||

|

labels: question

|

||||||

|

assignees: ''

|

||||||

|

|

||||||

|

---

|

||||||

|

|

||||||

|

- [ ] 我已经在 [issues](https://github.com/didi/KnowStreaming/issues) 搜索过相关问题了,并没有重复的。

|

||||||

|

|

||||||

|

## 在这里提出你的问题

|

||||||

22

.github/PULL_REQUEST_TEMPLATE.md

vendored

Normal file

@@ -0,0 +1,22 @@

|

|||||||

|

请不要在没有先创建Issue的情况下创建Pull Request。

|

||||||

|

|

||||||

|

## 变更的目的是什么

|

||||||

|

|

||||||

|

XXXXX

|

||||||

|

|

||||||

|

## 简短的更新日志

|

||||||

|

|

||||||

|

XX

|

||||||

|

|

||||||

|

## 验证这一变化

|

||||||

|

|

||||||

|

XXXX

|

||||||

|

|

||||||

|

请遵循此清单,以帮助我们快速轻松地整合您的贡献:

|

||||||

|

|

||||||

|

* [ ] 确保有针对更改提交的 Github issue(通常在您开始处理之前)。诸如拼写错误之类的琐碎更改不需要 Github issue。您的Pull Request应该只解决这个问题,而不需要进行其他更改—— 一个 PR 解决一个问题。

|

||||||

|

* [ ] 格式化 Pull Request 标题,如[ISSUE #123] support Confluent Schema Registry。 Pull Request 中的每个提交都应该有一个有意义的主题行和正文。

|

||||||

|

* [ ] 编写足够详细的Pull Request描述,以了解Pull Request的作用、方式和原因。

|

||||||

|

* [ ] 编写必要的单元测试来验证您的逻辑更正。如果提交了新功能或重大更改,请记住在test 模块中添加 integration-test

|

||||||

|

* [ ] 确保编译通过,集成测试通过

|

||||||

|

|

||||||

224

.gitignore

vendored

@@ -1,112 +1,112 @@

|

|||||||

### Intellij ###

|

### Intellij ###

|

||||||

# Covers JetBrains IDEs: IntelliJ, RubyMine, PhpStorm, AppCode, PyCharm, CLion, Android Studio and Webstorm

|

# Covers JetBrains IDEs: IntelliJ, RubyMine, PhpStorm, AppCode, PyCharm, CLion, Android Studio and Webstorm

|

||||||

|

|

||||||

*.iml

|

*.iml

|

||||||

|

|

||||||

## Directory-based project format:

|

## Directory-based project format:

|

||||||

.idea/

|

.idea/

|

||||||

# if you remove the above rule, at least ignore the following:

|

# if you remove the above rule, at least ignore the following:

|

||||||

|

|

||||||

# User-specific stuff:

|

# User-specific stuff:

|

||||||

# .idea/workspace.xml

|

# .idea/workspace.xml

|

||||||

# .idea/tasks.xml

|

# .idea/tasks.xml

|

||||||

# .idea/dictionaries

|

# .idea/dictionaries

|

||||||

# .idea/shelf

|

# .idea/shelf

|

||||||

|

|

||||||

# Sensitive or high-churn files:

|

# Sensitive or high-churn files:

|

||||||

.idea/dataSources.ids

|

.idea/dataSources.ids

|

||||||

.idea/dataSources.xml

|

.idea/dataSources.xml

|

||||||

.idea/sqlDataSources.xml

|

.idea/sqlDataSources.xml

|

||||||

.idea/dynamic.xml

|

.idea/dynamic.xml

|

||||||

.idea/uiDesigner.xml

|

.idea/uiDesigner.xml

|

||||||

|

|

||||||

|

|

||||||

# Mongo Explorer plugin:

|

# Mongo Explorer plugin:

|

||||||

.idea/mongoSettings.xml

|

.idea/mongoSettings.xml

|

||||||

|

|

||||||

## File-based project format:

|

## File-based project format:

|

||||||

*.ipr

|

*.ipr

|

||||||

*.iws

|

*.iws

|

||||||

|

|

||||||

## Plugin-specific files:

|

## Plugin-specific files:

|

||||||

|

|

||||||

# IntelliJ

|

# IntelliJ

|

||||||

/out/

|

/out/

|

||||||

|

|

||||||

# mpeltonen/sbt-idea plugin

|

# mpeltonen/sbt-idea plugin

|

||||||

.idea_modules/

|

.idea_modules/

|

||||||

|

|

||||||

# JIRA plugin

|

# JIRA plugin

|

||||||

atlassian-ide-plugin.xml

|

atlassian-ide-plugin.xml

|

||||||

|

|

||||||

# Crashlytics plugin (for Android Studio and IntelliJ)

|

# Crashlytics plugin (for Android Studio and IntelliJ)

|

||||||

com_crashlytics_export_strings.xml

|

com_crashlytics_export_strings.xml

|

||||||

crashlytics.properties

|

crashlytics.properties

|

||||||

crashlytics-build.properties

|

crashlytics-build.properties

|

||||||

fabric.properties

|

fabric.properties

|

||||||

|

|

||||||

|

|

||||||

### Java ###

|

### Java ###

|

||||||

*.class

|

*.class

|

||||||

|

|

||||||

# Mobile Tools for Java (J2ME)

|

# Mobile Tools for Java (J2ME)

|

||||||

.mtj.tmp/

|

.mtj.tmp/

|

||||||

|

|

||||||

# Package Files #

|

# Package Files #

|

||||||

*.jar

|

*.jar

|

||||||

*.war

|

*.war

|

||||||

*.ear

|

*.ear

|

||||||

|

*.tar.gz

|

||||||

# virtual machine crash logs, see http://www.java.com/en/download/help/error_hotspot.xml

|

|

||||||

hs_err_pid*

|

# virtual machine crash logs, see http://www.java.com/en/download/help/error_hotspot.xml

|

||||||

|

hs_err_pid*

|

||||||

|

|

||||||

### OSX ###

|

|

||||||

.DS_Store

|

### OSX ###

|

||||||

.AppleDouble

|

.DS_Store

|

||||||

.LSOverride

|

.AppleDouble

|

||||||

|

.LSOverride

|

||||||

# Icon must end with two \r

|

|

||||||

Icon

|

# Icon must end with two \r

|

||||||

|

Icon

|

||||||

|

|

||||||

# Thumbnails

|

|

||||||

._*

|

# Thumbnails

|

||||||

|

._*

|

||||||

# Files that might appear in the root of a volume

|

|

||||||

.DocumentRevisions-V100

|

# Files that might appear in the root of a volume

|

||||||

.fseventsd

|

.DocumentRevisions-V100

|

||||||

.Spotlight-V100

|

.fseventsd

|

||||||

.TemporaryItems

|

.Spotlight-V100

|

||||||

.Trashes

|

.TemporaryItems

|

||||||

.VolumeIcon.icns

|

.Trashes

|

||||||

|

.VolumeIcon.icns

|

||||||

# Directories potentially created on remote AFP share

|

|

||||||

.AppleDB

|

# Directories potentially created on remote AFP share

|

||||||

.AppleDesktop

|

.AppleDB

|

||||||

Network Trash Folder

|

.AppleDesktop

|

||||||

Temporary Items

|

Network Trash Folder

|

||||||

.apdisk

|

Temporary Items

|

||||||

|

.apdisk

|

||||||

/target

|

|

||||||

target/

|

/target

|

||||||

*.log

|

target/

|

||||||

*.log.*

|

*.log

|

||||||

*.bak

|

*.log.*

|

||||||

*.vscode

|

*.bak

|

||||||

*/.vscode/*

|

*.vscode

|

||||||

*/.vscode

|

*/.vscode/*

|

||||||

*/velocity.log*

|

*/.vscode

|

||||||

*/*.log

|

*/velocity.log*

|

||||||

*/*.log.*

|

*/*.log

|

||||||

web/node_modules/

|

*/*.log.*

|

||||||

web/node_modules/*

|

node_modules/

|

||||||

workspace.xml

|

node_modules/*

|

||||||

/output/*

|

workspace.xml

|

||||||

.gitversion

|

/output/*

|

||||||

*/node_modules/*

|

.gitversion

|

||||||

web/src/main/resources/templates/*

|

out/*

|

||||||

*/out/*

|

dist/

|

||||||

*/dist/*

|

dist/*

|

||||||

.DS_Store

|

km-rest/src/main/resources/templates/

|

||||||

kafka-manager-web/src/main/resources/templates/*

|

*dependency-reduced-pom*

|

||||||

74

CODE_OF_CONDUCT.md

Normal file

@@ -0,0 +1,74 @@

|

|||||||

|

|

||||||

|

# Contributor Covenant Code of Conduct

|

||||||

|

|

||||||

|

## Our Pledge

|

||||||

|

|

||||||

|

In the interest of fostering an open and welcoming environment, we as

|

||||||

|

contributors and maintainers pledge to making participation in our project and

|

||||||

|

our community a harassment-free experience for everyone, regardless of age, body

|

||||||

|

size, disability, ethnicity, gender identity and expression, level of experience,

|

||||||

|

education, socio-economic status, nationality, personal appearance, race,

|

||||||

|

religion, or sexual identity and orientation.

|

||||||

|

|

||||||

|

## Our Standards

|

||||||

|

|

||||||

|

Examples of behavior that contributes to creating a positive environment

|

||||||

|

include:

|

||||||

|

|

||||||

|

* Using welcoming and inclusive language

|

||||||

|

* Being respectful of differing viewpoints and experiences

|

||||||

|

* Gracefully accepting constructive criticism

|

||||||

|

* Focusing on what is best for the community

|

||||||

|

* Showing empathy towards other community members

|

||||||

|

|

||||||

|

Examples of unacceptable behavior by participants include:

|

||||||

|

|

||||||

|

* The use of sexualized language or imagery and unwelcome sexual attention or

|

||||||

|

advances

|

||||||

|

* Trolling, insulting/derogatory comments, and personal or political attacks

|

||||||

|

* Public or private harassment

|

||||||

|

* Publishing others' private information, such as a physical or electronic

|

||||||

|

address, without explicit permission

|

||||||

|

* Other conduct which could reasonably be considered inappropriate in a

|

||||||

|

professional setting

|

||||||

|

|

||||||

|

## Our Responsibilities

|

||||||

|

|

||||||

|

Project maintainers are responsible for clarifying the standards of acceptable

|

||||||

|

behavior and are expected to take appropriate and fair corrective action in

|

||||||

|

response to any instances of unacceptable behavior.

|

||||||

|

|

||||||

|

Project maintainers have the right and responsibility to remove, edit, or

|

||||||

|

reject comments, commits, code, wiki edits, issues, and other contributions

|

||||||

|

that are not aligned to this Code of Conduct, or to ban temporarily or

|

||||||

|

permanently any contributor for other behaviors that they deem inappropriate,

|

||||||

|

threatening, offensive, or harmful.

|

||||||

|

|

||||||

|

## Scope

|

||||||

|

|

||||||

|

This Code of Conduct applies both within project spaces and in public spaces

|

||||||

|

when an individual is representing the project or its community. Examples of

|

||||||

|

representing a project or community include using an official project e-mail

|

||||||

|

address, posting via an official social media account, or acting as an appointed

|

||||||

|

representative at an online or offline event. Representation of a project may be

|

||||||

|

further defined and clarified by project maintainers.

|

||||||

|

|

||||||

|

## Enforcement

|

||||||

|

|

||||||

|

Instances of abusive, harassing, or otherwise unacceptable behavior may be

|

||||||

|

reported by contacting the project team at shirenchuang@didiglobal.com . All

|

||||||

|

complaints will be reviewed and investigated and will result in a response that

|

||||||

|

is deemed necessary and appropriate to the circumstances. The project team is

|

||||||

|

obligated to maintain confidentiality with regard to the reporter of an incident.

|

||||||

|

Further details of specific enforcement policies may be posted separately.

|

||||||

|

|

||||||

|

Project maintainers who do not follow or enforce the Code of Conduct in good

|

||||||

|

faith may face temporary or permanent repercussions as determined by other

|

||||||

|

members of the project's leadership.

|

||||||

|

|

||||||

|

## Attribution

|

||||||

|

|

||||||

|

This Code of Conduct is adapted from the [Contributor Covenant][homepage], version 1.4,

|

||||||

|

available at https://www.contributor-covenant.org/version/1/4/code-of-conduct.html

|

||||||

|

|

||||||

|

[homepage]: https://www.contributor-covenant.org

|

||||||

158

CONTRIBUTING.md

@@ -1,28 +1,150 @@

|

|||||||

# Contribution Guideline

|

|

||||||

|

|

||||||

Thanks for considering to contribute this project. All issues and pull requests are highly appreciated.

|

|

||||||

|

|

||||||

## Pull Requests

|

|

||||||

|

|

||||||

Before sending pull request to this project, please read and follow guidelines below.

|

# 为KnowStreaming做贡献

|

||||||

|

|

||||||

1. Branch: We only accept pull request on `dev` branch.

|

|

||||||

2. Coding style: Follow the coding style used in kafka-manager.

|

|

||||||

3. Commit message: Use English and be aware of your spell.

|

|

||||||

4. Test: Make sure to test your code.

|

|

||||||

|

|

||||||

Add device mode, API version, related log, screenshots and other related information in your pull request if possible.

|

欢迎👏🏻来到KnowStreaming!本文档是关于如何为KnowStreaming做出贡献的指南。

|

||||||

|

|

||||||

NOTE: We assume all your contribution can be licensed under the [Apache License 2.0](LICENSE).

|

如果您发现不正确或遗漏的内容, 请留下意见/建议。

|

||||||

|

|

||||||

## Issues

|

## 行为守则

|

||||||

|

请务必阅读并遵守我们的 [行为准则](./CODE_OF_CONDUCT.md).

|

||||||

|

|

||||||

We love clearly described issues. :)

|

|

||||||

|

|

||||||

Following information can help us to resolve the issue faster.

|

|

||||||

|

|

||||||

* Device mode and hardware information.

|

## 贡献

|

||||||

* API version.

|

|

||||||

* Logs.

|

**KnowStreaming** 欢迎任何角色的新参与者,包括 **User** 、**Contributor**、**Committer**、**PMC** 。

|

||||||

* Screenshots.

|

|

||||||

* Steps to reproduce the issue.

|

我们鼓励新人积极加入 **KnowStreaming** 项目,从User到Contributor、Committer ,甚至是 PMC 角色。

|

||||||

|

|

||||||

|

为了做到这一点,新人需要积极地为 **KnowStreaming** 项目做出贡献。以下介绍如何对 **KnowStreaming** 进行贡献。

|

||||||

|

|

||||||

|

|

||||||

|

### 创建/打开 Issue

|

||||||

|

|

||||||

|

如果您在文档中发现拼写错误、在代码中**发现错误**或想要**新功能**或想要**提供建议**,您可以在 GitHub 上[创建一个Issue](https://github.com/didi/KnowStreaming/issues/new/choose) 进行报告。

|

||||||

|

|

||||||

|

|

||||||

|

如果您想直接贡献, 您可以选择下面标签的问题。

|

||||||

|

|

||||||

|

- [contribution welcome](https://github.com/didi/KnowStreaming/labels/contribution%20welcome) : 非常需要解决/新增 的Issues

|

||||||

|

- [good first issue](https://github.com/didi/KnowStreaming/labels/good%20first%20issue): 对新人比较友好, 新人可以拿这个Issue来练练手热热身。

|

||||||

|

|

||||||

|

<font color=red ><b> 请注意,任何 PR 都必须与有效issue相关联。否则,PR 将被拒绝。</b></font>

|

||||||

|

|

||||||

|

|

||||||

|

|

||||||

|

### 开始你的贡献

|

||||||

|

|

||||||

|

**分支介绍**

|

||||||

|

|

||||||

|

我们将 `dev`分支作为开发分支, 说明这是一个不稳定的分支。

|

||||||

|

|

||||||

|

此外,我们的分支模型符合 [https://nvie.com/posts/a-successful-git-branching-model/](https://nvie.com/posts/a-successful-git-branching-model/). 我们强烈建议新人在创建PR之前先阅读上述文章。

|

||||||

|

|

||||||

|

|

||||||

|

|

||||||

|

**贡献流程**

|

||||||

|

|

||||||

|

为方便描述,我们这里定义一下2个名词:

|

||||||

|

|

||||||

|

自己Fork出来的仓库是私人仓库, 我们这里称之为 :**分叉仓库**

|

||||||

|

Fork的源项目,我们称之为:**源仓库**

|

||||||

|

|

||||||

|

|

||||||

|

现在,如果您准备好创建PR, 以下是贡献者的工作流程:

|

||||||

|

|

||||||

|

1. Fork [KnowStreaming](https://github.com/didi/KnowStreaming) 项目到自己的仓库

|

||||||

|

|

||||||

|

2. 从源仓库的`dev`拉取并创建自己的本地分支,例如: `dev`

|

||||||

|

3. 在本地分支上对代码进行修改

|

||||||

|

4. Rebase 开发分支, 并解决冲突

|

||||||

|

5. commit 并 push 您的更改到您自己的**分叉仓库**

|

||||||

|

6. 创建一个 Pull Request 到**源仓库**的`dev`分支中。

|

||||||

|

7. 等待回复。如果回复的慢,请无情的催促。

|

||||||

|

|

||||||

|

|

||||||

|

更为详细的贡献流程请看:[贡献流程](./docs/contributer_guide/贡献流程.md)

|

||||||

|

|

||||||

|

创建Pull Request时:

|

||||||

|

|

||||||

|

1. 请遵循 PR的 [模板](./.github/PULL_REQUEST_TEMPLATE.md)

|

||||||

|

2. 请确保 PR 有相应的issue。

|

||||||

|

3. 如果您的 PR 包含较大的更改,例如组件重构或新组件,请编写有关其设计和使用的详细文档(在对应的issue中)。

|

||||||

|

4. 注意单个 PR 不能太大。如果需要进行大量更改,最好将更改分成几个单独的 PR。

|

||||||

|

5. 在合并PR之前,尽量的将最终的提交信息清晰简洁, 将多次修改的提交尽可能的合并为一次提交。

|

||||||

|

6. 创建 PR 后,将为PR分配一个或多个reviewers。

|

||||||

|

|

||||||

|

|

||||||

|

<font color=red><b>如果您的 PR 包含较大的更改,例如组件重构或新组件,请编写有关其设计和使用的详细文档。</b></font>

|

||||||

|

|

||||||

|

|

||||||

|

# 代码审查指南

|

||||||

|

|

||||||

|

Commiter将轮流review代码,以确保在合并前至少有一名Commiter

|

||||||

|

|

||||||

|

一些原则:

|

||||||

|

|

||||||

|

- 可读性——重要的代码应该有详细的文档。API 应该有 Javadoc。代码风格应与现有风格保持一致。

|

||||||

|

- 优雅:新的函数、类或组件应该设计得很好。

|

||||||

|

- 可测试性——单元测试用例应该覆盖 80% 的新代码。

|

||||||

|

- 可维护性 - 遵守我们的编码规范。

|

||||||

|

|

||||||

|

|

||||||

|

# 开发者

|

||||||

|

|

||||||

|

## 成为Contributor

|

||||||

|

|

||||||

|

只要成功提交并合并PR , 则为Contributor

|

||||||

|

|

||||||

|

贡献者名单请看:[贡献者名单](./docs/contributer_guide/开发者名单.md)

|

||||||

|

|

||||||

|

## 尝试成为Commiter

|

||||||

|

|

||||||

|

一般来说, 贡献8个重要的补丁并至少让三个不同的人来Review他们(您需要3个Commiter的支持)。

|

||||||

|

然后请人给你提名, 您需要展示您的

|

||||||

|

|

||||||

|

1. 至少8个重要的PR和项目的相关问题

|

||||||

|

2. 与团队合作的能力

|

||||||

|

3. 了解项目的代码库和编码风格

|

||||||

|

4. 编写好代码的能力

|

||||||

|

|

||||||

|

当前的Commiter可以通过在KnowStreaming中的Issue标签 `nomination`(提名)来提名您

|

||||||

|

|

||||||

|

1. 你的名字和姓氏

|

||||||

|

2. 指向您的Git个人资料的链接

|

||||||

|

3. 解释为什么你应该成为Commiter

|

||||||

|

4. 详细说明提名人与您合作的3个PR以及相关问题,这些问题可以证明您的能力。

|

||||||

|

|

||||||

|

另外2个Commiter需要支持您的**提名**,如果5个工作日内没有人反对,您就是提交者,如果有人反对或者想要更多的信息,Commiter会讨论并通常达成共识(5个工作日内) 。

|

||||||

|

|

||||||

|

|

||||||

|

# 开源奖励计划

|

||||||

|

|

||||||

|

|

||||||

|

我们非常欢迎开发者们为KnowStreaming开源项目贡献一份力量,相应也将给予贡献者激励以表认可与感谢。

|

||||||

|

|

||||||

|

|

||||||

|

## 参与贡献

|

||||||

|

|

||||||

|

1. 积极参与 Issue 的讨论,如答疑解惑、提供想法或报告无法解决的错误(Issue)

|

||||||

|

2. 撰写和改进项目的文档(Wiki)

|

||||||

|

3. 提交补丁优化代码(Coding)

|

||||||

|

|

||||||

|

|

||||||

|

## 你将获得

|

||||||

|

|

||||||

|

1. 加入KnowStreaming开源项目贡献者名单并展示

|

||||||

|

2. KnowStreaming开源贡献者证书(纸质&电子版)

|

||||||

|

3. KnowStreaming贡献者精美大礼包(KnowStreamin/滴滴 周边)

|

||||||

|

|

||||||

|

|

||||||

|

## 相关规则

|

||||||

|

|

||||||

|

- Contributer和Commiter都会有对应的证书和对应的礼包

|

||||||

|

- 每季度有KnowStreaming项目团队评选出杰出贡献者,颁发相应证书。

|

||||||

|

- 年末进行年度评选

|

||||||

|

|

||||||

|

贡献者名单请看:[贡献者名单](./docs/contributer_guide/开发者名单.md)

|

||||||

221

README.md

@@ -1,64 +1,157 @@

|

|||||||

|

|

||||||

---

|

<p align="center">

|

||||||

|

<img src="https://user-images.githubusercontent.com/71620349/185368586-aed82d30-1534-453d-86ff-ecfa9d0f35bd.png" width = "256" div align=center />

|

||||||

|

|

||||||

|

</p>

|

||||||

**一站式`Apache Kafka`集群指标监控与运维管控平台**

|

|

||||||

|

<p align="center">

|

||||||

---

|

<a href="https://knowstreaming.com">产品官网</a> |

|

||||||

|

<a href="https://github.com/didi/KnowStreaming/releases">下载地址</a> |

|

||||||

## 主要功能特性

|

<a href="https://doc.knowstreaming.com/product">文档资源</a> |

|

||||||

|

<a href="https://demo.knowstreaming.com">体验环境</a>

|

||||||

|

</p>

|

||||||

### 集群监控维度

|

|

||||||

|

<p align="center">

|

||||||

- 多版本集群管控,支持从`0.10.2`到`2.x`版本;

|

<!--最近一次提交时间-->

|

||||||

- 集群Topic、Broker等多维度历史与实时关键指标查看;

|

<a href="https://img.shields.io/github/last-commit/didi/KnowStreaming">

|

||||||

|

<img src="https://img.shields.io/github/last-commit/didi/KnowStreaming" alt="LastCommit">

|

||||||

|

</a>

|

||||||

### 集群管控维度

|

|

||||||

|

<!--最新版本-->

|

||||||

- 集群运维,包括逻辑Region方式管理集群

|

<a href="https://github.com/didi/KnowStreaming/blob/master/LICENSE">

|

||||||

- Broker运维,包括优先副本选举

|

<img src="https://img.shields.io/github/v/release/didi/KnowStreaming" alt="License">

|

||||||

- Topic运维,包括创建、查询、扩容、修改属性、数据采样及迁移等;

|

</a>

|

||||||

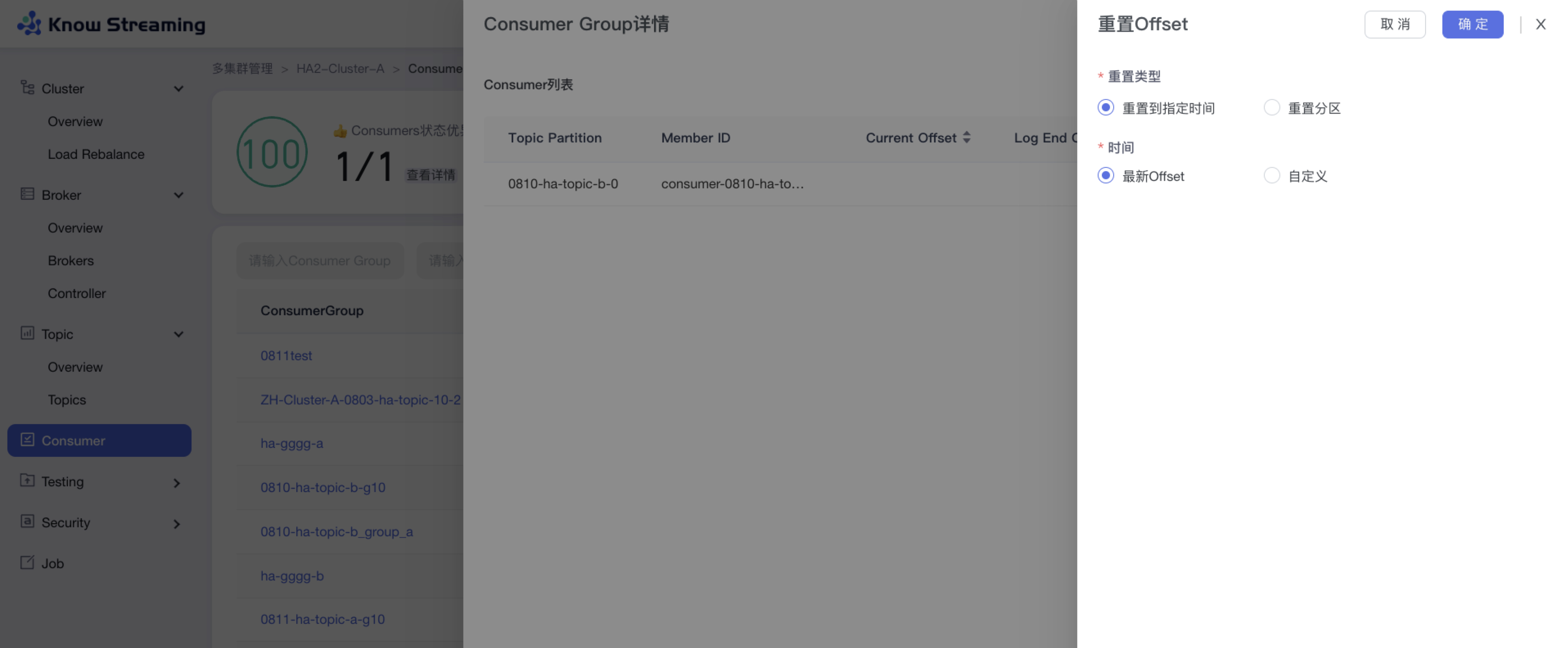

- 消费组运维,包括指定时间或指定偏移两种方式进行重置消费偏移

|

|

||||||

|

<!--License信息-->

|

||||||

|

<a href="https://github.com/didi/KnowStreaming/blob/master/LICENSE">

|

||||||

### 用户使用维度

|

<img src="https://img.shields.io/github/license/didi/KnowStreaming" alt="License">

|

||||||

|

</a>

|

||||||

- Kafka用户、Kafka研发、Kafka运维 视角区分

|

|

||||||

- Kafka用户、Kafka研发、Kafka运维 权限区分

|

<!--Open-Issue-->

|

||||||

|

<a href="https://github.com/didi/KnowStreaming/issues">

|

||||||

|

<img src="https://img.shields.io/github/issues-raw/didi/KnowStreaming" alt="Issues">

|

||||||

## kafka-manager架构图

|

</a>

|

||||||

|

|

||||||

|

<!--知识星球-->

|

||||||

|

<a href="https://z.didi.cn/5gSF9">

|

||||||

|

<img src="https://img.shields.io/badge/join-%E7%9F%A5%E8%AF%86%E6%98%9F%E7%90%83-red" alt="Slack">

|

||||||

## 相关文档

|

</a>

|

||||||

|

|

||||||

- [kafka-manager安装手册](./docs/install_cn_guide.md)

|

</p>

|

||||||

- [kafka-manager接入集群](./docs/manual_kafka_op/add_cluster.md)

|

|

||||||

- [kafka-manager使用手册-待更新](./docs/user_cn_guide.md)

|

|

||||||

|

---

|

||||||

|

|

||||||

## 钉钉交流群

|

|

||||||

|

## `Know Streaming` 简介

|

||||||

|

|

||||||

|

`Know Streaming`是一套云原生的Kafka管控平台,脱胎于众多互联网内部多年的Kafka运营实践经验,专注于Kafka运维管控、监控告警、资源治理、多活容灾等核心场景。在用户体验、监控、运维管控上进行了平台化、可视化、智能化的建设,提供一系列特色的功能,极大地方便了用户和运维人员的日常使用,让普通运维人员都能成为Kafka专家。

|

||||||

|

|

||||||

## 项目成员

|

我们现在正在收集 Know Streaming 用户信息,以帮助我们进一步改进 Know Streaming。

|

||||||

|

请在 [issue#663](https://github.com/didi/KnowStreaming/issues/663) 上提供您的使用信息来支持我们:[谁在使用 Know Streaming](https://github.com/didi/KnowStreaming/issues/663)

|

||||||

### 内部核心人员

|

|

||||||

|

|

||||||

`iceyuhui`、`liuyaguang`、`limengmonty`、`zhangliangmike`、`nullhuangyiming`、`zengqiao`、`eilenexuzhe`、`huangjiaweihjw`

|

|

||||||

|

整体具有以下特点:

|

||||||

|

|

||||||

### 外部贡献者

|

- 👀 **零侵入、全覆盖**

|

||||||

|

- 无需侵入改造 `Apache Kafka` ,一键便能纳管 `0.10.x` ~ `3.x.x` 众多版本的Kafka,包括 `ZK` 或 `Raft` 运行模式的版本,同时在兼容架构上具备良好的扩展性,帮助您提升集群管理水平;

|

||||||

`fangjunyu`、`zhoutaiyang`

|

|

||||||

|